R语言数据包性能调优:计算速度与资源管理的提升技巧

发布时间: 2024-11-11 01:48:51 阅读量: 36 订阅数: 39

# 1. R语言基础与性能挑战

## 1.1 R语言简介

R语言是一种用于统计分析、图形表示和报告的编程语言和软件环境。作为S语言的一种实现,R语言在数据科学领域享有极高的声誉。R语言的灵活性和开源特性吸引了众多统计学家和数据分析师,使其成为处理数据的强大工具。

## 1.2 R语言的性能挑战

随着数据量的增长,R语言的性能问题逐渐显现。由于R语言的解释性质和内存管理方式,处理大规模数据集时可能面临速度慢和内存不足的问题。为解决这些挑战,开发者需要了解R语言的基础和性能优化策略,以提升代码效率和扩展其在大数据场景中的应用。

## 1.3 性能优化概述

为了应对性能挑战,开发者可以采取多种优化措施。这些措施包括但不限于:改进数据结构的使用、优化代码逻辑、利用并行计算技术以及整合C/C++等语言提升性能。本章将重点探讨R语言的基础知识,并为接下来的性能优化章节奠定理论基础。

# 2. R语言数据结构与内存管理

### 2.1 R语言基础数据结构

#### 2.1.1 向量、矩阵和数组

在R语言中,向量是最基本的数据结构,它是一个有序的元素集合,这些元素的数据类型必须相同。例如,创建一个整数向量可以使用`c()`函数:

```R

vector_int <- c(1, 2, 3, 4, 5)

```

矩阵是一种二维数组,可以通过`matrix()`函数创建。创建矩阵时,需要指定行数和列数:

```R

matrix <- matrix(1:10, nrow = 2, ncol = 5)

```

数组则可以理解为多维矩阵,它是任何维度的元素集合。可以使用`array()`函数来创建数组:

```R

array_example <- array(1:24, dim = c(2, 3, 4))

```

在处理数据时,向量、矩阵和数组各有其用武之地。例如,对于简单的线性运算,使用向量会比较高效;而矩阵适用于需要二维或更高维度运算的情况。

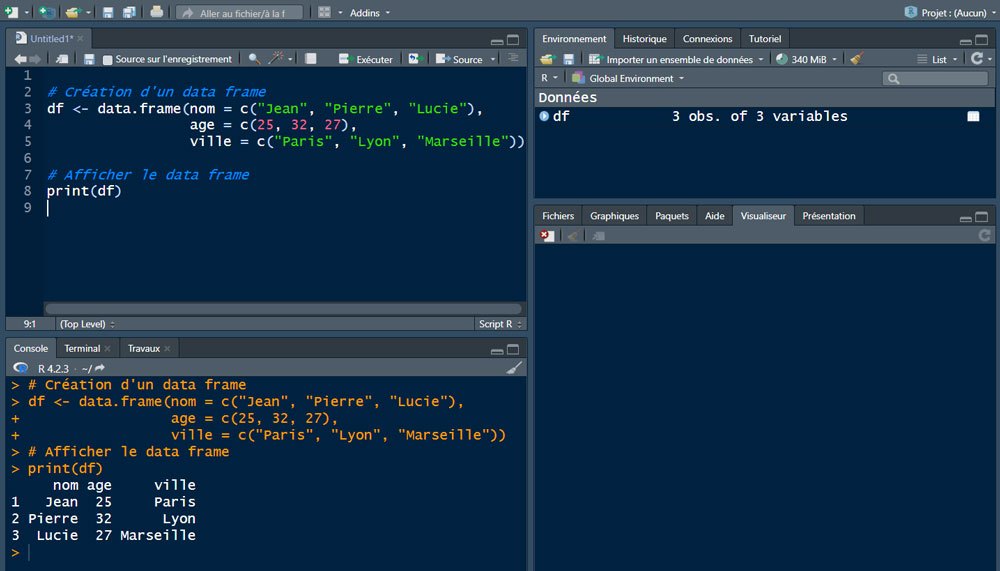

#### 2.1.2 数据框(DataFrame)和列表(List)

数据框(DataFrame)是R语言中用于存储表格型数据的主要数据结构,可以理解为一个拥有列名和行名的向量集合。它允许不同类型的列共存于同一个数据框中。创建数据框可以使用`data.frame()`函数:

```R

data_frame <- data.frame(column1 = 1:4, column2 = c("A", "B", "C", "D"))

```

列表(List)是R中最复杂的数据结构,它可以包含不同类型的元素,包括向量、矩阵、数组、数据框甚至是另一个列表。列表非常适合于存储结构化数据。创建列表使用`list()`函数:

```R

list_example <- list(vector = c(1, 2, 3), matrix = matrix(1:9, nrow = 3))

```

### 2.2 R语言的内存管理机制

#### 2.2.1 内存分配与垃圾回收

R语言采用了一种自动内存管理机制。当创建对象时,R会自动为其分配内存,并在对象不再被引用时通过垃圾回收机制释放内存。R使用了多种垃圾回收策略,包括引用计数和标记-清除算法。

在R中,开发者通常不需要手动管理内存,但是理解内存机制可以帮助编写更高效的代码。例如,避免创建不必要的大对象可以减少内存的压力。

#### 2.2.2 大数据集处理的内存策略

对于大数据集,R语言的标准内存管理可能会成为瓶颈。因此,需要采取特定的策略来处理。一种方法是使用R的外部数据处理工具或库,例如使用`bigmemory`包来创建和操作大型矩阵。

```R

if (!require(bigmemory)) install.packages("bigmemory")

library(bigmemory)

big_matrix <- read.big.matrix(file = "large_dataset.csv", type = "integer", sep = ",")

```

使用这种方法可以将数据加载到内存映射文件中,这样可以将数据处理的内存需求分散到磁盘上,从而避免一次性加载整个数据集到内存中。

### 2.3 代码层面的内存优化

#### 2.3.1 变量作用域与生命周期

在R中,变量的作用域规则遵循词法作用域。了解变量的生命周期对于内存优化至关重要,因为局部变量在不再需要时,其内存会自动被垃圾回收器回收。例如:

```R

f <- function() {

x <- 10 #局部变量x

}

f()

# x 不再存在

```

开发者应该尽量使用局部变量,避免在全局环境中创建不必要的大对象。

#### 2.3.2 环境对象的管理与优化

R中的环境对象是一种存储变量名和值的容器,但它们的使用比数据框或列表更为复杂。环境对象可以提高性能,因为它们对于变量的查找更快。不过,错误地使用环境可能导致内存泄漏。正确管理环境对象,可以在不牺牲性能的情况下优化内存使用。例如:

```R

env <- new.env()

env$x <- 1:1000000

# 在不再需要环境时,记得将其赋值为NULL以释放内存

env <- NULL

```

以上就是关于R语言数据结构与内存管理的基础知识和一些优化技巧。下一章中,我们将探讨如何通过并行计算来进一步提升R语言的计算性能。

# 3. R语言计算性能提升技巧

## 3.1 矩阵运算优化

### 3.1.1 基于矩阵的线性代数运算

矩阵运算在R语言中非常常见,尤其是在统计分析、机器学习等领域。由于矩阵运算通常涉及大量的数值计算,因此优化矩阵运算对于提升R语言的计算性能至关重要。在R中,矩阵运算默认使用了高度优化的数值库,但开发者仍可以通过选择合适的算法和工具进一步提升性能。

以下是一些优化矩阵运算的常见方法:

- 使用高效矩阵操作函数,比如`%*%`来进行矩阵乘法,`crossprod`来进行交叉积计算。

- 在可能的情况下,尽量使用稀疏矩阵来代替密集矩阵。稀疏矩阵只存储非零元素,从而减少了存储和计算的开销。

```r

# 创建密集矩阵

dense_matrix <- matrix(seq(1, 1e4), nrow = 100)

# 创建稀疏矩阵

library(Matrix)

sparse_matrix <- sparseMatrix(i = sample(1:100, 100), j = sample(1:100, 100), x = runif(100))

# 矩阵乘法操作性能比较

dense_product <- system.time(dense_matrix %*% dense_matrix)[3]

sparse_product <- system.time(sparse_matrix %*% sparse_matrix)[3]

# 输出性能比较结果

print(paste("密集矩阵乘法用时:", dense_product))

print(paste("稀疏矩阵乘法用时:", sparse_product))

```

### 3.1.2 矩阵运算的并行处理

R语言支持多线程或多核并行计算,利用并行处理可以显著减少大型矩阵运算的时间。R的并行计算可以通过多种包来实现,如`parallel`、`snow`或`foreach`。并行处理通常涉及到任务的拆分、分发、执行和结果的聚合。

一个简单的方法是使用`parallel`包中的`mcmapply`函数,该函数可以并行执行一个函数于多个参数上。下面的示例展示了如何并行计算矩阵的每一行的某种运算。

```r

library(parallel)

# 并行计算矩阵每行的和

parallel_row_sum <- function(matrix) {

mcmapply(sum, matrix, SIMPLIFY = FALSE, mc.cores = detectCores())

}

# 生成随机矩阵

large_matrix <- matrix(rnorm(1e6), nrow = 1e3)

# 串行计算时间

serial_time <- system.time(rowSums(large_matrix))[3]

# 并行计算时间

parallel_time <- system.time(parallel_row_sum(large_matrix))[3]

# 输出性能提升比较

print(paste("串行计算矩阵行和用时:", serial_time))

print(paste("并行计算矩阵行和用时:", parallel_time))

```

## 3.2 代码级性能优化

### 3.2.1 循环与条件语句的优化

循环是编程中的常见结构,但在R中循环往往是性能瓶颈。优化循环的常用策略包括减少循环内部的计算复杂度、避免重

0

0