【提升系统稳定性】:HDFS副本放置策略管理技巧

发布时间: 2024-10-28 08:39:30 阅读量: 45 订阅数: 40

大数据平台构建:HDFS运行原理.pptx

# 1. HDFS副本放置策略概述

随着大数据存储需求的增长,Hadoop分布式文件系统(HDFS)已成为处理大量数据的常用平台。在HDFS中,数据被自动复制并分散存储到多个数据节点上,以保证数据的可靠性与可用性。副本放置策略在HDFS中扮演着至关重要的角色,它决定了数据的物理分布、系统性能、数据的冗余备份,以及容错能力。

## 1.1 副本放置策略的重要性

副本放置策略影响数据的读写效率和系统故障恢复的能力。合适的策略能有效平衡数据的可用性和存储开销,保证当部分数据节点失败时,数据依然能够被迅速重建和恢复。

## 1.2 HDFS副本放置策略的目标

HDFS副本放置的目标是在保证数据安全的前提下,提高数据访问效率,优化数据恢复速度,并尽量减少对网络和磁盘资源的消耗。接下来的章节,我们将深入分析HDFS副本放置的机制和实践操作。

# 2. 理解HDFS副本放置机制

在第一章中,我们对HDFS副本放置策略进行了概述。接下来,让我们深入探讨HDFS的数据副本放置机制,并理解如何优化以提高数据的可靠性和系统的性能。

## 2.1 HDFS数据副本的原理

### 2.1.1 副本的基本概念与作用

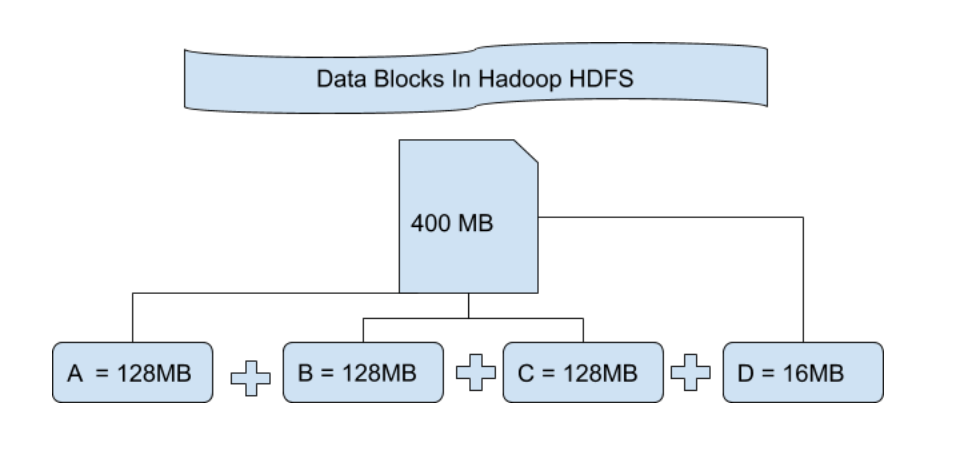

Hadoop分布式文件系统(HDFS)是Hadoop项目的核心组件之一,它专为处理大数据而设计。在HDFS中,文件被分成一个或多个块(block),并且默认情况下,每个块会有三个副本(默认副本数为3)。这三个副本通常分布在不同的节点上,以防止数据丢失并提供高可用性。

副本的作用主要体现在以下几个方面:

- **数据冗余**:副本提供了一种数据备份机制,当一个节点失败时,其他节点上的副本仍然可用,确保数据不会丢失。

- **负载均衡**:副本允许数据在多个节点上分布式存储,使得并行计算变得更加高效,从而提升了系统的整体性能。

- **容错性**:副本的存在使得系统能够承受节点故障而不影响服务的连续性。

### 2.1.2 HDFS中副本放置的默认规则

HDFS的副本放置策略遵循一定的规则以确保数据的可靠性和系统的高效性。默认情况下,当客户端上传一个新文件时,HDFS会按照以下策略进行副本放置:

1. 第一个副本被放置在上传文件的客户端所在的节点上,前提是该节点为集群的一部分。

2. 第二个副本被放置在与第一个副本不同机架上的一个随机节点上,从而确保即使一个机架完全失效,数据依然可用。

3. 第三个以及后续的副本被放置在与第二个副本相同的机架上的不同节点上,但尽量分散以减少机架失效的影响。

这种放置策略确保了数据具有较高的容错能力,同时也试图减少数据访问的延迟。

## 2.2 HDFS副本放置的优化空间

### 2.2.1 副本放置对系统性能的影响

副本的放置直接影响到HDFS的性能。过多的副本数量会导致存储空间的浪费,同时也会增加写入数据时的网络和磁盘I/O开销。相反,副本数量过少则会降低数据的冗余度,增加数据丢失的风险。

因此,选择合适的副本因子至关重要。我们可以通过调整参数`dfs.replication`来设置默认的副本数量。合理的副本因子需要在数据保护和系统性能之间找到一个平衡点。

### 2.2.2 理解副本放置与数据可靠性之间的关系

副本放置策略还与数据的可靠性紧密相关。HDFS通过冗余副本机制保证了即使部分硬件故障,系统仍然能够提供服务并恢复数据。这种可靠性依赖于副本放置的位置和副本的数量。

在实际应用中,需要根据数据的重要性,以及业务对数据可靠性和性能的不同需求,来调整副本策略。例如,对于一些关键数据,可能会增加副本数量以提供更高的可靠性;而对于一些不那么关键的数据,则可能会选择较少的副本数量以节省存储资源。

### 代码块示例及逻辑分析

```bash

hdfs dfsadmin -setReplication /path/to/file 5

```

上述命令展示了如何通过Hadoop的DFSAdmin命令行工具动态改变特定文件的副本因子。这里,`/path/to/file`是需要修改副本因子的文件路径,`5`是我们设置的新副本数。

逻辑分析:此命令通过Hadoop的管理接口修改了文件的副本因子。这会影响到HDFS内部存储管理器,它会触发一个重新复制过程,将选定文件的副本数增加到5。在执行此操作时,需要考虑到系统的负载情况,因为增加副本数会暂时增加存储和网络I/O的使用率。

### 表格展示

下面的表格展示了不同副本因子对于数据可靠性和存储开销的影响:

| 副本因子 | 数据可靠性 | 存储开销 | 性能影响 |

| -------- | ---------- | -------- | -------- |

| 1 | 低 | 低 | 低 |

| 3 | 中等 | 中等 | 中等 |

| 5 | 高 | 高 | 高 |

通过上表,我们可以看到随着副本因子的增加,数据的可靠性也随之增加,但同时存储开销和对系统性能的影响也会增加。

### 结论

理解HDFS的副本放置机制对于管理Hadoop集群至关重要。合理的副本放置策略可以平衡系统性能和数据可靠性之间的关系,从而确保大数据应用的高效和稳定运行。

# 3. 副本放置策略实践操作

## 3.1 配置副本放置策略

### 3.1.1 修改副本放置策略的参数设置

在Hadoop中,可以通过修改`hdfs-site.xml`文件来调整副本放置相关的参数。比如,要修改副本数量,可以设置`dfs.replication`参数。而对于更精细的控制,如指定副本放置在特定的机架,可以通过`dfs.hosts`或`dfs.hosts.excludes`文件来实现。

```xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value> <!-- 默认副本数 -->

</property>

<!-- 其他配置 -->

</configuration>

```

对于副本放置到特定机架的需求,可以通过编辑`dfs.hosts`文件来指定哪些节点属于同一个机架。在配置时,要保证Hadoop集群的网络拓扑配置正确,以防止数据丢失。

### 3.1.2 实时监控副本分布情况

了解副本分布对于副本策略的调整至关重要。可以使用`hdfs fsck`命令检查文件系统健康状况,以及`hdfs dfsadmin -report`命令来获取一个节点上副本的数量。

```bash

hdfs fsck /

hdfs dfsadmin -report

```

监控命令的输出可以帮助管理员判断是否需要调整副本放置策略。例如,如果发现某个数据节点上副本数量异常,可能需要重新平衡或手动干预副本放置。

## 3.2 管理副本的放

0

0