ONNX格式导出与CUDA推理:PyTorch模型部署优化

发布时间: 2024-04-30 22:14:45 阅读量: 117 订阅数: 106

MSP430单片机学习资料MPS430F149单片机之-基于单片机的数据压缩算法的实现

# 1. ONNX格式简介

ONNX(Open Neural Network Exchange)是一种开放的模型格式,用于表示神经网络模型。它允许不同框架和工具之间的模型交换和推理,从而简化了模型部署和优化。ONNX格式具有以下特点:

- **跨平台兼容性:**ONNX模型可以在不同的框架和平台上运行,包括PyTorch、TensorFlow和Caffe2。

- **可解释性:**ONNX格式是人类可读的,便于理解和调试模型。

- **高性能:**ONNX模型经过优化,可以在各种硬件平台上实现高性能推理。

# 2. PyTorch模型导出为ONNX

### 2.1 PyTorch模型的准备

在导出PyTorch模型为ONNX之前,需要确保模型已训练完成并保存为PyTorch格式。以下代码展示了如何加载已训练的PyTorch模型:

```python

import torch

# 加载模型

model = torch.load("my_model.pt")

```

### 2.2 ONNX导出过程

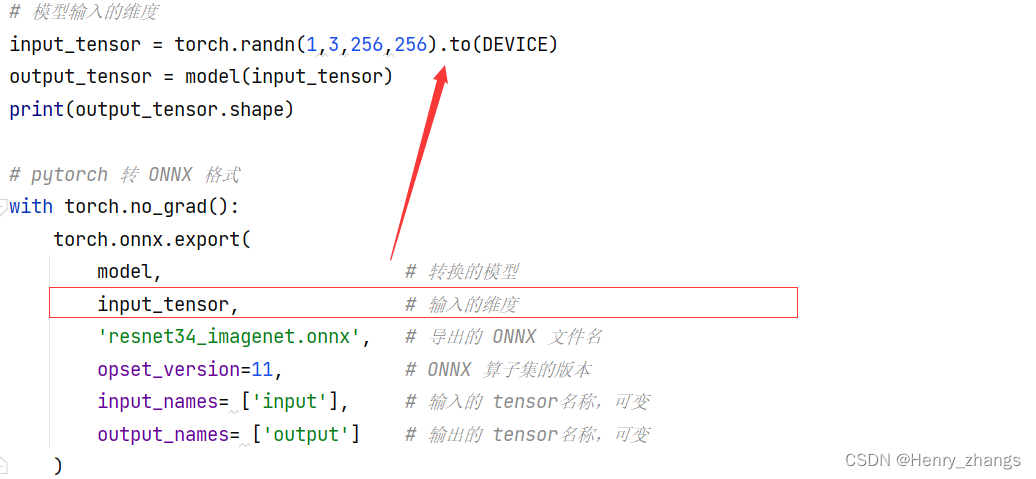

PyTorch提供了`torch.onnx.export`函数将PyTorch模型导出为ONNX格式。该函数需要以下参数:

- `model`: 要导出的PyTorch模型

- `args`: 模型输入的占位符张量

- `f`: 导出ONNX模型的文件路径

- `export_params`: 是否导出模型参数(默认True)

- `opset_version`: ONNX操作集版本(默认11)

以下代码展示了如何使用`torch.onnx.export`函数导出模型:

```python

import torch

# 加载模型

model = torch.load("my_model.pt")

# 准备输入占位符

input_placeholder = torch.randn(1, 3, 224, 224)

# 导出ONNX模型

torch.onnx.export(model, input_placeholder, "my_model.onnx")

```

### 2.3 导出格式的验证

导出ONNX模型后,可以使用`onnxmltools`库验证模型的格式是否正确。`onnxmltools`提供了`check_model`函数,它接受ONNX模型文件路径作为参数,并返回一个布尔值,表示模型是否有效。

以下代码展示了如何使用`check_model`函数验证模型:

```python

import onnxmltools

```

0

0