【深度学习趋势预测】:数据挖掘中的未来趋势预测实践案例

发布时间: 2024-09-08 07:12:24 阅读量: 260 订阅数: 67

# 1. 深度学习在趋势预测中的角色与作用

深度学习作为人工智能领域中的一个关键分支,在趋势预测中发挥着至关重要的作用。由于其强大的数据表示和特征学习能力,深度学习模型能够处理和分析大量复杂的数据集,从而识别潜在的模式和趋势。通过从原始数据中自动提取特征,深度学习为预测未来事件提供了新的可能性,这在金融市场、气候分析和销售预测等领域尤为显著。

本章将简要介绍深度学习在趋势预测中的应用,并对其如何影响未来技术发展进行初步探讨。我们将分析深度学习的基本原理、数据处理流程和模型构建过程,为后续章节中深入探讨具体算法和技术框架打下基础。通过明确深度学习在趋势预测中的地位和作用,读者将对接下来的技术细节和实际应用案例有一个宏观的认识。

# 2. 深度学习基础理论

深度学习作为一种先进的机器学习技术,其基础理论涵盖了数学基础、主要算法和框架等方面。本章将带你深入了解这些基础知识,为后续掌握深度学习在趋势预测中的应用打下坚实的基础。

## 2.1 深度学习的数学基础

### 2.1.1 线性代数在深度学习中的应用

线性代数是深度学习中不可或缺的数学工具,它在处理多维数据时扮演着重要角色。线性代数中的向量、矩阵和张量运算构成了深度学习中数据流动和参数更新的基础。

在深度学习中,线性代数的元素通过向量和矩阵的形式在神经网络的不同层次之间传递。权重和偏置在多层网络中以矩阵形式表示,而前向传播过程实质上就是一系列矩阵乘法和加法操作。反向传播算法中,通过链式法则求导,涉及大量的矩阵求导运算。另外,线性代数中的特征值和特征向量用于理解数据的内在结构,例如在主成分分析(PCA)中,就涉及到了特征值分解的应用。

代码示例:

```python

import numpy as np

# 定义一个简单的矩阵乘法函数

def matrix_multiplication(A, B):

return np.dot(A, B)

# 示例矩阵

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

# 执行矩阵乘法

result = matrix_multiplication(A, B)

print("矩阵乘法结果:")

print(result)

```

在上述代码中,我们使用了NumPy库进行了简单的矩阵乘法操作。这个操作在深度学习的每一层中都会发生,显示了线性代数在深度学习中的基础性作用。

### 2.1.2 概率论与信息论基础

深度学习模型的训练和预测过程都涉及到概率论。例如,在设计损失函数时,通常假设数据的生成遵循一定的概率分布,并通过最大化似然函数或最小化交叉熵来找到最匹配数据的模型参数。

信息论在深度学习中同样重要,它提供了一种衡量数据信息量和数据压缩的方法。比如,在自动编码器中,信息论被用来衡量重构误差与编码的效率。熵的概念在理解神经网络中的信息流动和表示能力方面也有着重要作用。

## 2.2 深度学习的主要算法

### 2.2.1 前馈神经网络

前馈神经网络(FNN)是深度学习中最简单的网络结构,它允许信息单向流动。FNN中的每个神经元只与前一层的神经元相连,并在最后一层输出结果。这种结构简单易懂,但由于其非循环的特性,FNN在处理序列数据时存在局限。

代码示例:

```python

from sklearn.neural_network import MLPRegressor

# 创建一个简单的前馈神经网络回归模型

mlp = MLPRegressor(hidden_layer_sizes=(50,), max_iter=500)

# 训练模型

# 这里假设X_train和y_train已经准备就绪

mlp.fit(X_train, y_train)

# 预测结果

predictions = mlp.predict(X_test)

print("前馈神经网络预测结果:")

print(predictions)

```

在这个例子中,我们使用了sklearn库创建了一个前馈神经网络回归模型,并对数据集进行了训练和预测。

### 2.2.2 卷积神经网络

卷积神经网络(CNN)是深度学习中处理图像和视频数据的首选算法。CNN通过局部感受野、权重共享和池化层的使用,大大减少了模型的参数数量,同时提高了对图像的特征提取能力。

代码示例:

```python

from keras.models import Sequential

from keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

# 构建一个简单的卷积神经网络模型

model = Sequential()

model.add(Conv2D(32, kernel_size=(3, 3), activation='relu', input_shape=(64, 64, 3)))

model.add(MaxPooling2D(pool_size=(2, 2)))

model.add(Flatten())

model.add(Dense(units=128, activation='relu'))

model.add(Dense(units=1, activation='sigmoid'))

# 编译模型

***pile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

# 模型概要

model.summary()

```

在这段代码中,我们构建了一个使用卷积层和池化层的简单CNN模型,并通过Keras框架进行编译和输出模型概要。卷积层的参数解释包括滤波器数量、大小以及激活函数。

### 2.2.3 循环神经网络

循环神经网络(RNN)非常适合处理序列数据,比如时间序列和文本。RNN能够在序列的每个时间点上维护一个状态,使得它能够使用先前的信息来影响当前的输出。

代码示例:

```python

from keras.models import Sequential

from keras.layers import SimpleRNN, Dense

# 构建一个简单的循环神经网络模型

model = Sequential()

model.add(SimpleRNN(units=50, return_sequences=True, input_shape=(timesteps, input_dim)))

model.add(SimpleRNN(units=50))

model.add(Dense(units=1))

# 编译模型

***pile(optimizer='adam', loss='mean_squared_error')

# 模型概要

model.summary()

```

此示例中,我们使用了Keras框架创建了一个含有两个RNN层的简单模型,这种结构常用于时间序列分析。RNN层的`return_sequences`参数设置为True时,表示返回整个序列,否则只返回序列的最后一个输出。

## 2.3 深度学习框架简介

### 2.3.1 TensorFlow基础

TensorFlow是由Google开发的一个开源深度学习框架。它允许开发者用数据流图的方式进行高性能数值计算。TensorFlow提供了丰富的API,易于实现复杂的算法,并且拥有良好的扩展性。

代码示例:

```python

import tensorflow as tf

# 定义一个简单的TensorFlow计算图

a = tf.constant(2)

b = tf.constant(3)

c = a + b

# 创建一个会话来执行计算图

with tf.Session() as sess:

result = sess.run(c)

print("计算结果:", result)

```

在这个例子中,我们定义了一个TensorFlow的计算图,并通过会话(Session)来执行这个图。这种方式可以优化复杂操作的性能,非常适合大规模深度学习任务。

### 2.3.2 PyTorch的基本使用

PyTorch是一个动态的、易于使用的深度学习框架,它支持自动求导系统,有助于加速研究开发和实验。PyTorch的设计理念类似于numpy,能够无缝地与Python原生数据结构交互。

代码示例:

```python

import torch

# 定义一个简单的PyTorch张量

a = torch.tensor([2.0, 3.0], requires_grad=True)

b = torch.tensor([6.0, 4.0], requires_grad=True)

c = a + b

# 计算c的梯度

c.backward(torch.tensor([1.0, 1.0]))

print("a的梯度:", a.grad)

print("b的梯度:", b.grad)

```

在这个例子中,我们使用PyTorch创建了一个带有梯度属性的张量,并展示了反向传播的过程。PyTorch的这种易用性使其在学术界和工业界都十分受欢迎。

本章中,我们对深度学习的基础理论进行了全面的介绍,从数学基础到主要算法,再到主流深度学习框架的使用,为深入理解深度学习的运作机制和未来应用奠定了扎实的理论基础。接下来的章节,我们将进一步探讨深度学习在数据挖掘中的应用,以及如何利用这些技术进行趋势预测。

# 3. 数据挖掘技术的深度学习应用

在深入探讨深度学习如何应用于趋势预测之前,我们必须首先了解其在数据挖掘领域的应用。数据挖掘是一个涵盖从数据清洗到模型部署的广泛领域,其中深度学习技术扮演了至关重要的角色。

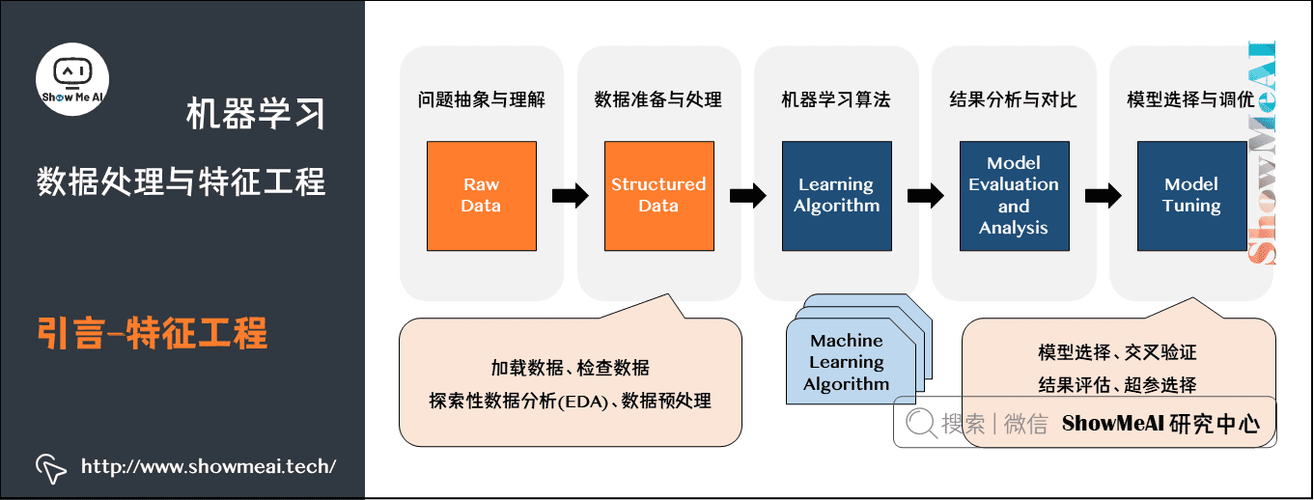

## 3.1 数据预处理与特征工程

在数据挖掘中,预处理和特征工程是准备数据以供模型学习的关键步骤。高质量的输入数据可以显著提升模型的准确性和有效性。

### 3.1.1 数据清洗和标准化

数据清洗是指识别并处理数据集中的错误、缺失值以及异常值,而数据标准化则是将数据缩放到统一的范围或分布,以便模型可以更有效地学习。

```python

import pandas as pd

from sklearn.preprocessing import StandardScaler

# 假设我们有一个包含特征和目标变量的DataFrame

data = pd.read_csv('data.csv')

# 缺失值填充

data.fillna(data.mean(), inplace=True

```

0

0