HDFS容错机制详解:安全模式在其中的核心作用

发布时间: 2024-10-29 18:16:50 阅读量: 44 订阅数: 19

# 1. HDFS的基本概念和架构

## 1.1 HDFS的定义

Hadoop分布式文件系统(HDFS)是Apache Hadoop项目的核心子项目之一。它是一个高度容错的系统,用于在廉价硬件上存储大量数据。HDFS提供高吞吐量的数据访问,非常适合大规模数据集的应用。

## 1.2 HDFS的核心组件

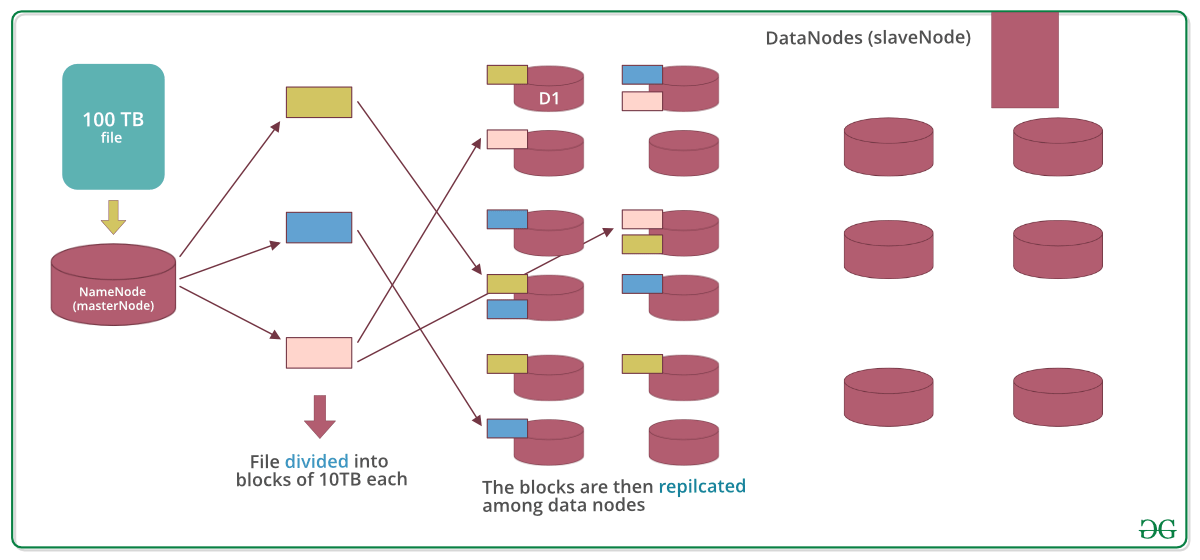

HDFS架构包含两种类型的节点:NameNode和DataNode。NameNode管理文件系统的命名空间并维护文件系统的树及整个HDFS集群中所有文件的元数据。DataNode则存储实际的数据,通常一个节点对应一个物理机器上的数据块。

## 1.3 HDFS的工作原理

HDFS以“块”为单位存储数据,这有助于在分布式环境中进行并行处理。客户端通过HDFS API与系统交互,对文件进行读写操作。HDFS通过块复制和心跳机制保证数据的可靠性和系统的高可用性。

```java

// 伪代码:HDFS读写操作示例

// 创建一个HDFS文件系统实例

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

// 写入数据到HDFS

FSDataOutputStream out = fs.create(new Path("/user/hadoop/file.txt"));

out.writeUTF("Hello HDFS");

out.close();

// 从HDFS读取数据

FSDataInputStream in = fs.open(new Path("/user/hadoop/file.txt"));

in.readUTF();

in.close();

```

以上代码展示了一个简单的HDFS读写操作过程,通过这个过程可以窥见HDFS数据流的基本工作方式。HDFS的设计允许系统在出现硬件故障时仍然能够保持高可用性,并允许对大数据集进行高效的并行处理。

# 2. HDFS的容错机制原理

### 2.1 HDFS数据冗余策略

HDFS作为大数据存储的核心组件之一,其数据冗余策略对于数据的可靠性和系统的稳定性起到了至关重要的作用。HDFS通过数据块复制的方法来保证数据的冗余,从而有效地防范硬件故障导致的数据丢失。

#### 2.1.1 数据块复制的基本原理

HDFS将文件分割为一系列的块,并将这些块以多个副本的形式分布在集群的不同节点上。每个块默认有三个副本,这个数量可以根据实际需求进行调整。HDFS默认的复制因子是3,意味着每个数据块会存储三份,分别位于不同的数据节点上。

数据的复制不仅能够提高数据的可用性,还能在某些节点出现故障时保证数据的完整性。例如,当一个数据节点因为硬件故障而宕机时,其他节点上的数据块副本仍然可以提供数据读取服务,从而确保服务的连续性。

#### 2.1.2 数据块放置策略和副本放置

数据块的放置策略影响着数据的可靠性以及集群的性能。HDFS使用一种称为“机架感知”(rack awareness)的数据块放置策略。在这种策略下,HDFS会将数据块的副本分散存储在不同的机架上。如果一个机架失效,由于副本分散在其他机架,系统仍然可以通过其他机架上的副本访问数据。

副本放置的策略具体包括:

- 第一个副本放置在写入节点的本地机架上。

- 第二个和第三个副本分别放置在不同的机架上,最好是不同网络拓扑结构的机架上。

- 其余副本放置策略则根据集群的配置和容量动态决定。

### 2.2 HDFS的故障检测和恢复过程

HDFS的故障检测和恢复过程是保证数据可靠性的关键环节。HDFS通过心跳机制和状态监控实时了解每个节点的健康状况,并在发现节点故障时,自动进行数据恢复。

#### 2.2.1 心跳机制和状态监控

心跳机制是HDFS监控数据节点和名称节点状态的重要手段。数据节点会定期向名称节点发送心跳信号,报告自己的运行状态。名称节点通过心跳频率来评估数据节点的健康状况。如果名称节点在指定时间内没有收到某个数据节点的心跳信号,就会认为该节点已经宕机,并开始执行数据恢复流程。

此外,HDFS还通过其他监控机制来检测节点和数据块的健康状态,如数据节点上的磁盘检查等。

#### 2.2.2 故障节点的自动切换和恢复

当HDFS检测到某个数据节点故障时,系统会自动进行数据恢复。首先,HDFS会将故障节点上的所有活动任务转移到其他健康的节点上,然后触发副本的创建和重新分配过程,使得丢失的数据块得以补充。这个过程由名称节点负责管理。

故障恢复过程中,HDFS会根据配置的副本放置策略,自动在其他健康节点上创建新的数据块副本。这不仅确保了数据的冗余度,也保证了系统负载的均衡。例如,如果数据节点A宕机,与它在同一机架上的其他节点会承担起副本创建的任务,同时名称节点还会在其他机架上创建副本,以维护数据块的机架分布策略。

为了保证数据的可靠性和一致性,在副本创建和恢复的过程中,HDFS使用了数据校验和一致性检查机制,确保新创建的数据块与原始数据块完全一致。

以上是对第二章的深入解析,接下来是具体章节的代码和示例说明。考虑到二级章节的具体性,以下是对应的代码块和流程图。

#### 2.1.2 数据块放置策略和副本放置代码示例

```java

// 伪代码,展示如何在HDFS中设置副本放置策略

public void setReplicationPolicy(HdfsConfiguration conf, String policy) {

conf.set("dfs.replication.policy", policy);

// 调用HDFS API根据策略分配副本

...

}

```

在这个代码块中,我们使用HDFS的配置对象`HdfsConfiguration`来设置副本放置策略。`dfs.replication.policy`参数指定了副本放置的具体策略。实际上,HDFS的配置可能更复杂,需要结合实际的存储需求和集群的网络拓扑结构。

#### 2.2.2 故障节点的自动切换和恢复流程图

```mermaid

graph LR

A[数据节点故障检测] --> B[任务转移到其他节点]

B --> C[副本恢复]

C --> D[副本分配]

D --> E[数据块校验和一致性检查]

E --> F[故障节点恢复完成]

```

mermaid流程图表示了故障节点的自动切换和恢复过程。从故障检测开始,到任务转移,再到副本恢复和分配,最终进行数据块的校验和一致性检查,确保恢复过程的正确性和数据的完整性。

以上内容作为第二章的进一步深入和对容错机制原理的细化讨论,接下来的章节将会继续围绕HDFS的其他关键功能和优化实践展开。

# 3. HDFS安全模式的作用和机制

## 3.1 安全模式的定义和应用场景

### 3.1.1 安全模式的启动和退出条件

HDFS的安全模式是一种特殊的模式,用来确保系统的稳定性和数据的完整性。在安全模式期间,HDFS的NameNode不会进行数据块的复制

0

0