解析图像特征提取的奥秘:语义分割中的卷积神经网络

发布时间: 2024-08-22 17:22:39 阅读量: 25 订阅数: 41

# 1. 语义分割概述

**语义分割**是一种计算机视觉任务,其目标是为图像中的每个像素分配一个语义标签,从而将图像分割成具有不同语义含义的区域。与传统的图像分割不同,语义分割不仅关注对象的边界,还关注对象的类别信息。

语义分割在自动驾驶、医疗图像分析和遥感图像处理等领域有着广泛的应用。例如,在自动驾驶中,语义分割可以帮助车辆识别道路、行人和其他物体,从而实现安全驾驶。在医疗图像分析中,语义分割可以帮助医生识别肿瘤、血管和其他解剖结构,从而辅助诊断和治疗。

# 2. 卷积神经网络基础

### 2.1 卷积层和池化层

**卷积层**

卷积层是CNN中最重要的层之一,它通过卷积运算提取图像特征。卷积运算的原理是将一个称为卷积核(或滤波器)的小矩阵与输入图像逐像素滑动,并计算卷积核与图像对应区域元素的点积。卷积核的权重由模型训练过程中学习得到。

**池化层**

池化层用于减少图像特征图的大小,同时保留重要信息。池化操作通常使用最大池化或平均池化。最大池化选择卷积核覆盖区域内的最大值,而平均池化则计算平均值。池化层有助于控制过拟合,并提高模型的鲁棒性。

### 2.2 激活函数和损失函数

**激活函数**

激活函数用于引入非线性到网络中,使模型能够学习复杂的关系。常用的激活函数包括ReLU、sigmoid和tanh。ReLU函数(f(x) = max(0, x))是一种简单的非线性函数,在深度学习中广泛使用。

**损失函数**

损失函数衡量模型预测与真实标签之间的差异。常用的损失函数包括交叉熵损失和均方误差损失。交叉熵损失用于分类任务,而均方误差损失用于回归任务。

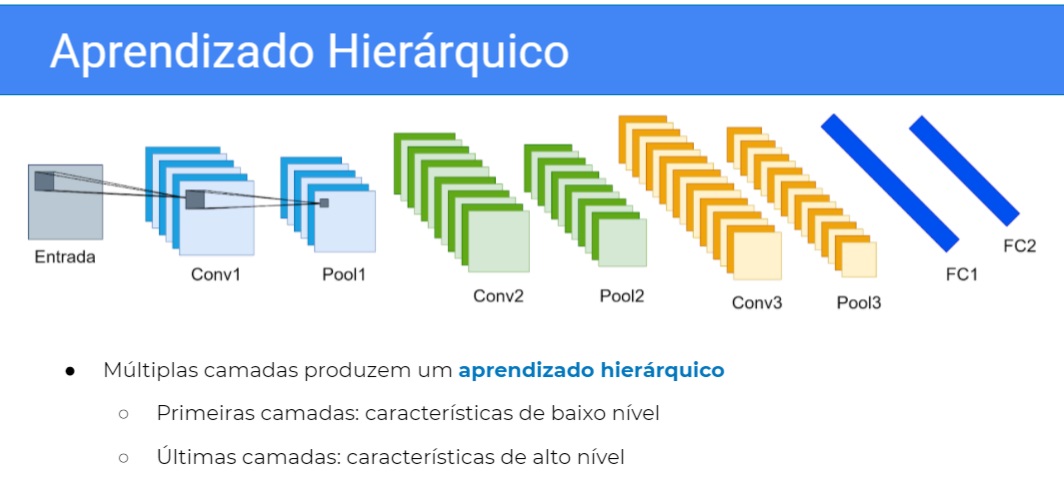

### 2.3 网络架构和训练方法

**网络架构**

CNN的网络架构通常由卷积层、池化层、激活函数和全连接层组成。卷积层和池化层提取图像特征,而全连接层用于分类或回归。

**训练方法**

CNN的训练通常使用反向传播算法。反向传播算法计算损失函数关于模型权重的梯度,并使用梯度下降法更新权重。优化算法,如Adam和RMSProp,用于加速训练过程。

**代码示例:**

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

class CNN(nn.Module):

def __init__(self):

super(CNN, self).__init__()

self.conv1 = nn.Conv2d(1, 32, 3, 1) # 卷积层,输入通道数为1(灰度图像),输出通道数为32,卷积核大小为3x3,步长为1

self.pool1 = nn.MaxPool2d(2, 2) # 池化层,最大池化,池化核大小为2x2,步长为2

self.conv2 = nn.Conv2d(32, 64, 3, 1) # 卷积层,输入通道数为32,输出通道数为64,卷积核大小为3x3,步长为1

self.pool2 = nn.MaxPool2d(2, 2) # 池化层,最大池化,池化核大小为2x2,步长为2

self.fc1 = nn.Linear(64 * 4 * 4, 1024) # 全连接层,输入维度为64 * 4 * 4(池化后的特征图大小),输出维度为1024

self.fc2 = nn.Linear(1024, 10) # 全连接层,输入维度为1024,输出维度为10(分类任务,类别数为10)

def forward(self, x):

x = self.conv1(x) # 卷积层1

x = F.relu(x) # 激活函数ReLU

x = self.pool1(x) # 池化层1

x = self.conv2(x) # 卷积层2

x = F.relu(x) # 激活函数ReLU

x = self.pool2(x) # 池化层2

x = x.view(x.size(0), -1) # 展平特征图

x = self.fc1(x) # 全连接层1

x = F.relu(x) # 激活函数ReLU

x = self.fc2(x) # 全连接层2

return x

# 训练代码

model = CNN()

optimizer = torch.optim.Adam(model.parameters())

loss_fn = nn.CrossEntropyLoss()

for epoch in range(10):

for batch in train_data:

images, labels = batch

outputs = model(images)

loss = loss_fn(outputs, labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

```

**逻辑分析:**

该代码定义了一个CNN模型,用于图像分类任务。模型包含两个卷积层和两个池化层,以及两个全连接层。卷积层提取图像特征,池化层减少特征图大小,全连接层用于分类。模型使用Adam优化器和交叉熵损失函数进行训练。

# 3.1 U-Net

U-Net是一种流行的语义分割架构,由Olaf Ronneberger等人于2015

0

0