【性能突破】深入SocketServer

发布时间: 2024-10-04 19:39:14 阅读量: 28 订阅数: 25

python SocketServer源码深入解读

# 1. SocketServer的基本原理

## 1.1 网络通信概述

网络通信是计算机间进行数据传输和信息交换的过程,它遵循一定的规则,这些规则统称为协议。SocketServer作为网络通信中服务器端的模型,利用这些协议来处理客户端的连接请求,实现数据的接收和发送。

## 1.2 SocketServer的职能

SocketServer的核心职能是监听特定的端口,当有客户端发起连接请求时,接受并建立连接,为数据传输提供通道。它能够处理多个客户端,保证数据的正确分发和同步。

## 1.3 应用协议层与传输层

在TCP/IP协议栈中,SocketServer主要作用于传输层,通常依赖于更上层的应用协议来提供服务。例如,HTTP协议运行在传输层的TCP协议之上,而SocketServer可以用来构建HTTP服务器,处理HTTP请求。

## 1.4 SocketServer与Socket API

SocketServer本质上是对套接字编程接口(Sockets API)的一种封装,简化了服务器端的编程。Socket API提供了创建连接、监听端口、数据传输等功能的底层实现,而SocketServer则在此基础上提供了更为高级的功能,如线程或进程管理、请求处理等。

通过这一章的介绍,我们将掌握SocketServer在互联网架构中的位置以及它与客户端交互的基本原理,为深入探讨SocketServer的编程实践打下基础。

# 2. SocketServer的编程实践

## 2.1 网络通信基础

### 2.1.1 TCP/IP协议栈解析

TCP/IP协议栈是一系列网络协议的集合,它定义了数据在网络中传输的标准和格式。在这个模型中,数据传输被分为四个层次:链路层、网络层、传输层和应用层。每一层都负责不同的任务,并且为上层提供服务。

在链路层,数据被封装成帧,通过物理介质传输。网络层主要负责IP地址的路由选择,确保数据包能够准确地到达目的地。传输层为应用层提供端到端的通信服务,主要协议有TCP和UDP。TCP保证数据传输的可靠性,而UDP则提供较为简单的无连接服务。应用层则直接与用户的应用程序相关,如HTTP协议、FTP协议等。

网络通信中,TCP三次握手是建立连接的重要过程。客户端发送一个带有SYN标志的包开始连接,服务器响应SYN-ACK包确认连接,最后客户端发送ACK包完成连接。这个过程确保了双方都可以接收和发送数据。

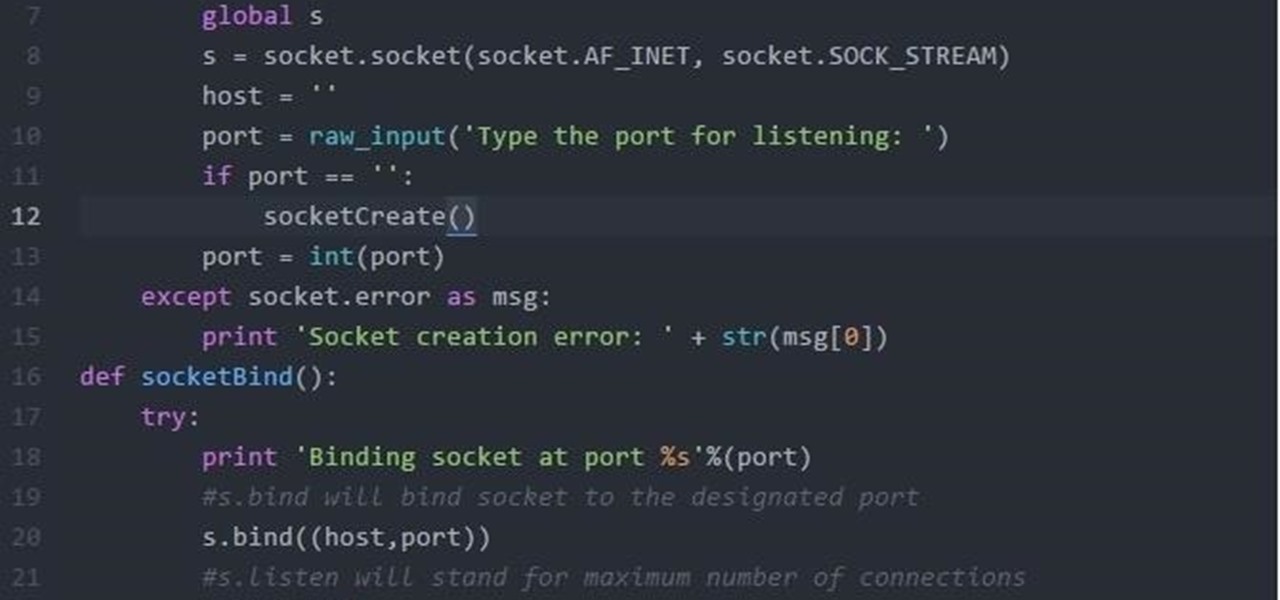

### 2.1.2 套接字编程接口(Sockets API)

套接字是网络通信的基石。它提供了一种机制,让网络中的应用程序能够发送和接收数据。套接字API是用于开发网络应用程序的一组函数调用,这些函数允许程序通过网络发送和接收数据。

在Unix-like系统中,套接字API非常丰富,常用的函数包括socket()用于创建套接字,bind()用于绑定地址,listen()用于监听连接请求,accept()用于接受连接请求,send()和recv()用于数据的发送和接收。

编写一个简单的TCP服务器和客户端的示例代码如下:

```c

// TCP服务器端示例代码

int main() {

int server_fd, new_socket;

struct sockaddr_in address;

int opt = 1;

int addrlen = sizeof(address);

char buffer[1024] = {0};

char *hello = "Hello from server";

// 创建套接字

if ((server_fd = socket(AF_INET, SOCK_STREAM, 0)) == 0) {

perror("socket failed");

exit(EXIT_FAILURE);

}

// 设置套接字选项

if (setsockopt(server_fd, SOL_SOCKET, SO_REUSEADDR | SO_REUSEPORT, &opt, sizeof(opt))) {

perror("setsockopt");

exit(EXIT_FAILURE);

}

address.sin_family = AF_INET;

address.sin_addr.s_addr = INADDR_ANY;

address.sin_port = htons(8080);

// 绑定套接字到端口

if (bind(server_fd, (struct sockaddr *)&address, sizeof(address))<0) {

perror("bind failed");

exit(EXIT_FAILURE);

}

// 监听套接字

if (listen(server_fd, 3) < 0) {

perror("listen");

exit(EXIT_FAILURE);

}

// 接受连接

if ((new_socket = accept(server_fd, (struct sockaddr *)&address, (socklen_t*)&addrlen))<0) {

perror("accept");

exit(EXIT_FAILURE);

}

// 读取数据

read(new_socket, buffer, 1024);

printf("Message from client: %s\n", buffer);

// 发送数据

send(new_socket, hello, strlen(hello), 0);

printf("Hello message sent\n");

// 关闭套接字

close(new_socket);

close(server_fd);

return 0;

}

```

```c

// TCP客户端示例代码

int main() {

struct sockaddr_in serv_addr;

char *hello = "Hello from client";

char buffer[1024] = {0};

int sock = 0;

if ((sock = socket(AF_INET, SOCK_STREAM, 0)) < 0) {

printf("\n Socket creation error \n");

return -1;

}

serv_addr.sin_family = AF_INET;

serv_addr.sin_port = htons(8080);

// 将IPv4地址从文本转换为二进制形式

if(inet_pton(AF_INET, "***.*.*.*", &serv_addr.sin_addr)<=0) {

printf("\nInvalid address/ Address not supported \n");

return -1;

}

// 连接到服务器

if (connect(sock, (struct sockaddr *)&serv_addr, sizeof(serv_addr)) < 0) {

printf("\nConnection Failed \n");

return -1;

}

// 发送数据

send(sock, hello, strlen(hello), 0);

printf("Hello message sent\n");

// 读取响应

read(sock, buffer, 1024);

printf("Message from server: %s\n", buffer);

// 关闭套接字

close(sock);

return 0;

}

```

上述代码展示了创建TCP服务器和客户端的基本过程。服务器监听特定端口,等待客户端连接,并进行简单的数据交互。

### *.*.*.* 代码逻辑解读

1. **创建套接字**:使用socket()函数创建一个新的套接字描述符。

2. **设置套接字选项**:使用setsockopt()函数允许地址和端口的重用。

3. **绑定套接字**:使用bind()函数将套接字绑定到服务器的IP地址和端口号。

4. **监听连接**:使用listen()函数让套接字进入监听状态,准备接受客户端连接。

5. **接受连接**:使用accept()函数等待并接受客户端的连接请求,返回一个新的套接字来与客户端通信。

6. **读取数据**:使用read()函数从客户端接收数据。

7. **发送数据**:使用send()函数向客户端发送响应消息。

8. **关闭套接字**:使用close()函数关闭与客户端的连接和服务器监听的套接字。

### *.*.*.* 参数说明

- `AF_INET`:表示使用IPv4地址。

- `SOCK_STREAM`:表示TCP协议,基于连接的传输层协议。

- `htons(8080)`:将端口号从主机字节序转换为网络字节序。

- `inet_pton(AF_INET, "***.*.*.*", &serv_addr.sin_addr)`:将IPv4地址从文本格式转换为二进制形式。

## 2.2 SocketServer的结构和组件

### 2.2.1 服务器端的组件构成

一个标准的SocketServer由多个组件构成,包括监听器、处理器和连接器。监听器负责监听客户端的连接请求,处理器处理业务逻辑,而连接器负责维护连接

0

0