MapReduce压缩技术实战:不同类型数据压缩选择的专家建议

发布时间: 2024-11-01 11:59:12 阅读量: 27 订阅数: 31

# 1. MapReduce压缩技术基础

MapReduce是处理大数据的关键技术之一,而压缩技术是优化MapReduce性能的有力工具。在本章中,我们将深入了解MapReduce压缩技术的理论基础,包括压缩技术如何在数据存储和处理中发挥关键作用,以及它如何影响MapReduce作业的执行效率和资源利用。

## 1.1 MapReduce压缩技术的重要性

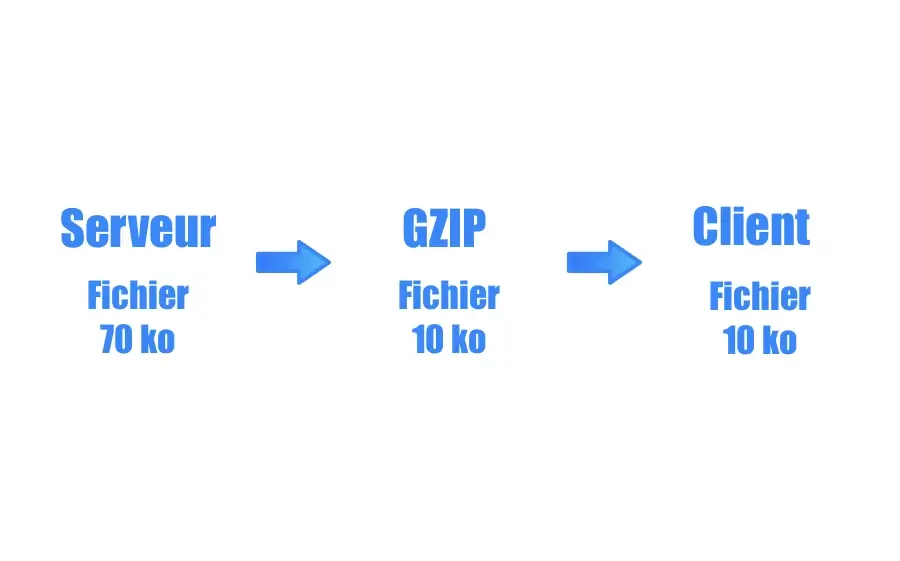

MapReduce通过分割大数据集为小块进行并行处理,压缩技术能够在这一过程中显著减少磁盘I/O操作,降低网络传输的数据量,并且节约存储空间。这一章将探讨压缩在提高MapReduce处理效率中的关键作用,并展示其对于整体大数据处理架构的重要性。

## 1.2 压缩技术在数据处理中的作用

压缩技术在MapReduce中作用主要体现在以下几个方面:

- **减少存储需求**:数据压缩可以大幅度减少对存储空间的需求,对于存储成本高昂的大数据环境来说,这一点尤为重要。

- **提升处理速度**:压缩后的数据在传输和处理过程中可以加快速度,尤其是对于网络带宽和处理能力有限的系统。

- **减少I/O开销**:通过减少磁盘读写次数,压缩技术可以直接降低系统的I/O负担,提升整体的处理效率。

通过理解这些作用,MapReduce用户可以更好地决定何时以及如何在他们的作业中应用压缩技术,以及选择合适的压缩算法来达到最优的处理效果。

# 2. 不同数据类型和压缩算法的理论分析

### 2.1 常见的数据类型及其特征

在数据处理领域,数据可以被分类为不同的类型,每种类型都有其独特的特性,对压缩算法的选择有着直接影响。了解这些数据类型及其特征,是进行有效压缩的第一步。

#### 2.1.1 文本数据的特点与压缩需求

文本数据通常由字符序列组成,具有明显的冗余性。在自然语言中,某些字母或单词的出现频率远高于其他字符,这种现象称为文本数据的统计冗余。常见的文本压缩算法,如Huffman编码和LZ77,都是基于统计冗余性来提高压缩效率的。

例如,Huffman编码为常见的字符分配较短的编码,而为不常见的字符分配较长的编码,以此达到压缩数据的目的。在选择压缩算法时,文本数据由于其结构相对简单,压缩率通常较高,适合使用基于字典的压缩算法。

#### 2.1.2 二进制数据的压缩策略

与文本数据相比,二进制数据不遵循任何语言规则,压缩时不能依赖于统计冗余。因此,二进制数据的压缩策略更多地依赖于数据的模式和结构。例如,数字图像数据可以通过预测编码和变换编码实现有效压缩。

预测编码通过利用数据的局部相关性来预测像素值,然后只存储预测误差,这样做可以减少数据量。变换编码如离散余弦变换(DCT),常用于图像和视频数据的压缩,其通过将数据从空间域转换到频率域,可以去除数据中的空间冗余,再进行量化和熵编码以实现压缩。

### 2.2 常用压缩算法概述

#### 2.2.1 压缩算法的分类

压缩算法可以按照有损和无损来分类。无损压缩允许数据在被压缩后可以完全无误地还原,主要用于文本和可执行文件的压缩。而有损压缩则在数据压缩的过程中会丢失部分信息,这通常用在多媒体文件(如图像、音频、视频)中,因为在这些场合中,人眼或耳朵对某些信息的损失不敏感。

从实现方法上,压缩算法可以分为基于字典的算法、基于预测的算法、基于变换的算法等。每个类别下还有多种具体的算法,如Lempel-Ziv算法系列(LZ77、LZ78)、霍夫曼编码、游程编码等。

#### 2.2.2 算法的时间和空间效率

不同的压缩算法在执行时对计算资源和存储资源的要求各有不同。时间效率通常关注算法压缩和解压缩的速度,而空间效率则关注算法本身所需的空间开销以及压缩后数据的大小。

例如,LZ77算法在压缩时,需要创建和维护一个滑动窗口来存储最近处理过的数据,这需要较大的内存空间。但是,由于其压缩速度相对较快,适合实时或近实时的数据压缩。相对的,Huffman编码虽然压缩率较高,但由于需要构建一棵哈夫曼树,其压缩和解压缩速度可能较慢。

### 2.3 压缩算法与数据类型匹配原理

#### 2.3.1 数据冗余度分析

压缩的核心原理是减少数据中的冗余度。数据冗余度的分析是选择合适压缩算法的关键。冗余度可以分为时间冗余、空间冗余、信息熵冗余等。例如,音频文件中可能有长时间的静音段落,这部分数据就是时间冗余。而图像文件中,相邻像素通常变化不大,这是空间冗余。

#### 2.3.2 算法选择对性能的影响

选择合适的压缩算法对于保持数据完整性、提高压缩效率及降低资源消耗至关重要。算法的选择会直接影响压缩比、压缩速度、内存使用量、CPU占用率等性能指标。压缩比是指压缩后数据的大小与原始数据大小的比例。高压缩比意味着较低的存储成本和传输时间,但通常会牺牲压缩和解压缩的速度。

例如,在处理大量日志文件时,可以采用适合文本数据的压缩算法,如GZIP或BZIP2,这些算法能够提供很好的压缩比,并且在压缩和解压缩的速度上也相对平衡。在对大型图像数据库进行压缩时,则可能需要考虑使用JPEG或PNG这类专门针对图像数据设计的有损或无损压缩格式。

# 3. MapReduce中的压缩实践

## 3.1 MapReduce压缩设置和优化

### 3.1.1 Hadoop生态中的压缩工具

在Hadoop的生态系统中,压缩工具不仅仅局限于数据压缩这一个用途。它们在数据的存储、传输以及处理上发挥着至关重要的作用。Hadoop提供了多种压缩编码器和解码器,每个编码器针对不同的数据类型和处理需求进行了优化。

压缩工具的分类依据,主要包括其压缩比、压缩/解压缩速度以及与Hadoop生态系统的兼容性。例如,Gzip压缩工具提供了较好的压缩比,适用于存储空间有限的场景。而Snappy压缩编码器则提供了更快的压缩速度,适用于那些更重视处理速度的实时处理或流处理场景。

### 3.1.2 压缩参数的调整和选择

在MapReduce作业中设置压缩,首先需要考虑到作业的I/O需求和内存限制。压缩参数的调整需要在压缩比和处理速度之间进行权衡。具体参数的设置需要依据实际场景和数据的特性进行配置。

以Hadoop为例,作业级别的压缩可以通过配置文件或命令行参数来实现。`***press` 设置为true来启用压缩,而`***press.codec` 选项用于指定压缩编码器类。

```shell

# 设置压缩参数

***press=***press.codec=***press.GzipCodec

```

在选择合适的压缩算法时,需要评估数据的读写频率、数据量大小、压缩和解压缩的速

0

0