【Python数据结构性能提升秘籍】:内存管理与效率飞跃技巧

发布时间: 2024-09-12 13:47:37 阅读量: 145 订阅数: 64

评估数据结构效率:理论分析与代码实践

# 1. Python数据结构概述

## 1.1 Python数据结构的组成

Python作为一门高级编程语言,其数据结构是程序设计的基础。Python支持多种数据结构,包括但不限于列表(List)、元组(Tuple)、字典(Dictionary)、集合(Set)等。这些结构不仅方便了数据的存储和操作,还允许在不同的应用场景下灵活使用。

## 1.2 数据结构在编程中的重要性

对数据结构的理解对于成为一名高效的程序员至关重要。良好的数据结构选择可以提升程序的性能和可读性,影响内存的使用效率,降低复杂度,从而提高软件的整体性能。

## 1.3 数据结构的选择与应用

不同的数据结构在不同的操作上性能各异。选择合适的数据结构需要考虑数据的类型、需要执行的操作、存储的元素数量等因素。例如,列表适用于快速的元素访问和插入,而字典则在需要通过键快速查找值时更为高效。理解这些基础概念对后续的性能优化有着重要的意义。

总结而言,本章将为读者提供Python数据结构的全景视图,包括它们的定义、性能特点以及在实际编程中如何做出合适的选择。这是进入深入学习Python性能优化前的必要准备。

# 2. 内存管理机制

## 2.1 Python内存管理基础

Python是一种高级编程语言,拥有强大的内存管理能力,其背后隐藏着复杂的内存分配策略。了解这些策略对于写出高效的Python代码至关重要。Python内存管理的基础包括内存的分配和引用计数机制。

### 2.1.1 Python的内存分配策略

在Python中,内存分配通常是指Python解释器为对象分配空间的过程。Python使用私有堆空间来管理内存,这意味着所有Python对象和数据结构都位于私有堆中,由解释器自动管理。Python内存管理器会负责分配内存给新对象,并在对象不再使用时释放内存。

Python内存分配的关键点包括:

- **对象缓冲池**:为了避免频繁地与底层系统调用进行交互,Python会使用对象缓冲池来分配一些常用的小对象,如整数和小字符串。

- **垃圾回收**:为了处理不再使用的对象,Python有一个内置的垃圾回收器,它通过引用计数和循环垃圾检测来自动回收内存。

- **内存池**:对于某些特定类型的内存需求,比如数组,Python可能会使用内存池来减少内存碎片,并提高分配效率。

Python内存分配策略使得程序员不需要直接与内存进行交互,从而减少了内存泄露和指针错误等低级问题的发生。

### 2.1.2 引用计数机制及其局限性

引用计数是Python内存管理的基础机制之一。每个Python对象都维护一个计数器,记录有多少引用指向它。当对象的引用计数变为零时,即表示没有任何变量或数据结构指向该对象,此时对象就可以被安全地回收。

然而,引用计数机制存在一些局限性:

- **循环引用**:当两个或更多的对象相互引用时,即使没有任何外部引用指向它们,它们也不会被回收,导致内存泄漏。

- **性能开销**:引用计数的维护是有性能成本的,每当对象的引用发生改变时,都需要更新引用计数。

```python

# 代码示例:引用计数机制的简单说明

a = []

b = [a]

a.append(b) # 此时a和b相互引用,它们的引用计数都为2

# 当执行del a和del b时,理论上a和b都应当被回收

# 但是,由于它们相互引用,它们的引用计数不会变为0,导致内存泄漏

```

## 2.2 内存泄漏与优化技巧

内存泄漏是导致程序性能下降乃至崩溃的一个常见原因。对于Python而言,正确地识别和避免内存泄漏尤为关键。

### 2.2.1 识别内存泄漏的常用工具

为了识别内存泄漏,Python提供了多种工具,如`tracemalloc`和`objgraph`。这些工具可以帮助开发者追踪内存使用情况并找出潜在的内存泄漏点。

#### 使用`tracemalloc`模块

`tracemalloc`是Python内置的模块,可以监控Python内存分配和回收,用于诊断内存泄漏问题。

```python

import tracemalloc

# 启动跟踪

tracemalloc.start()

# 模拟内存分配和泄漏

a = []

for i in range(10):

a.append(bytearray(100000))

# 获取当前内存使用快照

snapshot = tracemalloc.take_snapshot()

top_stats = snapshot.statistics('lineno')

# 打印内存使用情况

for stat in top_stats:

print(stat)

```

### 2.2.2 避免内存泄漏的编码最佳实践

为避免内存泄漏,开发者应当遵循以下最佳实践:

- **尽量减少全局变量的使用**:全局变量生命周期长,容易造成不可预见的内存泄漏。

- **适时释放不再需要的大对象**:可以使用`del`语句手动删除不再需要的对象引用。

- **避免循环引用**:使用弱引用和`weakref`模块来防止循环引用。

## 2.3 垃圾回收与性能调优

Python的垃圾回收机制是为了管理那些无法被正常回收的内存。通过理解这一机制,开发者可以更好地优化程序的内存使用。

### 2.3.1 垃圾回收的工作原理

Python使用分代垃圾回收机制。这一机制将对象分为不同的代,新生的对象在代0中,如果它们能存活一个垃圾回收周期,则被提升到代1中,以此类推。较老的代对象被回收的频率较低。

### 2.3.2 性能调优中的垃圾回收策略

尽管Python的垃圾回收机制能够自动管理内存,但在性能调优时,开发者有时需要手动干预垃圾回收过程。

#### 使用`gc`模块进行控制

Python的`gc`模块允许开发者控制垃圾回收器的行为。

```python

import gc

# 关闭垃圾回收器

gc.disable()

# 开启垃圾回收器

gc.enable()

# 强制执行垃圾回收

gc.collect()

```

开发者应当根据程序的特定需求和行为来决定何时启用或禁用垃圾回收器,或者是否需要调整垃圾回收的频率和代的阈值。这是性能调优中一个高级且有力的手段。

# 3. 数据结构性能优化实践

随着软件系统的复杂性增加,数据结构的性能变得至关重要。本章节将深入分析Python中常用数据结构的性能,并探讨如何通过优化实现高效的数据管理。

## 3.1 常用数据结构的性能分析

### 3.1.1 列表、元组与字典的性能比较

在Python中,列表(list)、元组(tuple)和字典(dict)是最常用的数据结构,它们各自拥有不同的性能特点。

- 列表是可变的,支持随机访问,插入和删除操作的时间复杂度平均为O(n)。在处理大量数据时,频繁的变动操作可能会导致性能下降。

- 元组是不可变的,因此在创建后无法修改。它们在空间效率上优于列表,但在需要修改数据时,需要创建新的元组,可能会导致更高的内存消耗。

- 字典是一个无序的、以键值对形式存储的可变集合,基于哈希表实现。字典的平均查找、插入和删除操作的时间复杂度为O(1),非常适合需要快速查找的场景。

为了验证这些性能特点,我们可以编写一个简单的性能测试脚本,比较不同类型的操作在不同数据结构上的执行时间。例如,创建一个包含10万个元素的列表和元组,然后分别在它们上执行插入和查找操作:

```python

import time

# 创建一个列表和元组

big_list = list(range(100000))

big_tuple = tuple(range(100000))

# 测试在列表中查找一个元素的时间

start_time = time.time()

_ = 98765 in big_list

print(f"List search time: {time.time() - start_time} seconds")

# 测试在元组中查找一个元素的时间

start_time = time.time()

_ = 98765 in big_tuple

print(f"Tuple search time: {time.time() - start_time} seconds")

```

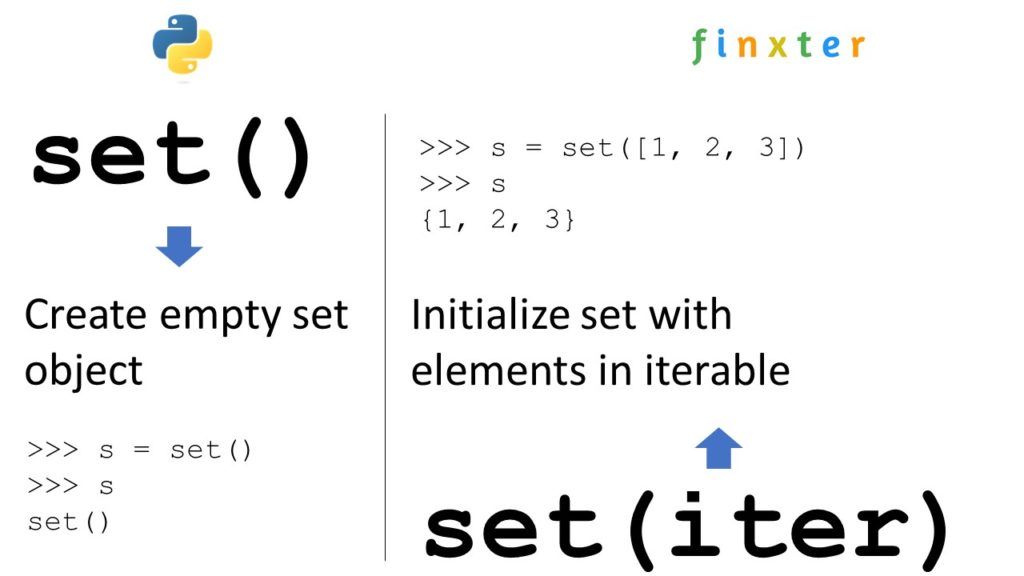

### 3.1.2 集合与冻结集合的性能考量

集合(set)和冻结集合(frozenset)是Python中用于存储唯一元素的数据结构,其中集合是可变的,而冻结集合是不可变的。

- 集合基于哈希表实现,提供了O(1)平均时间复杂度的元素添加和删除操作,以及O(n)的并集、交集、差集等集合操作。

- 冻结集合由于是不可变的,可以作为字典的键,而普通集合则不能。

下面的代码演示了集合和冻结集合在执行并集操作时的性能差异:

```python

# 创建一个大的集合和冻结集合

big_set = set(range(100000))

big_frozenset = frozenset(range(100000))

# 测试两个集合的并集操作

start_time = time.time()

union_result = big_set.union(big_frozenset)

print(f"Set union time: {time.time() - start_time} seconds")

```

## 3.2 高效数据结构的实现与应用

### 3.2.1 自定义数据结构的性能优势

虽然Python标准库提供了多种数据结构,但在特定的应用场景中,自定义数据结构可能会提供更好的性能和功能。

例如,如果你需要一个频繁进行插入和删除操作的有序集合,可以考虑实现一个基于平衡二叉树的数据结构。在Python中,可以使用第三方库如`bin

0

0