YOLOv5小目标检测与深度学习其他领域交叉融合:自然语言处理、语音识别和计算机图形学,拓展技术视野

发布时间: 2024-08-15 15:59:33 阅读量: 45 订阅数: 42

深度学习-YOLO目标检测 yolov5抽烟识别检测数据集(5000张图片数据).zip

# 1. YOLOv5小目标检测概述**

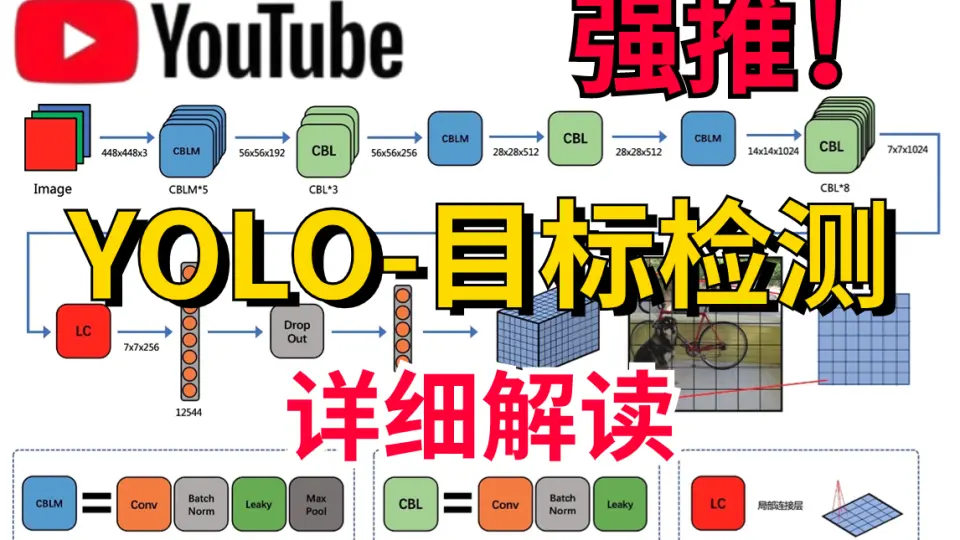

YOLOv5(You Only Look Once, version 5)是一种先进的深度学习目标检测算法,以其速度和准确性而闻名。它采用了单次卷积神经网络(CNN)架构,可以实时处理图像和视频。

YOLOv5针对小目标检测进行了优化,在识别和定位图像中较小或模糊的目标方面表现出色。它使用了一个称为Bag-of-Freebies(BoF)的集合,其中包含各种数据增强技术和训练策略,以提高模型的鲁棒性和准确性。此外,YOLOv5还采用了自适应锚框生成机制,可以根据输入图像的特征动态调整锚框大小,从而增强了小目标检测的性能。

# 2. YOLOv5与自然语言处理的交叉融合

### 2.1 自然语言处理基础知识

**2.1.1 文本表示和向量化**

文本表示是将文本数据转换为机器可处理的形式。常见的文本表示方法包括:

- **词袋模型(Bag-of-Words,BoW):**将文本表示为一个包含所有单词的集合,每个单词的权重由其在文本中出现的频率决定。

- **TF-IDF(词频-逆文档频率):**改进BoW模型,考虑单词在文本和语料库中的出现频率,赋予稀有单词更高的权重。

- **词嵌入(Word Embeddings):**将单词表示为低维向量,捕获单词之间的语义和语法关系。

**2.1.2 语言模型和序列建模**

语言模型是预测文本序列中下一个单词的概率分布。常见的语言模型包括:

- **N元语法模型:**基于前N个单词预测下一个单词的概率。

- **循环神经网络(RNN):**利用循环连接处理序列数据,捕获长距离依赖关系。

- **Transformer模型:**使用注意力机制并行处理序列数据,提高了建模效率。

### 2.2 YOLOv5在自然语言处理中的应用

YOLOv5在自然语言处理中具有广泛的应用,包括:

**2.2.1 文本分类和情感分析**

- **文本分类:**将文本分配到预定义的类别,例如新闻、体育、娱乐。YOLOv5可以利用文本表示和语言模型提取文本特征,并使用分类器进行预测。

- **情感分析:**识别文本中表达的情感,例如积极、消极或中立。YOLOv5可以结合词嵌入和情感词典来提取情感特征,并使用回归模型进行预测。

**2.2.2 机器翻译和摘要生成**

- **机器翻译:**将一种语言的文本翻译成另一种语言。YOLOv5可以利用双向语言模型和注意力机制,学习语言之间的映射关系。

- **摘要生成:**从长文本中生成简洁的摘要。YOLOv5可以利用序列到序列模型,将长文本编码成固定长度的向量,然后解码生成摘要。

**代码示例:**

```python

import torch

import transformers

# 文本分类

model = transformers.AutoModelForSequenceClassification.from_pretrained("distilbert-base-uncased-finetuned-sst-2-english")

input_ids = tokenizer(text, return_tensors="pt").input_ids

logits = model(input_ids).logits

predicted_class = torch.argmax(logits, dim=-1)

# 情感分析

model = transformers.AutoModelForSequenceClassification.from_pretrained("distilbert-base-uncased-finetuned-sst-2-english")

input_ids = tokenizer(text, return_tensors="pt").input_ids

logits = model(input_ids).logits

predicted_sentiment = torch.argmax(logits, dim=-1)

```

**逻辑分析:**

* 文本分类模型使用预训练的DistilBERT模型,通过输入文本的标记ID,提取文本特征。

* 情感分析模型也使用DistilBERT模型,通过输入文本的标记ID,提取情感特征。

* 预测类别或情感时,使用Argmax函数选择概率最高的类别或情感。

# 3. YOLOv5与语音识别的交叉融合

### 3.1 语音识别基础知识

#### 3.1.1 语音信号处理

语音识别系统处理的原始数据是语音信号,它是一个连续的模拟信号。为了便于计算机处理,需要对语音信号进行数字化和特征提取。

数字化:将模拟语音信号转换为数字信号,即采样和量化。采样是指以一定的频率对语音信号进行采样,量化是指将采样值离散化为有限个等级。

特征提取:从数字化语音信号中提取具有区分性的特征,如梅尔频率倒谱系数(MFCC)、线性预测系数(LPC)等。这些特征可以反映语音信号中重要的语音信息,如音高、音色和共振峰。

#### 3.1.2 声学模型和语言模型

语音识别系统由声学模型和语言模型组成。

声学模型:根据语音信号的特征估计语音单元(如音素、音节)的概率分布。它将语音信号映射到语音单元序列。

语言模型:根据语音单元序列估计句子或单词序列的概率分布。它约束语音单元序列的组合,使识别结果符合语言规则。

### 3.2 YOLOv5在语音识别中的应用

YOLOv5的实时目标检测能力可以应用于语音识别中,实现端到端的语音识别系统。

#### 3.2.1 语音转录和语音合成

**语音转录:**

```python

import torch

import torchaudio

# 加载预训练的 YOLOv5 模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 加载语音文件

audio, sr = torchaudio.load('audio.wav')

# 预处理语音信号

audio = audio.unsqueeze(0)

audio = audio.to(model.device)

# 执行目标检测

with torch.no_grad():

detections = model(audio)

# 解析检测结果

for detection in detections:

# 获取时间范围

start_time = detection[0].item()

end_time = detection[1].item()

# 获取语音片段

speech_segment = audio[:, start_time:end_time]

# 进行语音识别

# ...

```

**语音合成:**

```python

import torch

import torchaudio

# 加载预训练的 YOLOv5 模型

model = torch.hub.load(

```

0

0