【最新版本解读】:mclust包新特性的分析影响评估

发布时间: 2024-11-03 16:07:21 阅读量: 23 订阅数: 40

# 1. mclust包概述

在现代数据分析领域中,聚类分析是一种无监督的机器学习方法,用于发现数据中的自然分组。`mclust`包是R语言中一个功能强大的聚类工具,它通过模型基础的聚类方法(Model-Based Clustering)为用户提供了一种自动化且高效的聚类解决方案。本章将为您介绍`mclust`包的基本功能和应用范围,旨在为后续深入讨论和操作提供一个坚实的基础。

# 2. ```

# 第二章:mclust包的理论基础

## 2.1 混合模型的数学原理

### 2.1.1 概率模型与密度估计

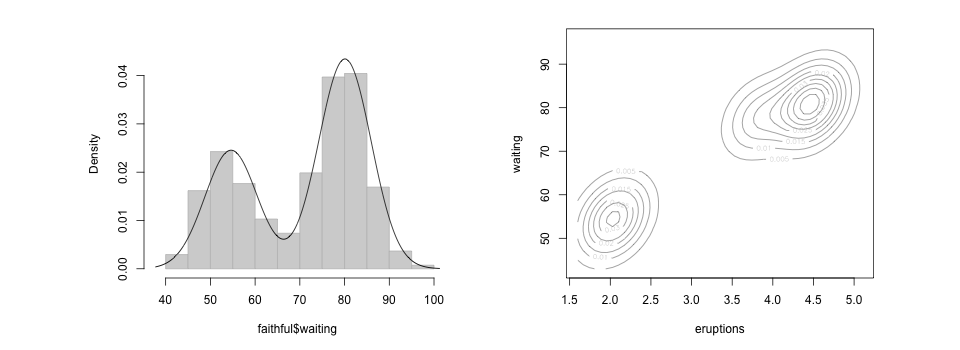

混合模型(Mixture Models)是统计学中一种基于概率模型的方法,用于描述由不同分量构成的数据分布。每个分量通常由一个概率分布来表征,如高斯分布、泊松分布等。混合模型假设数据是从这些分量中以一定概率混合得到的。以高斯混合模型(Gaussian Mixture Models, GMM)为例,其概率密度函数由若干高斯分布的加权和组成,权重则表示数据来自各个高斯分量的概率。

f(x|\pi,\mu,\Sigma) = \sum_{i=1}^{k} \pi_i \cdot \mathcal{N}(x|\mu_i,\Sigma_i)

这里,$f(x)$表示数据点$x$的密度,$\pi_i$是第$i$个高斯分量的权重,$\mathcal{N}(x|\mu_i,\Sigma_i)$是均值为$\mu_i$,协方差矩阵为$\Sigma_i$的高斯分布。权重和分布参数构成了混合模型的参数集合。

为了估计这些参数,通常采用最大似然估计(MLE)方法,通过迭代优化算法如期望最大化(EM)算法来进行。EM算法是一种处理含有隐变量的概率模型参数估计的方法,它通过两个步骤交替进行:E步(期望步)估计隐变量,M步(最大化步)优化参数。

### 2.1.2 混合模型的参数估计

参数估计是混合模型构建中的核心步骤,其目的是找到一组参数,使得观测数据出现的概率最大化。在高斯混合模型中,参数主要包括每个分量的均值$\mu$、协方差$\Sigma$以及各分量的权重$\pi$。

EM算法通过以下步骤进行参数估计:

1. **初始化**:随机选择模型参数的初始值。

2. **E步骤**:根据当前模型参数的估计值,计算每个数据点属于各个分量的后验概率。

3. **M步骤**:基于E步骤计算得到的后验概率,更新模型参数,使得观测数据的对数似然函数最大化。

4. **收敛判断**:判断模型参数的变化是否已经足够小,或是迭代次数已达到预设的上限。如果未满足停止条件,则返回E步骤继续迭代。

EM算法的每一次迭代都保证了对数似然函数的非减性,因此,经过足够次数的迭代后,算法可以收敛到局部最优解。

## 2.2 模型选择与评估方法

### 2.2.1 贝叶斯信息准则(BIC)

在确定了混合模型的结构后,即确定了模型中包含的分量数量之后,选择最优的模型参数是另一个重要任务。贝叶斯信息准则(Bayesian Information Criterion, BIC)是用于模型选择和复杂度控制的准则之一。BIC考虑了模型对数据的拟合程度以及模型复杂度,并尝试平衡二者,找到最优的模型。

BIC的定义如下:

BIC = -2 \cdot \ln(\mathcal{L}(\hat{\theta}|X)) + k \cdot \ln(n)

这里,$\mathcal{L}(\hat{\theta}|X)$是数据$X$的最大似然函数值,$\hat{\theta}$是最大化似然函数得到的参数估计值,$k$是模型中自由参数的个数,$n$是样本量。BIC的值越小,模型越好。

### 2.2.2 集成方法在模型选择中的应用

集成方法(Ensemble Methods)是通过构建并结合多个模型来解决同一问题,以期提高预测准确度和模型的泛化能力。在混合模型中,集成方法可以用来选择模型,例如通过Bagging方法生成多个模型,然后通过投票或平均的方式来集成这些模型的预测结果。

在模型选择的上下文中,集成方法的一个流行应用是自举汇聚(bootstrap aggregating)或称为Bagging。在Bagging方法中,通过从原始数据集中有放回地抽取相同数量的样本来创建多个不同的训练数据集,然后使用这些数据集训练出多个独立的模型。最终,将这些模型的预测结果进行汇总(例如通过投票或平均)来得到最终的预测结果。

在混合模型的背景下,Bagging可以用来选择最佳的模型参数,也可以用于改善模型的预测性能。通过生成多个混合模型并汇聚它们的预测,可以减小模型的方差,从而提高模型的稳定性和准确性。

请注意,以上内容是第二章内容的概览,我们将在后续章节中详细探讨mclust包在R语言环境中的实际应用和操作步骤。

```

# 3. mclust包的实践应用

## 3.1 数据准备与预处理

### 3.1.1 数据导入与格式化

在数据分析的初始阶段,数据导入和格式化是至关重要的一步。这包括将数据从不同的来源(如CSV文件、数据库、API等)加载到R环境中,并确保数据格式适合后续的分析。使用mclust包进行聚类分析之前,需要准备好数据集,确保数据没有缺失值,并将数据转换为适合的格式。

以下是一个简单的R代码示例,说明如何导入和格式化数据:

```r

# 加载必要的包

library(mclust)

# 导入数据集,假设数据集存储在CSV文件中

data <- read.csv("path_to_your_data.csv")

# 确保数据集是数据框格式

data <- as.data.frame(data)

# 检查数据集的结构,确保无缺失值

str(data)

summary(data)

# 对数据进行清洗,如有必要,可以处理缺失值

# 假设我们用列的平均值来填充缺失值

for (i in 1:ncol(data)) {

data[ , i][is.na(data[ , i])] <- mean(data[ , i], na.rm = TRUE)

}

# 如果数据集有特定的变量类型要求(如因子),确保转换正确

data$variable <- as.factor(data$variable)

```

执行逻辑说明与参数说明:

- `read.csv` 函数用于读取CSV文件,需要指定文件路径。

- `as.data.frame` 函数确保数据框格式。

- `str` 和 `summary` 函数用于查看数据集的结构和统计摘要,以便检查数据的质量和完整性。

- 缺失值处理用 `is.na` 函数结合列的平均值来填充。

### 3.1.2 特征选择与变换

在导入并初步处理数据之后,下一步是特征选择和变换。特征选择的目的是保留那些对聚类结果有贡献的变量,去除不相关或冗余的变量。特征变换可能会涉及标准化或归一化,以便消除不同特征量纲的影响,使聚类效果更好。

以下是进行特征选择和变换的R代码示例:

```r

# 使用相关系数选择特征

cor_matrix <- cor(data)

relevant_featur

```

0

0