【SQL数据库优化指南】:小白到大师的性能提升秘籍

发布时间: 2024-07-31 06:25:35 阅读量: 29 订阅数: 31

MySQL数据库SQL语言学习指南:涵盖基础到优化

# 1. SQL数据库基础**

SQL(结构化查询语言)数据库是一种关系型数据库管理系统,用于存储和管理数据。它以表格的形式组织数据,每一行代表一条记录,每一列代表一个属性。SQL数据库广泛用于各种应用程序,从简单的个人博客到大型企业系统。

理解SQL数据库的基础知识对于优化其性能至关重要。本章将涵盖SQL数据库的基本概念,包括表结构、数据类型、约束和索引。我们将探讨SQL语言的基础知识,包括用于数据操作和查询的常用命令。通过了解这些基础知识,我们可以为深入探讨性能优化奠定基础。

# 2. SQL数据库性能优化理论

### 2.1 数据库结构优化

#### 2.1.1 表设计原则

**范式化原则:**

* 将数据分解成多个表,每个表只存储一种类型的数据。

* 避免数据冗余,确保数据一致性。

**主键和外键约束:**

* 主键唯一标识每条记录,外键建立表之间的关系。

* 确保数据完整性和引用完整性。

**数据类型选择:**

* 根据数据特性选择合适的类型,如整数、浮点数、字符串等。

* 避免使用过大的数据类型,节省存储空间。

#### 2.1.2 索引设计与使用

**索引类型:**

* **B-Tree 索引:**适用于范围查询和相等查询。

* **哈希索引:**适用于相等查询,性能高于 B-Tree 索引。

**索引设计原则:**

* 索引列选择:选择经常查询的列或连接列。

* 索引顺序:对于多列索引,按查询频率从高到低排序。

* 覆盖索引:包含查询所需的所有列,避免回表查询。

### 2.2 SQL语句优化

#### 2.2.1 SQL语句的执行计划

**执行计划:**

* 数据库优化器根据 SQL 语句生成执行计划,决定如何执行查询。

* 优化器考虑索引、表连接、查询条件等因素。

**EXPLAIN 命令:**

* 使用 EXPLAIN 命令查看 SQL 语句的执行计划。

* 分析执行计划,找出性能瓶颈。

#### 2.2.2 索引的使用和优化

**索引使用原则:**

* 覆盖索引:优先使用覆盖索引,避免回表查询。

* 索引下推:将索引用于子查询或连接条件中,提高查询效率。

**索引优化:**

* 定期分析索引使用情况,删除未使用的索引。

* 优化索引列顺序,提高查询性能。

* 使用索引合并,减少索引数量。

#### 2.2.3 查询语句的重写

**查询重写技巧:**

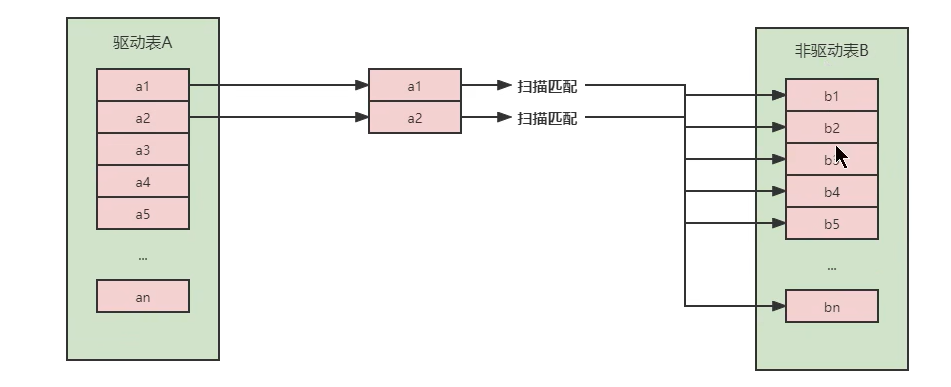

* 使用 JOIN 代替嵌套子查询。

* 使用 UNION ALL 代替 UNION,提高查询效率。

* 使用 CASE WHEN 代替 IF-ELSE 语句,简化查询。

### 2.3 数据库配置优化

#### 2.3.1 内存管理

**内存分配:**

* 调整共享缓冲区池大小,缓存经常查询的数据。

* 分配足够的内存给数据库进程,避免内存不足。

**内存参数:**

* `innodb_buffer_pool_size`:共享缓冲区池大小。

* `innodb_buffer_pool_instances`:缓冲区池实例数量。

* `innodb_flush_log_at_trx_commit`:事务提交时刷写日志的频率。

#### 2.3.2 缓冲区池优化

**缓冲区池分段:**

* 将缓冲区池划分为多个分段,提高并发访问效率。

* 使用 `innodb_buffer_pool_instances` 参数设置分段数量。

**缓冲区池置换策略:**

* LRU(最近最少使用)策略:置换最长时间未使用的页面。

* MRU(最近最常使用)策略:置换使用频率最低的页面。

* CLOCK 策略:结合 LRU 和 MRU 策略,提高置换效率。

#### 2.3.3 连接池配置

**连接池原理:**

* 创建一个预先分配的数据库连接池。

* 应用从连接池中获取连接,避免频繁创建和销毁连接。

**连接池参数:**

* `max_connections`:最大连接数。

* `min_connections`:最小连接数。

* `max_idle_time`:连接空闲时间限制。

**代码示例:**

```python

import mysql.connector

# 创建连接池

connection_pool = mysql.connector.pooling.MySQLConnectionPool(

max_connections=10,

min_connections=1,

max_idle_time=300,

host='localhost',

user='root',

password='password',

database='database_name'

)

# 获取连接

connection = connection_pool.get_connection()

# 执行查询

cursor = connection.cursor()

cursor.execute("SELECT * FROM table_name")

result = cursor.fetchall()

# 释放连接

cursor.close()

connection.close()

```

# 3.1 慢查询分析与优化

**3.1.1 慢查询日志的分析**

慢查询日志记录了执行时间超过指定阈值的 SQL 语句。通过分析慢查询日志,可以找出导致数据库性能问题的 SQL 语句。

**步骤:**

1. **启用慢查询日志:**在 MySQL 中,可以通过修改 `my.cnf` 配置文件并设置 `slow_query_log` 参数为 `ON` 来启用慢查询日志。

2. **设置阈值:**可以通过设置 `long_query_time` 参数来指定慢查询的阈值(单位为秒)。

3. **查看慢查询日志:**慢查询日志通常存储在 `/var/log/mysql/slow.log` 文件中。可以使用以下命令查看慢查询日志:

```

tail -f /var/log/mysql/slow.log

```

**分析慢查询日志:**

* **执行时间:**首先关注执行时间最长的查询。

* **SQL 语句:**检查 SQL 语句的结构和语法,是否存在明显的错误或优化空间。

* **查询计划:**使用 `EXPLAIN` 命令查看查询的执行计划,了解查询是如何执行的,是否存在不必要的扫描或连接。

* **索引使用:**检查查询是否使用了适当的索引,是否存在缺失或不合适的索引。

* **参数绑定:**检查查询是否使用了参数绑定,避免 SQL 注入攻击和性能问题。

### 3.1.2 慢查询的优化方法

**优化 SQL 语句:**

* **使用索引:**确保查询使用了适当的索引,避免全表扫描。

* **重写查询:**优化查询的结构和语法,例如使用 `JOIN` 代替嵌套查询。

* **使用参数绑定:**使用参数绑定来避免 SQL 注入攻击和性能问题。

**优化数据库配置:**

* **调整缓冲区池大小:**增加缓冲区池大小可以减少磁盘 I/O,提高查询性能。

* **优化连接池:**优化连接池配置,例如调整最大连接数和空闲连接超时时间,可以提高连接效率。

* **调整内存管理:**调整内存管理参数,例如 `innodb_buffer_pool_size` 和 `innodb_log_buffer_size`,可以优化数据库的内存使用。

**其他优化方法:**

* **使用分区表:**将大型表分区可以提高查询性能,尤其是当查询只涉及表的一部分时。

* **使用存储过程:**将复杂的查询封装在存储过程中可以提高性能和可维护性。

* **定期清理和重组:**定期清理和重组表可以释放碎片空间,提高查询性能。

# 4. SQL数据库性能优化进阶

### 4.1 分布式数据库优化

#### 4.1.1 分布式数据库的架构与原理

分布式数据库是一种将数据存储在多个物理位置的数据库系统。它可以提高可扩展性、容错性和性能。分布式数据库的常见架构包括:

* **主从复制:**一个主数据库和多个从数据库。主数据库处理写入操作,从数据库处理读取操作。

* **分片:**将数据水平划分为多个分片,每个分片存储特定范围的数据。

* **分布式哈希表(DHT):**使用哈希函数将数据映射到不同的节点。

#### 4.1.2 分布式数据库的性能优化

优化分布式数据库的性能需要考虑以下因素:

* **数据分区:**合理分配数据到不同的分片或节点,以平衡负载。

* **查询路由:**优化查询语句的执行计划,将查询路由到正确的节点。

* **事务处理:**确保分布式事务的一致性和隔离性。

* **复制延迟:**管理主从数据库之间的复制延迟,以避免数据不一致。

### 4.2 云数据库优化

#### 4.2.1 云数据库的特性与优势

云数据库是部署在云平台上的数据库服务。它具有以下特性和优势:

* **弹性扩展:**根据需求动态扩展或缩减数据库资源。

* **高可用性:**通过冗余和故障转移机制确保数据库的高可用性。

* **自动化管理:**云平台提供数据库管理和维护的自动化功能。

* **成本优化:**按需付费,仅为实际使用的资源付费。

#### 4.2.2 云数据库的性能优化

优化云数据库的性能需要考虑以下因素:

* **实例类型选择:**选择合适的实例类型以满足数据库的性能要求。

* **存储优化:**选择合适的存储类型(如 SSD、HDD)以优化数据访问性能。

* **网络优化:**配置网络设置以减少延迟和提高吞吐量。

* **监控和调整:**使用云平台提供的监控工具监控数据库性能并进行必要的调整。

### 4.3 数据库高可用性优化

#### 4.3.1 数据库备份与恢复

数据库备份是保护数据免受意外丢失或损坏的重要手段。常见的备份策略包括:

* **物理备份:**将整个数据库文件系统复制到另一个位置。

* **逻辑备份:**将数据库结构和数据导出为 SQL 脚本。

* **增量备份:**仅备份自上次备份以来更改的数据。

数据库恢复是指从备份中恢复数据库。恢复过程需要考虑以下因素:

* **恢复点:**选择要恢复到的特定时间点。

* **恢复类型:**选择完全恢复、部分恢复或只读恢复。

* **恢复速度:**优化恢复过程以最大程度地减少停机时间。

#### 4.3.2 数据库复制与故障转移

数据库复制是创建数据库副本的过程。副本可以用于以下目的:

* **负载均衡:**将读取操作分发到副本以减轻主数据库的负载。

* **故障转移:**在主数据库发生故障时,自动切换到副本。

* **数据冗余:**提供数据备份以防止数据丢失。

故障转移是指在主数据库发生故障时自动切换到副本的过程。故障转移的常见机制包括:

* **同步复制:**副本与主数据库保持实时同步。

* **异步复制:**副本与主数据库之间存在一定的延迟。

* **半同步复制:**副本在收到主数据库的确认后才提交事务。

# 5. SQL数据库性能优化案例

### 5.1 电商网站数据库优化

电商网站的数据库通常面临着高并发、海量数据和复杂查询等挑战。针对这些挑战,可以采取以下优化措施:

#### 5.1.1 订单处理数据库的优化

**表设计优化:**

- 使用整数类型存储订单 ID,而不是字符串类型,以提高查询速度。

- 将订单状态和支付状态等枚举值存储在单独的表中,并使用外键关联,以减少冗余和提高查询效率。

**索引优化:**

- 在订单表上创建复合索引,包括订单 ID、用户 ID 和订单状态,以加快按这些字段的组合进行查询。

- 在订单项表上创建索引,包括订单 ID 和商品 ID,以优化商品销售统计查询。

**SQL语句优化:**

- 使用连接查询代替嵌套查询,以减少数据库的 I/O 操作。

- 使用分页查询,避免一次性加载大量数据,提高查询响应速度。

- 避免使用 SELECT *,只选择需要的字段,以减少数据传输量。

#### 5.1.2 商品搜索数据库的优化

**表设计优化:**

- 将商品名称、描述和规格等文本数据存储在单独的表中,并使用外键关联,以提高查询效率。

- 使用全文索引对商品名称和描述进行索引,以支持快速全文搜索。

**索引优化:**

- 在商品表上创建复合索引,包括商品名称、商品分类和商品品牌,以加快按这些字段的组合进行查询。

- 在商品属性表上创建索引,包括商品 ID 和属性名称,以优化商品属性查询。

**SQL语句优化:**

- 使用相关性排序,根据商品与搜索关键词的相关性对搜索结果进行排序。

- 使用分页查询,避免一次性加载大量数据,提高查询响应速度。

- 优化查询缓存,减少重复查询的开销。

### 5.2 金融系统数据库优化

金融系统数据库需要处理大量交易和风控计算,因此需要更高的性能和可靠性。

#### 5.2.1 交易处理数据库的优化

**表设计优化:**

- 使用事务表存储交易记录,以确保数据的原子性和一致性。

- 将交易类型和交易状态等枚举值存储在单独的表中,并使用外键关联,以减少冗余和提高查询效率。

**索引优化:**

- 在交易表上创建复合索引,包括交易 ID、用户 ID 和交易时间,以加快按这些字段的组合进行查询。

- 在账户表上创建索引,包括账户 ID 和账户类型,以优化账户余额查询。

**SQL语句优化:**

- 使用存储过程或触发器处理复杂的交易逻辑,提高代码的可维护性和性能。

- 使用并行查询,将大型查询分解为多个较小的查询,同时执行,以提高查询速度。

- 优化锁机制,避免死锁和提高并发性。

#### 5.2.2 风控数据库的优化

**表设计优化:**

- 将风控规则和风控模型存储在单独的表中,并使用外键关联,以提高查询效率。

- 使用枚举类型存储风控结果,以减少冗余和提高查询速度。

**索引优化:**

- 在风控规则表上创建索引,包括规则名称和规则类型,以加快按这些字段进行查询。

- 在风控模型表上创建索引,包括模型名称和模型版本,以优化模型管理查询。

**SQL语句优化:**

- 使用动态 SQL,根据不同的风控场景生成不同的查询语句,提高查询效率。

- 使用缓存机制,存储常用的风控规则和模型,减少数据库查询开销。

- 优化查询计划,避免不必要的表扫描和连接操作。

# 6. SQL数据库性能优化最佳实践

### 6.1 性能优化原则

#### 6.1.1 避免过度优化

过度优化可能会导致代码复杂度增加,维护成本上升,甚至影响性能。因此,在优化数据库性能时,应遵循以下原则:

- **只优化有必要的部分:**并非所有数据库操作都需要优化。应重点关注影响性能的瓶颈部分。

- **遵循渐进式优化原则:**一次只优化一个方面,并观察其效果。避免同时进行多项优化,以免难以确定哪项优化产生了效果。

- **使用合适的工具:**利用性能监控工具和分析工具来识别瓶颈并指导优化工作。

#### 6.1.2 持续监控和调整

数据库性能是一个动态的过程,受多种因素影响。因此,需要持续监控数据库性能并根据需要进行调整。

- **定期检查性能指标:**使用性能监控工具定期检查数据库的响应时间、资源利用率和错误率等指标。

- **分析慢查询日志:**慢查询日志记录了执行时间较长的查询。分析慢查询日志可以帮助识别需要优化的查询。

- **根据需要调整配置:**根据监控结果,调整数据库配置,例如内存分配、缓冲区池大小和连接池大小。

### 6.2 数据库维护最佳实践

#### 6.2.1 定期清理和重组

定期清理和重组数据库可以提高性能并释放空间。

- **清理不必要的数据:**删除过时或不必要的数据,例如旧的日志文件和临时表。

- **重组表和索引:**重组可以优化数据的物理存储方式,提高查询性能。

#### 6.2.2 定期备份和恢复

定期备份和恢复数据库是保护数据免受意外丢失或损坏的最佳实践。

- **制定备份计划:**确定备份频率、备份类型(完整备份、增量备份等)和备份存储位置。

- **定期测试备份:**定期恢复备份以确保其完整性和可恢复性。

### 6.3 数据库安全最佳实践

#### 6.3.1 访问控制和权限管理

实施严格的访问控制和权限管理措施可以保护数据库免受未经授权的访问。

- **使用强密码:**为数据库用户设置强密码,并定期更改。

- **实施角色和权限:**根据需要分配角色和权限,只授予用户执行其工作所需的最少权限。

- **定期审核权限:**定期审核用户权限,并删除不再需要的权限。

#### 6.3.2 数据加密和脱敏

数据加密和脱敏可以保护敏感数据免受未经授权的访问和使用。

- **加密数据:**使用加密算法加密敏感数据,例如信用卡号和个人身份信息。

- **脱敏数据:**脱敏敏感数据,例如通过掩码或替换来隐藏其原始值。

0

0