【Python元编程实战】:掌握parser,深入解析Python源码

发布时间: 2024-10-11 04:16:13 阅读量: 123 订阅数: 31

# 1. Python元编程简介

在现代编程世界中,元编程是一种高级技术,它允许程序在运行时检查、修改或生成代码。Python作为一门具有高度动态性且语法灵活的语言,提供了强大的元编程能力。通过元编程,开发者可以编写更加通用、复用性高的代码,从而提高开发效率和软件质量。在本章中,我们将探究Python元编程的基本概念、目的与优势,以及它如何通过元类、装饰器、上下文管理器等特性实现对代码运行时行为的控制。这将为读者后续章节中深入探讨Python源码结构、parser构建与应用打下坚实的基础。

# 2. Python源码结构与解析基础

深入理解Python的源码结构和解析过程是学习Python元编程不可或缺的部分。本章节我们将探讨Python源码的组成,以及实现源码解析的相关技术。

## 2.1 Python源码的组成

Python代码在执行前会经过一系列的解析步骤,首先了解Python源码的基本组成是必要的。

### 2.1.1 语法分析与抽象语法树

当Python源码被加载后,会经过一个重要的步骤:**语法分析**。语法分析器(Parser)会将代码文本转换成一种叫做**抽象语法树(Abstract Syntax Tree, AST)**的中间表示形式。AST是源代码的抽象语法结构的树状表现形式,它映射了源代码的语法结构,但省略了其中的某些信息(如括号,分号等)。

下面是AST的一个简单例子:

```python

from ast import parse, dump

code = """

def foo(x):

return x + 1

ast_tree = parse(code)

dump(ast_tree)

```

这段代码首先导入了`parse`和`dump`函数,用于解析代码并打印AST。执行上述代码,我们能够看到`foo`函数定义对应的AST,它将函数的定义、参数、返回语句等都转换为了树状结构。

### 2.1.2 标准库中的解析工具

Python的标准库提供了许多用于解析源码的工具,例如`ast`模块。通过使用这些工具,开发者可以分析Python代码,并且对AST节点进行操作。例如,遍历AST,修改节点,或者基于AST创建新的代码片段。

在使用`ast`模块时,我们经常需要结合递归函数来遍历AST树:

```python

def print_tree(node, level=0):

indent = ' ' * (level * 2)

print(f"{indent}{node.__class__.__name__}")

for child in ast.iter_child_nodes(node):

print_tree(child, level + 1)

print_tree(ast_tree)

```

这段代码定义了一个简单的递归函数`print_tree`,它会遍历并打印AST树的每个节点。

## 2.2 解析Python代码的技术

解析Python代码的技术涉及两个主要部分:**词法分析**和**语法分析**。

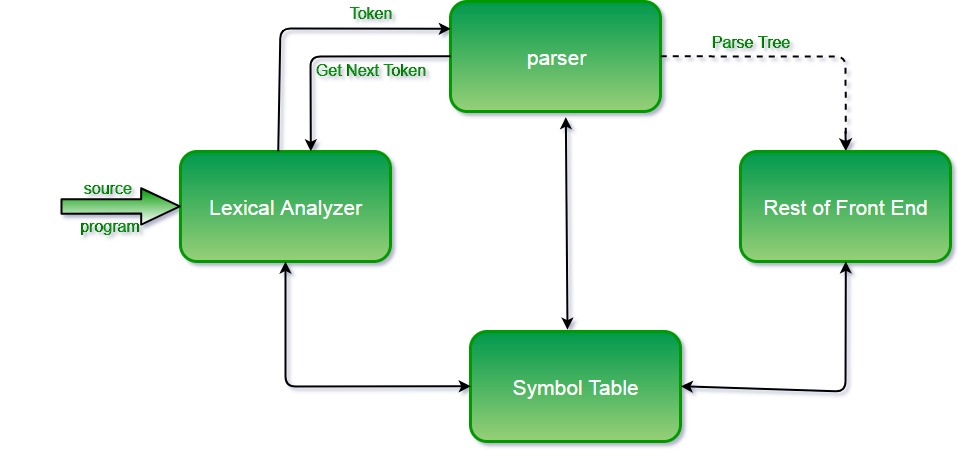

### 2.2.1 词法分析器(Lexer)的角色

词法分析器(Lexer)的作用是将输入的Python代码字符串拆分成一个个的**标记(Token)**。每个Token代表了编程语言中的一个符号,如标识符、关键字、运算符等。比如,对于字符串`x = x + 1`,Lexer会将其拆分为变量名`x`,赋值符`=`,加号`+`等Token。

Python标准库中的`tokenize`模块可以帮助我们理解词法分析的过程:

```python

import tokenize

from io import StringIO

code = """

x = x + 1

tokens = tokenize.tokenize(StringIO(code).readline)

for toknum, tokval, _, _, _ in tokens:

print(toknum, tokval)

```

上述代码通过`tokenize.tokenize`函数读取代码,并输出每个Token的编号和值。

### 2.2.2 语法分析器(Parser)的实现

语法分析器(Parser)接收词法分析器输出的Token流,并根据语言的语法规则构建AST。Python中的`ast`模块充当了Parser的角色。除了内置的解析器,开发者也可以使用`ply`(Python Lex-Yacc)这样的库来实现自定义的解析器。

`ply`允许我们定义语法规则来构建解析器:

```python

import ply.lex as lex

tokens = ('NAME', 'EQUALS', 'NUMBER', 'PLUS')

t_NAME = r'[a-zA-Z_][a-zA-Z0-9_]*'

t EQUALS = r'='

t_PLUS = r'\+'

t_ignore = ' \t'

def t_NUMBER(t):

r'\d+'

t.value = int(t.value)

return t

def t_error(t):

print("Illegal character '%s'" % t.value[0])

t.lexer.skip(1)

lexer = lex.lex()

data = """

x = 1 + 2

for tok in lexer.tokenize(data):

print(tok)

```

以上代码使用`ply`定义了`NAME`,`EQUALS`,`NUMBER`,`PLUS`等Token的规则,并对代码字符串进行了词法分析。

解析器技术是构建编译器、解释器以及代码分析工具的核心。在后续章节中,我们将继续探讨如何构建自定义的词法和语法分析器,并深入分析它们在元编程中的应用。

在本章节,我们介绍了Python源码的组成,包括AST以及词法和语法分析器的角色和技术。通过实例演示了如何使用Python内置工具分析源码,并展示了如何使用`ply`库来定义和实现简单的词法分析器。接下来的章节将继续深入探讨如何构建更高级的解析器,并展示它们在Python元编程中的具体应用。

# 3. 深入理解parser的构建

## 3.1 构建自定义的词法分析器

### 3.1.1 词法分析器的工作原理

词法分析器(Lexer)是编译器的第一阶段,它读取源代码并将其分解为一系列标记(Tokens),这些标记是构成程序语法的最小单位。比如,一个简单的Python语句 `a = 1`,词法分析器会将其分解为标识符(a)、赋值运算符(=)和数字(1)等标记。

词法分析器在解析代码时会忽略空格、换行和注释等无意义的信息,只保留有意义的语法元素。此外,词法分析器通常能处理关键字、操作符、字面量等不同类型的标记,并且能够识别出错误的标记(例如,拼写错误的关键字),从而将它们排除在进一步处理之外。

### 3.1.2 使用工具生成词法分析器

为了简化词法分析器的开发,许多工具如`lex`和`flex`被开发用于自动生成词法分析器。这些工具通过定义一系列规则来描述如何从源代码中识别不同的标记。以Python中的`re`模块为例,它提供了一套正则表达式的工具,可以用来模拟简单词法分析器的功能。

例如,下面是一个使用正则表达式来匹配Python变量名和关键字的简单示例:

```python

import re

# 正则表达式匹配Python变量名或关键字

token_re = ***pile(r'\b[_a-zA-Z][_a-zA-Z0-9]*\b')

# 示例代码

code = 'def my_function(): pass'

# 使用正则表达式找到所有匹配的标记

tokens = token_re.findall(code)

print(tokens) # 输出: ['def', 'my_function', 'pass']

```

这个例子中,正则表达式`r'\b[_a-zA-Z][_a-zA-Z0-9]*\b'`匹配以字母或下划线开头,后接任意字母、数字或下划线的字符串。`findall`方法用来找出所有符合模式的子串,即代码中的标记。

## 3.2 构建自定义的语法分析器

### 3.2.1 语法分析器的设计原则

语法分析器(Parser)的任务是根据编程语言的语法规则,将词法分析器生成的标记序列组织成抽象语法树(AST)。AST是一种树形结构,它代表了程序的语法结构,并且在编译器的后续阶段中使用。

在设计语法分析器时,通常需要遵循以下原则:

1. **明确的语法规范**:语法分析器的构建应该基于清晰定义的语法规则。这些规则可以用巴科斯-诺尔范式(BNF)或扩展巴科斯-诺尔范式(EBNF)来描述。

2. **自顶向下或自底向上**:两种常见的语法分析策略。自顶向下解析器尝试从最高层的非终结符开始解析,而自底向上解析器从输入的最左端的终结符开始解析。

3. **错误处理**:语法分析器需要具备错误检测和报告机制,当遇到不符合语法规则的代码时能够给出清晰的错误信息。

### 3.2.2 手动编写解析规则

手动编写解析规则是构建复杂语法分析器的传统方式。通常使用递归下降方法来实现。下面是一个简化的递归下降解析器的Python代码示例,用于解析简单的数学表达式:

```python

class MathParser:

def __init__(self, tokens):

self.tokens = iter(tokens)

self.peek = next(self.tokens, None)

```

0

0