【数据库日志分析】:使用django.db.backends进行数据库日志分析和调试

发布时间: 2024-10-13 14:14:16 阅读量: 21 订阅数: 25

# 1. 数据库日志分析基础

## 1.1 日志分析的重要性

在数据库管理和优化中,日志分析是不可或缺的一环。通过对数据库日志的深入分析,我们可以:

- 监控数据库性能,及时发现并解决性能瓶颈。

- 追踪异常和错误,保障系统的稳定运行。

- 通过模式识别,建立预警机制,提前预防潜在问题。

## 1.2 日志的种类与作用

数据库日志主要分为两大类:

- **事务日志(Transaction Log)**:记录事务操作,如增删改查(CRUD),确保数据的一致性和完整性。

- **系统日志(System Log)**:记录数据库的运行状态和事件,如连接、断开、错误信息等。

通过分析这两类日志,我们可以全面了解数据库的运行状态和性能表现。

## 1.3 日志分析的基本步骤

进行日志分析通常包括以下步骤:

1. **日志收集**:配置数据库以输出详细的日志信息。

2. **日志存储**:将日志数据存储到文件或数据库中,便于分析和检索。

3. **日志解析**:使用工具或脚本解析日志内容,提取关键信息。

4. **性能分析**:针对解析后的日志数据进行性能分析,寻找潜在问题。

5. **优化调整**:根据分析结果,对数据库进行优化调整。

通过这样的步骤,我们可以系统地进行数据库日志分析,从而提高数据库的性能和稳定性。

# 2. django.db.backends日志分析工具

### 2.1 日志分析工具的配置与使用

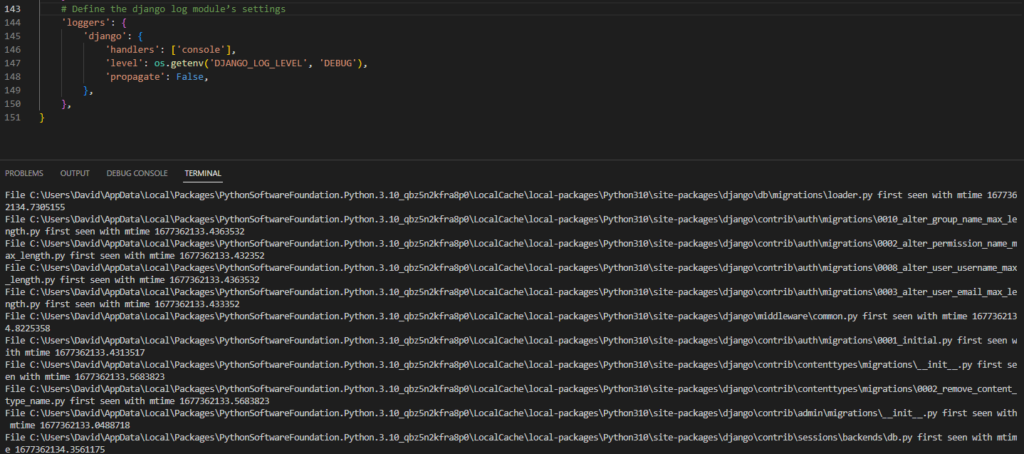

#### 2.1.1 配置django.db.backends的日志系统

在本章节中,我们将深入探讨如何配置Django框架中的`django.db.backends`日志系统,以便更好地进行数据库操作的监控和分析。配置日志系统是进行日志分析的第一步,它能够帮助我们捕获关键的数据库操作信息,如查询性能、错误信息等。

配置日志系统通常涉及以下几个步骤:

1. **启用日志记录**:在Django的设置文件`settings.py`中启用日志记录功能。

2. **配置日志处理器**:设置日志处理器,用于定义日志的输出位置,如文件、控制台等。

3. **定义日志格式**:设置日志格式,包括日志的时间戳、日志级别、消息等。

4. **设置日志级别**:根据需要设置日志级别,如DEBUG、INFO、WARNING等。

下面是一个简单的配置示例:

```python

# settings.py

LOGGING = {

'version': 1,

'disable_existing_loggers': False,

'handlers': {

'file': {

'level': 'DEBUG',

'class': 'logging.FileHandler',

'filename': 'django_debug.log',

},

},

'loggers': {

'django.db.backends': {

'handlers': ['file'],

'level': 'DEBUG',

'propagate': True,

},

},

}

```

在这个配置中,我们定义了一个文件处理器`file`,它将日志写入到`django_debug.log`文件中,并且将`django.db.backends`的日志级别设置为DEBUG。这意味着所有的数据库操作日志都将被记录在指定的文件中。

#### 2.1.2 选择合适的日志级别和格式

选择合适的日志级别和格式是进行有效日志分析的关键。Django的日志系统支持以下几种级别:

- **DEBUG**: 详细的调试信息,通常用于开发过程中。

- **INFO**: 一般性信息,如系统启动、停止等。

- **WARNING**: 警告信息,表明可能出现问题,但不影响系统运行。

- **ERROR**: 错误信息,表明出现严重问题,系统可能部分或完全无法使用。

- **CRITICAL**: 致命错误,表明出现非常严重的问题,需要立即关注。

在生产环境中,通常将日志级别设置为`WARNING`或`ERROR`,以减少日志量并专注于关键问题。而在开发环境中,`DEBUG`级别会提供更多的信息,有助于开发者理解系统的运行细节。

日志格式的定义则涉及到日志消息的结构,可以包含时间戳、日志级别、日志消息等信息。一个常用的格式化字符串示例如下:

```python

'format': '%(asctime)s [%(levelname)-8s] %(message)s',

```

这个格式定义了日志消息的结构,其中`%(asctime)s`表示时间戳,`%(levelname)-8s`表示日志级别,`%(message)s`表示日志消息。通过这种方式,我们可以清晰地看到每个日志条目的详细信息。

### 2.2 日志数据的收集与存储

#### 2.2.1 日志数据的收集方法

在本章节中,我们将讨论如何收集日志数据,这是进行日志分析的重要前提。日志数据的收集方法多种多样,包括但不限于以下几种:

1. **文件系统**:将日志直接写入到文件系统中,是最简单也是最常见的方法。这种方法易于实现,但不适合大规模分布式系统,因为文件系统在并发写入时可能会遇到性能瓶颈。

2. **数据库**:将日志存储到数据库中,可以利用数据库的强大查询功能进行复杂的日志分析。这种方法适合需要对日志进行深入分析的场景。

3. **消息队列**:使用消息队列(如RabbitMQ、Kafka等)来收集日志,可以有效地处理高并发的日志写入请求,并且可以与其他系统集成,如日志分析服务。

4. **集中式日志系统**:使用如ELK(Elasticsearch, Logstash, Kibana)这样的集中式日志系统,可以实现日志的统一收集、存储和分析。

#### 2.2.2 日志数据的存储解决方案

选择合适的日志存储解决方案对于日志分析的效率和效果至关重要。下面我们将详细介绍几种常见的日志存储解决方案。

##### *.*.*.* 使用文件系统

当使用文件系统来存储日志时,通常会将日志分散到多个文件中,以提高性能和便于管理。例如,可以按日期、按日志级别或其他任何逻辑来分割日志文件。

```python

'handlers': {

'file': {

'class': 'logging.handlers.RotatingFileHandler',

'filename': 'django_debug.log',

'maxBytes': 1024 * 1024 * 5, # 5MB

'backupCount': 5,

},

}

```

在这个例子中,我们使用了`RotatingFileHandler`,它会在日志文件达到指定大小(5MB)时自动滚动日志,保留最近的5个日志文件。

##### *.*.*.* 使用数据库

将日志存储到数据库中是一种更为结构化的存储方式,它允许我们利用数据库的强大查询功能来进行复杂的日志分析。

```python

'handlers': {

'db': {

'class': 'django.utils.log.AdminEmailHandler',

'include_html': True,

'connection': 'default',

},

}

```

在这个例子中,我们使用了`AdminEmailHandler`,它会将日志消息以HTML格式发送到管理员邮箱。如果要存储到数据库中,可以自定义一个日志处理器,将日志消息插入到数据库表中。

##### *.*.*.* 使用ELK集中式日志系统

ELK是一套广泛使用的日志分析解决方案,包括Elasticsearch(存储和搜索)、Logstash(日志收集和处理)和Kibana(可视化分析)。

- **Elasticsearch** 是一个分布式的搜索和分析引擎,它可以存储和索引大量的日志数据。

- **Logstash** 是一个数据收集引擎,它可以从各种源收集数据,并将其发送到Elasticsearch。

- **Kibana** 是一个可视化工具,它可以帮助用户在Elasticsearch中创建仪表板和图形。

通过ELK,我们可以实现日志的统一收集、存储和分析,这对于大型分布式系统来说是一个非常强大的解决方案。

### 2.3 日志分析的初步实践

#### 2.3.1 日志查询技巧

在本章节中,我们将介绍一些基本的日志查询技巧,这些技巧可以帮助我们快速定位和分析日志数据。无论是在文件系统中还是在数据库中存储的日志,都可以使用以下查询技巧。

##### *.*.*.* 使用grep和awk

在Linux系统中,`grep`和`awk`是常用的文本处理工具,可以用来快速搜索和分析日志文件。

```bash

grep "ERROR" django_debug.log | awk '{print $3, $4}'

```

在这个例子中,我们使用`grep`来搜索包含"ERROR"的日志行,然后使用`awk`来打印出每行的日志级别和消息。

##### *.*.*.* 使用SQL查询

如果日志存储在数据库中,我们可以使用SQL查询来分析日志数据。

```sql

SELECT timestamp, level, message FROM logs WHERE level = 'ERROR';

```

在这个例子中,我们从`logs`表中选择时间戳、日志级别和消息,条件是日志级别为"ERROR"。

#### 2.3.2 日志分析的可视化工具

在本章节中,我们将介绍一些常用的日志分析可视化工具,这些工具可以帮助我们更直观地理解日志数据。

##### *.*.*.* 使用Kibana

Kibana是ELK套装中的一部分,它提供了一个强大的仪表板功能,可以让我们创建各种图表和仪表板。

```mermaid

graph LR

A[日志文件] -->|Logstash| B[ELK]

B -->|Elasticsearch| C[日志数据存储]

C -->|Kibana| D[可视化分析]

```

在这个流程图中,我们展示了如何使用Kibana进行日志分析的流程。首先,日志文件通过Logstash进行处理,然后存储到Elasticsearch中。最后,我们使用Kibana来创建仪表板和图表,进行日志数据的可视化分析。

##### *.*.*.* 使用Python脚本

我们也可以使用Python脚本来进行日志分析,并生成可视化图表。

```python

import matplotlib.pyplot as plt

import pandas as pd

# 读取日志文件

df = pd.read_csv('django_debug.log', se

```

0

0