从海量数据中提取洞察:JSON文件库数据库中的数据分析秘诀

发布时间: 2024-07-29 01:47:10 阅读量: 20 订阅数: 23

# 1. JSON文件库数据库概述**

JSON(JavaScript Object Notation)是一种轻量级的数据交换格式,广泛用于存储和传输结构化数据。JSON文件库数据库是使用JSON格式存储数据的数据库,具有以下特点:

- **数据结构灵活:**JSON数据以键值对的形式组织,可以轻松表示复杂的嵌套数据结构。

- **跨平台兼容:**JSON是一种独立于语言和平台的格式,可以在各种系统和应用程序中使用。

- **易于解析:**JSON数据易于解析,可以使用多种编程语言和库进行读取和写入。

# 2. 数据提取与预处理

**2.1 数据提取方法**

数据提取是将数据从JSON文件中提取到可用于分析的格式的过程。有两种主要的方法来提取JSON数据:

**2.1.1 使用JSON解析库**

JSON解析库是专门用于解析JSON数据的软件包。它们提供了一组函数,可以轻松地将JSON数据转换为其他格式,如字典或列表。Python中常用的JSON解析库包括:

* **json库:**标准库中内置的JSON解析库。

* **simplejson库:**比json库更快,但功能较少。

* **ujson库:**非常快速的JSON解析库,但需要安装。

**代码块:使用json库解析JSON数据**

```python

import json

with open('data.json') as f:

data = json.load(f)

print(data)

```

**逻辑分析:**

* `open()`函数打开JSON文件并将其作为文件对象返回。

* `json.load()`函数将文件对象中的JSON数据加载到一个Python字典中。

* `print()`函数打印字典的内容。

**2.1.2 使用命令行工具**

命令行工具也可以用于提取JSON数据。例如,`jq`是一个流行的命令行工具,可以用于查询和处理JSON数据。

**代码块:使用jq命令行工具提取JSON数据**

```

jq '.name' data.json

```

**逻辑分析:**

* `jq`命令后跟一个查询表达式,该表达式指定要提取的数据。

* 在这个例子中,查询表达式`'.name'`提取JSON对象中的`name`属性。

**2.2 数据预处理技术**

数据预处理是将提取的数据转换为适合分析的格式的过程。这可能涉及以下步骤:

**2.2.1 数据清洗**

数据清洗涉及删除或更正数据中的错误或不一致之处。这可能包括:

* **处理缺失值:**用适当的值(如平均值或中位数)填充缺失值,或删除包含缺失值的记录。

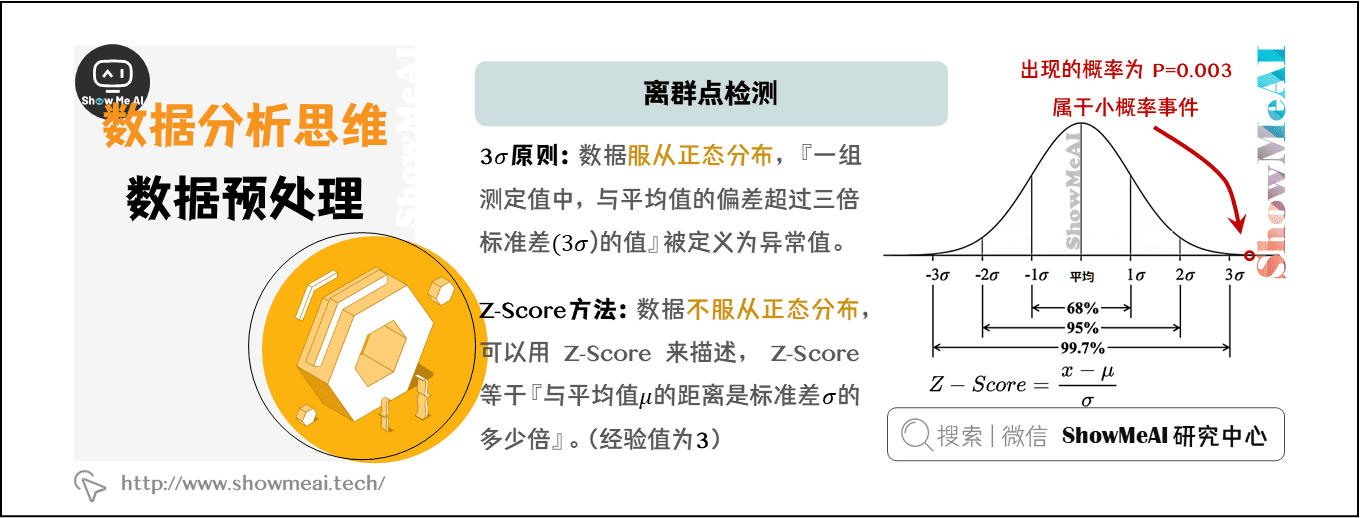

* **处理异常值:**识别和处理异常值,或将它们转换为更合理的值。

* **标准化数据:**将数据转换为一致的格式,如将日期转换为时间戳或将货币转换为特定货币单位。

**2.2.2 数据转换**

数据转换涉及将数据从一种格式转换为另一种格式。这可能包括:

* **转换数据类型:**将数据从一种数据类型(如字符串)转换为另一种数据类型(如数字)。

* **合并数据集:**将来自不同来源或表的数据合并到一个数据集。

* **拆分数据集:**将数据集拆分为更小的子集,以便于分析。

**2.2.3 数据归一化**

数据归一化涉及将数据缩放到一个特定的范围,通常是0到1之间。这有助于比较不同范围的数据并提高机器学习算法的性能。

**代码块:使用Pandas库进行数据预处理**

```python

import pandas as pd

# 读取JSON文件

df = pd.read_json('data.json')

# 处理缺失值

df.fillna(df.mean(), inplace=True)

# 转换数据类型

df['age'] = df['age'].astype(int)

# 标准化数据

df['score'] = (df['score'] - df['score'].min()) / (df['score'].max() - df['score'].min())

```

**逻辑分析:**

* `pd.read_json()`函数将JSON文件加载到Pandas DataFrame中。

* `fillna()`函数用平均值填充缺失值。

* `astype()`函数将`age`列转换为整数类型。

* `(df['score'] - df['score'].min()) / (df['score'].max() - df['score'].min())`计算分数列的归一化值。

# 3.1 统计分析

统计分析是数据分析的基础,它通过对数据进行汇总、分析和解释,帮助我们了解数据的分布、趋势和规律。统计分析主要分为两大类:描述性统计和推断性统计。

#### 3.1.1 描述性统计

描述性统计是对数据进行汇总和描述,以展示其主要特征和趋势。常用的描述性统计方法包括:

- **中心趋势度量:**包括均值、中位数和众数,用于衡量数据的集中程度。

- **离散度度量:**包括方差、标准差和极差,用于衡量数据的分布范围。

- **分布形状:**包括正态分布、偏态分布和峰态分布,用于描述数据的分布模式。

#### 3.1.2 推断性统计

推断性统计是在已知样本数据的基础上,对总体数据做出推断。常用的推断性统计方法包括:

-

0

0