机器人技术发展:人工智能算法的应用与未来趋势

发布时间: 2024-09-02 01:14:59 阅读量: 161 订阅数: 81

果壳处理器研究小组(Topic基于RISCV64果核处理器的卷积神经网络加速器研究)详细文档+全部资料+优秀项目+源码.zip

# 1. 人工智能算法的理论基础

## 简介

人工智能算法是机器人技术的核心,它赋予了机器人自主学习和决策的能力。本章将从理论上解释人工智能的基本原理,为理解后续章节中各种算法的应用打下坚实的基础。

## 知识点

### 1.1 算法的定义

算法可以被定义为一系列定义明确的指令集合,用于解决特定问题或执行计算任务。在人工智能领域,算法的设计往往模仿人类认知过程。

### 1.2 算法的分类

人工智能算法主要分为两类:启发式算法和精确算法。启发式算法通过经验法则解决问题,而精确算法使用明确的数学过程得出确定的答案。

### 1.3 算法的性能评估

算法的性能通常根据执行速度、资源消耗和输出结果的准确性来评估。在人工智能领域,这些指标尤为重要,因为算法效率直接关系到机器人任务完成的质量和效率。

通过上述章节的介绍,我们已经对人工智能算法有了初步的了解,为后续章节的学习奠定了基础。

# 2. 机器学习技术在机器人中的应用

## 2.1 机器学习基础

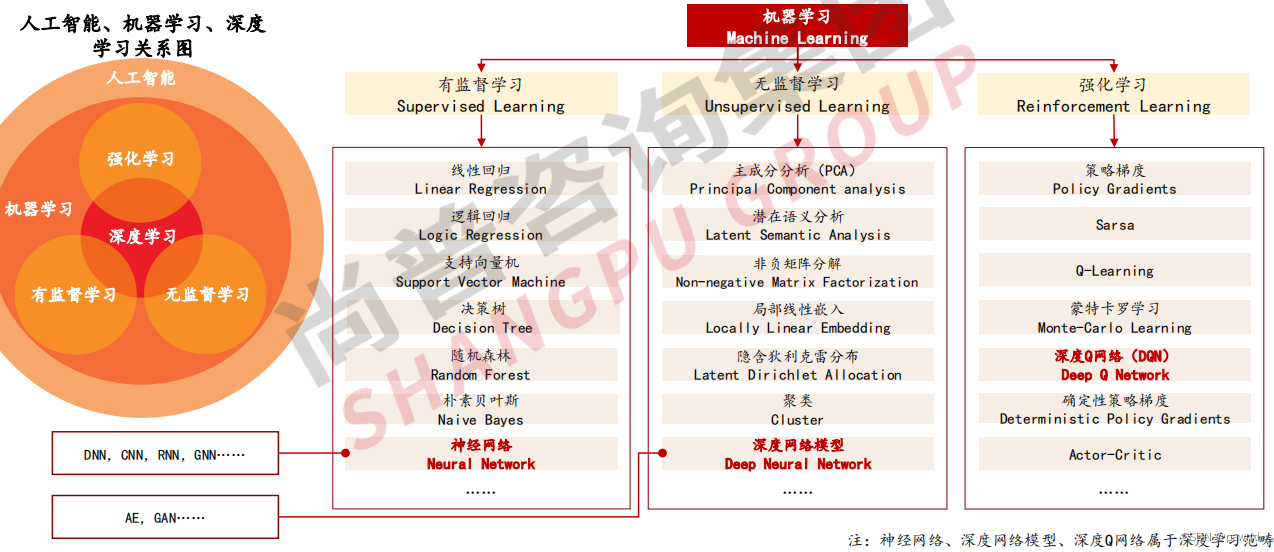

### 2.1.1 监督学习与非监督学习

监督学习是机器学习领域中一种重要的学习方法,它通过输入和输出的数据对(训练数据)来训练模型,并使模型能够预测新的数据输出。在机器学习中,监督学习算法利用训练集的数据来学习一个函数,这个函数可以将输入映射到正确的输出。监督学习通常被用于分类和回归问题。

一个典型的监督学习过程包括以下步骤:

1. 数据收集:收集大量的带有标签的数据作为训练材料。

2. 特征提取:从原始数据中提取特征,作为模型训练的输入。

3. 训练模型:使用带标签的数据训练模型,学习数据间的映射关系。

4. 验证与测试:使用一部分未参与训练的数据验证模型的效果,并进行测试评估。

5. 部署:将经过验证的模型部署到实际应用中进行预测。

例如,假定我们要训练一个模型来识别图片中的猫或狗。我们需要收集一定数量的图片数据集,每张图片都标明了是猫还是狗。然后我们使用这些数据来训练一个分类器,分类器会根据图片的像素值等特征来判断新图片中是猫还是狗。

非监督学习与监督学习不同的是,它不依赖于带有标签的数据。非监督学习的目的是从无标签的数据中学习数据的内在结构和模式。常见的非监督学习任务有聚类和降维。聚类是将相似的实例分到同一个组中;降维是减少数据中的变量数来降低复杂性。

一个非监督学习的例子是使用K均值算法对客户进行市场细分。这个方法将客户根据他们的购买习惯、年龄、收入等因素进行聚类,然后公司可以更有效地对不同的客户群体采取定制化的营销策略。

### 2.1.2 强化学习的基本概念

强化学习是机器学习的另一大分支,其核心思想借鉴于行为心理学。在强化学习中,智能体(agent)通过与环境的交互,基于奖励(reward)和惩罚(punishment)机制学习如何执行特定的任务。智能体的目标是在一个复杂的、不确定的环境中,通过试错来学习最优策略,以最大化它的累积奖励。

强化学习的主要组成部分如下:

- 智能体(Agent):学习者和决策者。

- 环境(Environment):智能体执行动作并接收反馈的外部环境。

- 状态(State):环境在某一时刻的描述。

- 动作(Action):智能体可以执行的动作。

- 奖励(Reward):在执行动作后智能体所获得的反馈,正奖励表示好的行为,负奖励表示不好的行为。

- 策略(Policy):智能体的行为规则,决定了在给定状态下的动作选择。

一个强化学习的例子是训练机器人进行一项操作任务,比如让机器人学会玩棋盘游戏。机器人在游戏中的每一步都基于当前棋盘状态选择一个动作,并根据游戏规则获得或扣除分数作为奖励。通过大量游戏的试错,机器人学会识别有利的动作,并逐渐优化其策略来赢得游戏。

在下一节中,我们将探索机器学习算法如何在机器人的导航和感知功能中得到应用,包括路径规划和障碍物避让技术。

# 3. 深度学习在机器人技术中的突破与应用

## 3.1 深度学习理论回顾

深度学习作为人工智能领域中的一大突破,其理论基础源于神经网络的研究。其中,卷积神经网络(CNN)和循环神经网络(RNN)及其变种长短时记忆网络(LSTM)在图像和序列数据处理方面取得了重大进展。

### 3.1.1 卷积神经网络(CNN)

CNN是一种特别设计用来处理具有网格结构的数据的神经网络,例如时间序列数据或图像数据。CNN通过使用卷积层来保留输入数据的空间特征,从而识别图像中的局部特征。

```python

import tensorflow as tf

from tensorflow.keras import layers, models

# 构建一个简单的CNN模型

model = models.Sequential()

model.add(layers.Conv2D(32, (3, 3), activation='relu', input_shape=(64, 64, 3)))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

model.add(layers.MaxPooling2D((2, 2)))

model.add(layers.Conv2D(64, (3, 3), activation='relu'))

# 模型的输出层

model.add(layers.Flatten())

model.add(layers.Dense(64, activation='relu'))

model.add(layers.Dense(1, activation='sigmoid'))

# 编译模型

***pile(optimizer='adam',

loss='binary_crossentropy',

metrics=['accuracy'])

```

以上代码构建了一个典型的CNN结构,其中包含多个卷积层,这些层通过卷积操作学习图像特征,池化层用于降低维度。最后,通过全连接层对特征进行分类。卷积层的参数如滤波器大小、数量和激活函数等都会影响模型的性能。

### 3.1.2 循环神经网络(RNN)与长短时记忆(LSTM)

RNN是专门用来处理序列数据的神经网络。它通过隐藏状态在序列中传递信息,可以记住之前的信息,并将其用于当前的决策。

```python

from tensorflow.keras import Sequential

from tensorflow.keras.layers import LSTM, Dense

# 构建一个简单的LSTM模型

model = Sequential()

model.add(LSTM(64, return_sequences=True, input_shape=(timesteps, input_dim)))

model.add(LSTM(32))

model.add(Dense(1, activation='sigmoid'))

# 编译模型

***pile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

```

在上述代码中,我们创建了一个LSTM层的模型,该模型特别适合处理时间序列数据,因为LSTM能够学习长期依赖性。其中,`return_sequences=True`参数表示返回完整的序列,否则只返回最后一层的输出。LSTM网络通过门机制控制信息的流入、保持和流出,有效解决了RNN的长期依赖问题。

## 3.2 深度学习在机器人视觉中的应用

### 3.2.1 物体识别与分类

深度学习在机器人视觉技术中取得了显著的进展,特别是在物体识别和分类任务中。CNN能够识别图像中的对象并对其进行分类。

```python

# 使用预训练的CNN进行图像分类的示例

import tensorflow as tf

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# 创建数据生成器

train_datagen = ImageDataGenerator(rescale=1./255)

# 流式读取训练数据

train_generator = train_datagen.flow_from_directory(

'path_to_train_data',

target_size=(150, 150),

batch_size=32,

class_mode='binary')

# 加载预训练的模型

base_model = tf.keras.applications.MobileNetV2(input_shape=(160, 160, 3),

include_top=False,

```

0

0