:YOLOv1目标检测算法:实时目标检测的先驱,开启计算机视觉新篇章

发布时间: 2024-04-27 00:28:08 阅读量: 329 订阅数: 73

计算机视觉领域中YOLOv8实时目标检测算法及其应用

# 1. 目标检测算法概述

目标检测算法是一种计算机视觉技术,用于识别和定位图像或视频中的对象。它在各种应用中至关重要,例如自动驾驶、视频监控和医疗诊断。

目标检测算法通常分为两类:两阶段算法和单阶段算法。两阶段算法,如 R-CNN 和 Fast R-CNN,首先生成候选区域,然后对每个区域进行分类和边界框回归。单阶段算法,如 YOLO 和 SSD,一次性执行检测和分类,速度更快,但精度通常较低。

# 2. YOLOv1算法原理

### 2.1 单次卷积神经网络

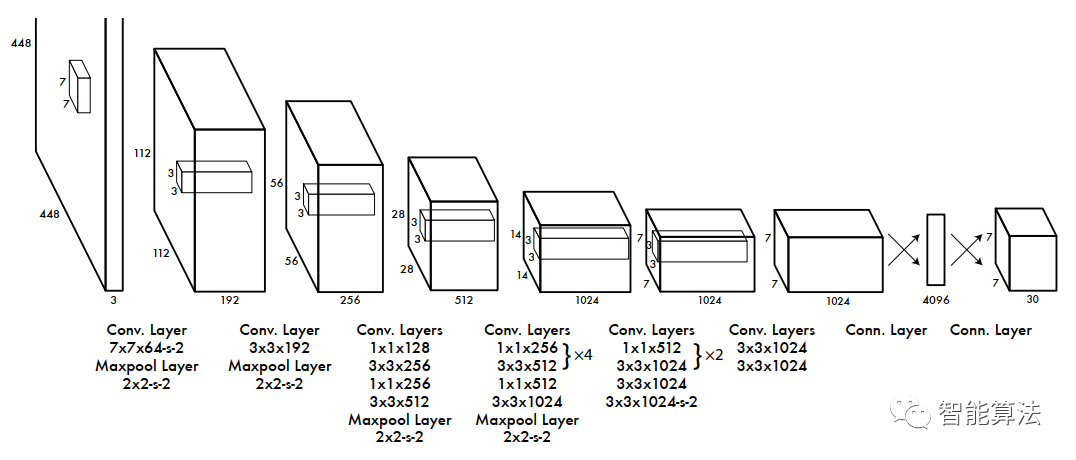

YOLOv1算法的核心思想是使用单次卷积神经网络(CNN)对图像进行处理,并直接输出目标的边界框和类别概率。与传统的目标检测算法不同,YOLOv1算法无需生成候选区域,而是将整个图像作为输入,并通过一次前向传播直接输出检测结果。

具体来说,YOLOv1算法的CNN网络结构如下:

```

Conv - Pool - Conv - Pool - Conv - Conv - Pool - Conv - Conv - Conv - Pool - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv - Conv -

```

0

0