Python编程新手必看:Tagging Fields快速入门与精通指南(3小时速成教程)

发布时间: 2024-10-10 13:25:55 阅读量: 93 订阅数: 47

在Python的Django框架下使用django-tagging的教程

# 1. Tagging Fields简介与环境搭建

在数据管理与分析领域,Tagging Fields 是一种有效的方法,用于增强数据的可读性和可操作性。通过给数据打上"标签",可以在不改变原始数据结构的情况下,额外提供元数据信息,从而为数据的分类、搜索和处理带来极大便利。

## 1.1 Tagging Fields的基础概念

### 1.1.1 什么是Tagging Fields

Tagging Fields 本质上是一种为数据元素附加额外信息的方法,通过定义一组标签来描述数据的属性。这不仅仅适用于简单的数据集,同样适用于结构化或半结构化的复杂数据,如数据库、文档或对象。

### 1.1.2 Tagging Fields在数据管理中的作用

在数据管理中,Tagging Fields 能够帮助数据分析师快速识别、分类和检索数据。对于处理大数据集,Tagging Fields 可以显著提高数据查询和处理的效率,同时保持数据结构的清晰和完整。

## 1.2 环境搭建

### 1.2.1 环境选择

要搭建一个适合开发和测试Tagging Fields的环境,你需要选择合适的编程语言和数据处理框架。Python因其简洁和强大的数据处理库(如pandas和numpy)而成为首选。

```python

# 示例:创建一个Python环境并安装pandas库

python3 -m venv tagging_env # 创建虚拟环境

source tagging_env/bin/activate # 激活虚拟环境(在Windows下使用 tagging_env\Scripts\activate)

pip install pandas # 安装pandas库

```

### 1.2.2 数据准备

接下来,准备一些示例数据,以便于演示Tagging Fields的操作。可以使用CSV或JSON格式的数据作为开始。

```python

# 示例:使用pandas读取CSV数据

import pandas as pd

data = pd.read_csv('sample_data.csv')

```

搭建Tagging Fields的工作环境是一个简明的步骤,它为后续的数据管理和操作奠定了基础。在本章的后续部分,我们将深入探讨Tagging Fields的具体运用和优化技巧。

# 2. 掌握基础语法和数据结构

## 2.1 标签字段的基础概念

### 2.1.1 什么是Tagging Fields

在数据管理的世界中,Tagging Fields(标签字段)是指用来描述数据集的额外信息字段。这些字段通过关键词、属性或分类来标识和分类数据,从而增强数据的可搜索性和可管理性。Tagging Fields允许数据被标记并附上具体的标签,使得用户可以通过这些标签对数据进行快速筛选、分类、排序和分析。

### 2.1.2 Tagging Fields在数据管理中的作用

Tagging Fields在数据管理中扮演着至关重要的角色,尤其是在大数据环境中,它们能够:

- 提高数据检索效率:通过标签可以快速定位到需要的数据集合。

- 加强数据的可读性:标签让数据的意义和内容一目了然。

- 简化数据处理流程:自动化标签的分配可以减少手动处理的步骤。

- 支持更复杂的数据分析:结合机器学习等技术,标签可用于预测分析和数据挖掘。

## 2.2 数据结构的运用

### 2.2.1 字典(Dictionary)的使用

在Python等编程语言中,字典是一种存储键值对的数据结构,非常适合用来实现Tagging Fields的功能。字典的键通常作为标签,值则关联到具体的数据或数据集合。

#### 示例代码块

```python

# 示例:创建并使用字典实现标签字段功能

tags = {'type': 'article', 'status': 'published', 'language': 'en'}

print(f"Article type: {tags['type']}")

print(f"Article status: {tags['status']}")

print(f"Article language: {tags['language']}")

```

#### 逻辑分析

在上面的代码中,我们创建了一个字典`tags`,其中包含了三个键值对,每个键对应文章的一个属性标签。通过键(如`'type'`),我们可以直接访问其对应的值(如`'article'`)。这种方式使得数据的管理和查询变得十分方便和直观。

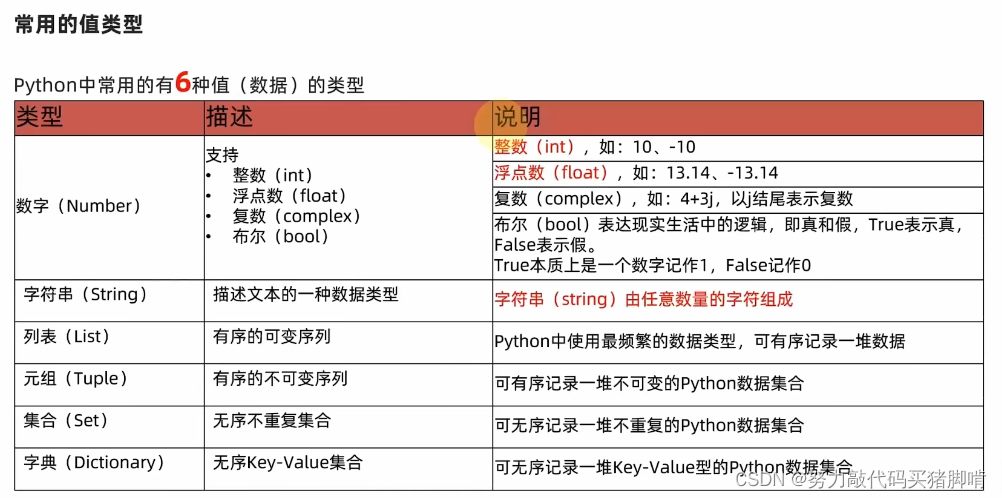

### 2.2.2 列表(List)和元组(Tuple)的区别

列表和元组都是Python中用于存储序列化数据的数据结构,但在使用上有一些区别。

- 列表(List)是可变的,可以随时修改其中的元素。

- 元组(Tuple)是不可变的,一旦创建就不能更改。

#### 表格展示差异

| 数据结构 | 可变性 | 功能 | 用途 |

| --- | --- | --- | --- |

| 列表(List) | 可变 | 存储可变序列 | 动态数据集合 |

| 元组(Tuple) | 不可变 | 存储不可变序列 | 数据交换和数据保证 |

#### 示例代码块

```python

# 示例:列表与元组的使用

my_list = [1, 2, 3] # 列表

my_tuple = (4, 5, 6) # 元组

# 修改列表

my_list[0] = 10

# 尝试修改元组将会引发错误

# my_tuple[0] = 40

```

#### 逻辑分析

在这个例子中,我们创建了一个列表`my_list`和一个元组`my_tuple`。我们可以直接修改列表中的元素,但是尝试修改元组会引发错误,因为元组不支持修改操作。

### 2.2.3 集合(Set)的去重和交集操作

集合(Set)是一个无序的、不重复的元素集。它可以用来实现去重操作,并且支持基本的集合操作,如并集、交集、差集等。

#### 示例代码块

```python

# 示例:使用集合去重和计算交集

a = {1, 2, 3, 4}

b = {3, 4, 5, 6}

# 去重

unique_elements = set(a)

# 计算交集

intersection = a & b # 或者使用 intersection(a, b)

print(f"Unique elements from set 'a': {unique_elements}")

print(f"Intersection of sets 'a' and 'b': {intersection}")

```

#### 逻辑分析

集合`a`和`b`中都包含数字,但在集合中每个数字只出现一次。使用集合去重是处理大数据集中的重复数据的一个高效方式。通过集合操作,我们可以很容易地找出两个集合中共有的元素,这对数据分析中的比较和筛选非常有用。

# 3. Tagging Fields的实战应用

## 3.1 数据分类和标记

### 3.1.1 分类数据的步骤和方法

在处理大量数据时,分类是一种常用的数据组织方式,有助于后续的数据管理和分析。分类的过程通常涉及以下步骤:

1. 确定分类标准:根据数据的特征和用途确定分类标准。例如,可以按照时间、地域、业务领域等标准进行分类。

2. 数据准备:对原始数据进行清洗和预处理,确保数据质量,为分类工作打好基础。

3. 设计分类算法:根据分类标准设计算法,比如使用决策树、聚类分析等机器学习算法进行自动分类。

4. 实施分类:应用分类算法对数据集进行处理,将数据分配到相应的类别中。

5. 结果评估与优化:通过检验分类结果的准确性和效率,评估分类模型的表现,必要时进行模型优化。

### 3.1.2 标记数据的策略和最佳实践

标记数据是给数据附加额外信息的过程,有助于提高数据的可读性和可操作性。标记数据的最佳实践包括:

1. 标记信息的一致性:确保使用一致的标记规则,避免歧义。

2. 标记粒度的选择:根据数据处理需求选择适当的标记粒度,避免过细或过粗的分类。

3. 利用元数据:使用元数据进行标记,例如,在文档管理系统中使用元数据标签来描述文档内容。

4. 自动与手动相结合:对于大规模数据集,优先使用自动标记工具,而对于特殊情况则进行手动标记。

5. 标记的维护:定期检查和更新标记信息,以保证数据的时效性和准确性。

## 3.2 数据筛选和查询

### 3.2.1 基于Tagging Fields的筛选技巧

Tagging Fields可以有效地对数据集进行筛选,以下是一些基于Tagging Fields的筛选技巧:

1. 使用Tagging Fields创建筛选条件:利用标签字段的特性,快速筛选出符合特定标签条件的数据。

2. 组合查询:通过组合多个Tagging Fields的条件进行复杂筛选。

3. 动态筛选:根据用户输入或实时数据变化动态调整筛选条件。

4. 多级筛选:构建多级筛选逻辑,例如,先按照大类标签筛选,再细化到具体子类标签。

### 3.2.2 利用查询语言进行复杂查询

复杂的数据集往往需要使用查询语言来进行更精细的查询操作。以SQL为例,可以利用其强大的查询功能进行数据检索:

```sql

SELECT * FROM table_name WHERE tag1 = 'value1' AND tag2 IN ('value2', 'value3');

```

查询语言通常包括如下操作:

- 条件过滤:使用`WHERE`子句设定筛选条件。

- 聚合函数:利用`COUNT()`, `SUM()`, `AVG()`等聚合函数进行数据汇总。

- 联合查询:通过`JOIN`操作合并多个表的数据。

- 分组与排序:使用`GROUP BY`和`ORDER BY`实现数据的分组统计和排序显示。

在进行复杂查询时,需要注意查询的性能,尤其是面对大数据集时。优化查询语句和数据库索引可以显著提高查询效率。

### 3.2.3 高级筛选技巧与工具应用

除了上述基础技巧,还可以采用一些高级的筛选技巧和工具来提升筛选的效率和准确性:

- 使用全文搜索工具如Elasticsearch进行快速全文搜索和分析。

- 利用数据可视化工具如Tableau或Power BI构建动态交互式的数据筛选仪表板。

- 采用机器学习方法进行模式识别和异常检测,进一步细化筛选标准。

在实际应用中,高级筛选技巧和工具的使用需要根据具体业务场景和数据特点进行选择和调整,以实现最佳的数据筛选效果。

# 4. Tagging Fields进阶技术

## 4.1 自定义Tagging逻辑

### 4.1.1 设计高级Tagging规则

设计高级Tagging规则是一个系统化和结构化的过程,它要求开发者对业务逻辑有深入的理解,并且能够将这些逻辑转化为可执行的Tagging方案。在设计Tagging规则时,通常需要遵循以下几个步骤:

1. **明确Tagging的目的**:首先确定Tagging需要解决的具体问题,比如是否用于提升数据检索的效率,或者用于数据分析和挖掘。

2. **分析数据特征**:了解数据的特征,包括数据类型、分布、关系等,这将有助于制定更有针对性的Tagging规则。

3. **制定规则草案**:基于数据特征,制定初步的Tagging规则,这些规则应当是可编程实现的。

4. **规则测试与评估**:将制定的规则应用于实际数据集,进行测试和评估。通过实际数据的反馈,调整和优化Tagging规则。

5. **持续迭代**:随着业务的发展和数据的变化,Tagging规则也需要不断地进行迭代和更新,以保持其有效性和准确性。

在具体实现上,可以通过编写函数或脚本来定义Tagging逻辑。例如,以下是一个简单的Python脚本,用于根据一组预定义的规则为文档打标签:

```python

def tagging_rules(document):

tags = []

if '关键词1' in document:

tags.append('标签1')

if '关键词2' in document:

tags.append('标签2')

# 更多规则...

return tags

# 示例文档

document = "这是一个含有关键词1和关键词3的示例文档。"

# 调用Tagging函数

document_tags = tagging_rules(document)

print("该文档的标签是:", document_tags)

```

在实际应用中,Tagging规则可能会涉及到复杂的自然语言处理(NLP)技术和机器学习算法,以实现智能化的文本分析和分类。

### 4.1.2 优化Tagging性能的方法

随着数据量的增加,Tagging性能成为了一个不可忽视的问题。优化Tagging性能可以从以下几个方面着手:

1. **算法优化**:选择高效的算法和数据结构是提升性能的关键,比如使用哈希表来快速查找和管理标签。

2. **并行处理**:当处理大量数据时,可以利用并行计算技术,例如多线程或分布式计算,来提高处理速度。

3. **缓存机制**:对于频繁访问的数据或标签,可以使用缓存技术来减少数据库的查询次数和提高响应速度。

4. **减少磁盘I/O**:尽量避免频繁的磁盘读写操作,因为这些操作通常比内存操作慢几个数量级。

下面的示例展示了如何使用Python的`multiprocessing`库来实现并行处理:

```python

from multiprocessing import Pool

import time

def tagging_function(document):

# 这里是复杂的Tagging逻辑

return tagging_rules(document)

def main(documents):

pool = Pool(processes=4) # 创建4个进程

start_time = time.time()

results = pool.map(tagging_function, documents)

pool.close()

pool.join()

end_time = time.time()

print(f"并行处理完成,耗时: {end_time - start_time}秒")

return results

# 大量文档数据

documents = ["文档1", "文档2", "文档3", ...]

# 运行主函数

document_tags = main(documents)

```

通过并行处理,可以显著减少处理大量数据的时间,提高Tagging操作的效率。

## 4.2 数据处理与分析

### 4.2.1 处理大数据集的技术

在大数据环境下,传统的数据处理方法往往难以应对。因此,使用适合的技术和工具来处理大数据集成为了必要。目前,最常用的两种技术是MapReduce模型和Spark框架。

MapReduce是一种编程模型,它允许开发者在集群上对数据进行分布式处理。它的工作原理是将任务分成两个阶段:Map阶段和Reduce阶段。Map阶段读取输入数据,并将其转换成中间键值对;Reduce阶段则对中间数据进行合并操作,得到最终结果。一个简单的MapReduce操作可以表示为:

```python

from mrjob.job import MRJob

class MRWordCount(MRJob):

def mapper(self, _, line):

yield "words", len(line.split())

def combiner(self, key, values):

yield key, sum(values)

def reducer(self, key, values):

yield key, sum(values)

if __name__ == '__main__':

MRWordCount.run()

```

Apache Spark则是一个更为现代的替代方案,它提供了一个更为丰富的API,并且具有更好的性能。Spark的核心概念是RDD(弹性分布式数据集),通过RDD,Spark能够优化执行计划并有效处理迭代算法。一个Spark程序的简单示例如下:

```python

from pyspark import SparkContext

sc = SparkContext()

text_file = sc.textFile("hdfs://.../file.txt")

counts = text_file.flatMap(lambda line: line.split(" ")) \

.map(lambda word: (word, 1)) \

.reduceByKey(lambda a, b: a + b)

counts.saveAsTextFile("hdfs://.../output")

```

这两种技术都可以处理海量数据,但它们的使用场景和性能特点各不相同。在选择具体技术时,需要根据实际的业务需求和数据特征来进行决策。

### 4.2.2 Tagging Fields在数据分析中的应用案例

Tagging Fields不仅可以用于数据管理,还可以在数据分析领域发挥重要作用。通过为数据打上正确的标签,可以更方便地对数据进行分类、聚合和分析,从而获得洞察力。

以一个零售数据分析项目为例,假设公司拥有大量的交易记录数据。通过Tagging Fields技术,我们可以对商品、购买时间、顾客类型等进行标记,然后根据这些标签来分析销售趋势、顾客购买行为等。

以下是一个简化的数据分析案例,它使用了pandas库在Python环境中进行数据分析:

```python

import pandas as pd

# 假设有一个交易数据集的CSV文件

data = pd.read_csv('transactions.csv')

# 为数据集添加标签列,例如顾客类型

data['CustomerType'] = data['CustomerID'].apply(lambda x: 'Returning' if x in returning_customers else 'New')

# 对数据进行分组聚合分析,比如计算每种顾客类型的平均消费额

average_spend = data.groupby('CustomerType')['AmountSpent'].mean()

# 输出分析结果

print(average_spend)

```

在这个案例中,通过为顾客数据打上“ Returning”或“New”等标签,可以快速地进行分组聚合操作,并得到有用的商业洞察。这仅是一个基本应用,实际上Tagging Fields在数据分析中的应用可以非常复杂和深入,例如通过机器学习算法进行高级分析和预测。

在进行数据分析时,确保数据质量也是非常重要的,数据清洗、预处理、数据验证等步骤对于得到准确的分析结果至关重要。此外,为了确保分析的准确性,还需要定期更新和维护Tagging规则,以适应新的数据和业务变化。

# 5. Tagging Fields项目实战

## 5.1 项目规划与设计

在开始实际的Tagging Fields项目开发之前,我们需要进行详尽的规划和设计。这不仅包括理解项目需求,而且还要考虑到如何构建项目的架构以及建立合适的数据模型。

### 5.1.1 需求分析和目标设定

在项目启动之初,需求分析是一个不可或缺的环节。这通常包括与利益相关者进行会议讨论,以确定项目的最终目标和预期结果。需要收集的信息可能包括业务流程、数据来源、数据量大小、性能要求、数据的访问模式等。一旦明确了这些需求,我们就可以设定项目目标,比如提高数据检索的速度、优化数据存储、或减少数据重复等。

### 5.1.2 构建项目架构和数据模型

在需求明确之后,接下来就是项目架构的设计。架构设计是将需求转化为实际软件结构的过程。它需要考虑很多因素,比如系统的扩展性、维护性、安全性等。对于Tagging Fields项目来说,架构设计可能需要包括数据存储、数据处理模块、查询接口等。

数据模型的建立则关注于如何在数据库层面有效地实现Tagging Fields,这包括数据表的设计、索引的创建、数据类型的选择等。例如,我们可能会为每个数据实体设计一个标签表,该表将存储实体与其相关标签之间的关系。

```sql

CREATE TABLE entity_tags (

entity_id INT,

tag_name VARCHAR(255),

PRIMARY KEY (entity_id, tag_name),

FOREIGN KEY (entity_id) REFERENCES entities(id)

);

```

## 5.2 实际开发中的问题与解决方案

在开发过程中,我们可能会遇到各种挑战和问题,如何有效地识别、分析和解决这些问题对项目的成功至关重要。

### 5.2.1 遇到的常见问题及调试技巧

开发Tagging Fields系统时可能会遇到的问题包括性能瓶颈、数据不一致性、错误的数据关联等。为了解决这些问题,我们可能需要进行性能分析、数据一致性校验和调试。

性能分析可能需要使用专业工具,比如SQL查询分析器、代码性能分析器等。对于数据一致性问题,我们可以编写测试脚本来确保数据关联的准确性。而调试过程中,使用日志记录和断点检查是两种常用的手段。

```python

# 示例代码:日志记录

import logging

logging.basicConfig(level=logging.DEBUG)

logger = logging.getLogger('debugging')

def process_data(data):

try:

# 模拟数据处理

processed_data = data * 2

except Exception as e:

logger.exception('Error processing data', exc_info=True)

raise e

```

### 5.2.2 代码优化和版本控制策略

代码优化是提高系统性能的关键步骤。在编写代码时,我们需要不断地对代码进行重构,提升代码的可读性和性能。性能优化可以通过多种手段,例如使用更高效的数据结构、减少不必要的计算、使用缓存等。

版本控制则是确保项目顺利进行的重要工具。通过使用Git等版本控制系统,我们可以跟踪项目的历史变更、进行分支管理、合并冲突以及回滚到之前的版本。正确使用版本控制能够帮助我们保持代码的稳定性和可靠性。

```git

# 示例Git命令:创建新分支并切换到该分支

git checkout -b feature-branch

# 示例Git命令:将更改添加到暂存区并提交

git add .

git commit -m "Refactor the tagging system for better performance"

# 示例Git命令:将更改推送到远程仓库

git push origin feature-branch

```

接下来,我们将进入第六章,探讨Tagging Fields在项目测试和部署阶段的应用,以及在这些阶段中可能面临的问题和解决方案。

0

0