Oracle数据库数据建模:从概念设计到物理实现,让你的数据库更合理

发布时间: 2024-08-03 20:26:49 阅读量: 40 订阅数: 46

sblim-gather-provider-2.2.8-9.el7.x64-86.rpm.tar.gz

# 1. Oracle数据库数据建模概述**

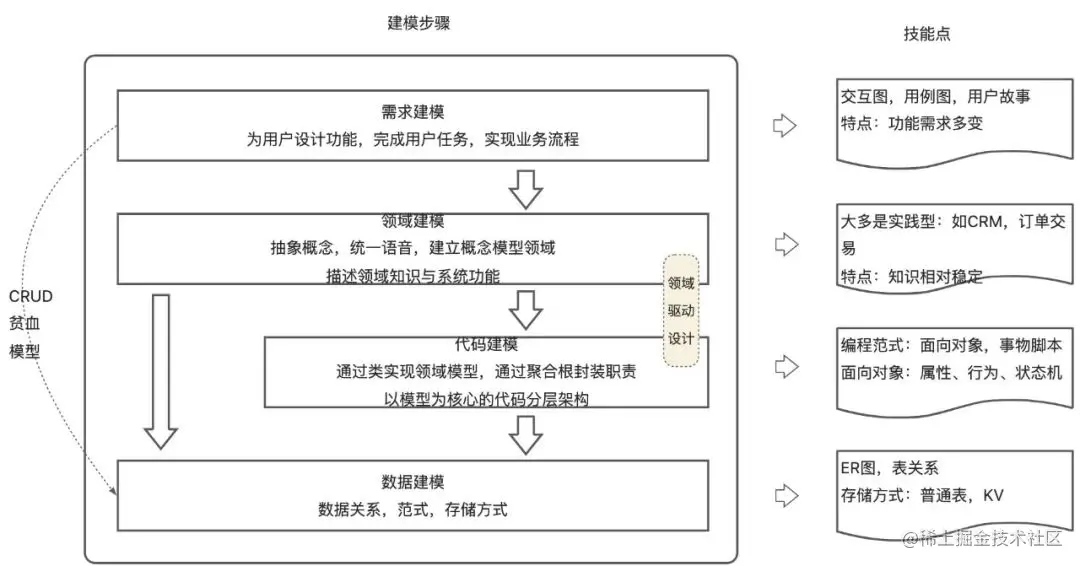

数据建模是数据库设计过程中至关重要的一步,它定义了数据库中数据的结构和组织方式。Oracle数据库数据建模涉及三个主要阶段:概念数据建模、逻辑数据建模和物理数据建模。

概念数据建模关注于业务需求的抽象表示,而逻辑数据建模则定义了数据的逻辑结构。物理数据建模将逻辑数据结构映射到物理存储结构,如表、索引和分区。

通过遵循数据建模的最佳实践,可以创建可扩展、可维护且符合业务需求的数据库。这些最佳实践包括可扩展性、可维护性、数据治理和元数据管理。

# 2. 概念数据建模

概念数据建模是数据建模过程的第一步,它着重于捕获业务领域的抽象概念和关系,而无需考虑具体的技术细节。本节将介绍两种常用的概念数据建模方法:实体关系模型(ERM)和领域驱动设计(DDD)。

### 2.1 实体关系模型(ERM)

ERM是一种图形化建模方法,用于表示业务实体及其之间的关系。它由以下元素组成:

#### 2.1.1 实体和属性

**实体**表示业务领域中的真实世界对象或概念,如客户、产品和订单。**属性**描述了实体的特征,如客户的姓名、地址和电话号码。

#### 2.1.2 关系和基数

**关系**表示实体之间的关联。**基数**指定了实体之间关系的最小和最大数量。例如,一个客户可以有多个订单(1:N),而一个订单只能属于一个客户(1:1)。

### 2.2 领域驱动设计(DDD)

DDD是一种软件开发方法,它强调通过创建领域模型来捕获业务领域的复杂性。领域模型由以下元素组成:

#### 2.2.1 限界上下文和领域模型

**限界上下文**定义了领域模型的边界,它表示业务领域中一个特定的子域。**领域模型**是限界上下文内概念的集合,它捕获了业务规则和行为。

#### 2.2.2 聚合和实体

**聚合**是领域模型中的一个逻辑分组,它代表了一个业务概念的完整性。**实体**是聚合中的一个对象,它具有自己的标识和生命周期。

**代码块:**

```

class Customer(Entity):

def __init__(self, id, name, address, phone):

self.id = id

self.name = name

self.address = address

self.phone = phone

class Order(Entity):

def __init__(self, id, customer_id, product_id, quantity):

self.id = id

self.customer_id = customer_id

self.product_id = product_id

self.quantity = q

```

0

0