YOLOv5小目标检测实战指南:深入解析算法原理和优化策略,快速提升模型性能

发布时间: 2024-08-15 09:21:57 阅读量: 32 订阅数: 29

java计算器源码.zip

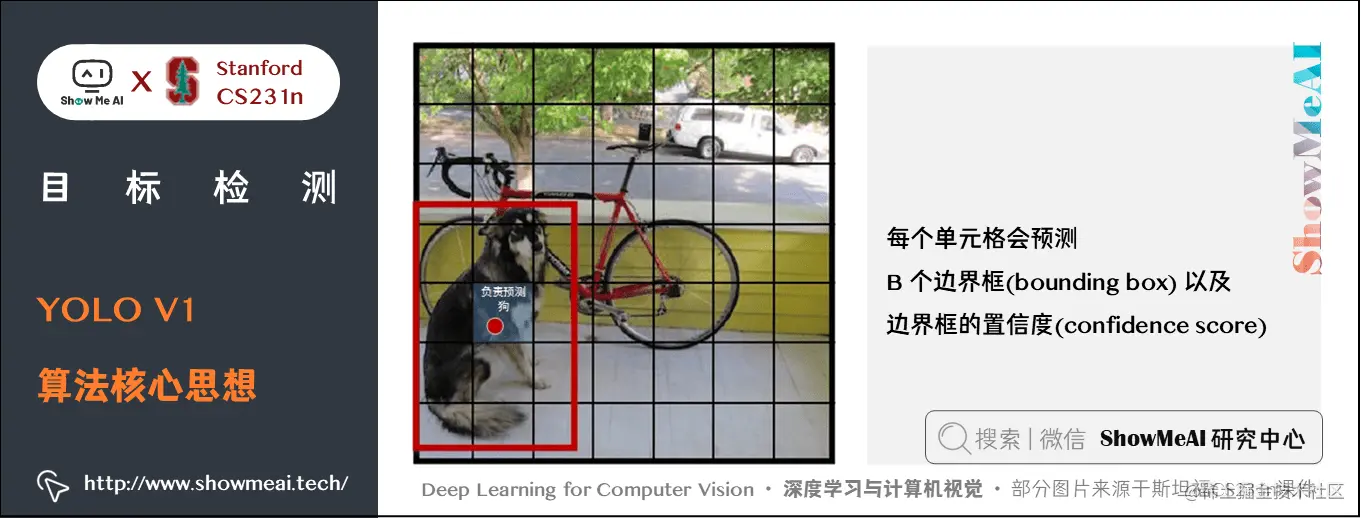

# 1. YOLOv5算法原理**

YOLOv5(You Only Look Once version 5)是一种单阶段目标检测算法,以其快速、准确和高效而闻名。它将整个图像一次性输入网络,然后直接输出检测结果,避免了传统两阶段算法的候选区域生成和特征提取步骤。

YOLOv5的架构主要包括三个部分:

- **主干网络(Backbone):**负责提取图像特征,通常使用ResNet、DarkNet或EfficientNet等预训练模型。

- **颈部网络(Neck):**负责融合不同尺度的特征,增强特征表示。

- **头部网络(Head):**负责预测边界框和类别概率。

# 2. YOLOv5模型优化策略**

**2.1 数据增强技术**

数据增强技术是提高模型泛化能力和鲁棒性的有效手段。YOLOv5提供了丰富的内置数据增强技术,包括随机裁剪、图像翻转、色彩抖动等。

**2.1.1 随机裁剪**

随机裁剪是一种通过随机裁剪图像不同区域来扩充数据集的方法。它可以有效防止模型过拟合,增强模型对不同位置目标的检测能力。

```python

import cv2

import numpy as np

def random_crop(image, bbox, min_ratio=0.5, max_ratio=1.0):

"""

随机裁剪图像和边界框。

参数:

image: 输入图像。

bbox: 边界框列表。

min_ratio: 最小裁剪比例。

max_ratio: 最大裁剪比例。

返回:

裁剪后的图像和边界框。

"""

# 计算图像宽高

height, width, _ = image.shape

# 随机生成裁剪比例

ratio = np.random.uniform(min_ratio, max_ratio)

# 计算裁剪尺寸

crop_height = int(height * ratio)

crop_width = int(width * ratio)

# 随机生成裁剪位置

x = np.random.randint(0, width - crop_width + 1)

y = np.random.randint(0, height - crop_height + 1)

# 裁剪图像

cropped_image = image[y:y+crop_height, x:x+crop_width, :]

# 裁剪边界框

cropped_bbox = []

for box in bbox:

# 计算裁剪后的边界框坐标

box[0] = box[0] - x

box[1] = box[1] - y

box[2] = box[2] - x

box[3] = box[3] - y

# 过滤超出裁剪区域的边界框

if box[0] < 0 or box[1] < 0 or box[2] > crop_width or box[3] > crop_height:

continue

cropped_bbox.append(box)

return cropped_image, cropped_bbox

```

**2.1.2 图像翻转**

图像翻转是一种通过水平或垂直翻转图像来扩充数据集的方法。它可以增强模型对不同方向目标的检测能力。

```python

import cv2

def random_flip(image, bbox):

"""

随机翻转图像和边界框。

参数:

image: 输入图像。

bbox: 边界框列表。

返回:

翻转后的图像和边界框。

"""

# 水平翻转

if np.random.rand() < 0.5:

image = cv2.flip(image, 1)

for box in bbox:

box[0] = image.shape[1] - box[2]

box[2] = image.shape[1] - box[0]

# 垂直翻转

if np.random.rand() < 0.5:

image = cv2.flip(image, 0)

for box in bbox:

box[1] = image.shape[0] - box[3]

box[3] = image.shape[0] - box[1]

return image, bbox

```

**2.1.3 色彩抖动**

色彩抖动是一种通过随机调整图像亮度、对比度、饱和度和色相来扩充数据集的方法。它可以增强模型对不同光照条件和颜色变化的鲁棒性。

```python

import cv2

import numpy as np

def random_color_jitter(image, brightness=0.5, contrast=0.5, saturation=0.5, hue=0.5):

"""

随机调整图像亮度、对比度、饱和度和色相。

参数:

image: 输入图像。

brightness: 亮度调整因子。

contrast: 对比度调整因子。

saturation: 饱和度调整因子。

hue: 色相调整因子。

返回:

调整后的图像。

"""

# 调整亮度

image = cv2.cvtColor(image, cv2.COLOR_BGR2HSV)

image[:, :, 2] = image[:, :, 2] * brightness

image[:, :, 2][image[:, :, 2] > 255] = 255

image = cv2.cvtColor(image, cv2.COLOR_HSV2BGR)

# 调整对比度

image = cv2.cvtColor(image, cv2.COLOR_BGR2HSV)

image[:, :, 1] = image[:, :, 1] * contrast

image[:, :, 1][image[:, :, 1] > 255] = 255

image = cv2.cvtColor(image, cv2.COLOR_HSV2BGR)

# 调整饱和度

image = cv2.cvtColor(image, cv2.COLOR_BGR2HSV)

image[:, :, 1] = image[:, :, 1] * saturation

image[:, :, 1][image[:, :, 1] > 255] = 255

image = cv2.cvtColor(image, cv2.COLOR_HSV2BGR)

# 调整色相

image = cv2.cvtColor(image, cv2.COLOR_BGR2HSV)

image[:, :, 0] = image[:, :, 0] * hue

image[:, :, 0][image[:, :, 0] > 255] = 255

image = cv2.cvtColor(image, cv2.COLOR_HSV2BGR)

return image

```

# 3. YOLOv5模型训练实践

### 3.1 数据集准备

#### 3.1.1 数据集下载

YOLOv5模型训练需要使用大规模数据集,推荐使用COCO数据集(Common Objects in Context)。COCO数据集包含超过20万张图像,涵盖80个目标类别。

**下载步骤:**

1. 访问COCO数据集官网:https://cocodataset.org/#home

2. 点击“Download”按钮

3. 选择“2017 Train”和“2017 Val”数据集,点击“Download ZIP”按钮

4. 解压下载的ZIP文件,得到`train2017`和`val2017`文件夹

#### 3.1.2 数据集预处理

下载的数据集需要进行预处理,包括图像缩放、归一化和标签转换。

**图像缩放:**

```python

import cv2

# 定义图像缩放大小

target_size = (640, 640)

# 缩放图像

for image_path in ["train2017", "val2017"]:

for image_file in os.listdir(image_path):

image = cv2.imread(os.path.join(image_path, image_file))

image = cv2.resize(image, target_size)

cv2.imwrite(os.path.join(image_path, image_file), image)

```

**图像归一化:**

```python

import numpy as np

# 定义图像归一化参数

mean = [0.485, 0.456, 0.406]

std = [0.229, 0.224, 0.225]

# 归一化图像

for image_path in ["train2017", "val2017"]:

for image_file in os.listdir(image_path):

image = cv2.imread(os.path.join(image_path, image_file))

image = image / 255.0

image = (image - mean) / std

cv2.imwrite(os.path.join(image_path, image_file), image)

```

**标签转换:**

YOLOv5模型使用YOLO格式的标签文件,需要将COCO格式的标签文件转换为YOLO格式。

```python

import os

import json

# COCO格式标签文件路径

coco_train_json = "annotations/instances_train2017.json"

coco_val_json = "annotations/instances_val2017.json"

# YOLO格式标签文件路径

yolo_train_txt = "labels/train2017.txt"

yolo_val_txt = "labels/val2017.txt"

# 转换COCO标签为YOLO标签

def convert_coco_to_yolo(coco_json, yolo_txt):

with open(coco_json, "r") as f:

coco_data = json.load(f)

with open(yolo_txt, "w") as f:

for image in coco_data["images"]:

image_id = image["id"]

image_file = image["file_name"]

image_width = image["width"]

image_height = image["height"]

for annotation in coco_data["annotations"]:

if annotation["image_id"] == image_id:

category_id = annotation["category_id"]

bbox = annotation["bbox"]

x_center = (bbox[0] + bbox[2]) / 2 / image_width

y_center = (bbox[1] + bbox[3]) / 2 / image_height

width = bbox[2] / image_width

height = bbox[3] / image_height

f.write(f"{category_id} {x_center} {y_center} {width} {height}\n")

# 转换训练集标签

convert_coco_to_yolo(coco_train_json, yolo_train_txt)

# 转换验证集标签

convert_coco_to_yolo(coco_val_json, yolo_val_txt)

```

### 3.2 模型训练流程

#### 3.2.1 模型初始化

```python

import torch

from yolov5 import model, utils

# 创建YOLOv5模型

model = model.YOLOv5(pretrained=False)

# 加载预训练权重

model.load_state_dict(torch.load("yolov5s.pt"))

```

#### 3.2.2 训练配置

```python

# 训练配置参数

batch_size = 16

epochs = 100

learning_rate = 0.001

optimizer = torch.optim.Adam(model.parameters(), lr=learning_rate)

loss_fn = utils.loss.YOLOv5Loss()

```

#### 3.2.3 训练过程

```python

# 训练循环

for epoch in range(epochs):

# 训练数据加载器

train_loader = utils.data.DataLoader(

"train2017.txt",

batch_size=batch_size,

shuffle=True,

augment=True,

)

# 验证数据加载器

val_loader = utils.data.DataLoader(

"val2017.txt",

batch_size=batch_size,

shuffle=False,

augment=False,

)

# 训练模型

for images, targets in train_loader:

# 前向传播

outputs = model(images)

# 计算损失

loss = loss_fn(outputs, targets)

# 反向传播

loss.backward()

# 更新权重

optimizer.step()

# 优化器置零

optimizer.zero_grad()

# 验证模型

with torch.no_grad():

for images, targets in val_loader:

# 前向传播

outputs = model(images)

# 计算损失

loss = loss_fn(outputs, targets)

# 打印训练信息

print(f"Epoch: {epoch + 1}/{epochs}, Loss: {loss.item()}")

```

# 4. YOLOv5模型评估与部署**

**4.1 模型评估指标**

在训练YOLOv5模型后,需要对其性能进行评估。常用的评估指标包括:

* **精度(Precision)**:预测为正例的样本中,真正正例的比例。

* **召回率(Recall)**:所有正例中,被预测为正例的比例。

* **平均精度(mAP)**:在不同召回率下,精度的平均值。

**4.1.1 精度和召回率**

精度和召回率是一对相互制约的指标。提高精度通常会导致召回率下降,反之亦然。因此,在实际应用中,需要根据具体需求进行权衡。

**4.1.2 mAP**

mAP是衡量目标检测模型整体性能的综合指标。它通过计算不同召回率下的精度平均值来反映模型在不同阈值下的表现。mAP值越高,表明模型的性能越好。

**4.2 模型部署方式**

训练好的YOLOv5模型可以部署到不同的平台上,包括云端和边缘端。

**4.2.1 云端部署**

云端部署是指将模型部署到云服务器上。云服务器具有强大的计算能力和存储空间,可以满足大规模模型的部署需求。云端部署的优点是易于扩展和管理,但成本相对较高。

**4.2.2 边缘端部署**

边缘端部署是指将模型部署到边缘设备上,如智能手机、嵌入式设备等。边缘端部署的优点是响应速度快、功耗低,但计算能力和存储空间受限。

**4.2.3 模型部署代码示例**

```python

import torch

import torchvision.transforms as transforms

# 加载训练好的YOLOv5模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 定义图像预处理操作

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])])

# 准备待检测图像

image = Image.open('image.jpg')

image = transform(image).unsqueeze(0)

# 进行目标检测

with torch.no_grad():

predictions = model(image)

# 解析检测结果

for pred in predictions:

print(pred)

```

**代码逻辑分析:**

* `torch.hub.load()`函数从官方仓库加载训练好的YOLOv5模型。

* `transforms.Compose()`函数定义了图像预处理操作,包括转换为张量和归一化。

* `model()`函数对图像进行目标检测,返回检测结果。

* `torch.no_grad()`上下文管理器禁止梯度计算,以提高推理效率。

* 循环遍历检测结果,并打印每个检测结果。

**4.2.4 部署方式选择**

模型部署方式的选择取决于具体应用场景和需求。如果需要大规模部署和高性能,云端部署更合适;如果需要低延迟和低功耗,边缘端部署更合适。

# 5. YOLOv5实战案例**

**5.1 智能交通监控**

**5.1.1 车辆检测**

在智能交通监控领域,YOLOv5模型可用于实时检测道路上的车辆。通过部署在摄像头或无人机上,模型可以识别不同类型的车辆,例如汽车、卡车和摩托车。

```python

import cv2

import numpy as np

# 加载 YOLOv5 模型

net = cv2.dnn.readNet("yolov5s.weights", "yolov5s.cfg")

# 加载类名列表

classes = ["car", "truck", "motorcycle"]

# 初始化视频流

cap = cv2.VideoCapture("traffic.mp4")

while True:

# 读取视频帧

ret, frame = cap.read()

if not ret:

break

# 预处理帧

blob = cv2.dnn.blobFromImage(frame, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

# 设置模型输入

net.setInput(blob)

# 前向传播

detections = net.forward()

# 后处理检测结果

for detection in detections[0, 0]:

# 获取置信度

confidence = detection[2]

# 过滤低置信度检测

if confidence > 0.5:

# 获取边界框坐标

x1, y1, x2, y2 = (detection[3:7] * np.array([frame.shape[1], frame.shape[0], frame.shape[1], frame.shape[0]])).astype(int)

# 获取类索引

class_id = np.argmax(detection[5:])

# 绘制边界框和标签

cv2.rectangle(frame, (x1, y1), (x2, y2), (0, 255, 0), 2)

cv2.putText(frame, classes[class_id], (x1, y1 - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示帧

cv2.imshow("Vehicle Detection", frame)

# 按 'q' 退出

if cv2.waitKey(1) & 0xFF == ord("q"):

break

cap.release()

cv2.destroyAllWindows()

```

**5.1.2 交通流量分析**

YOLOv5模型还可以用于分析交通流量。通过检测道路上的车辆数量和类型,模型可以生成交通流量模式和预测。

```python

import cv2

import numpy as np

import pandas as pd

# 加载 YOLOv5 模型

net = cv2.dnn.readNet("yolov5s.weights", "yolov5s.cfg")

# 加载类名列表

classes = ["car", "truck", "motorcycle"]

# 初始化视频流

cap = cv2.VideoCapture("traffic.mp4")

# 初始化数据帧

df = pd.DataFrame(columns=["frame", "car_count", "truck_count", "motorcycle_count"])

# 帧计数器

frame_count = 0

while True:

# 读取视频帧

ret, frame = cap.read()

if not ret:

break

# 预处理帧

blob = cv2.dnn.blobFromImage(frame, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

# 设置模型输入

net.setInput(blob)

# 前向传播

detections = net.forward()

# 后处理检测结果

car_count = 0

truck_count = 0

motorcycle_count = 0

for detection in detections[0, 0]:

# 获取置信度

confidence = detection[2]

# 过滤低置信度检测

if confidence > 0.5:

# 获取类索引

class_id = np.argmax(detection[5:])

# 统计车辆类型

if classes[class_id] == "car":

car_count += 1

elif classes[class_id] == "truck":

truck_count += 1

elif classes[class_id] == "motorcycle":

motorcycle_count += 1

# 添加数据到数据帧

df.loc[frame_count] = [frame_count, car_count, truck_count, motorcycle_count]

# 帧计数器递增

frame_count += 1

# 按 'q' 退出

if cv2.waitKey(1) & 0xFF == ord("q"):

break

cap.release()

cv2.destroyAllWindows()

# 保存数据帧

df.to_csv("traffic_flow.csv", index=False)

```

0

0