【YOLO批量识别:10大技巧优化图像处理流程,提升识别效率】

发布时间: 2024-08-13 17:06:45 阅读量: 73 订阅数: 38

YOLO V5 识别本地文件夹图片,输出使用模型识别后的结果

# 1. YOLO批量识别概述

YOLO(You Only Look Once)是一种实时目标检测算法,以其速度和准确性而闻名。YOLO批量识别将YOLO算法应用于批量图像,以一次性检测和识别多个目标。它在安防、工业和医疗等领域有着广泛的应用。

与传统的目标检测算法不同,YOLO使用单个神经网络对图像进行一次性处理,从而实现实时检测。这种方法消除了目标定位和分类的中间步骤,大大提高了检测速度。此外,YOLO采用了一种独特的锚框机制,可以同时检测不同大小和形状的目标。

# 2. YOLO批量识别理论基础

### 2.1 YOLO算法原理

#### 2.1.1 目标检测基础知识

目标检测是计算机视觉中的一项基本任务,其目的是在图像或视频中定位和识别感兴趣的对象。传统的目标检测方法通常采用两阶段流程:

1. **区域生成:**使用滑动窗口或区域建议网络生成候选目标区域。

2. **分类和回归:**对每个候选区域进行分类并预测其边界框。

#### 2.1.2 YOLO算法的网络结构和训练过程

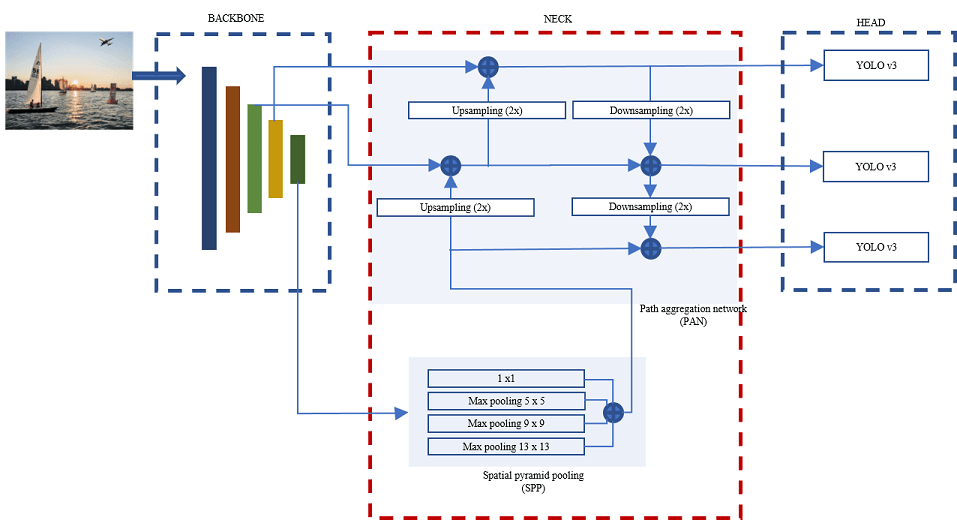

YOLO(You Only Look Once)算法是一种单阶段目标检测算法,它将目标检测问题转化为回归问题。YOLO算法的网络结构主要包括:

- **主干网络:**通常采用预训练的卷积神经网络(如ResNet或Darknet)作为主干网络,用于提取图像特征。

- **卷积层:**主干网络输出的特征图通过一系列卷积层进行处理,以提取更高层次的特征。

- **预测层:**预测层将卷积层输出的特征图划分为网格,每个网格预测多个边界框和置信度。

YOLO算法的训练过程主要包括:

1. **数据准备:**收集和标注目标检测数据集,其中每个图像包含多个目标及其边界框。

2. **网络初始化:**使用预训练的主干网络初始化YOLO网络。

3. **正负样本采样:**对于每个网格,选择一个负责预测真实边界框的正样本,并从其他网格中采样负样本。

4. **损失函数:**定义损失函数来衡量预测边界框和真实边界框之间的差异,通常包括定位损失、分类损失和置信度损失。

5. **反向传播和优化:**使用反向传播算法计算网络参数的梯度,并使用优化算法(如SGD或Adam)更新参数。

### 2.2 YOLO批量识别优化策略

#### 2.2.1 数据增强技术

数据增强技术可以增加训练数据集的多样性,从而提高模型的泛化能力。常用的数据增强技术包括:

- **图像缩放和裁剪:**随机缩放和裁剪图像,以模拟不同距离和视角下的目标。

- **图像翻转:**水平或垂直翻转图像,以增加训练样本的种类。

- **颜色抖动:**随机调整图像的亮度、对比度和饱和度,以增强模型对光照变化的鲁棒性。

#### 2.2.2 模型选择和调参

模型选择和调参是优化YOLO批量识别模型的关键步骤。以下是一些需要注意的因素:

- **主干网络选择:**选择合适的预训练主干网络,以平衡模型精度和速度。

- **网格尺寸:**网格尺寸决定了模型对小目标的检测能力,较小的网格尺寸有利于检测小目标,但可能增加计算量。

- **锚框设置:**锚框是预测边界框的先验框,选择合适的锚框可以提高模型的召回率。

- **超参数调优:**调整学习率、权重衰减和正负样本采样率等超参数,以优化模型性能。

```python

import torch

import torchvision.transforms as transforms

# 数据增强变换

transform = transforms.Compose([

transforms.RandomResizedCrop(224),

transforms.RandomHorizontalFlip(),

transforms.ColorJitter(brightness=0.4, contrast=0.4, saturation=0.4, hue=0.2),

transforms.ToTensor(),

transforms.Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])

])

# 训练数据集

train_dataset = torchvision.datasets.CIFAR10(root='./data', train=True, download=True, transform=transform)

# 训练数据加载器

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=64, shuffle=True)

```

**代码逻辑分析:**

这段代码展示了如何使用PyTorch的`torchvision.transforms`模块对CIFAR-10训练数据集进行数据增强。数据增强变换包括随机裁剪、水平翻转、颜色抖动、张量化和归一化。这些变换有助于增加训练数据集的多样性,提高模型的泛化能力。

**参数说明:**

- `RandomResizedCrop(224)`:随机裁剪图像大小为224x224。

- `RandomHorizontalFlip()`:随机水平翻转图像。

- `ColorJitter(brightness=0.4, contrast=0.4, saturation=0.4, hue=0.2)`:随机调整图像的亮度、对比度、饱和度和色相。

- `ToTensor()`:将图像转换为张量。

- `Normalize([0.485, 0.456, 0.406], [0.229, 0.224, 0.225])`:使用CIFAR-10图像的平均值和标准差对张量进行归一化。

# 3. YOLO批量识别实践应用

### 3.1 YOLO批量识别图像预处理

#### 3.1.1 图像缩放和裁剪

YOLO算法对输入图像的大小有要求,因此需要对图像进行缩放和裁剪以满足算法的输入要求。缩放操作可以改变图像的分辨率,而裁剪操作可以从图像中提取感兴趣的区域。

```python

import cv2

# 图像缩放

image = cv2.imread("image.jpg")

scaled_image = cv2.resize(image, (416, 416))

# 图像裁剪

cropped_image = scaled_image[0:416, 0:416]

```

#### 3.1.2 图像增强和噪声去除

图像增强技术可以提高图像的质量,使YOLO算法能够更准确地检测目标。常用的图像增强技术包括对比度增强、锐化和去噪。

```python

import numpy as np

# 对比度增强

contrast_image = cv2.convertScaleAbs(image, alpha=1.5, beta=0)

# 锐化

kernel = np.array([[0, -1, 0], [-1, 5, -1], [0, -1, 0]])

sharpened_image = cv2.filter2D(image, -1, kernel)

# 去噪

denoised_image = cv2.fastNlMeansDenoisingColored(image, None, 10, 10, 7, 21)

```

### 3.2 YOLO批量识别模型训练

#### 3.2.1 训练数据集准备

训练数据集是YOLO算法训练的基础。数据集应包含大量标记的图像,其中每个图像都标注了目标的位置和类别。

#### 3.2.2 模型训练过程和参数设置

YOLO算法的训练过程涉及以下步骤:

1. 将训练数据集划分为训练集和验证集。

2. 初始化YOLO网络模型。

3. 使用训练集训练模型。

4. 使用验证集评估模型的性能。

5. 调整模型参数和训练策略,以提高模型的性能。

```python

import torch

from torch.utils.data import DataLoader

# 训练数据集

train_dataset = ...

# 验证数据集

val_dataset = ...

# 数据加载器

train_loader = DataLoader(train_dataset, batch_size=16, shuffle=True)

val_loader = DataLoader(val_dataset, batch_size=16, shuffle=False)

# YOLO网络模型

model = ...

# 优化器

optimizer = ...

# 损失函数

loss_fn = ...

# 训练过程

for epoch in range(100):

for batch in train_loader:

# 前向传播

outputs = model(batch["image"])

# 计算损失

loss = loss_fn(outputs, batch["target"])

# 反向传播

loss.backward()

# 更新权重

optimizer.step()

# 评估模型

with torch.no_grad():

val_loss = 0

for batch in val_loader:

# 前向传播

outputs = model(batch["image"])

# 计算损失

loss = loss_fn(outputs, batch["target"])

# 累加损失

val_loss += loss

# 计算平均损失

avg_val_loss = val_loss / len(val_loader)

# 打印损失

print(f"Epoch: {epoch}, Train Loss: {loss}, Val Loss: {avg_val_loss}")

```

### 3.3 YOLO批量识别后处理

#### 3.3.1 目标检测结果解析

YOLO算法的输出是一组边界框和置信度分数。边界框表示目标的位置,置信度分数表示算法对目标检测的信心。

```python

import numpy as np

# 解析边界框

bboxes = outputs["bboxes"].numpy()

# 解析置信度分数

scores = outputs["scores"].numpy()

# 筛选置信度分数大于阈值的边界框

filtered_bboxes = bboxes[scores > 0.5]

```

#### 3.3.2 结果可视化和保存

将检测到的目标可视化在图像上,并保存结果图像。

```python

import cv2

# 可视化边界框

for bbox in filtered_bboxes:

x1, y1, x2, y2 = bbox

cv2.rectangle(image, (x1, y1), (x2, y2), (0, 255, 0), 2)

# 保存结果图像

cv2.imwrite("result.jpg", image)

```

# 4. YOLO批量识别进阶优化

### 4.1 YOLO批量识别加速技术

随着YOLO算法的不断发展,其在实际应用中的效率要求也越来越高。为了满足实时性和高吞吐量的需求,研究人员提出了多种YOLO批量识别加速技术。

#### 4.1.1 GPU并行计算

GPU(图形处理器)具有强大的并行计算能力,非常适合处理图像和视频等数据密集型任务。YOLO算法可以通过利用GPU的并行架构来显著提高其处理速度。

**代码块:**

```python

import torch

import torchvision

# 加载模型

model = torchvision.models.yolov3(pretrained=True)

# 将模型移动到GPU

model = model.cuda()

# 加载图像

image = torch.randn(1, 3, 416, 416)

# 将图像移动到GPU

image = image.cuda()

# 推理

with torch.no_grad():

outputs = model(image)

```

**逻辑分析:**

这段代码将YOLOv3模型移动到GPU,然后将图像数据也移动到GPU。在推理阶段,通过`with torch.no_grad()`上下文管理器,可以关闭梯度计算,从而进一步提高推理速度。

#### 4.1.2 模型压缩和量化

模型压缩和量化是减少模型大小和计算复杂度的两种有效技术。通过压缩和量化,YOLO模型可以在保持精度的情况下部署到资源受限的设备,如移动设备或嵌入式系统。

**代码块:**

```python

import torch

import torch.nn.quantization as quantization

# 加载模型

model = torchvision.models.yolov3(pretrained=True)

# 量化模型

quantized_model = quantization.quantize_dynamic(model, {torch.nn.Linear}, dtype=torch.qint8)

```

**逻辑分析:**

这段代码使用PyTorch的`quantize_dynamic()`函数对YOLOv3模型进行动态量化。量化后,模型的权重和激活被转换为低精度格式(如int8),从而减少了模型的大小和计算成本。

### 4.2 YOLO批量识别集成和部署

#### 4.2.1 YOLO批量识别服务搭建

为了在实际应用中使用YOLO批量识别,需要将模型集成到服务中。可以通过使用Web框架(如Flask或Django)或云服务(如AWS Lambda或Azure Functions)来搭建YOLO批量识别服务。

**代码块:**

```python

from flask import Flask, request, jsonify

import torchvision.models as models

# 加载模型

model = models.yolov3(pretrained=True)

# 创建Flask应用

app = Flask(__name__)

@app.route('/predict', methods=['POST'])

def predict():

# 解析请求数据

data = request.get_json()

image = data['image']

# 预处理图像

image = torchvision.transforms.ToTensor()(image)

# 推理

with torch.no_grad():

outputs = model(image)

# 返回预测结果

return jsonify({'predictions': outputs})

```

**逻辑分析:**

这段代码使用Flask框架搭建了一个YOLO批量识别服务。当收到HTTP POST请求时,服务会解析请求数据,预处理图像,然后使用YOLO模型进行推理。推理结果通过JSON格式返回给客户端。

#### 4.2.2 YOLO批量识别应用场景

YOLO批量识别技术具有广泛的应用场景,包括:

* **安防领域:**人员检测和识别、车辆检测和识别

* **工业领域:**产品缺陷检测、生产线质量监控

* **医疗领域:**医学图像分析、疾病诊断

* **零售领域:**商品识别、库存管理

* **交通领域:**交通流量监测、自动驾驶

# 5. YOLO批量识别案例分析

### 5.1 YOLO批量识别在安防领域的应用

#### 5.1.1 人员检测和识别

在安防领域,YOLO批量识别技术可以应用于人员检测和识别,以实现人员管控、安全监控等功能。

```python

import cv2

import numpy as np

# 加载 YOLO 模型

net = cv2.dnn.readNetFromDarknet("yolov3.cfg", "yolov3.weights")

# 加载待检测图像

image = cv2.imread("person.jpg")

# 预处理图像

image = cv2.resize(image, (416, 416))

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 将图像输入模型进行检测

blob = cv2.dnn.blobFromImage(image, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

net.setInput(blob)

detections = net.forward()

# 解析检测结果

for detection in detections[0, 0]:

score = detection[5]

if score > 0.5:

left, top, right, bottom = detection[0:4] * np.array([image.shape[1], image.shape[0], image.shape[1], image.shape[0]])

cv2.rectangle(image, (int(left), int(top)), (int(right), int(bottom)), (0, 255, 0), 2)

cv2.putText(image, "Person", (int(left), int(top) - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示检测结果

cv2.imshow("Person Detection", image)

cv2.waitKey(0)

```

#### 5.1.2 车辆检测和识别

YOLO批量识别技术还可以应用于车辆检测和识别,以实现交通管理、车辆管控等功能。

```python

import cv2

import numpy as np

# 加载 YOLO 模型

net = cv2.dnn.readNetFromDarknet("yolov3.cfg", "yolov3.weights")

# 加载待检测图像

image = cv2.imread("car.jpg")

# 预处理图像

image = cv2.resize(image, (416, 416))

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 将图像输入模型进行检测

blob = cv2.dnn.blobFromImage(image, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

net.setInput(blob)

detections = net.forward()

# 解析检测结果

for detection in detections[0, 0]:

score = detection[5]

if score > 0.5:

left, top, right, bottom = detection[0:4] * np.array([image.shape[1], image.shape[0], image.shape[1], image.shape[0]])

cv2.rectangle(image, (int(left), int(top)), (int(right), int(bottom)), (0, 0, 255), 2)

cv2.putText(image, "Car", (int(left), int(top) - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 0, 255), 2)

# 显示检测结果

cv2.imshow("Car Detection", image)

cv2.waitKey(0)

```

### 5.2 YOLO批量识别在工业领域的应用

#### 5.2.1 产品缺陷检测

在工业领域,YOLO批量识别技术可以应用于产品缺陷检测,以实现质量控制、提高生产效率等功能。

```python

import cv2

import numpy as np

# 加载 YOLO 模型

net = cv2.dnn.readNetFromDarknet("yolov3.cfg", "yolov3.weights")

# 加载待检测图像

image = cv2.imread("product.jpg")

# 预处理图像

image = cv2.resize(image, (416, 416))

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 将图像输入模型进行检测

blob = cv2.dnn.blobFromImage(image, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

net.setInput(blob)

detections = net.forward()

# 解析检测结果

for detection in detections[0, 0]:

score = detection[5]

if score > 0.5:

left, top, right, bottom = detection[0:4] * np.array([image.shape[1], image.shape[0], image.shape[1], image.shape[0]])

cv2.rectangle(image, (int(left), int(top)), (int(right), int(bottom)), (255, 0, 0), 2)

cv2.putText(image, "Defect", (int(left), int(top) - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (255, 0, 0), 2)

# 显示检测结果

cv2.imshow("Product Defect Detection", image)

cv2.waitKey(0)

```

#### 5.2.2 生产线质量监控

YOLO批量识别技术还可以应用于生产线质量监控,以实现实时监控、质量追溯等功能。

```python

import cv2

import numpy as np

# 加载 YOLO 模型

net = cv2.dnn.readNetFromDarknet("yolov3.cfg", "yolov3.weights")

# 打开视频流

cap = cv2.VideoCapture("production_line.mp4")

while True:

# 读取一帧图像

ret, image = cap.read()

if not ret:

break

# 预处理图像

image = cv2.resize(image, (416, 416))

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 将图像输入模型进行检测

blob = cv2.dnn.blobFromImage(image, 1 / 255.0, (416, 416), (0, 0, 0), swapRB=True, crop=False)

net.setInput(blob)

detections = net.forward()

# 解析检测结果

for detection in detections[0, 0]:

score = detection[5]

if score > 0.5:

left, top, right, bottom = detection[0:4] * np.array([image.shape[1], image.shape[0], image.shape[1], image.shape[0]])

cv2.rectangle(image, (int(left), int(top)), (int(right), int(bottom)), (0, 255, 0), 2)

cv2.putText(image, "Product", (int(left), int(top) - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示检测结果

cv2.imshow("Production Line Quality Monitoring", image)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放视频流

cap.release()

cv2.destroyAllWindows()

```

0

0