YOLOv5圆形目标检测:精准识别,高效处理

发布时间: 2024-08-15 08:23:22 阅读量: 125 订阅数: 27

yolov5-使用yolov5进行手写单词检测+识别.zip

# 1. YOLOv5目标检测概述

YOLOv5(You Only Look Once version 5)是当前最先进的目标检测算法之一,以其速度快、精度高的特点而闻名。它基于卷积神经网络(CNN),利用单次前向传播即可同时检测和定位图像中的多个对象。

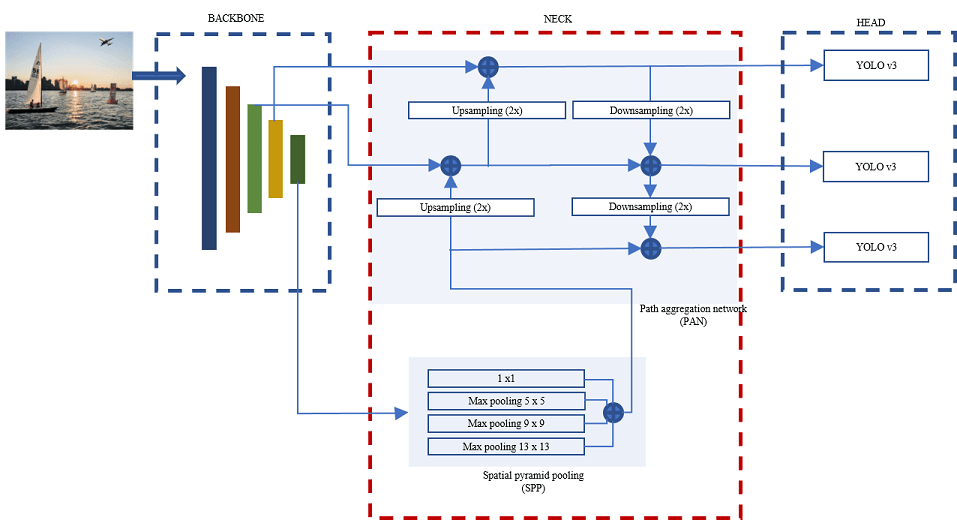

YOLOv5的架构包含一个主干网络和三个检测头。主干网络负责提取图像特征,而检测头则负责预测边界框和类概率。这种设计使得YOLOv5能够以实时速度进行目标检测,同时保持较高的精度。

YOLOv5在各种目标检测任务中表现出色,包括图像分类、对象定位和视频分析。它已被广泛应用于安防监控、自动驾驶和医疗成像等领域。

# 2. YOLOv5模型的理论基础

### 2.1 卷积神经网络(CNN)的原理

卷积神经网络(CNN)是一种深度学习模型,专为处理具有网格状结构的数据(如图像)而设计。CNN由一系列卷积层组成,每个卷积层都应用一组可学习的滤波器(或内核)来提取输入数据的特征。

**卷积层的工作原理:**

1. **滑动窗口:**滤波器在输入数据上以滑动窗口的方式移动,逐个像素地进行卷积操作。

2. **点积:**滤波器中的每个权重与滑动窗口中的相应像素值相乘,然后求和。

3. **激活函数:**卷积结果通常通过激活函数(如ReLU)进行处理,以引入非线性并增强模型的表达能力。

### 2.2 目标检测算法的演变

目标检测算法从早期的滑动窗口方法演变而来,如R-CNN、Fast R-CNN和Faster R-CNN。这些方法使用预先训练的CNN作为特征提取器,然后使用区域建议网络(RPN)生成目标候选区域。

**YOLO(You Only Look Once)算法:**

YOLO算法于2015年提出,它将目标检测任务视为回归问题,直接预测目标的边界框和类别。YOLO算法速度快,但精度较低。

### 2.3 YOLOv5模型的架构与优势

YOLOv5是YOLO算法的最新版本,它结合了多种先进技术,包括:

**Cross-Stage Partial Connections (CSP):**一种新的网络架构,可以减少计算量并提高模型精度。

**Spatial Attention Module (SAM):**一种注意力机制,可以增强模型对重要特征的关注。

**Path Aggregation Network (PAN):**一种特征融合机制,可以改善不同层级特征的利用。

**YOLOv5模型的优势:**

* **速度快:**YOLOv5模型的推理速度高达每秒数百帧,使其非常适合实时目标检测应用。

* **精度高:**YOLOv5模型在COCO数据集上取得了64.0%的AP(平均精度),在精度和速度之间取得了良好的平衡。

* **通用性强:**YOLOv5模型可以用于各种目标检测任务,包括对象检测、人脸检测和车辆检测。

**代码块:**

```python

import torch

import torchvision.transforms as transforms

# 定义CSPDarknet53网络

class CSPDarknet53(torch.nn.Module):

def __init__(self):

super(CSPDarknet53, self).__init__()

# ...

# 定义YOLOv5模型

class YOLOv5(torch.nn.Module):

def __init__(self):

super(YOLOv5, self).__init__()

# ...

# 加载预训练权重

model = YOLOv5()

model.load_state_dict(torch.load('yolov5s.pt'))

# 图像预处理

transform = transforms.Compose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 图像输入

image = transform(Image.open('image.jpg')).unsqueeze(0)

# 目标检测

with torch.no_grad():

outputs = model(image)

```

**逻辑分析:**

* CSPDarknet53网络用于提取图像特征。

* YOLOv5模型使用CSP、SAM和PAN机制进行目标检测。

* 图像预处理将图像转换为张量并进行归一化。

* 模型在推理模式下进行目标检测,输出边界框和类别预测。

**参数说明:**

* `model.load_state_dict()`:加载预训练权重。

* `transform`:图像预处理变换。

* `image`:输入图像。

* `outputs`:模型输出,包含边界框和类别预测。

# 3.1 模型的训练与评估

#### 3.1.1 数据集准备与预处理

训练YOLOv5模型需要大量的标注数据。常用的数据集包括COCO、VOC和ImageNet。这些数据集提供不同场景和目标类别的大量图像和标注信息。

数据预处理是训练模型的关键步骤。它涉及到将图像调整为模型输入所需的尺寸、格式和数据类型。常见的预处理操作包括:

- 图像缩放和裁剪:将图像调整为模型输入所需的尺寸,并随机裁剪以增加数据多样性。

- 数据增强:应用随机旋转、翻转、颜色抖动等技术来增强数据,防止模型过拟合。

- 数据归一化:将图像像素值归一化到[0, 1]或[-1, 1]的范围内,以提高模型收敛速度。

#### 3.1.2 模型训练与参数优化

YOLOv5模型的训练是一个迭代的过程,涉及到以下步骤:

1. **正向传播:**将预处理后的图像输入模型,并通过模型的层进行正向传播,得到预测结果。

2. **损失计算:**计算预测结果与真实标注之间的损失函数,如交叉熵损失或IoU损失。

3. **反向传播:**根据损失函数计算模型参数的梯度,并使用优化器(如Adam或SGD)更新参数。

4. **权重更新:**根据更新后的参数,更新模型的权重。

训练过程中的参数优化至关重要。常见的优化技术包括:

- **学习率调整:**随着训练的进行,逐渐降低学习率以提高收敛稳定性。

- **权重衰减:**添加L1或L2正则化项,以防止模型过拟合。

- **梯度裁剪:**限制梯度的最大值,以防止梯度爆炸和模型不稳定。

#### 3.1.3 模型评估与性能分析

训练完成后,需要评估模型的性能。常用的评估指标包括:

- **平均精度(mAP):**在不同IoU阈值下的平均精度,衡量模型对目标检测的准确性。

- **召回率:**模型检测出所有真实目标的比例,衡量模型的完整性。

- **推理速度:**模型在特定硬件上的推理时间,衡量模型的实时性。

通过分析评估结果,可以优化模型的参数和训练策略,以提高模型的性能。

# 4. YOLOv5模型的进阶应用

### 4.1 圆形目标检测的挑战与解决方案

#### 4.1.1 圆形目标的特征与检测难点

圆形目标检测与矩形目标检测存在显著差异,主要体现在以下几个方面:

- **形状差异:**圆形目标缺乏明显的边界和角点,使得特征提取和定位变得困难。

- **遮挡敏感性:**圆形目标容易受到遮挡,遮挡区域会影响特征提取和定位的准确性。

- **尺度变化:**圆形目标的尺度变化范围较大,从微小的圆点到巨大的圆形物体,这给模型的泛化能力带来挑战。

#### 4.1.2 YOLOv5模型的改进与优化

为了解决圆形目标检测的难点,YOLOv5模型进行了针对性的改进和优化:

- **圆形锚框:**传统YOLOv5模型使用矩形锚框,而针对圆形目标,研究人员提出了圆形锚框,其形状更符合圆形目标的特征,提高了定位精度。

- **特征增强:**通过引入额外的卷积层和注意力机制,增强模型对圆形目标特征的提取能力,减少遮挡和尺度变化的影响。

- **损失函数优化:**针对圆形目标的形状差异和遮挡敏感性,对损失函数进行优化,使其更适合圆形目标的检测任务。

### 4.2 实时目标检测与追踪

#### 4.2.1 实时检测的实现原理

实时目标检测要求模型能够在视频流或图像序列中快速准确地检测目标。YOLOv5模型采用以下技术实现实时检测:

- **轻量化模型:**通过模型剪枝和量化等技术,减小模型的尺寸和计算量,提高推理速度。

- **并行计算:**利用GPU或TPU等并行计算设备,同时处理多个图像或帧,提升推理效率。

- **预处理优化:**通过图像预处理技术,如图像缩放和数据增强,减少模型的输入数据量,加快推理速度。

#### 4.2.2 目标追踪算法的应用

在实时目标检测中,目标追踪算法用于关联连续帧中的目标,实现目标的运动轨迹跟踪。YOLOv5模型可以与以下目标追踪算法结合使用:

- **卡尔曼滤波:**一种经典的线性目标追踪算法,通过预测和更新目标状态来估计目标位置。

- **IOU追踪:**一种基于交并比(IOU)的简单但有效的目标追踪算法,通过计算目标与检测框的重叠区域来关联目标。

- **深度排序:**一种基于深度学习的目标追踪算法,利用深度特征提取和关联网络来提高追踪精度。

通过结合YOLOv5模型和目标追踪算法,可以实现实时目标检测与追踪,广泛应用于视频监控、自动驾驶和人机交互等领域。

# 5. YOLOv5模型的性能优化

### 5.1 模型压缩与加速

#### 5.1.1 模型剪枝与量化

**模型剪枝**

模型剪枝是一种通过移除冗余和不重要的连接或节点来减小模型大小的技术。对于YOLOv5模型,可以应用剪枝算法来识别和删除对模型性能影响较小的权重和通道。

```python

import torch

from torch.nn.utils import prune

# 加载预训练的YOLOv5模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 定义剪枝率

prune_rate = 0.2

# 创建剪枝器

pruner = prune.L1Unstructured(model)

# 执行剪枝

pruner.prune(prune_rate)

```

**模型量化**

模型量化是一种将浮点权重和激活转换为低精度数据类型(如int8或int16)的技术,从而减小模型大小并提高推理速度。对于YOLOv5模型,可以使用量化工具(如TensorRT或ONNX Runtime)来执行量化。

```python

import torch

import torch.quantization

# 加载预训练的YOLOv5模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 准备模型进行量化

model = torch.quantization.prepare(model, inplace=True)

# 执行量化

model = torch.quantization.convert(model, inplace=True)

```

#### 5.1.2 硬件加速与优化

**GPU加速**

GPU(图形处理单元)可以显著加速YOLOv5模型的推理过程。可以使用CUDA或cuDNN等库来利用GPU的并行计算能力。

```python

import torch

import torch.cuda

# 检查GPU可用性

if torch.cuda.is_available():

# 将模型移动到GPU

model = model.cuda()

# 使用GPU进行推理

outputs = model(input_tensor)

```

**硬件优化**

除了GPU之外,还可以使用专门的硬件加速器(如TPU或FPGA)来进一步优化YOLOv5模型的推理性能。这些加速器针对深度学习任务进行了优化,可以提供更高的吞吐量和更低的延迟。

### 5.2 算法改进与创新

#### 5.2.1 新型骨干网络的探索

YOLOv5模型的骨干网络通常是ResNet或CSPDarknet。近年来,已经提出了许多新的骨干网络架构,可以提高YOLOv5模型的精度和速度。例如,EfficientNet和MobileNetV3可以提供更轻量级的骨干网络,而Swin Transformer和ViT可以提供更强大的表示能力。

#### 5.2.2 检测头的改进与优化

YOLOv5模型的检测头负责生成目标检测结果。可以通过改进检测头的结构和损失函数来提高模型的精度和鲁棒性。例如,可以引入注意力机制来增强模型对目标特征的关注,或者使用新的损失函数来减少假阳性和假阴性。

# 6. YOLOv5模型的未来发展与展望

### 6.1 算法的持续演进与突破

YOLOv5模型的算法仍在不断演进和突破,研究人员正在探索新的方法来提高其准确性和效率。一些有前景的研究方向包括:

- **新型骨干网络:**探索新的骨干网络架构,如Transformer和Graph Neural Networks (GNN),以提取更丰富的特征和提高检测精度。

- **检测头的改进:**优化检测头,如引入注意力机制、特征融合模块和上下文信息,以增强目标定位能力和减少漏检。

- **算法创新:**开发新的算法,如自适应训练策略、元学习和弱监督学习,以提高模型的泛化能力和鲁棒性。

### 6.2 应用领域的拓展与创新

YOLOv5模型在目标检测领域取得了巨大成功,其应用领域也在不断拓展和创新。未来,YOLOv5模型有望在以下领域发挥重要作用:

- **自动驾驶:**实时检测行人、车辆和其他障碍物,为自动驾驶系统提供关键信息。

- **医疗影像:**检测和分类医学图像中的病变,辅助医生诊断和治疗。

- **智能零售:**识别和跟踪商店中的顾客,分析购物行为和优化店内布局。

- **工业检测:**检测和分类工业产品中的缺陷,提高生产效率和产品质量。

### 6.3 计算机视觉领域的未来趋势

YOLOv5模型是计算机视觉领域快速发展的一个缩影。未来,计算机视觉领域将继续呈现以下趋势:

- **深度学习的普及:**深度学习将继续成为计算机视觉领域的主导技术,推动模型的性能和应用范围不断扩展。

- **数据驱动的研究:**大规模数据集和先进的标注技术将促进数据驱动的研究,使模型能够从海量数据中学习和适应。

- **跨学科融合:**计算机视觉将与其他领域,如自然语言处理和机器人技术,进行更紧密的融合,创造新的应用和可能性。

0

0