【IPython.Shell中的绘图魔法】:掌握数据可视化的基本技巧,让数据讲故事

发布时间: 2024-10-17 05:08:30 阅读量: 20 订阅数: 36

NumPy攻略-Python科学计算与数据分析-第一章:使用IPython.pdf

# 1. IPython.Shell与数据可视化的介绍

## 1.1 IPython.Shell的基本功能

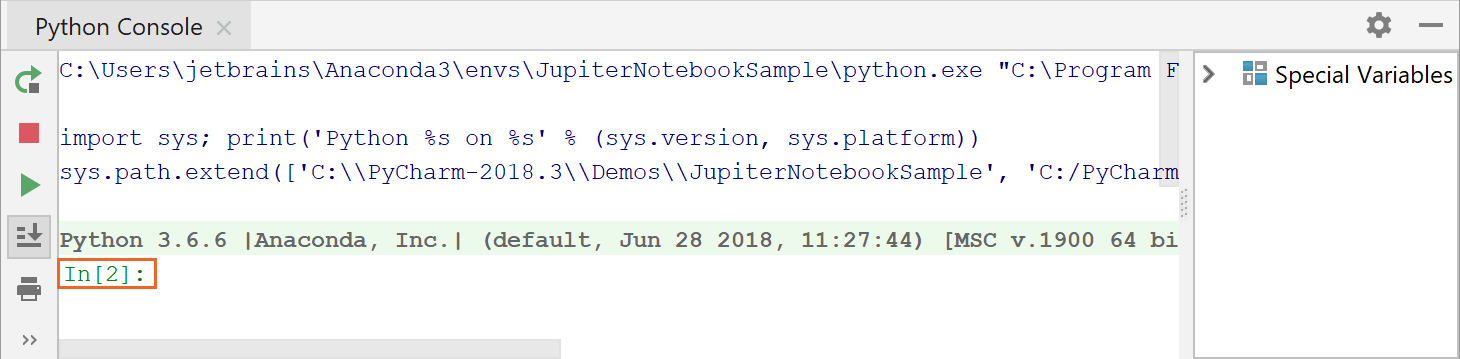

IPython.Shell是一个强大的交互式Python环境,它不仅提供了标准的Python解释器功能,还增加了一些交互式的扩展,使得数据处理和可视化变得更加高效。它支持丰富的魔法命令,这些命令能够极大地简化数据处理流程,特别是对于数据分析和科学计算来说,IPython.Shell是一个不可或缺的工具。

```python

# 导入必要的模块

import matplotlib.pyplot as plt

# 使用IPython.Shell的魔法命令来展示当前环境中的对象

%matplotlib inline

```

通过使用`%matplotlib inline`魔法命令,IPython.Shell可以让我们直接在Notebook中嵌入图形,而无需额外的代码来显示它们。

## 1.2 数据可视化的意义

数据可视化是数据分析的关键步骤之一,它能够将复杂的数据集通过图形的方式展示出来,使得数据的信息和模式一目了然。良好的数据可视化不仅能够帮助分析人员快速理解数据,还能够有效地向非技术人员传达复杂的信息。在IPython.Shell中,我们可以利用多种工具和魔法命令来创建各种各样的图表,从而实现数据的可视化。

```python

# 使用matplotlib绘制简单的折线图

x = [1, 2, 3, 4, 5]

y = [1, 4, 9, 16, 25]

plt.plot(x, y)

plt.title('Simple Plot')

plt.show()

```

通过这段代码,我们可以看到如何在IPython.Shell中使用matplotlib库绘制一个简单的折线图,这是数据可视化的一个基本例子。在后续章节中,我们将深入探讨如何使用IPython.Shell进行更高级的数据可视化操作。

# 2. 绘图魔法的理论基础

在本章节中,我们将深入探讨数据可视化的理论基础,以及如何在IPython.Shell环境中使用绘图魔法命令来实现各种图表。我们将从数据可视化的理论概念开始,逐步深入到IPython.Shell中的绘图工具,最后探讨数据类型的准备和处理。这一章节将为后续的实践和进阶应用打下坚实的基础。

## 2.1 数据可视化的理论概念

### 2.1.1 数据可视化的定义和重要性

数据可视化是将数据通过图形化的方式展示出来,以便人们能够更容易地理解和分析数据。它不仅能够揭示数据中的模式、趋势和异常,还能帮助人们在大量信息中迅速抓住关键点。在当今数据驱动的时代,数据可视化已成为数据分析、报告和决策过程中不可或缺的一部分。

通过本章节的介绍,我们将了解到数据可视化不仅仅是为了美观,更重要的是为了提高信息的传递效率和理解的深度。一个好的可视化能够将复杂的数据简化,使非专业人士也能快速把握数据的核心内容。

### 2.1.2 可视化设计的基本原则

在进行数据可视化时,有几个基本原则需要遵循:

1. **清晰性**:确保图表清晰易懂,避免过度装饰和混淆元素。

2. **准确性**:数据必须准确无误地反映在图表中,不夸大也不缩小。

3. **简洁性**:去除不必要的细节,突出关键信息。

4. **可比性**:在比较不同数据集时,确保视觉元素的一致性。

本章节将详细介绍如何应用这些原则来设计有效的可视化图表。

## 2.2 IPython.Shell中的绘图工具

### 2.2.1 IPython魔法命令概览

IPython.Shell提供了一系列的魔法命令,这些命令是IPython的内置功能,可以帮助用户更高效地进行数据处理和可视化的操作。在IPython.Shell中,以`%`符号开始的命令被称为魔法命令。例如,`%matplotlib`是一个用于设置matplotlib绘图环境的魔法命令。

本文将通过实例演示如何使用这些魔法命令来导入数据、设置绘图环境以及绘制基本图表。

### 2.2.2 绘图魔法命令的具体使用

IPython.Shell中的绘图魔法命令包括但不限于以下几种:

- `%matplotlib`:设置matplotlib绘图环境。

- `%load_ext`:加载扩展模块,如`%load_ext autoreload`自动重载模块。

- `%config`:配置IPython的内核设置。

例如,要使用matplotlib进行绘图,可以先通过`%matplotlib`魔法命令来设置绘图环境:

```python

%matplotlib inline

```

这行代码会让所有的matplotlib图表直接在Jupyter Notebook中显示。接下来,我们可以使用matplotlib的函数来绘制图表。

### 2.2.3 代码示例与逻辑分析

下面是一个使用matplotlib绘制简单图表的代码示例:

```python

import matplotlib.pyplot as plt

# 准备数据

x = [1, 2, 3, 4, 5]

y = [2, 4, 6, 8, 10]

# 绘制折线图

plt.plot(x, y)

plt.title('Simple Line Plot')

plt.xlabel('X Axis')

plt.ylabel('Y Axis')

plt.show()

```

在这段代码中,我们首先导入了matplotlib.pyplot模块,然后准备了x和y两个列表作为图表的数据源。`plt.plot(x, y)`函数用于绘制折线图,`plt.title`、`plt.xlabel`和`plt.ylabel`分别用于设置图表的标题和坐标轴标签。最后,`plt.show()`函数显示图表。

## 2.3 数据类型的准备和处理

### 2.3.1 数据的导入和整理

在进行数据可视化之前,需要将数据导入到Python环境中,并进行必要的整理。数据可以来自多种格式,如CSV、Excel文件等。我们可以使用pandas库中的`read_csv`和`read_excel`函数来导入这些数据。

例如,导入CSV文件的代码如下:

```python

import pandas as pd

# 导入CSV文件

data = pd.read_csv('data.csv')

```

### 2.3.2 数据清洗与预处理技巧

数据清洗是数据分析的重要步骤,包括处理缺失值、异常值、重复数据等。在数据可视化前,清洗和预处理数据可以确保图表的准确性和有效性。

以下是一个简单的数据清洗示例:

```python

# 处理缺失值

data = data.dropna()

# 处理重复数据

data = data.drop_duplicates()

# 处理异常值

# 假设异常值是超出平均值三个标准差的数据

mean = data['column'].mean()

std = data['column'].std()

data = data[(data['column'] >= mean - 3 * std) & (data['column'] <= mean + 3 * std)]

```

在本章节的介绍中,我们探讨了数据可视化的理论基础,包括定义、重要性、设计原则,以及在IPython.Shell中使用绘图魔法命令的具体方法。此外,我们还学习了如何导入、整理和清洗数据,为后续的可视化工作打下了坚实的基础。

在下一章节中,我们将进一步探讨基本绘图技巧的实践,包括常用图表的绘制、高级绘图功能的探索以及实际案例分析。这些内容将帮助读者将理论知识转化为实际操作技能,提高数据可视化的实践能力。

# 3. 基本绘图技巧的实践

## 3.1 常用图表的绘制与应用

在本章节中,我们将深入探讨如何使用IPython.Shell中的绘图魔法命令来绘制和应用基本图表,包括柱状图、折线图、饼图、散点图和箱型图。这些图表是数据可视化的基础,它们能够帮助我们快速理解数据的分布和趋势。

### 3.1.1 柱状图、折线图和饼图的绘制

首先,我们将学习如何绘制柱状图,这是展示离散数据分布的常用图表。柱状图能够清晰地显示各类别之间的数量差异。在IPython.Shell中,我们使用`%matplotlib`魔法命令来启用绘图功能,并使用`plt.bar()`函数来绘制柱状图。

```python

%matplotlib inline

import matplotlib.pyplot as plt

categories = ['Category A', 'Category B', 'Category C']

values = [23, 45, 56]

plt.bar(categories, values)

plt.title('Bar Chart Example')

plt.xlabel('Categories')

plt.ylabel('Values')

plt.show()

```

在上述代码中,我们首先导入了`matplotlib.pyplot`模块,并定义了类别和对应的值。然后,我们使用`plt.bar()`函数创建柱状图,并通过`plt.

0

0