人脸识别技术:安防领域的安全新守护神

发布时间: 2024-09-07 08:48:09 阅读量: 351 订阅数: 56

人脸识别技术在安防领域的实践应用.pdf

# 1. 人脸识别技术概述

在信息技术飞速发展的今天,人脸识别技术已经成为了安全认证、监控系统和人机交互中的重要工具。随着计算机视觉和深度学习技术的不断突破,人脸识别在准确性、速度和应用范围上都取得了显著进步。本章将为读者提供人脸识别技术的基础知识框架,介绍其定义、发展历程以及当前的应用状况,为接下来的深入探讨奠定基础。

人脸识别,简言之,是利用计算机分析人脸图像,从而识别或验证个人身份的过程。它依据人类脸上的独特特征,包括眼睛、鼻子、嘴巴、轮廓等,来实现个体的识别和区分。随着人工智能技术的成熟,这一技术已广泛应用于各种场景中,从手机解锁到机场安检,再到公共安全监控。

在历史演进中,人脸识别技术经历了从简单几何特征分析到利用深度学习提取高维特征的转变。尤其在最近几年,深度神经网络的引入极大地提高了识别的准确性和鲁棒性,但同时也带来了巨大的计算成本和隐私保护等新挑战。接下来的章节将详细探讨这些技术背后的原理和实现方法。

# 2. 人脸识别技术的理论基础

## 2.1 人脸识别技术的工作原理

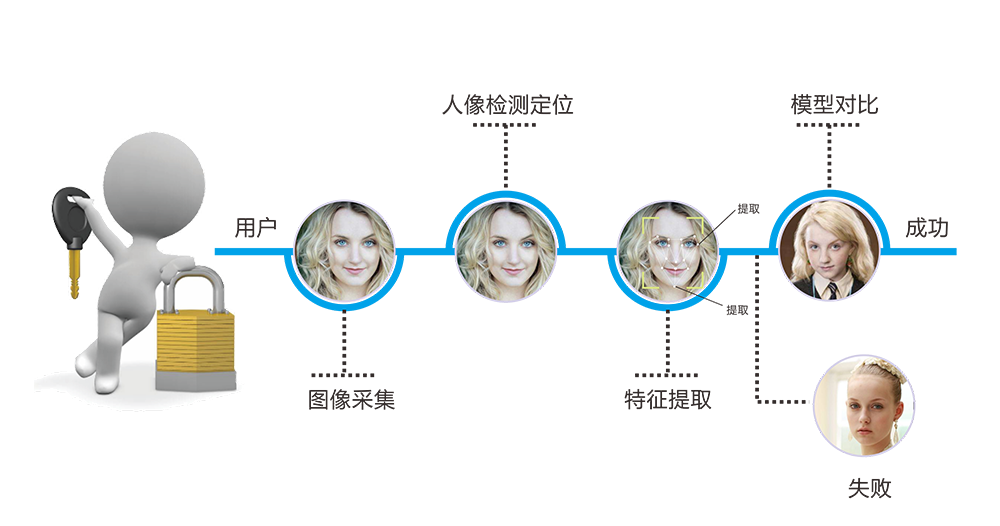

### 2.1.1 从图像采集到特征提取

在人脸识别技术中,从图像采集到特征提取是一个至关重要的步骤。首先,系统需要通过摄像头或其他图像捕获设备获取人脸图像。在获取图像之后,需要进行预处理,例如灰度转换、直方图均衡化、滤波去噪等操作,目的是为了提高图像质量,为后续的特征提取做好准备。

接下来是特征提取阶段,它是人脸识别系统能够准确识别个体的关键。在这个阶段,系统会根据特定的算法来识别和定位人脸的特征点,比如眼睛、鼻子、嘴巴等。这些特征点在数学上可以表示为特征向量,而这些特征向量能够以较低的维度描述人脸的几何结构和面部特征。

一个常用的特征提取方法是主成分分析(PCA),它能够将原始数据转换成一系列线性无关的特征向量,并且这些向量保留了数据集的最大方差信息。PCA能够减少数据的维度,同时保留最重要的变化信息,这对加速后续的匹配过程大有裨益。

```python

import cv2

import numpy as np

# 图像捕获

face_img = cv2.imread('face_image.jpg')

gray_img = cv2.cvtColor(face_img, cv2.COLOR_BGR2GRAY)

# 预处理

face_img_eq = cv2.equalizeHist(gray_img)

# 特征提取 - 使用 PCA

face_img_flat = face_img_eq.flatten().reshape(1, -1)

mean_face = np.mean(face_img_flat, axis=0)

eigfaces = np.load('eigfaces.npy')

face_sample = face_img_flat - mean_face

coeffs = np.dot(face_sample, eigfaces)

```

在上述的Python代码块中,使用了OpenCV库来处理图像,并进行了PCA处理。这里,首先将彩色图像转换为灰度图,然后执行直方图均衡化。最后,代码使用预先计算好的PCA基向量(存储在`eigfaces.npy`文件中)来提取特征。结果是`coeffs`变量,它包含了图像的主成分表示,这些成分能够用于后续的特征匹配和识别任务。

### 2.1.2 特征匹配与识别决策

特征提取之后,接下来的步骤是将提取的特征与数据库中存储的人脸特征进行匹配。数据库通常包含了目标用户的脸部特征向量和对应的标签,例如用户名或ID。匹配过程主要是通过计算相似度得分来完成,常用的相似度度量包括欧氏距离、余弦相似度等。

在确定了最相似的特征向量后,还需要一个决策机制来确认是否为同一个人。这可以通过设定一个阈值来完成,即只有当相似度得分超过这个阈值时,系统才会给出肯定的识别结果。否则,将返回无法识别或需要进一步验证的结果。

```python

import numpy as np

# 假设已知的特征向量和待识别的特征向量

known_face_features = np.array([0.1, 0.2, 0.3])

unknown_face_features = np.array([0.11, 0.21, 0.31])

# 计算欧氏距离

euclidean_distance = np.linalg.norm(unknown_face_features - known_face_features)

print(f"欧氏距离: {euclidean_distance}")

# 设定阈值

threshold = 0.05

# 识别决策

if euclidean_distance < threshold:

print("识别成功: 同一个人")

else:

print("识别失败: 不是同一个人或需要进一步验证")

```

在该代码示例中,我们模拟了特征匹配过程,并计算了两个特征向量之间的欧氏距离。根据预先设定的阈值,系统会做出是否为同一人的决策。如果距离小于阈值,表明两者足够相似,可以认为是同一人;如果距离大于阈值,则表明可能不是同一人,或者需要进一步的验证手段。

## 2.2 人脸识别算法的分类与比较

### 2.2.1 传统的人脸识别方法

传统的人脸识别方法主要依赖于几何特征、基于模型的方法以及一些统计分析方法。例如,几何特征方法侧重于提取人脸的几何结构信息,比如眼睛、鼻子和嘴巴的位置关系。基于模型的方法,如隐马尔可夫模型(HMM)或主动形状模型(ASM),则尝试建立面部特征的统计模型。

这些方法由于其对硬件的要求较低,较为容易实现,但它们在处理复杂变化的能力上有限,比如在不同光照条件或表情变化下的识别准确度。

```mermaid

graph LR

A[开始] --> B[图像预处理]

B --> C[特征提取]

C --> D[几何特征方法]

C --> E[基于模型的方法]

D --> F[决策]

E --> F[决策]

```

如上图所示,传统的几何特征和基于模型的方法最终都将特征数据应用于决策过程。这些方法通常较为直接,能够快速给出结果,但也正是因为其简单性,导致了它们在适应性和准确性方面具有一定的局限性。

### 2.2.2 深度学习在人脸识别中的应用

近年来,深度学习在人脸识别领域取得了巨大的成功。深度神经网络(DNNs)通过大量的训练数据可以学习到人脸图像的高级特征表示。卷积神经网络(CNNs)特别适合于图像相关的任务,它能够在图像中自动提取具有层级结构的特征,从而显著提高识别的准确率。

CNN在多个公开的人脸识别基准测试中都展示了超越传统方法的性能,特别是在处理不同的姿态、表情和光照条件等复杂场景下。深度学习模型的一个主要挑战是其需要大量的训练数据和强大的计算资源,但随着硬件性能的提升和大规模数据集的可用性,这些问题正在逐渐被克服。

```python

import tensorflow as tf

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, Flatten, Dense

# 构建简单的卷积神经网络

model = Sequential([

Conv2D(32, (3, 3), activation='relu', input_shape=(64, 64, 3)),

Conv2D(64, (3, 3), activation='relu'),

Flatten(),

Dense(128, activation='relu'),

Dense(1, activation='sigmoid')

])

***pile(optimizer='adam', loss='binary_crossentropy')

model.summary()

```

在上面的代码中,构建了一个简单的CNN模型,用于图像分类任务。虽然这是一个分类任务的示例,但相同的方法可以应用于人脸识别中的特征学习和分类任务。网络的每一层都在学习如何更好地表示图像数据,以便于在后续层中可以识别更高级的抽象模式。通过适当的训练,这个模型能够学习到复杂的人脸特征,从而在人脸识别任务中表现出色。

### 2.2.3 算法性能评估标准

在进行人脸识别算法的性能评估时,需要考虑多个指标来全面了解系统的性能。最常用的评估指标包括准确率、精确率、召回率、F1分数和ROC曲线下面积(AUC)。

- 准确率(Accuracy)是指正确识别的人脸数与总人脸数的比例。

- 精确率(Precision)是指被正确识别为某人的脸数与被识别为某人总次数的比例。

- 召回率(Recall)是指被正确识别为某人的脸数与实际为某人的脸总数的比例。

- F1分数是精确率和召回率的调和平均数,它提供了一个综合性能指标。

- AUC是ROC曲线下的面积,表示在不同的阈值下识别正确率与误识率之间的平衡能力。

这些指标能够帮助研究人员和开发者了解算法在不同方面的表现,并且优化算法以达到更高的性能。为了进行性能评估,通常需要准备一个包含已知标签的测试集,并运行算法来评估识别结果。

```python

from sklearn.metrics import accuracy_score, precision_score, recall_score, f1_score

# 假设真实标签和预测标签

true_labels = [1, 0, 1, 1, 0, 1]

predicted_labels = [1, 0, 1, 0, 0, 1]

# 计算性能指标

accuracy = accuracy_score(true_labels, predicted_labels)

precision = precision_score(true_labels, predicted_labels)

recall = recall_score(true_labels, predicted_labels)

f1 = f1_score(true_labels, predicted_labels)

print(f"准确率: {accuracy}")

print(f"精确率: {precision}")

print(f"召回率: {recall}")

print(f"F1分数: {f1}")

```

在该代码示例中,使用了`sklearn.metrics`库来计算了四种性能指标。通过真实标签与预测标签的对比,我们可以得到算法在特定数据集上的性能表现。通过分析这些指标,开发者可以对算法进行调整,以达到更好的识别效果。

# 3. 人脸识别技术实践应用

人脸识别技术已经从理论研究走向了实际应用,成为当今世界中一个不可或缺的技术领域。本章重点分析和讨论了如何将人脸识别技术应用在现实世界的具体场景中,并对应用场景中的实施步骤进行详细的讲解。

## 3.1 人脸识别系统的部署

### 3.1.1 硬件设备的选择与配置

在部署一个实用的人脸识别系统之前,选择合适的硬件设备是至关重要的一步。通常,一套基本的人脸识别系统硬件包括摄像头、服务器和显示设备。摄像头用来捕获图像,服务器进行图像处理和识别决策,显示设备则用于展示实时的监控画面或识别结果。

在选择摄像头时,不仅要关注其像素和分辨率,更要重视其能够在低光环境或不同光照条件下正常工作。一些设备专门针对人脸识别优化,配备了IR(红外)照明,以提高夜间或光线不足场景下的性能。

服务器的配置需要根据预期处理的数据量和实时性要求来定。高并发的场景下,建议使用具有高性能CPU和GPU的服务器,以便能够快速处理大量数据和运行深度学习模型。

### 3.1.2 软件框架搭建与集成

软件框架的搭建主要包括操作系统的选择、开发库的配置和算法模型的集成。操作系统推荐使用稳定性和兼容性较好的Linux发行版。在搭建软件框架时,需要安装一些必备的开发工具和库,例如OpenCV、Dlib、TensorFlow或PyTorch等,它们在图像处理和人脸识别算法中常被用到。

集成算法模型时,对于使用深度学习方法的人脸识别系统,开发者可能需要先训练一个适合自己需求的模型或者使用开源的预训练模型。集成模型后,需要对整个系统进行性能调优,确保它能在不同的操作环境和不同的硬件配置下稳定运行。

## 3.2 人脸识别技术在安防领域的应用实例

### 3.2.1 访问控制系统

人脸识别技术在访问控制系统中可以提供一种方便、快捷且难以伪造的验证方式。传统的身份验证方法,如磁卡或密码,容易丢失、遗忘或被他人获取,而使用人脸识别技术后,用户只需要自然地接近验证设备即可完成身份验证。

在实现时,访问控制系统通常包含一个摄像头和人脸识别模块。当用户走近时,摄像头捕获图像,并将其发送到后端服务器。服务器使用人脸检测和识别算法对图像进行处理,并将识别结果与数据库中存储的已注册用户信息进行比对,从而验证用户身份。

### 3.2.2 视频监控与分析

视频监控是安防领域中的传统应用,结合了人脸识别技术后,视频监控系统可以从被动记录发展到主动分析。通过实时监控视频流中的人脸并进行识别,系统能够快速发现黑名单人物或异常行为。

这一应用的关键在于视频中人脸的准确检测和追踪。为此,系统需要集成高效的实时人脸检测算法,并在检测到人脸后,通过人脸识别算法进行身份确认。同时,为了提高效率和准确性,系统还可以结合其他信息,如衣着、行为特征或使用GPS等数据。

### 3.2.3 人员追踪与行为分析

在复杂的场景中,如机场、火车站和商场等,人员追踪和行为分析对于维护公共安全起着关键作用。基于人脸识别技术的系统可以通过对人员身份的识别和追踪,辅助安全人员进行高效的人群管理和突发事件响应。

实现人员追踪通常需要将识别到的个体与特定的空间地图进行融合。这涉及到复杂的计算机视觉技术,比如多摄像头的协同工作和空间定位算法。行为分析则需要在人脸识别的基础上,进一步利用行为识别算法来分析个体的行为模式,比如检测是否有奔跑、打斗等异常行为。

### 代码块和逻辑分析

下面展示一个使用OpenCV和face_recognition库进行简单人脸检测和识别的Python代码示例。`face_recognition`是一个简单易用的人脸处理库,它封装了深度学习模型和相关的图像处理功能。

```python

import cv2

import face_recognition

# 加载图片并识别人脸

image = face_recognition.load_image_file("test.jpg")

face_locations = face_recognition.face_locations(image)

# 仅为人脸检测,如果需要识别人脸还需要进行下一步的人脸编码

# face_encodings(image)

# 打印检测到的人脸位置

for top, right, bottom, left in face_locations:

print("A face is located at pixel location Top: {}, Left: {}, Bottom: {}, Right: {}".format(top, left, bottom, right))

# 显示图片

image = cv2.imread("test.jpg")

for top, right, bottom, left in face_locations:

cv2.rectangle(image, (left, top), (right, bottom), (0, 0, 255), 2)

cv2.imshow('Face Detection', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

在这段代码中,首先使用`face_recognition.load_image_file`函数加载待检测的人脸图片。`face_locations`函数根据图片中的特征找到人脸位置,并返回每张人脸的位置数据。之后,代码通过循环打印出每张人脸的位置,并使用`cv2.rectangle`函数在图片上用红色矩形框出人脸。最后,显示图片,并等待任意按键后关闭窗口和释放资源。

### 表格

| 人脸识别应用 | 关键技术 | 使用场景 | 潜在挑战 |

|--------------|----------|----------|----------|

| 访问控制 | 实时人脸检测、人脸比对 | 门禁系统、登录验证 | 光照变化、表情差异 |

| 视频监控 | 实时人脸追踪、异常行为检测 | 公共场所安全监控 | 高并发处理、数据隐私 |

| 行为分析 | 多人追踪、行为模式识别 | 交通管理、人群控制 | 人群密度、遮挡问题 |

通过表格形式,我们可以对人脸识别技术在不同应用中的关键技术和使用场景进行对比,并指出每个场景可能面临的挑战。

### mermaid 流程图

下面是一个关于人脸检测的简单流程图:

```mermaid

graph LR

A[开始] --> B[加载图片]

B --> C{人脸检测}

C -- 检测到人脸 --> D[标记人脸位置]

C -- 未检测到人脸 --> E[结束]

D --> F[显示带标记的图片]

F --> G[等待用户操作]

G --> H[结束]

```

该流程图描述了从加载图片开始,到进行人脸检测,再到标记和显示结果,最后等待用户操作的整个过程。通过这样的流程图,可以更加直观地理解人脸检测技术在实际应用中的一系列操作步骤。

# 4. 人脸识别技术的挑战与未来展望

人脸识别技术以其非接触性、易于使用等优点在各个领域得到了广泛的应用,然而,随着技术的发展与应用的深入,人脸识别技术也面临着不少挑战。在本章中,我们将深入探讨这些挑战,并对未来的发展趋势进行展望。

## 4.1 面临的技术挑战与解决方案

### 4.1.1 环境因素对识别准确率的影响

人脸识别技术在不同的环境条件下会有不同的性能表现。光照、角度、遮挡等环境因素都会影响识别的准确性。例如,低光照环境或极端天气条件下的图像质量较差,可能会导致人脸识别系统无法准确提取特征点,进而降低识别率。

#### 环境因素的解决方案:

为了解决环境因素对人脸识别准确性的影响,研究者和工程师采取了以下几种方法:

1. **增强型算法**:通过深度学习中的对抗网络或生成对抗网络(GANs)来模拟不同环境下的图像,并训练模型以增强其鲁棒性。

```python

# 以下代码为GANs中生成器的简化示例

from keras.models import Sequential

from keras.layers import Dense, Conv2D, LeakyReLU, BatchNormalization

model = Sequential()

model.add(Dense(128, input_dim=100)) # 输入噪声向量

model.add(LeakyReLU(alpha=0.01))

# ... 后续的卷积层、池化层等

```

这段代码是生成对抗网络生成器部分的一个简化示例,实际应用中会更为复杂。

2. **多光源适应性**:在识别系统中加入可调光或多种光源,以适应不同的光照环境。

3. **特征融合**:结合多种特征(如颜色、纹理、深度等),进行融合识别。

### 4.1.2 数据隐私与安全问题

随着人脸识别技术的普及,数据隐私和安全问题成为公众最为关心的问题之一。人脸识别系统可能会收集到大量敏感的个人生物识别信息,一旦泄露,可能会造成不可估量的损失。

#### 数据隐私与安全问题的解决方案:

1. **加密技术**:对存储和传输的人脸数据进行加密处理,确保数据安全。

```python

# 一个简单的加密算法示例

import hashlib

def encrypt(password):

password_hash = hashlib.sha256(password.encode()).hexdigest()

return password_hash

```

2. **匿名化处理**:对识别结果进行匿名化处理,不直接存储个人的生物识别信息。

3. **合规性遵循**:确保人脸识别技术的应用遵守相关法律法规,比如欧盟的通用数据保护条例(GDPR)。

## 4.2 人脸识别技术的法律与伦理考量

### 4.2.1 法律法规的制定与执行

随着人脸识别技术的广泛应用,法律和法规也在不断更新,以规范其应用。不同国家和地区对人脸识别技术的法律规定不同,企业和社会各界需要遵循相应的法律法规,以保证技术的合理与合规使用。

#### 法律法规的制定与执行:

1. **合理使用原则**:在公共安全、商业等领域合理使用人脸识别技术,同时确保个人隐私不被侵犯。

2. **公民教育**:提高公众对人脸识别技术的认识,教育公众如何保护自己的生物识别信息安全。

### 4.2.2 伦理问题与公众接受度

人脸识别技术在提高效率的同时,也引发了一系列伦理问题。其中,公众接受度成为技术推广的关键因素。

#### 伦理问题与公众接受度:

1. **透明度**:企业或政府机构应当对人脸识别技术的使用目的、使用范围等信息向公众进行透明公开。

2. **公众参与**:在制定与执行相关技术政策时,应积极听取公众意见,建立公众参与机制。

## 4.3 人脸识别技术的发展趋势

### 4.3.1 跨模态识别与融合技术

跨模态识别是指结合不同类型的数据进行身份验证,比如结合人脸和指纹、虹膜等信息进行更为准确的识别。这种方法可以显著提高识别的准确性,并增强系统的安全性。

#### 跨模态识别与融合技术:

1. **多模态学习算法**:研究并开发能够有效处理和融合不同类型生物特征数据的算法。

2. **融合策略**:探讨并实施不同生物特征数据融合的策略,如早期融合、晚期融合等。

### 4.3.2 边缘计算与实时处理

边缘计算是指将数据处理、分析等任务在数据源附近完成,从而减少对中心服务器的依赖。对于人脸识别技术而言,边缘计算可以实现实时的快速处理。

#### 边缘计算与实时处理:

1. **优化算法**:针对边缘设备进行算法优化,实现低延迟和高准确性的实时处理。

2. **硬件加速**:采用专用的硬件加速器,如GPU、TPU等,以支持在边缘端进行深度学习计算。

## 本章小结

在本章中,我们探讨了人脸识别技术面临的挑战,并对可能的解决方案进行了讨论。同时,我们也讨论了人脸识别技术的法律和伦理问题,并展望了技术的发展趋势。随着技术的不断发展,人脸识别技术必将在未来的社会生活中扮演更加重要的角色。

请注意,以上内容仅展示了第四章的一部分结构化内容。在实际文章中,每个二级章节需要根据具体要求展开到足够的字数,并且每个部分都应包含必要的代码示例、表格、mermaid流程图等元素。

# 5. 人脸识别技术案例研究

人脸识别技术已经广泛应用于多个行业,从安保、金融到零售业。本章节中,我们将分析一些具有代表性的成功与失败案例,深入探究其背景、实施过程、遇到的问题、解决方案以及影响因素。

## 5.1 成功案例分析

### 5.1.1 案例背景与实施过程

在探讨成功案例前,我们首先要理解成功案例的背景。一个典型的成功案例是某大型银行使用人脸识别技术来提升客户服务体验并加强安全验证。在实施过程中,银行首先进行了市场调研,与技术供应商合作,确定了软硬件需求。接着,通过定制开发和集成,构建了一个能够在柜台和自助服务终端上使用的人脸识别系统。

#### 案例背景

该银行的目标是减少柜台交易时间,同时提高安全性,减少欺诈行为。该银行选择了基于深度学习的人脸识别算法,因其识别准确率高,适应性强。

#### 实施步骤

1. 需求分析:确定系统应具备的功能与性能指标。

2. 技术选型:选择适合的硬件设备和软件框架。

3. 系统开发:进行定制化开发和第三方服务集成。

4. 测试验证:进行模拟测试,评估系统性能。

5. 部署上线:在部分分行试运行,根据反馈进行调整优化。

6. 全面推广:完成调试后,在所有分行推广部署。

### 5.1.2 技术实施效果与用户反馈

该银行实施人脸识别系统后,客户平均办理业务时间减少了30%,排队等待时间也显著下降。安全性能提升表现在尝试欺诈的案例减少,交易的准确性提高。用户反馈普遍正面,客户对通过人脸识别快速完成身份验证的方式感到满意。

#### 效果评估

- 识别准确率:通过大量样本测试,验证了系统的高准确率。

- 系统稳定性:评估系统长期运行的稳定性和可靠性。

- 用户体验:通过问卷调查,了解用户对系统的接受度和满意度。

#### 用户反馈

收集到的用户反馈显示,人脸识别技术的应用极大提高了用户办理业务的效率。同时,用户对系统的安全性也给予了一致的好评。

## 5.2 失败案例分析

人脸识别技术的成功应用案例固然鼓舞人心,然而,一些失败的案例也能给我们提供宝贵的教训。下面将介绍一个失败案例,并探讨问题的根源及解决方案。

### 5.2.1 遇到的问题与解决方案

在某城市的一次智能安全门禁系统试点项目中,尽管前期准备充分,人脸识别系统在部署后不久就遇到了识别准确率低下,尤其是在夜间和低光照条件下,表现不佳的问题。问题的根源在于光照条件的不稳定性与算法的适应性。

#### 问题分析

- 环境光照:在光照条件极端的情况下,系统无法准确识别人脸特征。

- 数据集偏差:训练数据没有充分覆盖所有可能的光照条件。

- 算法适应性:使用的算法未能在多变环境中保持高效。

#### 解决方案

为解决这些问题,项目团队采取了以下措施:

1. 优化硬件:引入了适应各种光照条件的红外摄像头。

2. 数据增强:增加了各种光照条件下的训练数据。

3. 算法改进:更换并训练了能够适应不同光照条件的深度学习模型。

4. 持续迭代:定期收集用户反馈和系统日志,不断迭代优化算法。

### 5.2.2 教训与未来改进方向

从这个失败案例中,我们可以得到一些重要的教训。首先,充分的市场调研和多变环境下的数据预处理是非常重要的。其次,选对技术和算法,并在实际部署前进行充分测试也同样重要。

#### 教训总结

- 前期调研:深入分析应用环境,包括光照、人群密度等因素。

- 算法选择:根据实际需求选择合适的人脸识别技术。

- 系统测试:在真实场景中进行测试,确保系统稳定性与准确性。

#### 未来改进方向

- 模型的持续更新:根据实际场景不断优化模型,保持其准确度和鲁棒性。

- 技术的融合应用:结合其他生物识别技术,如指纹识别或虹膜识别,以增强系统性能。

- 用户体验的设计:不断迭代产品设计,使之更加符合用户的实际使用习惯。

人脸识别技术案例研究的分析不仅帮助我们理解了技术的实际应用,而且揭示了项目成功与失败的关键因素。通过对这些案例的深入分析,我们可以更好地理解人脸识别技术的应用前景及其优化方向。

# 6. 人脸识别技术的实战演练

在深入研究人脸识别技术的理论和应用后,我们现在将把学到的知识应用到实践中。本章旨在通过实战演练,让读者能够亲身体验并掌握如何使用人脸识别技术。我们将会从环境搭建开始,然后进入编码和测试阶段,最终实现一个简单的人脸识别系统。

## 6.1 实战准备:工具与环境搭建

### 6.1.1 开发环境的配置

首先,我们需要搭建一个适合人脸识别项目开发的环境。对于初学者而言,Python是一个非常合适的选择,因为它有着丰富的库支持,例如OpenCV和dlib,这些都是进行人脸识别时常用到的库。

1. 安装Python:访问Python官网下载并安装适合你的操作系统的Python版本。

2. 配置IDE:选择一个你喜欢的集成开发环境(IDE),如PyCharm、VS Code等,并进行基本配置。

3. 安装依赖库:打开命令行工具,使用pip安装OpenCV、dlib以及其他必要的库。

```bash

pip install opencv-python

pip install dlib

```

4. 验证安装:创建一个新的Python文件,导入安装的库,确保没有出现错误。

```python

import cv2

import dlib

```

### 6.1.2 库和框架的选择

对于人脸识别项目,除了基本的Python环境和开发工具外,还需要选择合适的人脸识别库和框架。OpenCV是一个强大的计算机视觉库,它提供了大量的图像处理和分析的函数。dlib库中包含了一个优秀的人脸检测器和人脸识别模型,能够快速准确地进行人脸检测和识别。

在安装了必要的库之后,我们可以准备一个简单的图像文件来测试人脸检测功能。

## 6.2 实战演练:编码与测试

### 6.2.1 编写人脸识别代码

现在,让我们开始编写一些基本的人脸识别代码。我们将使用dlib提供的预训练模型进行人脸检测,然后使用OpenCV显示检测结果。

```python

import cv2

import dlib

# 初始化dlib的人脸检测器

detector = dlib.get_frontal_face_detector()

# 使用OpenCV读取图片

image = cv2.imread('path_to_image.jpg')

# 将图片转换为灰度图

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 使用检测器检测灰度图中的人脸

faces = detector(gray_image)

# 在检测到的人脸周围画框

for (i, rect) in enumerate(faces):

x = rect.left()

y = ***()

x1 = rect.right()

y1 = rect.bottom()

# 画出人脸边框

cv2.rectangle(image, (x, y), (x1, y1), (0, 255, 0), 2)

# 显示图片

cv2.imshow('Image', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

在上述代码中,我们首先导入了必要的库,然后加载了一个图像文件,并将其转换为灰度图。接着,我们使用dlib的检测器找到图像中的人脸,并使用OpenCV在找到的人脸周围绘制绿色边框。

### 6.2.2 系统测试与性能调优

完成代码编写后,接下来是系统测试和性能调优。在测试阶段,我们可以使用不同的图像来验证代码的鲁棒性。需要注意的是,真实环境中会遇到各种复杂的场景,因此测试时需要尽可能模拟这些情况。

系统调优包括两个方面:首先是调整人脸识别算法的参数,以适应不同的使用环境和性能要求。其次是优化代码执行效率,比如通过使用更高效的图像处理算法或利用并行计算技术来加快处理速度。

以上步骤完成后,我们就能够得到一个基本的人脸识别系统,并且具备了进行进一步优化和开发的基础。

## 总结

在本章中,我们学习了如何搭建人脸识别技术的开发环境,并亲自编写了人脸检测的代码。通过实战演练,我们对人脸识别技术有了更直观的理解,并为后续的深入学习和开发打下了基础。在第七章,我们将深入探讨人脸识别技术的优化策略和实现高效部署的关键因素。

0

0