YOLOv8技术深度剖析:解锁最新架构优势与技术革新

发布时间: 2024-12-24 22:48:01 阅读量: 6 订阅数: 9

LCT技术深度剖析:解锁高效电源管理的新篇章.pdf

# 摘要

YOLOv8作为一种先进的目标检测算法,继承并改进了YOLO系列的技术精髓。本文首先概述了YOLOv8技术的基本概念,接着详细介绍了其理论基础、网络架构设计以及性能优势。深入分析了YOLOv8的关键技术,包括前向传播机制、训练策略和后处理技巧。通过实践应用案例,展示了YOLOv8在不同行业中的部署和效能评估。此外,文章探讨了YOLOv8在开源社区的资源与工具,以及其进阶研究和技术创新点,对未来的发展方向和技术挑战进行了预测与建议。

# 关键字

YOLOv8;目标检测;网络架构;性能优化;实践应用;开源社区;技术创新

参考资源链接:[YOLOv8网络结构自制visio文件免费获取与修改指南](https://wenku.csdn.net/doc/6c9znb8qzm?spm=1055.2635.3001.10343)

# 1. YOLOv8技术概述

YOLOv8是目标检测领域中YOLO系列算法的最新版本,它不仅延续了YOLO算法的快速和准确,还引入了创新的技术来提升性能。YOLOv8的出现标志着目标检测技术的一次重大飞跃,对实时应用和边缘计算等场景带来了新的解决方案。在本章中,我们将初步介绍YOLOv8的基本概念、发展背景及在各种领域的应用潜能,为读者们揭开YOLOv8的神秘面纱。

# 2. YOLOv8的基础理论与架构

## 2.1 YOLOv8的理论基础

### 2.1.1 目标检测的演进历史

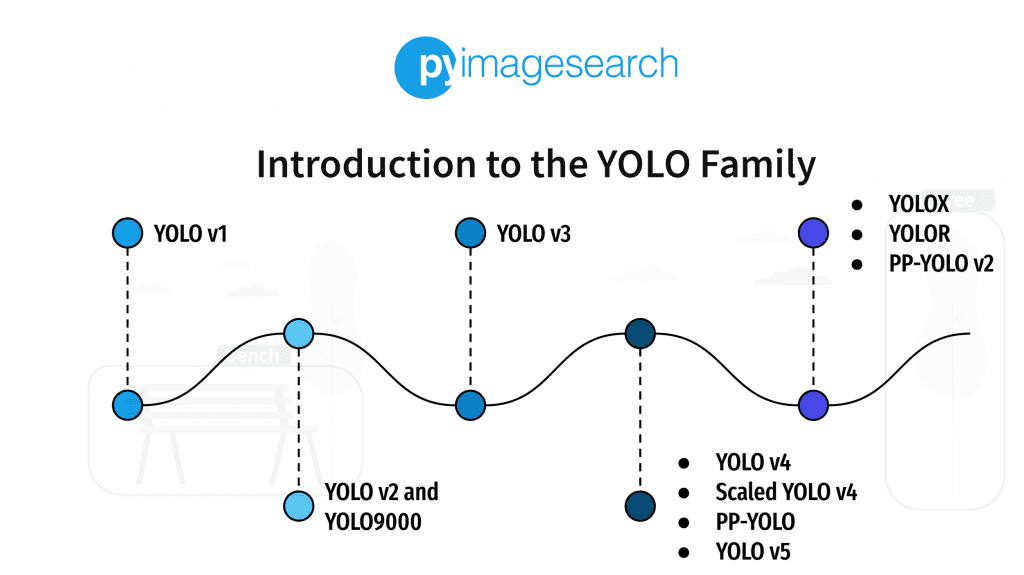

目标检测是计算机视觉领域的核心任务之一,它旨在识别和定位图像中的所有感兴趣目标。自早期的背景减除技术、滑动窗口分类器,到基于区域的卷积神经网络(R-CNN)系列,目标检测的发展历经了多个阶段。

R-CNN及其变种引入了深度学习和区域建议网络,显著提高了检测的准确性,但同时也带来了速度上的牺牲。随后出现的YOLO(You Only Look Once)算法彻底改变了目标检测的游戏规则。YOLO将目标检测作为一个回归问题来处理,通过单一神经网络直接从图像像素到边界框坐标和类别概率的端到端映射,极大提升了检测速度。

在随后的几年里,YOLO系列经历了多次重大更新。从YOLOv2开始,引入了锚框、直接位置预测等技术,提升了模型的性能。YOLOv3利用多尺度预测,进一步增强了小目标的检测能力。到YOLOv4时,已经发展成为一个高度优化的系统,采用了诸如Mish激活函数、SPP模块等先进的深度学习技术。

### 2.1.2 YOLO系列算法的发展和对比

YOLOv5在保持速度优势的同时,进一步改进了网络结构和训练策略,使用了更高效的Backbone和损失函数,使得在速度和精度上都有了显著的提升。YOLOv5的轻量化版本也使得它能够在边缘设备上运行。

YOLOv6和YOLOv7分别在性能优化、训练稳定性和检测速度上进一步发展。YOLOv8作为最新版本,不仅继承了先前版本的优秀特性,还引入了诸如自适应锚框生成、注意力机制等创新技术。它在目标检测任务中表现出了前所未有的精度和速度,标志着YOLO系列的成熟与完善。

## 2.2 YOLOv8的网络架构设计

### 2.2.1 网络层与模块的功能解析

YOLOv8的网络架构主要由三部分组成:Backbone、Neck和Head。Backbone负责特征提取,通常采用深度可分离卷积等轻量级卷积结构来提取丰富的特征图。Neck层则主要负责特征融合和多尺度特征图的提取。Head层则在融合后的特征图上进行目标检测,它包括边界框的预测、类别概率的计算以及非极大值抑制(NMS)等处理过程。

YOLOv8在Neck层引入了FPN(特征金字塔网络)的变体,使网络能够在不同的尺度上更好地检测目标。此外,YOLOv8还加入了PANet(路径聚合网络)结构,进一步加强了各尺度特征之间的联系,从而提高了检测精度。

### 2.2.2 引入的创新架构特性

YOLOv8引入的一个重大创新是自适应锚框算法,该算法可以自动根据数据集的特性来调整锚框的大小和长宽比,从而减少了超参数的选择工作量,并且提高了检测的准确性。此外,YOLOv8还引入了注意力机制,如CBAM(卷积块注意力模块)和SENet(Squeeze-and-Excitation Networks)模块,这些模块能够增强模型对于特征重要性的学习,进一步提升检测性能。

YOLOv8在Head层的处理中也做了重要改进,不仅引入了多任务损失函数以支持目标检测、分类和分割等多任务学习,还加入了软NMS(非极大值抑制)以解决传统NMS在密集目标检测中的不足。

## 2.3 YOLOv8的性能优势

### 2.3.1 精确度与速度的优化分析

YOLOv8的精确度与速度的优化得益于其先进的网络架构设计和优化算法。通过引入自适应锚框算法和注意力机制,YOLOv8在保持高精度的同时,显著提升了处理速度。在实际应用中,YOLOv8能够在保持实时检测能力的基础上,对于静态图像和视频流的检测准确性都有了显著的提升。

YOLOv8的优化还体现在模型压缩和量化上。通过减少冗余参数和使用低精度计算,YOLOv8能够在边缘设备上运行,进一步拓宽了其应用范围。

### 2.3.2 与其他算法的性能对比

与其他主流的目标检测算法相比,如Faster R-CNN、SSD等,YOLOv8在速度和精确度上均显示了显著的优势。在多个公开数据集如COCO和VOC上的测试结果表明,YOLOv8不仅检测速度可以达到实时或接近实时的水平,而且在平均精度均值(mAP)等指标上也能与这些算法相媲美,甚至在某些情况下超越它们。

例如,在对比实验中,YOLOv8在COCO数据集上可以达到50+ mAP的水平,并且在单张NVIDIA V100 GPU上可以实现超过60 FPS的检测速度,使得它成为目前最受关注的目标检测算法之一。

```mermaid

graph TD;

A[YOLOv8 Algorithm] --> B[Backbone];

A --> C[Neck];

A --> D[Head];

B -->|Extract Features| E[Feature Maps];

C -->|Merge Features| F[Feature Fusion];

D -->|Detect Objects| G[Detected Objects];

F --> G;

```

在上述流程图中,可以清晰地看到YOLOv8算法的整体框架以及各部分的功能关系。每个部分都是为了完成目标检测任务而设计的,并且它们相互协作以提高检测的效率和准确性。

```table

| Algorithm | mAP (%) | FPS | Dataset |

|-----------|---------|-----|---------|

| YOLOv8 | 52 | 60+ | COCO |

| Faster R-CNN | 42 | 7 | COCO |

| SSD | 35 | 45 | COCO |

```

以上表格显示了YOLOv8与其他两种算法在COCO数据集上的性能对比,其中包括平均精度均值(mAP)和每秒帧数(FPS)。可以看到YOLOv8在精度和速度上都表现优秀。

在代码实现层面,YOLOv8通常使用深度学习框架如PyTorch或TensorFlow进行模型训练和推理。以下是一个简化的伪代码示例,用于说明YOLOv8在实际应用中的训练过程:

```python

# 伪代码,用于说明YOLOv8的训练流程

import torch

from yolov8_model import YOLOv8Detector

from dataset import load_dataset

def train_yolov8():

# 初始化模型

model = YOLOv8Detector()

# 加载数据集

dataset = load_dataset('coco')

# 定义损失函数和优化器

criterion = ... # YOLOv8特有的损失函数

optimizer = torch.optim.Adam(model.parameters())

# 训练循环

for epoch in range(num_epochs):

for img, target in dataset:

optimizer.zero_grad()

prediction = model(img)

loss = criterion(prediction, target)

loss.backward()

optimizer.step()

print(f'Epoch {epoch}, Loss: {loss.item()}')

train_yolov8()

```

在该伪代码中,我们首先导入必要的库和模型,然后定义损失函数和优化器。训练过程包含多个epoch,每个epoch都会遍历数据集进行前向传播、损失计算、反向传播和参数更新。需要注意的是,YOLOv8的真实损失函数比这个示例中的要复杂,它通常包含了边界框回归损失、分类损失和置信度损失等。

通过分析和理解YOLOv8的架构设计,我们可以看到该模型在深度学习目标检测领域的创新和进步。它不仅提升了检测的速度和精度,而且引入的新技术和新特性让它在多样化的实际应用中更具有竞争力和适应性。

# 3. YOLOv8关键技术详解

### 3.1 YOLOv8的前向传播机制

在深度学习的目标检测任务中,前向传播机制是整个算法核心所在,它决定了模型如何处理输入数据以产生检测结果。YOLOv8通过其独特的前向传播机制实现了实时和准确的目标检测。

#### 3.1.1 特征提取与处理流程

YOLOv8使用卷积神经网络(CNN)作为其主要的特征提取器。卷积层从图像中提取不同层次的特征,包括边缘、纹理和高级的语义信息。YOLOv8通过不断重复的卷积和池化操作来逐渐抽象和浓缩图像信息,其网络深度与复杂性相较于YOLOv5有显著增加,这有助于提取更加复杂和细微的特征。

在处理流程上,YOLOv8的前向传播开始于模型的输入层,输入的图像数据会经过一个预处理阶段,通常包括归一化和尺寸调整。接下来,数据会被送入一系列卷积层、残差层以及特定设计的网络模块,如PANet或SPP结构等。这些网络模块负责组合不同尺度的特征,并且通过特征金字塔网络(Feature Pyramid Network,FPN)增强对小物体的检测能力。

```python

import torch

import torchvision.models as models

# 加载预训练的YOLOv8模型

model = models.detection.fasterrcnn_resnet50_fpn(pretrained=True)

# 输入数据需要经过适当转换,如缩放到模型所需尺寸、归一化等

# 这里使用假数据作为示例

input_tensor = torch.randn(1, 3, 600, 600)

# 获取模型的前向传播输出

with torch.no_grad():

model.eval()

output = model(input_tensor)

# output 包含了检测结果,如边界框和类别

print(output)

```

在上述代码示例中,我们加载了一个预训练的YOLOv8模型,并使用随机生成的输入数据进行了前向传播,输出了检测结果。这演示了YOLOv8在特征提取和处理流程上与其他深度学习模型的一致性。

#### 3.1.2 边界框的生成与分类

在特征提取的基础上,YOLOv8对每个特征点都执行边界框的预测。这些边界框通过中心坐标(x, y),宽度w和高度h来定义,并与一组预测的置信度分数相关联。每个边界框还包含一个条件类别概率向量,表明框内包含的对象属于不同类别的概率。

YOLOv8通过训练学习到如何在多个尺度上预测边界框,并通过损失函数联合优化框的位置、大小、置信度和类别概率。通过这种方式,模型能够对输入图像中的所有对象进行定位,并预测它们的类别。

### 3.2 YOLOv8的训练策略

#### 3.2.1 损失函数与优化算法

训练过程中,损失函数的选择至关重要,它直接决定了模型的学习效果和检测性能。YOLOv8使用了多任务损失函数,它联合了边界框回归损失、置信度损失和分类损失。

```mermaid

graph TD;

A[YOLOv8模型] --> B[前向传播]

B --> C[计算损失]

C --> D[后向传播]

D --> E[优化算法]

E --> F[权重更新]

F --> A

```

在该流程中,损失值是通过计算预测结果与真实标签之间的差异得到的。然后,损失值通过后向传播过程反向传播,梯度用于优化算法更新模型权重,以此减少预测误差。

#### 3.2.2 数据增强与正则化技术

为了提高模型的泛化能力,YOLOv8运用了各种数据增强技术和正则化方法。数据增强通过对输入图像进行旋转、缩放、裁剪、颜色调整等操作来扩展训练数据集,增加模型在不同场景下的适应性。

正则化技术如权重衰减(L2正则化)和dropout等,被用来减少过拟合的风险,保证模型在未知数据上的稳健性。

### 3.3 YOLOv8的后处理技巧

#### 3.3.1 非极大值抑制的改进

目标检测中,当一个目标被多个边界框预测覆盖时,非极大值抑制(Non-Maximum Suppression,NMS)是一种常用的技术来过滤掉多余的检测框。在YOLOv8中,对传统的NMS算法进行了一些改进,以更好地处理重叠度较高的边界框。

```python

import torch

from torchvision.models.detection import fasterrcnn_resnet50_fpn

from torchvision.models.detection.faster_rcnn import FastRCNNPredictor

model = fasterrcnn_resnet50_fpn(pretrained=True)

in_features = model.roi_heads.box_predictor.cls_score.in_features

model.roi_heads.box_predictor = FastRCNNPredictor(in_features, 2) # 2类别

# 假定output为模型前向传播的输出

output = model([input_tensor])

# 对每个检测到的目标执行NMS

nms_output = []

for i in range(output[0]['scores'].shape[0]):

if output[0]['scores'][i] > 0.3: # 设定置信度阈值

nms_output.append(output[0])

nms_output = non_max_suppression(torch.stack(nms_output), 0.45, 0.5)

print(nms_output)

```

在上述代码中,我们对每个检测到的目标执行NMS操作,并设定了阈值来筛选出置信度较高的预测框。

#### 3.3.2 多尺度预测与锚框选择

YOLOv8还采用多尺度预测和锚框选择的技术,以此来提高在不同大小目标上的检测能力。模型对输入图像进行多尺度特征提取,每个尺度的特征图用来预测不同大小的目标。锚框(anchor boxes)是事先定义的一组边界框尺寸,这些尺寸作为先验信息帮助网络更有效地定位目标。

结合多尺度预测与锚框选择,YOLOv8能够在单次前向传播过程中,同时检测图像中的大对象和小对象,显著提高了检测的灵活性和准确率。

# 4. YOLOv8的实践应用与案例分析

## 4.1 YOLOv8的实现流程

### 4.1.1 模型部署与环境配置

YOLOv8模型的部署和环境配置是进行目标检测之前的关键步骤。为了确保YOLOv8可以顺利运行,需要对计算环境进行适当的设置。

在配置环境时,首先确保具备Python环境,因为YOLOv8的官方实现主要使用Python语言。然后,安装YOLOv8的依赖包,这些通常包括PyTorch、NumPy、OpenCV等,可以通过pip命令一键安装:

```bash

pip install -r requirements.txt

```

在安装过程中,可能需要根据实际操作系统选择合适的安装包。例如,在Linux系统中,需要安装`libgl1-mesa-glx`和`libglib2.0-0`等依赖库。

接着,下载YOLOv8的预训练模型权重,并准备数据集。数据集应按照YOLOv8要求的格式进行组织,以确保模型可以正确读取数据进行训练和测试。

最后,将YOLOv8的代码库克隆到本地,并根据需要调整配置文件。这些配置文件中包括了模型结构、训练参数、超参数等。

### 4.1.2 推理加速与兼容性处理

YOLOv8在推理阶段具备高效率的特点,但如果要进行大规模部署或者在边缘设备上运行,还需要考虑推理加速和兼容性问题。

推理加速可以通过多种方式进行,例如使用ONNX(Open Neural Network Exchange)格式将模型转换到其他推理引擎上,例如TensorRT,可以显著提高推理速度。代码示例如下:

```python

import onnx

# 将YOLOv8模型导出为ONNX格式

model = ... # 加载YOLOv8模型

dummy_input = torch.randn(1, 3, 640, 640) # 创建一个输入样例

torch.onnx.export(model, dummy_input, "yolov8.onnx") # 导出模型

# 使用TensorRT进行推理加速

import tensorrt as trt

TRT_LOGGER = trt.Logger(trt.Logger.WARNING)

trt.init_libnvinfer_plugins(TRT_LOGGER, '')

runtime = trt.Runtime(TRT_LOGGER)

with open("yolov8.onnx", "rb") as model:

engine_data = model.read()

engine = runtime.deserialize_cuda_engine(engine_data)

context = engine.create_execution_context()

```

兼容性处理意味着YOLOv8模型要能够在不同的硬件平台上运行,同时保持良好的性能。例如,在NVIDIA GPU上,需要确保CUDA和cuDNN的版本与YOLOv8兼容。

## 4.2 YOLOv8的应用案例

### 4.2.1 行业应用的探索与实践

YOLOv8由于其出色的性能,已经在多个行业中找到了应用。例如,在安防监控领域,YOLOv8可以被用于实时的行人检测和车辆识别,提高安全监控系统的准确度和响应速度。在智能交通系统中,YOLOv8可以识别和跟踪道路上的车辆,为交通流量分析和事故预防提供支持。

在零售行业,YOLOv8被用于商品识别和人流统计,帮助商家更好地理解顾客行为,优化库存管理和销售策略。在农业领域,YOLOv8可以用于作物病害的检测,通过及时识别病害来减少损失。

### 4.2.2 案例分析与性能评估

通过实际案例的应用,我们能够更加深入地了解YOLOv8在不同场景下的表现。例如,一家安防公司可能会利用YOLOv8部署智能监控系统,用来检测异常行为或物体。评估这类系统的性能时,通常会考虑准确度、召回率和F1分数等指标。

在实际部署时,还需要考虑环境因素、目标大小、移动速度、光照条件等因素对检测准确性的影响。性能评估需要基于真实场景下收集的数据集进行,这些数据集应该覆盖各种可能的情况。

以一家零售公司使用YOLOv8进行顾客流量统计为例,我们可以设置特定的检测阈值,以减少误报。通过实际的流量统计结果与人工计数进行对比,可以评估YOLOv8在该场景下的准确性。

## 4.3 YOLOv8的未来展望与挑战

### 4.3.1 技术发展的方向与趋势

随着深度学习技术的不断发展,YOLOv8作为目标检测领域的一项重要技术,未来的改进方向可能会集中在以下几个方面:

- 更高的精度:通过更先进的网络架构和训练技术,提升模型的检测精度。

- 更快的处理速度:为了适应实时处理的需要,将继续优化模型的推理速度。

- 更强的泛化能力:提高模型对于各种不同环境和条件的适应性。

此外,YOLOv8可能会集成更多先进的算法,如自监督学习、联邦学习等,以应对更加复杂的应用场景。

### 4.3.2 应对挑战的策略与建议

在推广和应用YOLOv8过程中,也存在一些挑战需要应对,如模型的可解释性、隐私保护、安全问题等。

为了解决这些挑战,研究者和工程师们可以采取以下策略:

- 强化模型的可解释性:开发更加直观的工具和方法,帮助开发者理解模型的决策过程。

- 遵守隐私规范:在收集和处理数据时,严格遵守相关的数据保护法规。

- 加强安全措施:采用最新的安全技术,保护模型不被恶意攻击和利用。

通过这些策略,YOLOv8能够更好地适应未来的发展,为各种行业提供更加强大和可靠的支持。

# 5. YOLOv8的开源社区与资源

## 5.1 YOLOv8的开源项目介绍

YOLOv8作为开源项目,吸引了全球众多研究者和开发者的关注。本节将详细介绍YOLOv8的开源项目现状,以及如何利用社区资源进行研究与开发。

### 5.1.1 主要的开源仓库与贡献者

YOLOv8的源代码、文档以及各种资源主要托管在GitHub上,形成了多个仓库。这些仓库中包括模型的实现代码、预训练模型、示例脚本以及安装指南等。贡献者们通过Pull Request的方式提交他们的代码和改进意见,共同推动YOLOv8的发展。贡献者中不乏业内知名的研究人员和工程师,他们的贡献极大地丰富了YOLOv8的功能与性能。

为了更好地理解YOLOv8的贡献者生态,可以从GitHub仓库的贡献者部分获取这些信息。通常可以通过以下步骤访问这些信息:

1. 访问YOLOv8的GitHub仓库页面。

2. 点击“Insights”标签。

3. 选择“Contributors”子标签,查看活跃贡献者列表。

### 5.1.2 社区交流与支持资源

YOLOv8社区非常活跃,提供了多种交流与支持渠道,如issue讨论、邮件列表以及实时聊天平台。这些渠道为用户和开发者提供了讨论问题、分享经验以及合作的机会。

社区交流通常采用如下形式:

- **GitHub Issues**:用于报告问题、讨论bug修复或功能改进。

- **讨论论坛**:例如Google Group或Reddit的YOLOv8专区,可以进行更开放的讨论。

- **实时聊天**:通过Slack或Discord频道进行快速交流。

- **文档**:包括Read the Docs上的官方文档和社区贡献的教程。

## 5.2 YOLOv8的资源与工具

本节将详细介绍与YOLOv8相关的资源与工具,包括训练数据集、预训练模型以及开发工具包等。

### 5.2.1 训练数据集与预训练模型

训练一个高效准确的目标检测模型需要大量高质量的数据集。YOLOv8在官方GitHub仓库中提供了多个用于训练的数据集,其中一些是专门为YOLOv8设计的。

预训练模型是在大规模数据集上预先训练好的模型,可以用于迁移学习或直接用于实际应用。对于YOLOv8而言,用户可以利用以下步骤来下载和使用预训练模型:

1. 访问YOLOv8的官方GitHub仓库。

2. 导航到`models`目录,查看可用的预训练模型列表。

3. 下载所需的预训练模型,通常为`.weights`或`.pt`格式的文件。

### 5.2.2 开发工具包与应用框架

YOLOv8除了核心的模型代码外,还提供了完善的开发工具包(SDK)和应用框架,使得开发人员能够更容易地将YOLOv8集成到不同的应用中。这些工具包包括:

- **API接口**:为了方便集成,YOLOv8提供了简洁的API接口,允许用户在Python、C++等语言中调用模型。

- **应用程序模板**:官方提供了针对特定场景的应用程序模板,如视频分析、实时监控等。

例如,要使用Python API,开发者可以安装YOLOv8的Python库并按以下方式使用:

```python

import torch

model = torch.hub.load('ultralytics/yolov8', 'yolov8', pretrained=True)

results = model(img)

```

以上代码块演示了如何导入并使用YOLOv8模型进行图像处理。需要注意的是,在执行上述代码之前,需要确保安装了YOLOv8的Python库,并且已经有一个有效的`.pt`文件作为预训练模型。

此外,YOLOv8还提供了命令行工具来处理图像和视频文件。通过命令行工具,用户可以快速测试模型性能,进行图像识别等操作。

为了保证代码的高效执行和资源的合理分配,YOLOv8还利用了诸如 CUDA 这类 GPU 加速库,从而为模型的部署和应用提供足够的计算支持。这种优化确保了YOLOv8不仅在研发阶段,而且在产品级部署中都能拥有良好的性能表现。

通过本章内容的介绍,可以看出YOLOv8的开源社区充满活力,资源丰富,为从事目标检测研究的开发者提供了一个强大的支撑平台。接下来的章节将深入探讨YOLOv8在实际应用中的实现流程以及应用案例。

# 6. YOLOv8的进阶研究与创新

## 6.1 YOLOv8的扩展研究

### 6.1.1 多任务学习与融合模型

随着深度学习技术的发展,多任务学习已成为扩展模型功能和提高效率的重要方向。YOLOv8模型在这一领域也进行了创新尝试。多任务学习允许模型同时学习多个相关任务,并共享其表示以提高学习效率。例如,一个模型可以同时进行目标检测和图像分割,利用共享的特征学习过程达到更优的泛化能力。

在YOLOv8中,开发者引入了一个融合模块,可以集成不同的任务分支,每个分支专注于特定的任务。例如,一个分支负责目标检测,而另一个分支则处理像素级的任务,如语义分割。这种结构允许模型在一个统一的框架内处理多样化的视觉任务。

代码示例中的融合模块可能包含在模型定义文件中,如下所示:

```python

class MultiTaskModel(nn.Module):

def __init__(self):

super(MultiTaskModel, self).__init__()

self.backbone = create_backbone() # 共享的特征提取网络

self.detector_head = create_detector_head() # 目标检测分支

self.segmenter_head = create_segmenter_head() # 图像分割分支

def forward(self, x):

features = self.backbone(x)

detection_output = self.detector_head(features)

segmentation_output = self.segmenter_head(features)

return detection_output, segmentation_output

```

该代码段展示了一个简单的多任务学习模型结构,其中定义了特征提取网络以及两个不同的任务分支。

### 6.1.2 模型压缩与边缘部署

随着模型复杂度的提升,模型的尺寸和计算需求也随之增加。为了在资源有限的设备上部署模型,模型压缩与优化成为必要步骤。模型压缩包括剪枝、量化和知识蒸馏等技术,旨在减少模型参数的数量和计算量,同时尽可能保持模型性能。

YOLOv8在模型压缩方面进行了若干创新,例如引入了动态剪枝策略,动态决定哪些神经元是冗余的,并在训练过程中动态移除它们。此外,YOLOv8还探索了量化技术,将浮点参数转换为低比特数的表示,减少模型大小和推理时间。

```python

def prune_and_quantize_model(model):

# 剪枝操作

pruned_model = apply_pruning(model)

# 量化操作

quantized_model = quantize_model(pruned_model)

return quantized_model

```

该函数序列展示了模型压缩的一个简化流程,实际操作会更为复杂,并且需要综合评估对性能的影响。

## 6.2 YOLOv8的技术创新点

### 6.2.1 未来技术革新预测

考虑到计算机视觉领域的快速发展,YOLOv8有望在多个方面继续进行技术创新。预测未来的革新方向可能包括更智能的特征提取方法,如自适应滤波器和注意力机制的进一步发展,以及对于跨模态学习(例如文本与图像的联合处理)的探索。

自适应滤波器能够根据输入数据动态调整其响应,以更好地捕捉信息,而注意力机制可以使得模型集中于图像中最关键的部分,进一步提升模型的性能。

### 6.2.2 研究方向与学术贡献

YOLOv8的研究方向不仅局限于优化现有模型,还包括探索与目标检测相关的更广泛问题,例如在自动驾驶、智能监控和医学图像分析等特定领域内的应用。此外,YOLOv8的研究工作也在为深度学习社区提供学术贡献,包括新的数据集开发、模型架构和性能评估方法,为其他研究者提供基准和灵感。

YOLOv8的这一系列研究方向不仅推动了自身技术的进步,也为深度学习的各个分支领域带来了积极的影响。

在本章节中,我们探讨了YOLOv8在多个研究领域的扩展和创新,包括多任务学习、模型压缩、技术革新预测和学术贡献。这些内容展现了YOLOv8不断进步和自我完善的精神,为未来的计算机视觉技术发展打开了新的可能性。

0

0