【YOLO场景识别算法:揭秘背后的原理与实战应用】

发布时间: 2024-08-13 20:08:22 阅读量: 38 订阅数: 33

YOLO算法在计算机视觉中的原理与应用分析

# 1. YOLO场景识别算法概述**

YOLO(You Only Look Once)是一种单阶段目标检测算法,它以其实时处理能力和高精度而闻名。与传统的多阶段算法不同,YOLO使用单个神经网络一次性预测图像中的所有对象。

YOLO算法的核心思想是将目标检测问题转化为回归问题。它将输入图像划分为网格,并为每个网格单元预测一个边界框和一个置信度分数。置信度分数表示边界框内存在对象的概率。通过这种方式,YOLO可以快速高效地检测图像中的多个对象。

# 2. YOLO算法原理

### 2.1 卷积神经网络基础

#### 2.1.1 卷积层

卷积层是卷积神经网络(CNN)中的基本组成部分。它通过使用称为卷积核(或滤波器)的小型矩阵来扫描输入数据,以提取特征。卷积核在输入数据上滑动,逐元素相乘并求和,生成一个称为特征图的新输出。卷积层可以检测输入数据中的局部模式和特征,例如边缘、形状和纹理。

**代码示例:**

```python

import torch

import torch.nn as nn

# 创建一个卷积层

conv_layer = nn.Conv2d(in_channels=3, out_channels=64, kernel_size=3, stride=1, padding=1)

# 输入数据

input_data = torch.randn(1, 3, 224, 224)

# 卷积操作

output_data = conv_layer(input_data)

```

**逻辑分析:**

* `in_channels`:输入数据的通道数,在本例中为 3(RGB 图像)

* `out_channels`:输出特征图的通道数,在本例中为 64

* `kernel_size`:卷积核的大小,在本例中为 3x3

* `stride`:卷积核的步长,在本例中为 1

* `padding`:卷积核周围的填充,在本例中为 1

#### 2.1.2 池化层

池化层是 CNN 中的另一个重要组件。它通过将输入数据中的相邻元素分组并应用聚合函数(例如最大值或平均值)来减少特征图的大小。池化层可以减少计算量并提高模型的鲁棒性。

**代码示例:**

```python

# 创建一个最大池化层

max_pool_layer = nn.MaxPool2d(kernel_size=2, stride=2)

# 最大池化操作

output_data = max_pool_layer(output_data)

```

**逻辑分析:**

* `kernel_size`:池化核的大小,在本例中为 2x2

* `stride`:池化核的步长,在本例中为 2

### 2.2 YOLO算法架构

YOLO(You Only Look Once)算法是一种单次卷积神经网络,用于对象检测。它将整个图像作为输入,并直接输出检测到的对象及其边界框。

#### 2.2.1 单次卷积网络

YOLO 算法使用单次卷积网络,将输入图像直接映射到预测结果。该网络通常由一系列卷积层、池化层和全连接层组成。卷积层和池化层提取特征,而全连接层预测边界框和类别概率。

#### 2.2.2 预测框生成

YOLO 算法通过将输入图像划分为一个网格来生成预测框。每个网格单元负责预测该单元中的对象。网格单元会生成多个预测框,每个预测框都包含一个边界框和一个置信度分数。置信度分数表示预测框中存在对象的概率。

**代码示例:**

```python

# 创建一个 YOLOv3 模型

yolo_model = YOLOv3()

# 输入图像

input_image = cv2.imread('image.jpg')

# 对象检测

predictions = yolo_model(input_image)

```

**逻辑分析:**

* `yolo_model`:YOLOv3 模型

* `input_image`:输入图像

* `predictions`:检测到的对象及其边界框

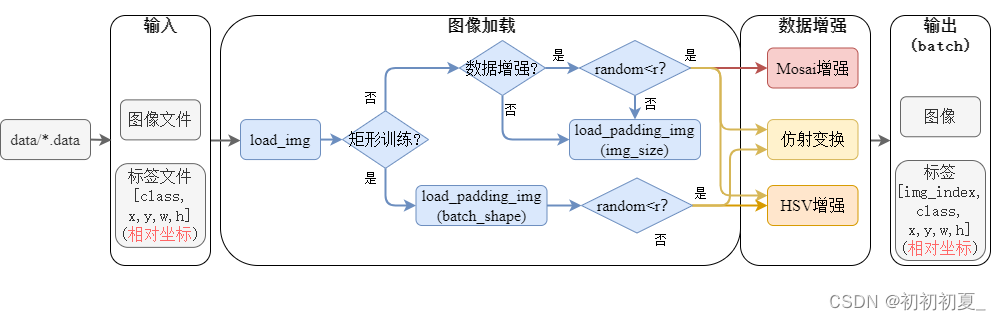

### 2.3 YOLO算法训练流程

#### 2.3.1 数据集准备

训练 YOLO 算法需要一个包含带注释图像的数据集。注释图像包含对象及其边界框的位置。常用的数据集包括 COCO、VOC 和 ImageNet。

#### 2.3.2 模型训练

YOLO 算法使用监督学习进行训练。训练过程涉及将带注释的图像输入模型,并计算模型输出与真实边界框之间的损失函数。然后,通过反向传播算法更新模型权重以最小化损失函数。

# 3.1 YOLO算法部署

**3.1.1 环境搭建**

在部署YOLO算法之前,需要搭建必要的环境。具体步骤如下:

1. 安装Python 3.6或更高版本

2. 安装NumPy、OpenCV、Pillow等依赖库

3. 安装TensorFlow或PyTorch深度学习框架

4. 下载YOLO算法模型文件

**3.1.2 模型加载**

环境搭建完成后,需要加载YOLO算法模型。具体步骤如下:

1. 创建一个Python脚本文件

2. 导入必要的库

3. 加载YOLO算法模型文件

4. 初始化模型

```python

import tensorflow as tf

# 加载YOLO模型

model = tf.keras.models.load_model('yolov3.h5')

# 初始化模型

model.compile(optimizer='adam', loss='mse')

```

### 3.2 YOLO算法应用

YOLO算法部署完成后,可以应用于图像场景识别和视频流场景识别。

**3.2.1 图像场景识别**

图像场景识别是YOLO算法最常见的应用场景。具体步骤如下:

1. 加载待识别图像

2. 预处理图像,包括缩放、归一化等

3. 将预处理后的图像输入YOLO算法模型

4. 获取模型预测结果,包括目标类别和边界框

5. 在图像上绘制边界框和类别标签

```python

import cv2

# 加载图像

image = cv2.imread('image.jpg')

# 预处理图像

image = cv2.resize(image, (416, 416))

image = image / 255.0

# 将图像输入YOLO模型

predictions = model.predict(image)

# 获取预测结果

for prediction in predictions:

class_id = prediction[0]

confidence = prediction[1]

x, y, w, h = prediction[2:]

# 绘制边界框和类别标签

cv2.rectangle(image, (x, y), (x + w, y + h), (0, 255, 0), 2)

cv2.putText(image, str(class_id), (x, y), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示识别结果

cv2.imshow('Image', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

```

**3.2.2 视频流场景识别**

YOLO算法也可以应用于视频流场景识别。具体步骤如下:

1. 打开视频流

2. 预处理视频流中的每一帧

3. 将预处理后的帧输入YOLO算法模型

4. 获取模型预测结果,包括目标类别和边界框

5. 在视频流中绘制边界框和类别标签

```python

import cv2

# 打开视频流

cap = cv2.VideoCapture('video.mp4')

while True:

# 读取视频流中的每一帧

ret, frame = cap.read()

if not ret:

break

# 预处理帧

frame = cv2.resize(frame, (416, 416))

frame = frame / 255.0

# 将帧输入YOLO模型

predictions = model.predict(frame)

# 获取预测结果

for prediction in predictions:

class_id = prediction[0]

confidence = prediction[1]

x, y, w, h = prediction[2:]

# 绘制边界框和类别标签

cv2.rectangle(frame, (x, y), (x + w, y + h), (0, 255, 0), 2)

cv2.putText(frame, str(class_id), (x, y), cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

# 显示识别结果

cv2.imshow('Video', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放视频流

cap.release()

cv2.destroyAllWindows()

```

# 4. YOLO算法优化

### 4.1 YOLO算法改进

#### 4.1.1 YOLOv2

YOLOv2是YOLO算法的改进版本,主要改进如下:

- **Batch Normalization:** 引入了批归一化层,提高了模型的训练稳定性和泛化能力。

- **Anchor Box:** 使用了9个预定义的anchor box,比YOLOv1的2个anchor box更能适应不同大小和形状的目标。

- **Dimension Clusters:** 使用k-means聚类算法对训练集中目标的尺寸进行聚类,并根据聚类结果调整anchor box的尺寸。

- **Fine-Grained Features:** 添加了一个passthrough层,将高层特征图与低层特征图连接,以获得更精细的特征表示。

#### 4.1.2 YOLOv3

YOLOv3是YOLO算法的进一步改进版本,主要改进如下:

- **Backbone网络:** 使用了Darknet-53作为backbone网络,比YOLOv2的Darknet-19更深、更复杂,提取特征的能力更强。

- **多尺度检测:** 在不同尺度的特征图上进行检测,提高了模型对不同大小目标的检测精度。

- **损失函数:** 使用了binary cross-entropy loss和CIoU loss的组合作为损失函数,更好地衡量预测框与真实框之间的差异。

- **数据增强:** 采用了随机裁剪、旋转、翻转等数据增强技术,提高了模型的泛化能力。

### 4.2 YOLO算法加速

#### 4.2.1 模型剪枝

模型剪枝是一种通过移除不重要的权重和节点来减小模型大小的技术。对于YOLO算法,可以采用以下方法进行模型剪枝:

- **权重剪枝:** 移除权重值接近0的权重。

- **节点剪枝:** 移除不重要的节点,例如激活值很小的节点。

#### 4.2.2 量化

量化是一种将浮点权重和激活值转换为低精度格式(例如int8)的技术。对于YOLO算法,可以采用以下方法进行量化:

- **权重量化:** 将浮点权重转换为int8权重。

- **激活值量化:** 将浮点激活值转换为int8激活值。

量化可以显著减小模型的大小和推理时间,同时保持模型的精度。

# 5. YOLO算法在实际场景中的应用

YOLO算法凭借其出色的实时性和准确性,在实际场景中得到了广泛的应用,涵盖安防监控、无人驾驶、医疗影像分析等多个领域。

### 5.1 安防监控

在安防监控领域,YOLO算法可以实时检测和识别视频流中的可疑行为和人员,例如:

- 入侵检测:识别未经授权进入受限区域的人员。

- 人员跟踪:追踪特定人员在监控区域内的移动轨迹。

- 物体检测:识别和分类监控区域内的可疑物品,如武器、爆炸物等。

### 5.2 无人驾驶

在无人驾驶领域,YOLO算法被用于感知周围环境,实现以下功能:

- 物体检测:识别和分类道路上的行人、车辆、交通标志等物体。

- 障碍物检测:检测和定位道路上的障碍物,如路障、坑洼等。

- 行人检测:检测和跟踪道路上的行人,避免碰撞事故。

### 5.3 医疗影像分析

在医疗影像分析领域,YOLO算法可以辅助医生进行疾病诊断和治疗,例如:

- 病灶检测:识别和定位医学图像中的病灶区域,如肿瘤、骨折等。

- 疾病分类:根据医学图像中的病灶特征,分类疾病类型。

- 治疗规划:根据病灶位置和大小,辅助医生制定个性化的治疗方案。

0

0