Python内存管理的艺术:优化list.remove()对性能的影响

发布时间: 2024-09-19 05:54:22 阅读量: 54 订阅数: 21

# 1. Python内存管理概述

Python作为一种高级编程语言,其内存管理机制被设计得既高级又方便,隐藏了复杂性,使得开发者可以专注于编写逻辑而不是资源分配。然而,理解Python的内存管理对于编写高性能的应用程序至关重要。Python使用自动内存管理,这主要通过引用计数和垃圾回收两种机制来实现。在本章中,我们将概述Python内存管理的工作原理,包括对象生命周期管理、垃圾回收机制以及引用计数等基本概念。这将为我们深入探讨list.remove()方法及其内存影响打下坚实的基础。

# 2. ```

# 第二章:深入理解list.remove()方法

Python的列表(list)是一个动态数组,它提供了丰富的操作来处理序列数据。在这众多的操作中,`list.remove()` 方法是一个十分常用的删除列表中特定值的方法。对于Python开发者而言,深入理解这个方法不仅有助于编写高效的代码,还能够更好地进行内存管理。这一章节将带我们逐步深入探讨 `list.remove()` 方法的数据结构特性、工作原理、性能特点以及其对性能的影响。

## 2.1 list数据结构与remove()方法

### 2.1.1 list的数据结构特性

在Python中,list是一个可变序列,允许我们添加、删除或修改其中的元素。List的底层实现是一个数组,这意味着它可以提供快速的随机访问。然而,list不是使用连续的内存空间来存储数据的,而是通过一个固定大小的数组来存储指向实际数据的指针。这种设计使得列表的扩展和收缩更为高效,因为不需要频繁地移动现有元素来容纳新元素或填补删除后留下的空隙。

### 2.1.2 remove()方法的工作原理

`list.remove(x)` 方法用于删除列表中第一个值为 x 的元素。该方法的工作原理如下:

1. 遍历列表中的所有元素,寻找第一个与 x 值匹配的元素。

2. 找到匹配元素后,从列表中删除该元素,这通常涉及到移动后续元素来填补被删除元素留下的空隙。

3. 由于列表的动态性质,Python的垃圾回收机制会在适当的时候回收被移除元素的内存。

## 2.2 remove()方法的性能特点

### 2.2.1 时间复杂度分析

`list.remove()` 方法的时间复杂度为 O(n),其中 n 是列表的长度。这是因为最坏情况下需要遍历整个列表才能找到并删除目标元素。如果列表中元素很多或者需要频繁进行删除操作,这可能成为性能瓶颈。

### 2.2.2 内存使用模式

当 `list.remove()` 方法被调用时,它会修改列表的大小。由于列表的底层实现是数组,每次删除操作都需要移动一些元素。如果被删除的元素在列表的中间或末尾,那么就需要移动所有它后面的元素。这个过程会暂时增加内存的使用,因为需要额外的内存来存放移动的元素。一旦元素被移动,之前的内存空间就可以被垃圾回收机制回收。

## 3.1 remove()在不同场景下的性能表现

### 3.1.1 大小不同的列表操作对比

由于 `list.remove()` 方法的时间复杂度为 O(n),因此列表的大小直接影响到操作的性能。列表越大,找到匹配元素所需的时间就越长,后续可能的元素移动也越多。在列表中元素数量极多的情况下,使用 `list.remove()` 方法可能需要优化,比如考虑预先排序或者使用其他数据结构。

### 3.1.2 remove()与其他列表操作方法的对比

Python的列表提供了许多其他的元素操作方法,如 `list.pop(index)`、`list.pop()`、`list.clear()` 等。对比这些方法,`list.remove()` 在操作上相对较慢,因为它需要搜索并匹配特定值。在性能敏感的场景下,了解这些方法的性能特点能够帮助我们做出更合适的选择。

## 3.2 内存分配与垃圾回收机制

### 3.2.1 Python的内存分配策略

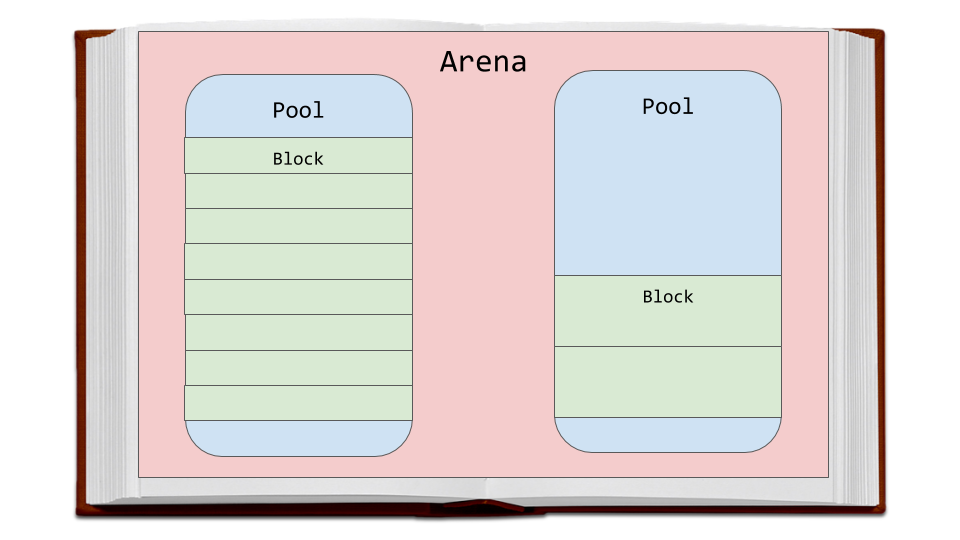

Python采用了一种名为"对象池"(object pooling)的内存分配策略来提升小对象的分配速度。Python中的一些小对象,比如整数和字符,被预先分配在内存中,并在需要时快速重用。然而,对于像列表这样的复杂对象,Python通常会在堆上动态分配内存。

### 3.2.2 垃圾回收机制对性能的影响

Python使用引用计数(reference counting)机制进行垃圾回收,这保证了没有被引用的对象可以被及时回收。然而,在大量删除元素的场景下,引用计数机制可能会导致频繁的内存回收操作,从而影响性能。为了优化性能,Python引入了代垃圾回收(generational garbage collection),以减少对性能的影响。

```python

import sys

# 示例代码:查看垃圾回收器的状态

print(sys.getsizeof(1)) # 查看整数对象的内存大小

print(sys.getsizeof([])) # 查看空列表的内存大小

```

在上述示例代码中,我们使用 `sys.getsizeof()` 函数来查看对象所占用的内存大小。理解这些内存分配和回收的机制对于编写高效的Python程序至关重要,尤其是在处理大量数据时。

## 4.1 避免频繁调用remove()的策略

### 4.1.1 数据预处理减少remove()调用

为了避免在循环或数据处理中频繁调用 `list.remove()` 方法,我们可以通过数据预处理来减少需要删除的元素数量。例如,我们可以预先过滤掉不需要的元素,或使用其他集合类型如集合(set)来处理。

### 4.1.2 使用其他数据结构优化性能

在某些情况下,使用其他数据结构可能会更有效。例如,当需要频繁地添加和删除元素时,使用双向链表可能比数组更合适,因为双向链表可以在 O(1) 的时间复杂度内添加或删除节点。

## 4.2 实践中的内存管理优化技巧

### 4.2.1 手动管理内存以减少开销

在Python中,通常不需要像在C或C++中那样手动管理内存,但是当处理大量的数据时,可以通过一些策略来减少内存使用和提高性能。例如,使用 `__slots__` 特性来减少实例属性所需的内存开销。

### 4.2.2 使用缓存机制优化内存使用

使用缓存机制(如 Python 中的 `functools.lru_cache`)可以减少重复的计算,进而减少内存消耗。例如,对于一些计算密集型和内存密集型的任务,缓存能够显著提升性能。

```python

from functools import lru_cache

@lru_cache(maxsize=128)

def compute_expensive_function(arg):

# 复杂的计算逻辑

pass

```

在上述代码块中,我们通过使用 `functools.lru_cache` 装饰器来缓存函数的返回值,这样可以避免重复计算同一个参数对应的结果。

# 第三章:remove()方法的性能影响分析

在本章中,我们将详细探究 `list.remove()` 方法在不同场景下的性能表现,并深入了解内存分配和垃圾回收机制。这些知识将帮助开发者编写出更高效和响应速度更快的Python代码。

```

# 3. remove()方法的性能影响分析

在Python中,`list.remove()`是一个常用的方法,用于删除列表中的指定元素。它在不同场景下的性能表现如何?本章节深入分析`remove()`在不同使用场景下的性能特点,及其对Python内存管理的影响。

#### 3.1 remove()在不同场景下的性能表现

##### 3.1.1 大小不同的列表操作对比

为了理解`list.remove()`在不同大小列表中的性能表现,我们可以设计一个基准测试,比较不同列表大小情况下`remove()`方法的执行时间。以下是一段基准测试代码的示例:

```python

import timeit

def performance_test():

for size in [100, 1000, 10000]:

print(f"List size: {size}")

setup_code = f"my_list = list(range({size}))" # 创建一个范围为size的列表

test_code = "my_list.remove(1)" # 移除列表中的第一个元素

times = timeit.timeit(setup=setup_code, stmt=test_code, number=1000)

print(f"remove() took {times:.6f} seconds")

print(

```

0

0