数据流算法优化大法:释放数据价值,提升性能

发布时间: 2024-08-25 23:26:33 阅读量: 36 订阅数: 34

ysoserial-master.zip

# 1. 数据流算法基础**

数据流算法是一种处理连续、无界数据流的算法。它与传统批处理算法不同,后者处理的是静态数据集。数据流算法实时处理数据,无需存储整个数据集。

数据流算法的常见应用包括实时分析、欺诈检测和网络安全。这些应用要求算法能够快速处理大量数据,并实时做出决策。

数据流算法面临的主要挑战之一是处理数据流的无界性。这意味着算法必须能够处理不断增长的数据,而不会耗尽内存或处理能力。

# 2. 数据流算法优化理论

### 2.1 数据流模型与优化目标

数据流算法处理连续不断的数据流,因此需要一个合适的模型来描述数据流的特性。常见的数据流模型包括:

- **滑动窗口模型:**数据流被划分为大小固定的窗口,算法只处理当前窗口内的数据。

- **会话模型:**数据流被划分为一系列会话,每个会话包含相关的数据。

- **无状态模型:**算法不存储任何历史状态,只处理当前数据。

- **有状态模型:**算法存储历史状态,用于处理当前数据。

优化目标通常包括:

- **吞吐量:**单位时间内处理的数据量。

- **延迟:**数据从进入算法到产生结果的时间。

- **准确性:**算法结果的准确性。

- **资源利用率:**算法对计算和内存资源的利用率。

### 2.2 优化算法与技术

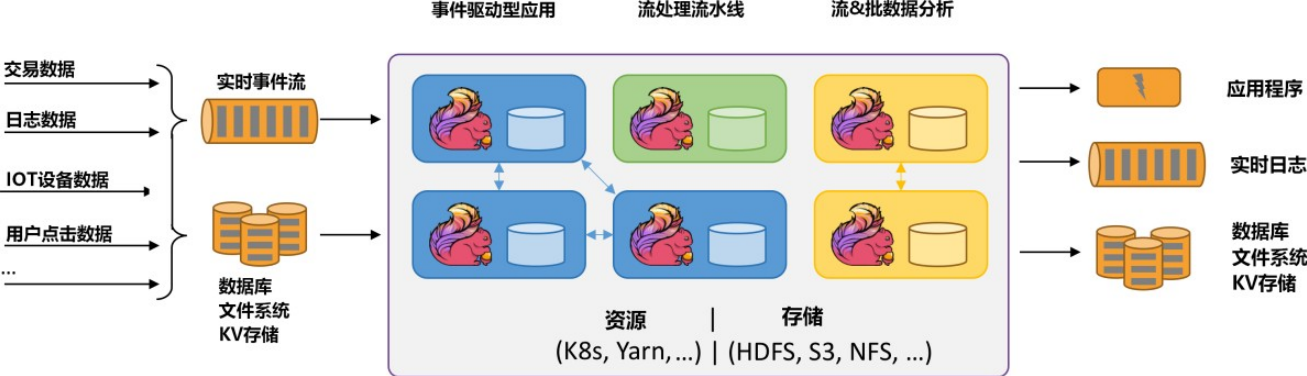

#### 2.2.1 分布式处理

分布式处理将数据流算法部署在多个节点上,以提高吞吐量和降低延迟。常用的分布式框架包括:

- **Apache Flink:**一个基于流处理的分布式计算引擎。

- **Apache Spark Streaming:**一个基于微批处理的分布式计算引擎。

- **Apache Kafka Streams:**一个用于流处理的分布式流处理平台。

#### 2.2.2 负载均衡

负载均衡确保数据流均匀分布到所有节点上,以避免单个节点过载。常用的负载均衡算法包括:

- **轮询:**将数据流依次分配给节点。

- **随机:**将数据流随机分配给节点。

- **加权轮询:**根据节点的容量分配权重,将数据流分配给节点。

#### 2.2.3 容错机制

容错机制确保数据流算法在节点故障时能够继续运行。常用的容错机制包括:

- **检查点:**定期将算法状态保存到持久化存储中。

- **故障转移:**当一个节点故障时,将数据流转移到其他节点。

- **复制:**将数据流复制到多个节点,以确保数据冗余。

**代码块:**

```java

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

public class DistributedDataStream {

public static void main(String[] args) throws Exception {

// 创建流执行环境

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 设置并行度为 4,即使用 4 个并行任务处理数据流

env.setParallelism(4);

// 创建一个数据流

DataStream<String> dataStream = env.fromElements("a", "b", "c", "d", "e");

// 将数据流打印到控制台

dataStream.print();

// 执行流处理任务

env.execute();

}

}

```

**代码逻辑分析:**

该代码创建一个并行度为 4 的流执行环境,并创建一个包含字符串 "a" 到 "e" 的数据流。然后,将数据流打印到控制台,并执行流处理任务。通过设置并行度,可以将数据流均匀分布到 4 个并行任务上处理,从而提高吞吐量。

**参数说明:**

- `env.setParallelism(4)`:设置流执行环境的并行度为 4。

- `env.fromElements("a", "b", "c", "d", "e")`:创建一个包含字符串 "a" 到 "e" 的数据流。

- `dataStream.print()`:将数据流打印到控制台。

- `env.execute()`:执行流处理任务。

# 3. 数据流算法优化实践

### 3.1 数据预处理优化

#### 3.1.1 数据清洗与转换

数据清洗是数据预处理的重要步骤,旨在去除数据中的噪声、异常值和缺失值。常见的数据清洗技术包括:

- **缺失值处理:** 使用均值、中位数或众数等统计方法填充缺失值,或删除包含大量缺失值的样本。

- **异常值处理:** 识别和移除数据集中明显偏离正常范围的值,可通过箱形图、Z-score等方法。

- **数据类型转换:** 将数据转换为适合后续处理的类型,如将字符串转换为数字或日期。

- **数据标准化:** 将数据缩放到统一的范围,以便于比较和分析,如使用最大最小归一化或标准差归一化。

#### 3.1.2 特征工程

特征工程是数据预处理的另一关键步骤,旨在提取和创建对模型预测有用的特征。常见特征工程技术包括:

- **特征选择:** 从原始数据集中选择与目标变量最相关的特征,可使用过滤法(如方差选择)或包裹法(如递归特征消除)。

- **特征转换:** 将原始特征转换为更具预测性的形式,如对分类特征进行独热编码或对连续特征进行对数转换。

- **特征组合:** 创建新的特征,通过组合或交叉现有特征,以捕获更复杂的关系。

- **特征缩放:** 将特征缩放到统一的范围,以防止特征取值范围较大的特征对模型产生过大影响。

### 3.2 算法模型优化

#### 3.2.1 模型选择与调参

模型选择是数据流算法优化中的重要步骤,涉及选择最适合给定数据集和任务的模型。常见模型选择方法包括:

- **交叉验证:** 将数据集划分为多个子集,依次使用一个子集作为测试集,其余子集作为训练集,以评估不同模型的性能。

- **网格搜索:** 系统地搜索模型超参数(如学习率、正则化项)的最佳组合,以最大化模型性能。

- **贝叶斯优化:** 使用贝叶斯统计方法,根据模型性能的反馈迭代更新超参数,以找到最佳组合。

#### 3.2.2 算法融合与集成

算法融合和集成技术可通过组合多个模型来提高数据流算法的性能。常见技术包括:

- **集成学习:** 训练多个模型,并通过投票、平均或加权等方法结合其预测结果。

- **模型融合:** 将不同模型的输出作为输入,训练一个新的模型来进行预测。

- **堆叠泛化:** 使用一个模型的输出作为另一个模型的输入,逐层训练多个模型,以提高预测精度。

# 4. 数据流算法性能评估

### 4.1 性能指标与测量方法

评估数据流算法的性能至关重要,因为它可以帮助我们了解算法的效率、准确性和可靠性。常见的性能指标包括:

- **吞吐量:**每秒处理的数据量。

- **延迟:**从数据到达系统到产生结果所需的时间。

- **准确性:**算法产生的结果与预期结果之间的接近程度。

- **资源利用率:**算法对计算、内存和其他资源的利用程度。

- **可扩展性:**算法处理更大数据量和更高并发性的能力。

测量这些指标的方法有多种,包括:

- **基准测试:**使用标准数据集和场景对算法进行测试。

- **压力测试:**在极端条件下测试算法,例如高负载或故障。

- **监控:**在生产环境中持续监控算法的性能。

### 4.2 性能优化策略

一旦我们评估了算法的性能,就可以采取措施对其进行优化。优化策略可以分为两类:

#### 4.2.1 硬件优化

- **选择合适的硬件:**使用具有足够处理能力、内存和网络带宽的硬件。

- **优化硬件配置:**调整CPU内核、内存分配和网络设置以提高性能。

- **使用加速器:**利用GPU或FPGA等加速器来处理计算密集型任务。

#### 4.2.2 软件优化

- **优化算法:**改进算法的逻辑和数据结构以提高效率。

- **并行化:**将算法分解为多个并行任务,以利用多核处理器。

- **缓存和索引:**使用缓存和索引来减少对数据的重复访问。

- **代码优化:**使用编译器优化和代码重构技术来提高代码性能。

- **监控和调整:**持续监控算法的性能并根据需要进行调整。

**示例:**

考虑一个用于实时推荐系统的流算法。我们可以使用以下优化策略来提高其性能:

- **硬件优化:**使用具有高吞吐量和低延迟的服务器硬件。

- **软件优化:**并行化算法以利用多核处理器。

- **缓存和索引:**缓存用户数据和推荐模型,以减少对数据库的访问。

- **代码优化:**使用编译器优化和代码重构技术来提高代码性能。

通过实施这些优化策略,我们可以显著提高算法的吞吐量、降低延迟并提高准确性。

# 5. 数据流算法应用案例

数据流算法在实际场景中有着广泛的应用,以下列举几个典型案例:

### 5.1 实时推荐系统

**应用场景:**

实时推荐系统是电子商务、社交媒体等领域常见的应用,其目的是根据用户的实时行为数据(如浏览记录、购买记录等)为用户提供个性化的推荐内容。

**数据流算法应用:**

数据流算法可以实时处理用户的行为数据,并基于这些数据更新推荐模型,从而实现个性化推荐。例如,使用滑动窗口算法可以实时跟踪用户的近期行为,并根据这些行为更新推荐模型,提高推荐准确性和时效性。

### 5.2 网络安全分析

**应用场景:**

网络安全分析旨在检测和响应网络安全威胁,如网络攻击、恶意软件等。

**数据流算法应用:**

数据流算法可以实时处理网络流量数据,并从中识别异常行为。例如,使用异常检测算法可以检测网络流量中的异常模式,并及时发出警报,帮助安全分析人员快速响应威胁。

### 5.3 医疗诊断与预测

**应用场景:**

医疗诊断与预测是医疗保健领域的重要应用,其目的是基于患者的医疗数据(如病历、检查结果等)进行疾病诊断和预测。

**数据流算法应用:**

数据流算法可以实时处理患者的医疗数据,并从中提取有价值的信息。例如,使用时间序列分析算法可以分析患者的健康数据,识别疾病发作的早期迹象,从而实现早期诊断和干预。

# 6. 数据流算法未来展望

### 6.1 云计算与边缘计算

云计算和边缘计算的兴起为数据流算法带来了新的机遇和挑战。云计算提供了强大的计算能力和存储资源,可以支持大规模数据流处理。边缘计算则将计算和存储资源部署到靠近数据源的位置,降低了数据传输的延迟和成本。

**云计算的优势:**

- **弹性扩展:**云计算平台可以根据需求动态扩展或缩减资源,满足数据流处理的波峰和波谷。

- **高可用性:**云计算服务通常提供高可用性保证,确保数据流处理的稳定性和可靠性。

- **低成本:**云计算按需付费的模式可以帮助企业节省成本,避免投资昂贵的硬件和基础设施。

**边缘计算的优势:**

- **低延迟:**边缘计算将计算资源部署到靠近数据源的位置,可以显著降低数据传输延迟。

- **隐私保护:**边缘计算可以避免将敏感数据传输到云端,增强数据隐私保护。

- **实时响应:**边缘计算可以支持实时数据流处理,实现对事件的快速响应。

### 6.2 人工智能与机器学习

人工智能和机器学习技术正在与数据流算法深度融合,为数据流处理带来了新的变革。

**人工智能在数据流算法中的应用:**

- **异常检测:**人工智能算法可以自动检测数据流中的异常事件,提高系统安全性。

- **预测分析:**机器学习模型可以对数据流进行预测,帮助企业提前做出决策。

- **自然语言处理:**人工智能算法可以处理文本和语音数据流,增强数据流分析能力。

### 6.3 隐私与安全

随着数据流算法的广泛应用,隐私和安全问题也日益突出。

**隐私保护:**

- **数据脱敏:**对数据流中的敏感信息进行脱敏处理,防止泄露。

- **匿名化:**对数据流中的个人身份信息进行匿名化处理,保护用户隐私。

- **差分隐私:**使用差分隐私技术,在保证数据分析准确性的同时保护个人隐私。

**安全保障:**

- **数据加密:**对数据流中的数据进行加密,防止未经授权的访问。

- **访问控制:**建立严格的访问控制机制,限制对数据流的访问权限。

- **入侵检测:**部署入侵检测系统,监测数据流中的异常行为,防止安全威胁。

0

0