【Hadoop 2.0备份与容错性】:专家推荐的备份策略与故障恢复流程

发布时间: 2024-10-30 00:16:49 阅读量: 4 订阅数: 16

# 1. Hadoop 2.0基础与架构概述

Hadoop 2.0作为一个强大而灵活的大数据处理平台,已经成为IT行业中处理大数据的首选框架。它不仅支持高度可扩展的存储,还提供了处理大量数据集的并行计算能力。本章节将为读者提供Hadoop 2.0的入门级介绍,包括其核心组件HDFS(Hadoop Distributed File System)和MapReduce的架构及工作原理。

## Hadoop 2.0的核心组件

Hadoop 2.0的核心组件是HDFS和MapReduce。HDFS为海量数据提供了高吞吐量的存储能力,而MapReduce则支持大规模数据集的并行运算。这两者协同工作,能够处理PB级别的数据量,对各种数据处理任务提供支持。

### HDFS架构

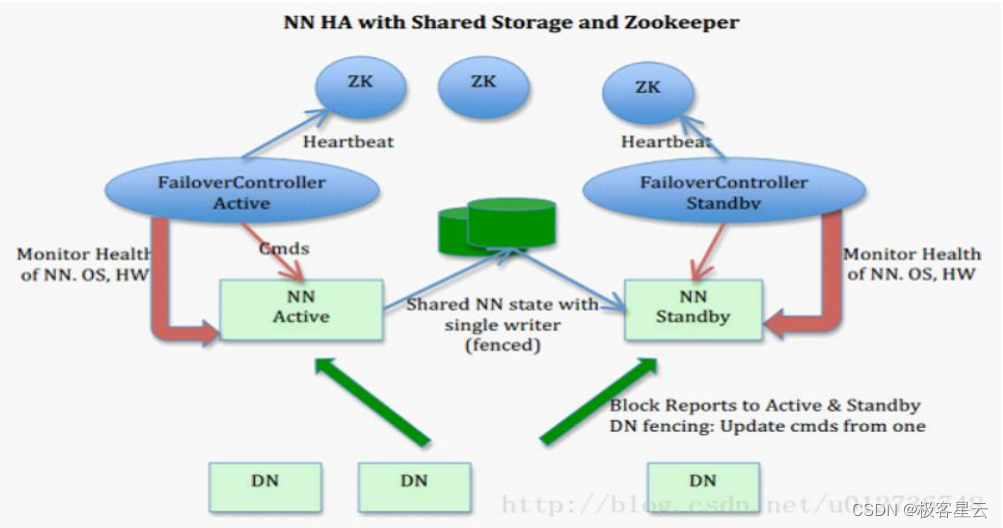

HDFS采用主从(Master/Slave)架构,由一个NameNode(主节点)和多个DataNode(数据节点)组成。NameNode管理文件系统的命名空间和客户端对文件的访问操作,DataNode则在本地文件系统上存储实际数据。

```mermaid

graph LR

A[NameNode] -->|管理| B[HDFS命名空间]

B -->|存储数据| C[DataNode1]

B -->|存储数据| D[DataNode2]

B -->|存储数据| E[DataNode3]

A -->|心跳检测| C

A -->|心跳检测| D

A -->|心跳检测| E

```

这个架构设计使得Hadoop 2.0可以分布在大量廉价的硬件设备上,实现数据的高容错性和可扩展性。接下来的章节,我们将更深入地探讨Hadoop 2.0的备份机制以及如何确保其容错性,确保系统在面对故障时能够稳定运行。

# 2. Hadoop 2.0的备份机制

## 2.1 HDFS的数据备份原理

### 2.1.1 副本策略和数据分布

Hadoop Distributed File System(HDFS)作为Hadoop 2.0的重要组成部分,通过数据的复制策略保证了数据的可靠性和容错性。HDFS中的每个文件被划分为一系列的块(block),默认情况下,每个块的大小为128MB,这些块被复制存储在不同的DataNode上。

HDFS的副本策略可以配置不同的副本数量,以适应不同的容错需求。Hadoop 2.0默认的副本数量为3,意味着每个块的数据会被复制三份,分布在不同的DataNode上。副本的分布遵循以下原则:

- 第一个副本位于写入文件的节点,以减少网络I/O。

- 第二个副本位于与第一个副本不同的机架上的节点,以提高跨机架容错性。

- 其余副本的分布遵循与第一个副本相同的机架偏好策略。

为了维护数据的高可用性,HDFS还会根据节点的健康状况动态调整副本数量。例如,如果某个DataNode发生故障,HDFS会自动创建新的副本以确保总副本数保持不变。

```java

// 示例代码展示如何设置HDFS的副本策略

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

// fs.setReplication(block, newReplicationFactor) // 设置特定块的副本数

```

在上面的代码片段中,`setReplication`方法可以用来动态调整特定数据块的副本数。这在特定情况下(如数据块损坏或需要调整副本策略时)非常有用。

### 2.1.2 心跳检测与自动恢复

HDFS通过心跳机制保持DataNode与NameNode之间的通信,确保系统中节点的健康状态。DataNode定时向NameNode发送心跳信号,表明它仍然存活。如果NameNode在指定的时间内没有接收到某个DataNode的心跳,则将其标记为“dead”。

一旦检测到DataNode故障,HDFS会触发自动恢复机制。NameNode首先会删除故障节点上所有失效的块,并重新创建这些块的副本。这个过程完全自动化,无需人工干预。

```java

// 示例代码展示如何实现心跳检测和自动恢复机制

HeartbeatReceiver receiver = new HeartbeatReceiver();

DataNode node = new DataNode(conf);

receiver.receiveHeartbeat(node);

// 如果没有收到心跳,触发自动恢复过程

receiver.performAutoRecovery(node);

```

在该代码中,`HeartbeatReceiver`类负责处理来自DataNode的心跳信号。如果检测到心跳中断,它会调用`performAutoRecovery`方法来恢复数据。

## 2.2 Hadoop 2.0的备份策略

### 2.2.1 定期备份计划的制定

对于任何分布式存储系统而言,定期备份是确保数据不丢失的关键。在制定Hadoop 2.0的备份计划时,需要考虑数据的重要性和备份的频率。

备份计划通常由以下两个要素组成:

1. **备份频率:** 需要根据数据更新的速度和重要性来决定备份的频率。例如,对于重要的日志数据可能需要实时备份,而对于相对静态的数据,每天进行一次备份可能就足够了。

2. **备份窗口:** 指定系统可以用于执行备份操作的时间段。备份窗口通常选择在系统负载较低的时间段进行,以避免对生产环境的影响。

```shell

# Hadoop 2.0的定期备份命令示例

hdfs dfs -copyFromLocal /path/to/local/directory /path/to/hdfs/directory

```

该命令将本地目录中的数据复制到HDFS的指定目录中,从而实现数据的备份。备份操作可以设置在特定时间通过cron作业自动执行。

### 2.2.2 高效备份工具的选择与应用

为了提高备份效率和方便性,可以选择一些专门为Hadoop设计的备份工具,如Apache Falcon或Ambari等。

这些工具不仅提供了数据备份的功能,还包括数据恢复、备份策略管理以及状态监控等。

使用备份工具能够自动化备份过程,通过图形用户界面或REST API来定义和执行备份任务。

```xml

<!-- Apache Falcon中的策略配置示例 -->

<feed name="backup-policy">

<endpoint>

<name>hdfsCluster</name>

<fs>hdfs://namenode:8020</fs>

</endpoint>

<schedule>

<interval>1d</interval>

</schedule>

<policy>

<name>backup-policy</name>

<retention>7d</retention>

</policy>

</feed>

```

上述配置片段定义了一个名为`backup-policy`的备份策略,其备份间隔为1天,并设置了7天的保留期。

## 2.3 备份数据的一致性与完整性

### 2.3.1 分布式校验机制

为确保备份数据的一致性和完整性,Hadoop 2.0使用了校验和(checksum)机制。HDFS为每个数据块维护一个校验和文件,当数据被读取时,它会与校验和进行比对,以确保数据的完整性。

校验和是通过对数据块进行哈希计算得到的,并在数据块读取时进行校验。如果校验失败,则表明数据可能已经损坏,此时HDFS会自动使用其他副本恢复损坏的数据。

```java

// 校验和的计算和验证示例代码

DigestInputStream digestStream = new DigestInputStream(input, MessageDigest.getInstance("MD5"));

// 读取数据后,可以通过以下方式获取校验和

MessageDigest digest = digestStream.getMessageDigest();

byte[] checksum = digest.digest();

```

这段代码展示了如何使用`DigestInputStream`来计算数据的MD5校验和。HDFS内部也是采用类似的机制来进行数据完整性校验。

### 2.3.2 数据备份的恢复点目标(RPO)和恢复时间目标(RTO)

在制定备份计划时,需要考虑恢复点目标(Recovery Point Objective, R

0

0