牛顿-拉夫逊算法:加速迭代的十大技巧与改进策略

发布时间: 2024-12-22 07:50:33 阅读量: 7 订阅数: 8

果壳处理器研究小组(Topic基于RISCV64果核处理器的卷积神经网络加速器研究)详细文档+全部资料+优秀项目+源码.zip

# 摘要

牛顿-拉夫逊算法是一种广泛应用于解决非线性问题的数值方法。本文首先介绍了该算法的基本概念和原理,并深入探讨其理论基础,包括迭代法概述、数学模型、收敛性分析及其变种。接着,本文详细阐述了提升算法效率的十大加速技巧,涵盖启动点选择、Hessian矩阵近似、步长控制等多个方面。在实践应用章节,文章探讨了全局化策略、非线性问题处理以及实际问题案例研究,旨在展现算法在各种复杂情况下的应用能力。最后,文章展望了算法的未来展望与挑战,分析了其在机器学习、复杂系统优化等新领域中的适应性,以及算法研究的前沿方向。本文总结了牛顿-拉夫逊算法的发展历程,并对未来的研究方向提出了展望。

# 关键字

牛顿-拉夫逊算法;迭代法;收敛性;加速技巧;全局化策略;非线性问题;并行化计算

参考资源链接:[电力系统潮流计算:牛顿-拉夫逊法详解](https://wenku.csdn.net/doc/65epwvzced?spm=1055.2635.3001.10343)

# 1. 牛顿-拉夫逊算法简介与原理

牛顿-拉夫逊算法是一种在数学优化问题中寻找函数零点的迭代方法。为了快速找到方程或方程组的解,该算法利用函数的泰勒展开来逼近真实的根。它在物理、工程和经济学领域中有广泛的应用。

## 算法简介

牛顿-拉夫逊算法的核心思想是使用切线来逼近函数在某一点的局部行为,进而找到函数的零点。每个迭代步骤都基于当前点的函数值和导数来估计解的位置,直到找到满足预定精度的近似解。

## 算法原理

### 迭代法概述

在数值分析中,迭代法用于逼近方程的根。牛顿-拉夫逊算法是一种特殊的迭代法,它不仅考虑函数值,还考虑函数的导数(或称为斜率)。

### 牛顿法的数学模型

牛顿法的迭代公式可以表示为 `x_{n+1} = x_n - f(x_n)/f'(x_n)`,其中 `x_n` 是当前的近似值,`x_{n+1}` 是更新后的近似值。该公式直观地解释了算法名称中"牛顿"的来源,其数学基础是泰勒展开。

通过这个简单的迭代公式,牛顿-拉夫逊算法在许多实际应用中都显示出了其强大的解决能力。在后续章节中,我们将深入了解它的理论基础、加速技巧以及在实践中的应用。

# 2. 牛顿-拉夫逊算法的理论基础

## 2.1 牛顿-拉夫逊算法的核心思想

### 2.1.1 迭代法概述

迭代法是一种通过重复计算和逼近来解决问题的数学方法。在优化问题中,迭代法可以用来寻找函数的极值点,这些极值点可能是函数的局部最小值或最大值。牛顿-拉夫逊算法作为迭代法的一种,特别适合求解无约束优化问题。

迭代法的核心思想是选取一个初始点,然后按照一定的迭代规则逐步改进这个点,直到找到满足预定精度要求的解。牛顿-拉夫逊算法通过在每次迭代中利用函数的泰勒展开式来逼近函数,从而确定下一次迭代的搜索方向和步长。

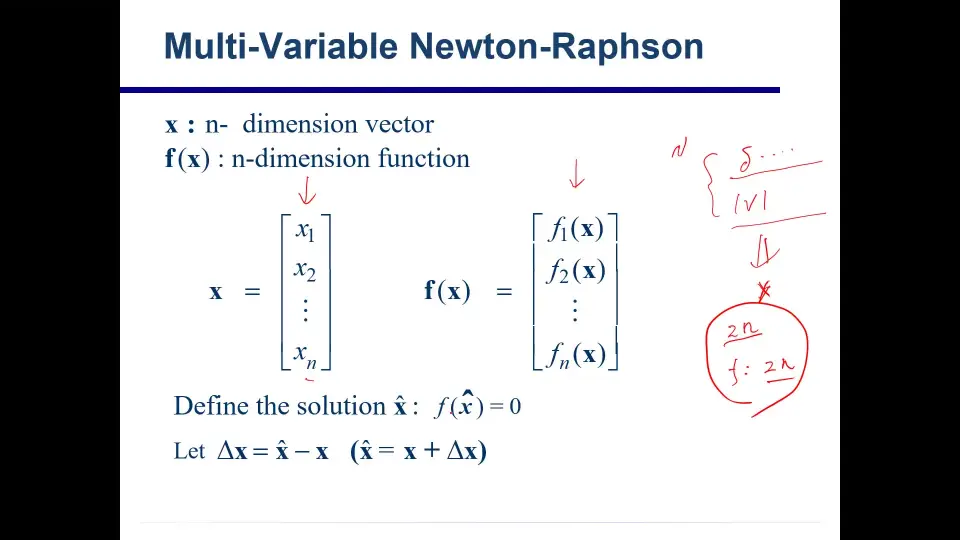

### 2.1.2 牛顿法的数学模型

牛顿法(也称为牛顿-拉夫逊方法)是一种寻找函数零点的迭代方法。对于求解非线性方程 f(x)=0 的根,牛顿法的迭代公式为:

\[ x_{n+1} = x_n - \frac{f(x_n)}{f'(x_n)} \]

这里,\( x_n \) 是当前迭代点,\( x_{n+1} \) 是下一次迭代点。函数 \( f(x) \) 的导数 \( f'(x) \) 表示函数在点 \( x \) 处的斜率。牛顿法利用函数在当前点的导数来预测函数值接近零点的方向,并沿着这个方向移动,直至找到一个足够接近真实零点的位置。

牛顿-拉夫逊算法是牛顿法的一个拓展,主要用于求解无约束优化问题,其迭代公式为:

\[ x_{n+1} = x_n - H_n^{-1} \nabla f(x_n) \]

其中,\( \nabla f(x_n) \) 是函数 \( f \) 在点 \( x_n \) 处的梯度,而 \( H_n \) 是函数 \( f \) 在 \( x_n \) 处的海森矩阵(Hessian matrix),也就是函数的二阶导数矩阵。

## 2.2 牛顿-拉夫逊算法的收敛性分析

### 2.2.1 收敛条件

牛顿-拉夫逊算法的收敛性取决于许多因素,包括初始点的选择、函数的性质以及迭代过程中的数值稳定性。在理想情况下,如果初始点选择得当,并且函数满足某些条件(如在解点的梯度不为零),牛顿-拉夫逊方法可以快速收敛到函数的局部最小值。

然而,算法也可能遇到一些问题,例如当海森矩阵不可逆时(即矩阵是奇异的或接近奇异),算法可能无法继续迭代。为了解决这类问题,可能需要引入正则化项、使用伪逆或进行矩阵分解等技巧。

### 2.2.2 收敛速度的理论探讨

牛顿-拉夫逊算法的收敛速度通常是非常快的。理论上,它具有二次收敛性,这意味着如果算法靠近解点,它的误差在每一步迭代后大约减少四倍。然而,这种二次收敛性要求海森矩阵在解点附近是正定的,并且在迭代过程中保持不变或变化不大。

实际应用中,牛顿-拉夫逊算法的收敛速度可能会受到各种因素的影响,包括初始点的选择、函数的曲率变化等。因此,理解和优化算法的收敛速度通常需要对具体问题进行详细分析。

## 2.3 算法的扩展与变种

### 2.3.1 不同迭代策略的比较

为了提高牛顿-拉夫逊算法的性能和稳定性,研究者们提出了许多扩展和变种。例如,拟牛顿法通过近似海森矩阵来避免直接计算和存储大型矩阵,从而减少计算成本。有限内存拟牛顿法(如L-BFGS)就是一种常用的拟牛顿法,它特别适合处理大规模优化问题。

### 2.3.2 基于牛顿法的其他优化算法

除了拟牛顿法,还有许多其他的优化算法是基于牛顿法的思想发展起来的。阻尼牛顿法通过引入一个标量因子来控制步长,以此避免在迭代过程中出现过大的步长。全局化牛顿法则结合了牛顿法和线搜索技术,确保每一步迭代都能取得目标函数的充分下降,从而避免陷入非稳定点或非最小点。这些算法的提出和应用,展示了牛顿-拉夫逊算法理论基础的强大生命力和适应性。

# 3. 牛顿-拉夫逊算法的十大加速技巧

牛顿-拉夫逊算法尽管是一个强有力的数学工具,但在实际应用中,尤其是在大规模和复杂的

0

0