YOLO训练集与测试集的比率:不同场景下的优化策略

发布时间: 2024-08-17 00:59:52 阅读量: 32 订阅数: 21

# 1. YOLO训练集与测试集的比率概述

训练集和测试集的比率是YOLO算法训练过程中至关重要的因素之一。它决定了模型在训练和评估阶段的数据分配,进而影响模型的性能和泛化能力。在本章中,我们将概述YOLO训练集与测试集的比率,并探讨其在不同场景下的优化策略。

# 2. 训练集与测试集比率的理论基础

### 2.1 机器学习中的训练集与测试集

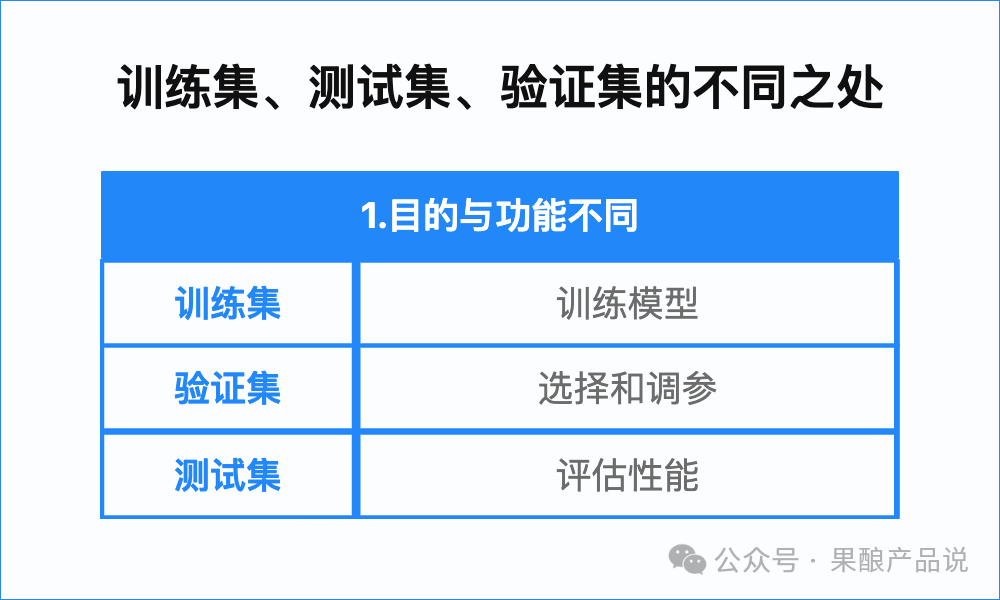

在机器学习中,训练集和测试集是两个至关重要的概念。训练集用于训练模型,而测试集用于评估模型的性能。训练集和测试集的比率对于模型的泛化能力和鲁棒性至关重要。

**训练集**包含用于训练模型的数据样本。这些样本用于学习模型的参数,从而使模型能够识别模式并进行预测。训练集的大小和质量对于模型的性能有很大影响。训练集越大,模型可以学习的模式就越多。然而,训练集中的噪声或偏差也可能导致模型过拟合,即模型在训练集上表现良好,但在新数据上表现不佳。

**测试集**包含用于评估模型性能的数据样本。这些样本不参与模型的训练,因此可以提供模型泛化能力的无偏估计。测试集的大小和质量对于模型评估的准确性至关重要。测试集越大,模型评估的结果就越可靠。然而,测试集中的噪声或偏差也可能导致模型评估结果失真。

### 2.2 YOLO算法的训练集与测试集比率

YOLO(You Only Look Once)算法是一种实时目标检测算法。与其他目标检测算法不同,YOLO 算法一次性预测图像中的所有目标,而不是逐个预测。因此,YOLO 算法对训练集和测试集比率非常敏感。

一般来说,YOLO 算法的训练集与测试集比率为 8:2 或 9:1。这意味着训练集包含 80% 或 90% 的数据样本,而测试集包含 20% 或 10% 的数据样本。这个比率可以确保模型在训练集上学习到足够多的模式,同时又能够在测试集上评估模型的泛化能力。

**代码块:**

```python

import tensorflow as tf

# 定义训练集和测试集的比率

train_test_ratio = 0.8

# 加载数据集

dataset = tf.data.Dataset.from_tensor_slices(...)

# 划分训练集和测试集

train_dataset = dataset.take(int(len(dataset) * train_test_ratio))

test_dataset = dataset.skip(int(len(dataset) * train_test_ratio))

```

**逻辑分析:**

这段代码使用 TensorFlow 定义了训练集和测试集的比率,并加载了数据集。然后,它使用 `take()` 和 `skip()` 函数将数据集划分为训练集和测试集。`take()` 函数取数据集的前 `int(len(dataset) * train_test_ratio)` 个样本作为训练集,而 `skip()` 函数跳过数据集的前 `int(len(dataset) * train_test_ratio)` 个样本,并取剩余样本作为测试集。

**参数说明:**

* `train_test_ratio`:训练集和测试集的比率。

* `dataset`:要划分的 TensorFlow 数据集。

* `train_dataset`:训练集的 TensorFlow 数据集。

* `test_dataset`:测试集的 TensorFlow 数据集。

# 3.1 小数据集场景下的优化策略

在小数据集场景下,由于数据量有限,模型容易出现过拟合问题,即模型在训练集上表现良好,但在测试集上表现不佳。因此,需要采用特定的优化策略来缓解过拟合问题。

#### 3.1.1 数据增强技术

数据增强是一种通过对原始数据进行变换(如旋转、翻转、裁剪、添加噪声等)来生成更多训练样本的技术。通过数据增强,可以有效增加训练集的大小,从而减轻过拟合问题。

**代码块:**

```python

import cv2

import numpy as np

def augment_data(image, bboxes):

# 随机旋转图像

angle = np.random.randint(-30, 30)

image = cv2.rotate(image, angle)

# 随机翻转图像

if np.random.rand(

```

0

0