【人工神经网络】:在复杂衍射图谱中寻找峰的智能策略

发布时间: 2024-12-13 23:12:49 阅读量: 26 订阅数: 33

mozillazg_python-pinyin_1741402107.zip

参考资源链接:[MDI Jade教程:自动与手动寻峰处理衍射数据](https://wenku.csdn.net/doc/7q5wcpyqxj?spm=1055.2635.3001.10343)

# 1. 人工神经网络基础介绍

人工神经网络(ANN)是深度学习的基石,其结构和功能旨在模拟人类大脑处理信息的方式。本章将介绍神经网络的基本概念和组成。

## 1.1 神经网络的基本概念

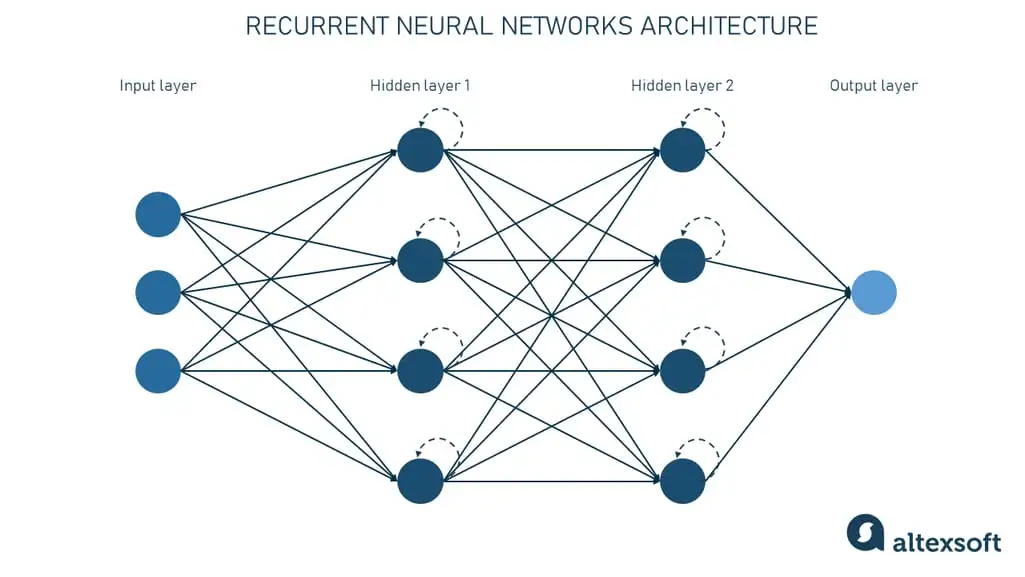

人工神经网络是一种由大量相互连接的节点(神经元)组成的计算模型,通过模拟人脑中的神经元与突触之间的联系进行学习和决策。它包含输入层、隐藏层和输出层,每层含有若干个神经元。

## 1.2 神经元与激活函数

每个神经元接收来自前一层的多个输入信号,对它们进行加权求和,并通过一个激活函数处理后,产生一个输出信号传递给下一层。激活函数是网络学习非线性映射能力的关键,常见的有Sigmoid、ReLU等。

## 1.3 网络层及其结构设计

隐藏层的引入使得神经网络可以学习到输入数据的复杂特征。结构设计包括确定隐藏层数量及每层神经元的数量,这影响到模型的复杂度和学习能力。浅层网络适合简单任务,而深层网络能够处理更复杂的模式识别。

通过本章的介绍,读者应该对人工神经网络有了一个初步的认识,为进一步理解其在峰寻找中的应用打下了基础。在下一章,我们将探讨衍射图谱分析的理论基础,为深入理解神经网络在物理和化学数据分析中的应用做铺垫。

# 2. ```

# 第二章:衍射图谱分析的理论基础

衍射图谱分析是材料科学、物理、化学等领域的关键技术之一。它涉及到材料的微观结构特征,以及如何通过图谱解析这些特征。本章将深入介绍衍射图谱分析的理论基础,重点解读其基本概念和类型,以及在衍射图谱中寻找峰特征的重要性。

## 2.1 衍射图谱的基本概念和类型

### 2.1.1 衍射现象的物理原理

在物理学中,衍射现象是指波遇到障碍物或通过狭缝时发生偏离直线传播并在其后形成特定图形的过程。对于X射线或电子束,当它们与物质相互作用时,若满足布拉格方程条件,则会在特定方向产生衍射峰。布拉格方程定义为:

```

nλ = 2d sin(θ)

```

其中,n 是衍射级数,λ 是入射波长,d 是晶面间距,θ 是布拉格角。

### 2.1.2 常见的衍射图谱类型及其特性

衍射图谱类型主要取决于分析的波长、样品以及探测器的类型。以下是一些常见的衍射图谱类型及其特性:

- **X射线衍射图谱 (XRD)**: 用于确定物质的晶体结构,通过晶面间距和强度揭示材料的组成和相。

- **中子衍射图谱**: 对轻元素如氢和锂的检测更为敏感,常用于磁性材料的研究。

- **电子衍射图谱 (ED)**: 利用电子束通过非常薄的样品时产生的衍射图案,用于纳米材料和薄膜分析。

## 2.2 衍射图谱中的峰特征分析

### 2.2.1 峰的定义和测量方法

在衍射图谱中,峰是指衍射信号达到局部最大值的位置,它代表了材料的某种特定的晶体结构或电子结构特征。峰的测量方法包括:

- **峰高**: 峰的最高点与背景水平之间的垂直距离。

- **峰宽**: 反映峰的展宽程度,通常以半高全宽(FWHM)来测量。

- **积分强度**: 峰下面积的积分,与材料的相含量有关。

### 2.2.2 峰的识别对物质分析的重要性

峰的准确识别对于物质分析至关重要,因为:

- **定性分析**: 峰的位置可以用来识别材料中的相和化合物。

- **定量分析**: 峰的积分强度可以用来确定某一相的含量。

- **微观结构研究**: 峰的展宽分析可提供晶体缺陷、应力或微观畸变等信息。

## 2.3 衍射图谱分析的流程和应用实例

### 2.3.1 数据采集和预处理

衍射数据的采集一般通过X射线或中子源以及相应的衍射仪完成。采集到的数据需要经过预处理步骤,如基线校正、平滑等,以确保数据的准确性。

### 2.3.2 峰识别算法的应用

峰识别算法是衍射图谱分析中的关键步骤。它包括峰检测和峰匹配两个主要步骤。峰检测算法包括:

- **导数法**: 利用信号的一阶导数来确定峰的起始点和结束点。

- **阈值法**: 根据预设的阈值确定峰的位置。

### 2.3.3 衍射图谱分析软件介绍

为了便于峰识别和分析,科研人员开发了多款衍射图谱分析软件,如Bruker的 DIFFRAC.SUITE、Rigaku的PDXL和MDI的Jade等。

以下是一个XRD衍射图谱数据的简单处理流程:

```python

import matplotlib.pyplot as plt

from scipy.signal import find_peaks

# 假设我们已经获取了一组XRD数据和对应的强度值

xrd_data = [10, 15, 20, 25, 30, 35, 40, 45, 50, 55] # 2θ角度

intensity = [100, 200, 500, 1000, 800, 300, 150, 100, 50, 20] # 对应的衍射强度

# 使用scipy的find_peaks函数找到所有的峰

peaks, properties = find_peaks(intensity, height=200)

# 绘制XRD图谱和峰的位置

plt.plot(xrd_data, intensity, 'b', label='XRD Spectrum')

plt.plot(xrd_data[peaks], intensity[peaks], 'ro', label='Detected Peaks')

plt.legend()

plt.show()

```

在上述代码中,我们首先导入了matplotlib和scipy的信号处理模块,然后模拟了一组XRD数据。通过find_peaks函数,我们找到了所有的峰,并将其在图谱上标记出来。这对于初步识别材料中的相结构是非常有用的。

通过这些理论和应用的介绍,我们可以看到衍射图谱分析在材料科学中扮演着重要角色,它使得科研人员能够从分子层面上深入理解材料的结构和性质。

```

# 3. 神经网络在峰寻找中的应用原理

## 3.1 人工神经网络的基本构成

### 3.1.1 神经元和激活函数

神经网络的基本构成单位是神经元(Neuron),它模拟了生物神经元的功能。在人工神经网络中,一个神经元接收输入信号,对这些信号进行加权求和,并通过激活函数产生输出信号。激活函数的作用是为神经元添加非线性因素,使得网络能够学习和执行更加复杂的任务。

常见的激活函数包括Sigmoid、ReLU、Tanh等。例如,Sigmoid函数可将输入压缩至0和1之间,而ReLU函数会将所有负值置为零,保留正值不变。选择适当的激活函数对于模型的性能至关重要,不同的激活函数适用于不同的问题场景。

代码示例:

```python

import numpy as np

def sigmoid(x):

return 1 / (1 + np.exp(-x))

def relu(x):

return np.maximum(0, x)

# 模拟神经元输入

inputs = np.array([1, 2, 3, 4])

# 计算Sigmoid激活函数的输出

sigmoid_output = sigmoid(inputs)

# 计算ReLU激活函数的输出

relu_output = relu(inputs)

print("Sigmoid Output:", sigmoid_output)

print("ReLU Output:", relu_output)

```

逻辑分析与参数说明:此代码定义了两种激活函数Sigmoid和ReLU,并分别计算了对于相同输入数组的输出。参数说明包括`inputs`数组,代表神经元的输入信号。

### 3.1.2 网络层及其结构设计

神经网络由多层组成,包括输入层、隐藏层和输出层。隐藏层的数量和每层中神经元的数量定义了网络的深度和宽度,即网络结构。网络结构的设计需要依据具体问题而定,过深或过宽的网络结构可能导致过拟合或欠拟合。

例如,在处理峰寻找问题时,网络可能需要足够的隐藏层以捕捉复杂的数据特征。但同时,网络结构也应尽量简洁,以减少计算资源的消耗和防止过拟合的发生。

mermaid格式流程图示例:

```mermaid

graph TD;

A[输入层] --> B[隐藏层1]

B --> C[隐藏层2]

C --> D[隐藏层3]

D --> E[输出层]

```

逻辑分析与参数说明:上述流程图展示了简单的三层神经网络结构,包括输入层、三个隐藏层和输出层。实际应用中,根据任务的复杂度,网络可以设计为更多的隐藏层或更深的网络结构。每层之间通过前向传播的方式传递信息,并通过反向传播算法进行权重的调整。

## 3.2 神经网络处理峰寻找的机制

### 3.2.1 数据的输入和网络的输出层设计

对于峰寻找应用,神经网络的输入层需要设计得能够接受描述峰的数据,例如,峰值的高度、宽度、位置等。输出层则需要提供最终的峰识别结果,比如输出峰值的位置坐标或者峰的存在性概率。

输出层设计的关键是选择合适的损失函数,损失函数量化了网络输出与实际目标值之间的差异,是网络训练的核心。

代码示例:

```python

from keras import models, layers

# 假设我们已经预处理好了峰数据

X_train, y_train = ... # 训练数据及其标签

# 设计一个简单的神经网络模型

model = models.Seq

```

0

0