Redis高可用部署策略:持久化与故障转移的redis-py应用

发布时间: 2024-10-01 14:32:17 阅读量: 62 订阅数: 32

PyPI 官网下载 | redis-py-cluster-1.1.0.tar.gz

# 1. Redis高可用基础与理论

在本章中,我们将介绍Redis作为高性能键值存储系统的高可用性(High Availability,简称HA)的基础和理论。我们将讨论高可用性的意义、Redis为实现高可用性所提供的机制,以及这些机制背后的工作原理。

Redis作为一个内存数据库,其读写性能卓越,被广泛应用于缓存、消息队列、排行榜等多种场景。然而,任何依赖于单一节点的服务都面临着故障的风险。因此,构建一个高可用的Redis服务是确保业务连续性的关键步骤。

高可用的实现通常涉及数据备份、故障检测、自动故障转移以及故障恢复等多个方面。在Redis中,这些功能可以通过主从复制(Replication)、哨兵(Sentinel)系统以及持久化机制来实现。

接下来的章节将深入探讨Redis持久化机制,并分析如何通过不同的配置来优化Redis的性能与稳定性。同时,我们会深入了解Redis故障转移的理论与实践,以及如何利用redis-py库将这些理论应用到实际开发中。

通过本章的学习,读者将能够理解并运用Redis高可用的关键技术,为构建可靠、稳定的应用打下坚实的基础。

# 2. Redis持久化机制深入解析

## 2.1 持久化的理论基础

### 2.1.1 数据一致性问题

数据一致性问题是指在系统运行过程中,为了保证数据不丢失,需要将内存中的数据定期持久化到磁盘上。但是,由于数据在内存中是不断变化的,所以如何在保证性能的同时确保数据的一致性是一个挑战。

Redis通过两种持久化机制来解决这个问题:RDB(Redis Database)和AOF(Append Only File)。RDB通过创建数据集的快照来进行持久化,而AOF则记录了对数据集的每个写操作。它们都有各自的方法来平衡性能和一致性,用户可以根据需求选择合适的持久化方式。

### 2.1.2 RDB和AOF的区别与选择

RDB与AOF在多个方面有着本质上的不同:

- **数据恢复方式**:

- RDB是以快照的形式保存某一时刻的数据集。

- AOF则是记录数据库的所有写操作,并在重启时重放。

- **文件大小**:

- RDB的文件大小取决于执行快照时的数据量。

- AOF的文件大小则是由增量的数据修改决定的。

- **性能影响**:

- RDB在持久化过程中可能会耗费较多的CPU和内存资源。

- AOF的写操作是顺序追加,对性能的影响相对较小。

- **故障恢复**:

- RDB恢复速度通常很快,但可能会丢失最后一次快照之后的数据。

- AOF通过重放所有操作,可以最大程度地保证数据不丢失,但恢复时间较长。

在实际选择时,应根据业务场景的需求来进行平衡。如果需要快速的故障恢复并且可以接受一定的数据丢失风险,RDB可能更适合;而如果对数据安全要求极高,则应该优先考虑使用AOF。有时候结合两者使用,即同时启用RDB和AOF,可以取得更好的平衡。

## 2.2 RDB持久化的实现与优化

### 2.2.1 RDB快照的原理

RDB持久化是通过创建数据集的快照来实现的。在Redis配置文件中,可以设定快照触发的条件,例如`save`指令指定时间间隔或操作次数。当达到指定条件时,Redis会fork出一个子进程,然后子进程将当前的数据写入临时文件,完成后进行文件替换操作。

以下是一个配置示例:

```shell

save 900 1

save 300 10

save 60 10000

```

这里定义了三种快照触发机制:

- 每900秒(15分钟)如果至少有1个key被改变时,执行快照。

- 每300秒(5分钟)如果至少有10个key被改变时,执行快照。

- 每60秒如果至少有10000个key被改变时,执行快照。

### 2.2.2 RDB的配置与性能调整

在使用RDB进行持久化时,配置的选择非常关键,因为它直接影响到Redis的性能和数据的安全性。以下是配置RDB持久化的几个关键点:

- **持久化间隔**:决定快照触发的时间间隔,快照太频繁会降低性能,太慢则可能丢失较多数据。

- **压缩**:通过`rdbcompression yes`开启数据压缩,可以减少磁盘空间的占用,但会增加CPU的使用率。

- **fork策略**:为了减少fork操作对主进程性能的影响,可以配置`active-defrag yes`等参数进行碎片整理。

### 2.3 AOF持久化的实现与优化

#### 2.3.1 AOF重写机制

AOF通过记录写命令的方式来保持数据的持久性。随着时间的推移,AOF文件会越来越大,这会增加重放时的开销。为了解决这个问题,Redis提供了AOF重写的机制。

AOF重写是通过创建当前内存数据集的最小化版本来减少文件大小。在执行重写时,Redis会生成一个子进程来遍历内存中的数据,并将数据转换为最小的写操作集合。这个过程可以由用户手动触发,或者通过配置自动进行。

例如,以下配置会根据AOF文件的大小自动触发重写:

```shell

auto-aof-rewrite-percentage 100

auto-aof-rewrite-min-size 64mb

```

这里规定当AOF文件大小比上次重写后增加超过100%时,或者AOF文件大小至少有64MB时,进行自动重写。

#### 2.3.2 AOF故障恢复策略

在发生故障时,AOF文件提供了强大的数据恢复能力。由于AOF文件记录了所有的写操作,因此在重启Redis时,可以通过重放这些操作来恢复数据。

故障恢复策略主要涉及以下几个方面:

- **重放策略**:在Redis启动时,它会自动检测AOF文件,如果有AOF文件存在,就优先使用AOF来恢复数据。

- **故障转移**:如果使用了Redis Sentinel或Redis Cluster,故障转移发生时会自动切换到新的主节点,并使用AOF进行数据恢复。

- **验证与优化**:为了确保AOF文件的一致性,可以使用`redis-check-aof`工具进行修复。同时,可以通过AOF重写来优化AOF文件,减少恢复所需的时间。

```shell

redis-check-aof --fix

```

上面命令用于修复有问题的AOF文件。

通过上述机制,Redis能够有效地保证在各种情况下数据的持久性和一致性,同时也提供了相应的性能优化手段以减轻对系统性能的影响。在实际部署时,应该根据具体的应用场景和需求,对这些参数进行细致的配置和调整,以达到最佳的持久化效果。

# 3. Redis故障转移机制实践

## 3.1 故障转移的理论模型

### 3.1.1 主从复制的原理

Redis 的复制功能允许将数据从一个主节点自动传播到多个从节点。在复制过程中,主节点会处理客户端的写操作,并将这些操作异步地复制给从节点。复制是 Redis 高可用性架构的基础,同时也为读取操作提供了负载均衡的可能。

为了更好地理解复制的工作原理,我们需要了解以下几个关键点:

1. **复制的初始化**:当从节点连接到主节点时,主节点会发送所有的数据集给从节点。这个过程称为同步。同步完成后,主节点会记录所有的写操作,并持续将新的写操作传播给所有同步过的从节点。

2. **数据传播**:复制通过网络进行,主节点将写命令传播给从节点。从节点接到命令后,执行命令以更新自己的数据集。

3. **增量复制**:如果主从之间发生网络中断,复制是部分性的,主节点会在网络恢复后,将中断期间发生的数据变更记录发送给从节点。这些记录被称为复制偏移量和复制积压缓冲区。

4. **复制的数据一致性**:主从复制能够保证数据的一致性,但是它并不是完全同步的。如果主节点在传播写命令给从节点之前崩溃,从节点可能就会丢失一部分数据。因此,在配置 Redis 时,需要根据实际需求来权衡数据一致性和性能。

### 3.1.2 故障检测机制

Redis 主从复制模式中,故障检测是保证高可用性的关键。Redis 使用的是基于心跳机制的故障检测,它依赖于配置项 `min-slaves-to-write` 和 `min-slaves-max-lag` 来确定节点是否健康。

- `min-slaves-to-write`:指定至少有多少个从节点连接到主节点后,主节点才接受写操作。

- `min-slaves-max-lag`:指定从节点与主节点的数据延迟不能超过多少秒,如果超过这个时间,主节点会拒绝写操作。

这种机制可以有效避免脑裂(split-brain)问题的发生,即防止在一个主节点无法访问的情况下,多个从节点都被提升为主节点,从而导致数据不一致的情况。故障检测机制能够确保在主节点不可用时,有且只有一个从节点可以被提升为新的主节点。

## 3.2 实现故障自动转移的策略

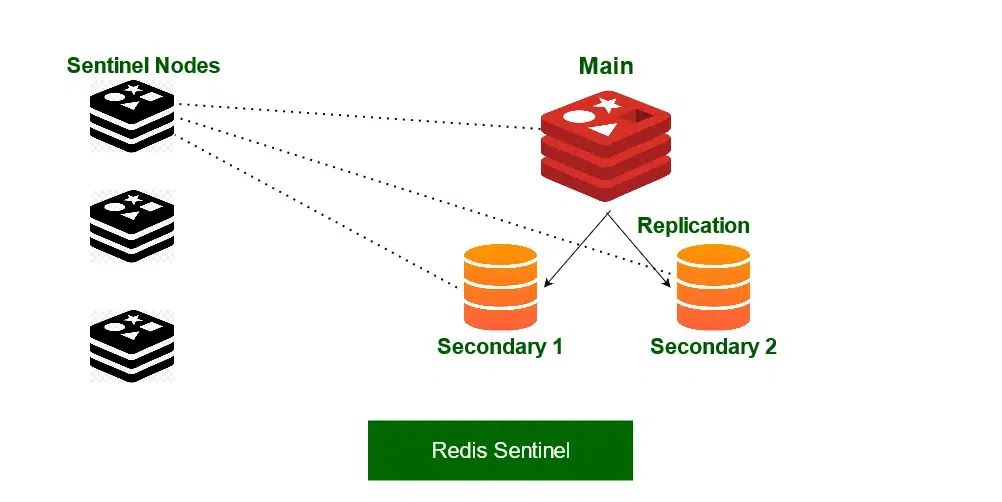

### 3.2.1 Redis Sentinel系统

Redis Sentinel 是 Redis 的高可用解决方案。Sentinel 系统由一系列 Sentinel 节点构成,这些节点的主要职责是监控所有的 Redis 节点,包括主节点和从节点,并在故障发生时自动进行故障转移。

Sentinel 系统的工作流程包括以下几个主要步骤:

1. **监控**:Sentinel 节点会定期向主节点和从节点发送命令,以检查它们是否

0

0