利用LogBack构建日志监控与报警系统:效率提升指南

发布时间: 2024-09-27 23:17:51 阅读量: 63 订阅数: 26

Java开发-日志管理-logback框架日志系统基础

# 1. 日志监控与报警系统的重要性

随着企业业务系统的日益复杂,日志监控与报警系统成为了保证系统稳定运行不可或缺的一部分。通过对系统日志的实时监控,不仅可以及时发现系统异常和安全隐患,还能辅助进行性能优化和故障排查,从而提高业务连续性和用户体验。日志中的信息是诊断问题、跟踪事故、分析性能瓶颈的重要数据来源。因此,一个高效、可靠的日志监控与报警系统能够显著提升IT管理的效率,保障系统的稳定性和安全性,减少潜在的损失。在本章节中,我们将探讨日志监控与报警系统的基本概念,分析其在现代IT运维管理中的核心地位和重要作用。

# 2. LogBack基础

## 2.1 LogBack的核心组件和架构

### 2.1.1 LogBack的核心组件介绍

LogBack是Java世界中非常流行的日志框架,由log4j的原作者开发,旨在提供更优的性能和更丰富的特性。LogBack的核心组件包括Logger,Appender和Layout三部分。

- **Logger**: Logger对象是日志框架与应用程序交互的主要界面,它提供了记录日志信息的方法。Logger对象通常由LoggerFactory创建,每个Logger对象都有一个名称,这个名称与记录日志时使用的类别名相同。

- **Appender**: Appender是负责输出日志的组件,可以理解为日志的“目的地”。LogBack支持多种Appender,如ConsoleAppender(输出到控制台)、FileAppender(输出到文件)以及SMTPAppender(邮件发送)等。Appender可以配置多个,并且可以灵活控制日志输出到哪些目的地。

- **Layout**: Layout负责格式化日志事件的最终输出格式。通过Layout,开发者可以控制日志的输出格式,例如是否包含时间戳、线程信息、日志级别、日志信息以及如何分隔各项信息等。常见的Layout有PatternLayout(自定义格式输出)和SimpleLayout(简单输出)。

这些组件协同工作,使得LogBack能够灵活地记录不同级别(如DEBUG、INFO、WARN和ERROR)的日志信息,并将其发送到预设的多个目的地(如控制台、文件、数据库等)。

### 2.1.2 LogBack的架构和工作流程

LogBack采用了独特的事件驱动架构,它包括三个主要的模块:logback-core、logback-classic和logback-access。

- **logback-core**: 这是最基础的模块,提供了LogBack运行时的基础设施。它包含用于日志记录的核心类,并提供与其他模块的接口。

- **logback-classic**: 它是建立在logback-core之上,提供了对log4j的兼容层。它还实现了SLF4J(Simple Logging Facade for Java)API,让开发者可以通过SLF4J接口使用LogBack。此外,logback-classic自身也提供了一个完整的日志实现,包括上述提到的Logger、Appender和Layout组件。

- **logback-access**: 该模块与Servlet容器(如Tomcat或Jetty)集成,为Web应用提供HTTP访问日志记录功能。

工作流程如下:

1. 当应用程序需要记录一条日志时,它会调用Logger对象的相关方法(如debug, info, warn, error)。

2. Logger根据日志级别,决定是否将消息传递给Appender。如果日志级别符合要求,Logger将消息传递给一个或多个Appender。

3. Appender接收到日志事件后,将事件发送到预定的目的地。例如,ConsoleAppender会将消息输出到控制台,而FileAppender会将消息写入到文件系统。

4. Layout组件随后将日志事件格式化为最终的字符串表示形式,然后由Appender输出。

整个过程是线程安全的,并且具有很高的性能,尤其是在处理大量日志记录时。

接下来,我们将深入了解LogBack的配置与应用,包括其配置文件详解以及如何将其集成到Java项目中。

# 3. 日志监控的实现

日志监控是确保系统稳定运行的关键环节。在本章中,我们将深入探讨日志监控的各个环节,包括日志信息的采集与解析、日志监控指标分析以及日志告警策略设计。

## 3.1 日志信息的采集与解析

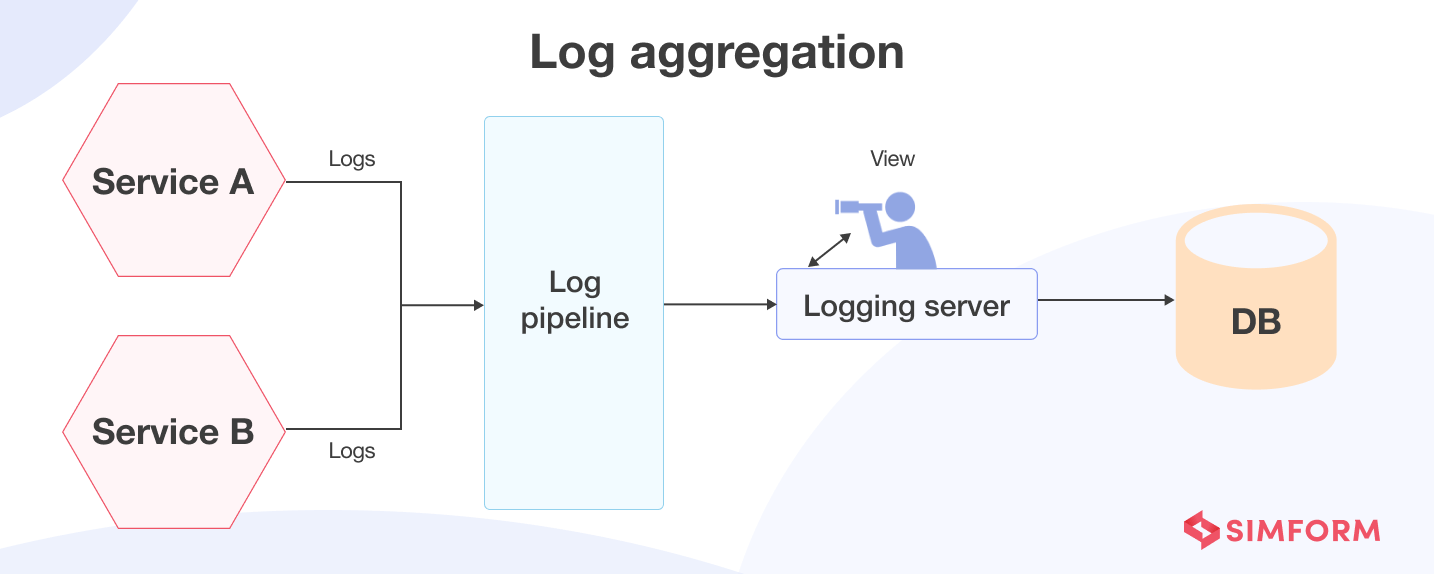

日志信息采集是日志监控的第一步,涉及到从各种日志源中提取日志数据。结构化处理这些信息以便于后续的分析和告警则是核心任务。

### 3.1.1 日志信息的提取方法

日志数据的来源多种多样,包括操作系统日志、应用服务器日志、数据库日志等。提取这些日志信息的方法主要分为两类:主动推送和被动拉取。

- **主动推送**:日志系统配置好后,日志数据会定期或实时地被发送到指定的日志中心。如使用Logstash配合Filebeat来实时收集文件系统中的日志数据并推送至Elasticsearch。

- **被动拉取**:通过定时任务或服务监控机制来检查日志文件的更新,如使用Linux的cron任务定期执行脚本来读取日志文件,并将其内容发送到日志中心。

为了保证数据的完整性,通常会结合以上两种方法,例如在应用程序中实现日志的主动推送,同时在服务器级别使用被动拉取的方式作为补充。

### 3.1.2 日志信息的结构化处理

结构化处理是将非结构化的日志数据转换为结构化的格式,比如JSON。结构化的好处在于方便后续的数据分析和检索。

结构化通常包括以下几个步骤:

1. **日志模式定义**:为日志数据定义一个模式(Schema),明确每个字段的数据类型和含义。

2. **数据映射**:将原始日志数据中的信息映射到预先定义好的模式中。

3. **数据转换**:如果模式中包含转换逻辑(如时间格式化、字段值转换等),则执行相应的转换操作。

```json

{

"level": "INFO",

"timestamp": "2023-04-01T12:00:00Z",

"thread": "main",

"class": "com.example.MyClass",

"message": "User login successful",

"context": {

"userId": 123,

"ipAddress": "***.***.*.*"

}

}

```

上例展示了一个结构化后的日志条目,其包含日志级别、时间戳、线程名、类名、消息和上下文信息。

## 3.2 日志监控指标分析

监控指标是衡量系统健康状况的重要指标,能够帮助我们从日志数据中抽取关键信息,快速定位问题所在。

### 3.2.1 常见的日志监控指标

日志监控指标通常包括但不限于以下内容:

- **错误和异常数量**:对错误日志和异常进行计数。

- **响应时间**:记录请求的响应时间,分析系统性能。

- **服务调用次数**:统计服务调用的频率。

- **用户行为模式**:通过日志分析用户的行为习惯。

- **资源使用情况**:监控CPU、内存和磁盘的使用率。

- **日志事件分布**:统计不同日志事件的分布比例。

### 3.2.2 日志指标的计算和分析方法

指标的计算可以通过日志分析工具实现,如使用ELK Stack(Elasticsearch、Logstash、Kibana)进行实时分析。

计算和分析的过程通常涉及以下步骤:

1. **日志数据的聚合**:根

0

0