【预测未来趋势】:最小二乘法在时间序列分析中的精妙应用

发布时间: 2024-12-27 01:43:16 阅读量: 6 订阅数: 7

磁盘IO的艺术调度:ionice在Linux中的精妙应用

# 摘要

本论文深入探讨了最小二乘法在时间序列分析中的关键作用,以及在理论基础、实践应用和高级应用方面的具体应用。首先介绍了时间序列分析的理论基础,包括数据特性和最小二乘法的基本原理。随后,论文转向最小二乘法在实际问题中的应用,涵盖了数据预处理、模型训练、参数优化以及预测结果的评估和应用场景。文章进一步阐述了最小二乘法在多变量时间序列分析、时变参数模型以及行业预测中的高级应用。最后,本文对最小二乘法与机器学习的融合、时间序列分析的新挑战与机遇以及未来的研究方向和技术发展进行了展望。本文的目的是为读者提供一个全面了解最小二乘法在时间序列分析中应用的视角,并指明未来研究与技术发展的方向。

# 关键字

最小二乘法;时间序列分析;数据预处理;模型训练;预测评估;机器学习融合

参考资源链接:[整体最小二乘法:原理、应用与误差处理](https://wenku.csdn.net/doc/18zeo82php?spm=1055.2635.3001.10343)

# 1. 最小二乘法在时间序列分析中的角色

## 引言

在数据分析与预测领域,时间序列分析作为一种强大的工具,能够帮助我们从历史数据中发现模式,并据此预测未来的趋势。在众多时间序列分析方法中,最小二乘法(Least Squares Method)扮演着核心角色。它不仅历史悠久,而且在实际应用中,通过最小化误差的平方和,为模型参数提供了可靠的估计。

## 最小二乘法简介

最小二乘法是数学和统计学中用于数据分析的一种优化技术。它通过最小化误差的平方和,从而找到数据的最佳函数匹配。在时间序列分析中,它常用于参数估计和趋势预测。这种方法的优势在于其数学理论的严密性和广泛适用性,使得它能够应用于各种线性及非线性模型的构建和优化。

## 时间序列分析的重要性

时间序列分析是分析时间顺序数据点,预测未来时间点数据走向的重要技术。它被广泛应用于金融市场预测、经济分析、信号处理、气象预测等领域。最小二乘法在此分析中,通过拟合历史数据,为时间序列的建模提供了数学基础,允许分析师创建更为精确的预测模型。在接下来的章节中,我们将详细介绍时间序列分析的理论基础以及最小二乘法如何在其中发挥作用。

# 2. 时间序列分析的理论基础

### 2.1 时间序列数据的特性

时间序列数据是按时间顺序排列的数据点的集合,它记录了一个变量在不同时间点的观测值。理解时间序列数据的特性是构建有效预测模型的基础。

#### 2.1.1 稳定性与非稳定性时间序列

稳定性是时间序列分析中的一个关键概念。一个稳定的时间序列指的是其统计特性不随时间改变,比如具有恒定的均值、方差和自相关性。如果一个时间序列的这些统计特性随时间变化,则该序列是非稳定的。

理解稳定性与非稳定性对于时间序列分析至关重要,因为大多数预测方法都假设数据是稳定的。非稳定性序列需要通过差分或其他转换方法来达到稳定状态。

```mermaid

flowchart LR

A[原始时间序列] -->|差分| B[一阶差分序列]

B -->|检查稳定性| C{是否稳定?}

C -->|否| D[进一步差分或转换]

C -->|是| E[进行模型拟合]

```

### 2.1.2 趋势、季节性与周期性分析

时间序列数据通常表现出趋势、季节性和周期性特征。

- **趋势**指的是时间序列的长期上升或下降的运动。它可以通过绘制时间序列图来观察,也可以通过移动平均或多项式拟合来识别。

- **季节性**指的是在固定周期内重复出现的模式。识别季节性组件对于季节性调整和预测未来值是必要的。

- **周期性**与季节性类似,但它指的是更长周期的模式。周期性波动不一定有固定的时间长度。

在实际应用中,通过季节性分解技术,如X-11或STL分解方法,可以将时间序列分解为趋势、季节性和随机成分。这有助于对每个成分单独建模和预测。

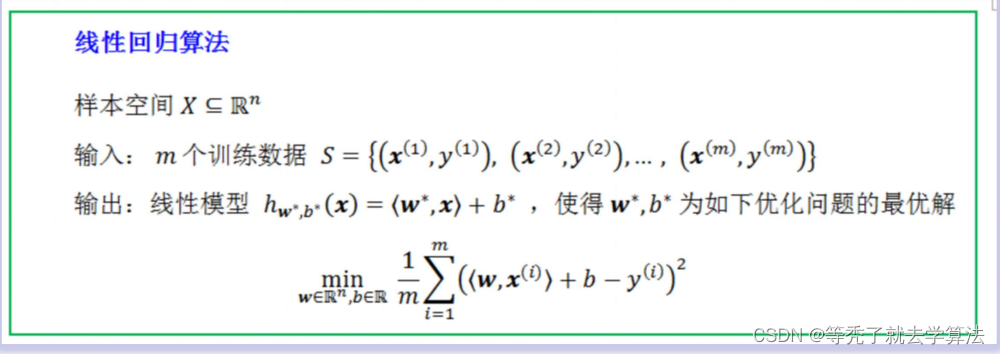

### 2.2 最小二乘法的基本原理

#### 2.2.1 最小二乘法的数学定义

最小二乘法是一种数学优化技术,它通过最小化误差的平方和来寻找数据的最佳函数匹配。在时间序列分析中,最小二乘法常用于线性回归模型的参数估计。

假设我们有一组观测数据点 \( (x_i, y_i) \),我们想要找到最佳的线性关系 \( y = mx + b \),其中 \( m \) 和 \( b \) 是模型参数。最小二乘法的目标是最小化所有观测点的残差平方和,即:

\[ S(m, b) = \sum_{i=1}^{n}(y_i - (mx_i + b))^2 \]

通过计算偏导数并令它们等于零,可以找到 \( S(m, b) \) 的最小值,从而得到参数 \( m \) 和 \( b \) 的估计值。

#### 2.2.2 参数估计与误差分析

在最小二乘法中,参数估计的结果取决于数据本身以及模型的形式。最小二乘法的一个重要特征是它为参数估计提供了精确的数学表达式,这些表达式是数据的函数。

误差分析在最小二乘法中也非常关键。误差通常用残差(观测值与预测值之间的差异)来表示。通过分析残差图和计算残差的统计特性(如均值、方差和自相关性),可以评估模型的适用性和预测能力。

### 2.3 时间序列预测模型的构建

#### 2.3.1 线性回归模型

线性回归模型是最简单的预测模型之一,适用于寻找时间序列数据中的线性关系。模型形式如下:

\[ y_t = \beta_0 + \beta_1x_{t1} + \beta_2x_{t2} + \ldots + \beta_kx_{tk} + \epsilon_t \]

其中 \( y_t \) 是时间点 \( t \) 的因变量,\( x_{t1}, x_{t2}, \ldots, x_{tk} \) 是自变量,\( \beta_0, \beta_1, \ldots, \beta_k \) 是模型参数,而 \( \epsilon_t \) 是误差项。

#### 2.3.2 自回归模型与移动平均模型

除了线性回归模型,时间序列分析中还有其他两种基本模型:自回归(AR)模型和移动平均(MA)模型。

自回归模型假设时间序列当前值与其历史值相关。其一般形式为:

\[ y_t = c + \phi_1y_{t-1} + \phi_2y_{t-2} + \ldots + \phi_py_{t-p} + \epsilon_t \]

其中 \( p \) 是模型的阶数,\( \phi_1, \phi_2, \ldots, \phi_p \) 是自回归系数,而 \( c \) 是常数项。

移动平均模型则是通过将当前观测值与前 \( q \) 个观测值的误差项的线性组合来表达时间序列值。其形式为:

\[ y_t = \mu + \epsilon_t + \theta_1\epsilon_{t-1} + \theta_2\epsilon_{t-2} + \ldots + \theta_q\epsilon_{t-q} \]

其中 \( \mu \) 是时间序列的均值,\( \theta_1, \theta_2, \ldots, \theta_q \) 是移动平均系数。

通过自回归和移动平均模型,可以捕捉时间序列数据中的时间依赖结构,但它们各自也有局限性。自回归模型不能很好地处理误差项的自相关性,而移动平均模型可能过度依赖近期的数据。因此,这两个模型常被结合起来形成自回归移动平均(ARMA)模型,以获得更好的预测效果。

# 3. 最小二乘法在时间序列中的实践应用

## 3.1 数据预处理与特征提取

### 3.1.1 数据清洗与异常值处理

在时间序列分析中,数据的准确性和完整性对结果的影响极大。数据清洗与异常值处理是确保数据质量的重要步骤。首先,我们需要检查数据集中的缺失值,并根据具体情况进行填充或删除。缺失值可以通过插值、使用平均值或中位数等方式来处理。例如,在Python的pandas库中,可以使用`fillna()`函数来填充缺失值。

```python

import pandas as pd

import numpy as np

# 创建一个带有缺失值的数据集

data = pd.DataFrame({

'time': pd.date_range(start='2021-01-01', periods=10, freq='D'),

'value': [10, 11, np.nan, 13, 14, 15, np.nan, 17, 18, 19]

})

# 使用前一个值填充缺失值

data['value'].fillna(method='ffill', inplace=True)

# 输出处理后的数据集

print(data)

```

接下来,异常值的检测和处理也是数据清洗的关键环节。异常值可能会严重扭曲模型的预测结果。通常可以通过箱线图(Boxplot)来识别异常值,然后决定是删除这些值还是进行适当的转换。

```python

import seaborn as sns

import matplotlib.pyplot as plt

# 绘制箱线图

sns.boxplot(data['value'])

plt.show()

# 删除异常值

data = data[~((data['value'] < data['value'].quantile(0.25) - 1.5 * data['value'].quantile(0.75)) |

(data['value'] > data['value'].quantile(0.75) + 1.5 * data['value'].quantile(0.75)))]

```

通过上述步骤,我们可以得到一个经过清洗的数据集,为后续的特征提取和模型训练打下坚实的基础。

### 3.1.2 特征工程与变量选择

特征工程是指使用领域知识和数据转换技术,从原始数据中构造出对预测模型更有用的特征的过程。在时间序列分析中,特征工程不仅包括构造时间相关的特征(如滞后特征、滑动平均等),还包括周期性特征的创建和时间相关性的捕捉。

滞后特征是将前一时间点的数据作为当前时间点预测的输入特征,这在自回归模型中尤为常见。

```py

```

0

0