Java中的数据结构选择:哈希表VS树结构VS数组

发布时间: 2024-08-29 20:50:38 阅读量: 54 订阅数: 27

java数据结构和算法中哈希表知识点详解

# 1. 数据结构基础与Java实现概述

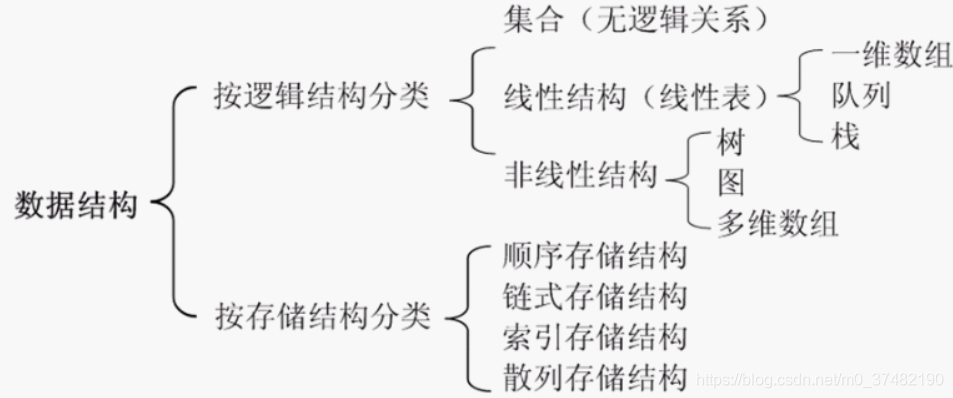

在现代编程实践中,数据结构作为存储数据的逻辑结构和操作这些数据的算法的集合,是软件开发的核心基础。Java语言由于其简洁性和强大的抽象能力,成为了实现数据结构和算法的优选语言之一。本章旨在为读者提供一个数据结构的基础框架,特别是其在Java环境中的实现方式。我们首先从基础概念谈起,包括数组、链表、栈、队列等线性结构的定义与特性。随后,我们会深入探讨树和图这样的非线性结构,并且说明如何在Java中高效地实现和使用这些数据结构。通过本章的学习,读者将对数据结构有更深层次的理解,为进一步掌握复杂系统设计打下坚实基础。

# 2. 哈希表在Java中的应用

## 2.1 哈希表的基本原理与实现

### 2.1.1 哈希函数的构建与选择

哈希表是一种以键-值(key-value)存储数据的数据结构,它使用哈希函数将键映射到表中的位置以获取值。哈希函数的设计是哈希表中至关重要的部分,一个优秀的哈希函数能够减少冲突并提高数据检索的效率。

在Java中实现哈希表,通常我们会定义一个哈希函数,该函数会将输入的键转换为数组的索引。一个好的哈希函数需满足以下条件:

- 计算简便:函数应足够简单,以便快速计算索引值。

- 分布均匀:不同的键应该映射到不同的索引上,或者至少分散在不同的索引上,从而减少冲突的可能性。

- 适应性强:对输入数据的分布有良好的适应性。

一个基本的哈希函数可以是模运算(例如,`index = key % array.length`),但这种简单的哈希函数很容易产生冲突,尤其是当表大小和键的范围之间存在关系时。

在Java中,我们可以通过覆盖`Object`类中的`hashCode()`方法来自定义哈希函数。例如:

```java

@Override

public int hashCode() {

return Objects.hash(field1, field2, ..., fieldN);

}

```

这里使用了`Objects.hash()`方法,它会根据给定的多个参数计算出一个哈希码。`Objects.hash()`方法内部实际上通过数组和循环构建了一个简单的哈希函数。

### 2.1.2 冲突解决机制

冲突解决是哈希表设计中的另一个关键问题。当两个不同的键通过哈希函数计算得到相同的数组索引时,就会发生冲突。冲突解决机制的目的是处理这些索引相同的键值对。

在Java中,常用冲突解决机制有:

- 开放寻址法:当发现冲突时,按照某种规则在表内继续寻找下一个空的位置。

- 链接法(拉链法):为哈希表的每一个位置设计一个链表,当出现冲突时,将数据项作为节点添加到对应位置的链表中。

Java内置的`HashMap`类使用了链接法来解决冲突。其底层通过一个数组存储键值对,每个数组元素是一个链表的头节点,当出现冲突时,将节点添加到对应的链表中。

## 2.2 哈希表的性能分析与优化

### 2.2.1 时间复杂度与空间复杂度

哈希表的性能分析主要涉及时间复杂度和空间复杂度。

- 时间复杂度:理想情况下,哈希表的查找、插入和删除操作的时间复杂度都是O(1)。然而,这依赖于哈希函数的好坏和冲突处理策略。在最坏的情况下,比如所有的键都冲突到了同一个位置,时间复杂度会退化到O(n)。

- 空间复杂度:哈希表的空间复杂度与表的大小直接相关。为了减少冲突,通常会预留一些空间,这意味着哈希表占用的空间会比实际存储的数据多。

### 2.2.2 Java内置哈希表结构:HashMap与HashTable

Java提供了两个内置的哈希表结构:`HashMap`和`HashTable`。

- `HashMap`:非同步的哈希表实现,允许使用`null`键和`null`值。它使用链接法解决冲突。

- `HashTable`:同步的哈希表实现,不允许使用`null`键和`null`值。由于是线程安全的,`HashTable`比`HashMap`的性能稍低。

在选择使用哪个类时,主要根据是否需要线程安全和是否允许`null`值来决定。

## 2.3 哈希表的实际应用案例

### 2.3.1 高效的数据缓存存储

哈希表在数据缓存存储方面非常有效,它可以快速定位数据的位置,并提供O(1)的访问时间。使用哈希表缓存数据时,可以将缓存项的唯一标识符(如URL或者对象ID)作为键,将缓存数据作为值。

例如,一个Web服务器可能会使用哈希表来缓存频繁请求的页面:

```java

Map<String, String> cache = new HashMap<>();

String url = "/index.html";

String pageContent = cache.get(url);

if (pageContent == null) {

pageContent = fetchDataFromDatabase(url);

cache.put(url, pageContent);

}

```

### 2.3.2 快速的键值对映射实现

哈希表在需要快速键值对映射的场景中也非常有用。例如,构建一个URL映射到处理函数的映射表:

```java

Map<String, Runnable> urlHandlers = new HashMap<>();

urlHandlers.put("/home", () -> show

```

0

0