Java集合框架专题:Java 9增强集合功能的实战应用指南

发布时间: 2024-10-19 07:35:10 阅读量: 19 订阅数: 26

Java编程语言详解与实战指南:从基础到进阶

# 1. Java集合框架概述

在Java编程的世界里,集合框架一直是构建应用程序和处理数据的基础。它是Java开发者必须熟练掌握的核心知识之一。集合框架不仅仅是一组可用的集合类型,更是一套丰富的接口和类的设计,为存储和操作对象群集提供了统一的标准。

集合框架为不同类型的集合提供了一套丰富的抽象数据类型(ADT),这些数据类型可以用来存储和访问数据集合。例如,List接口可以保证数据的有序性,而Set接口则保证了元素的唯一性。Map接口则提供了一种将键映射到值的存储方式。

本章将带您了解Java集合框架的基础知识,并简要介绍其重要性,为后续章节中更深入的探讨奠定基础。了解集合框架的工作原理和最佳实践对于编写高效、可维护的代码至关重要。我们将从核心集合接口开始,逐步深入探索Java集合框架的内部工作原理和使用技巧。

# 2. Java 9之前的集合框架详解

Java集合框架作为整个Java平台的核心组件之一,提供了丰富的数据结构和算法,用于操作数据集合。在Java 9之前,集合框架主要包括一系列接口、类和算法。这一章节将深入剖析这些核心组件,从集合框架的核心接口到常用集合类的实现和性能分析,为理解Java 9对集合框架的增强提供坚实的基础。

## 2.1 集合框架的核心接口

### 2.1.1 List、Set和Map接口的特性和使用场景

在Java集合框架中,List、Set和Map接口是最核心的三个接口,它们各自有不同的特性和适用场景。

- **List接口**:List接口是一个有序集合,可以包含重复元素。它支持快速访问元素,并且可以插入和删除特定位置的元素。在需要按照元素插入的顺序遍历元素时,List接口是最佳选择。常见的实现类包括ArrayList和LinkedList。

- **Set接口**:Set接口是一个不允许包含重复元素的集合。它主要用于进行数学上的集合运算,如并集、交集和差集等。Set接口的典型实现包括HashSet和LinkedHashSet。HashSet提供了基于哈希表的快速查找能力,而LinkedHashSet则通过维护一个双向链表来保持插入顺序。

- **Map接口**:Map接口是一个映射关系的集合,它存储键值对,并且保证了键的唯一性。Map接口并不继承自Collection接口,而是由一系列实现类如HashMap和Hashtable来提供具体的实现。Map非常适合需要查找元素的场景,比如缓存数据、键值对应等。

### 2.1.2 迭代器、比较器和集合的算法操作

在Java集合框架中,迭代器(Iterator)是遍历集合的通用方式,允许对集合元素进行读取和删除操作。而比较器(Comparator)则是用于在不修改原有对象代码的情况下,对对象进行排序的接口。

- **迭代器**:它为集合提供了一种统一的遍历方式,避免了对集合内部结构的直接暴露。使用迭代器遍历集合时,可以安全地进行元素的删除操作。

- **比较器**:当集合中的元素类型没有自然排序或者需要按照特定的规则进行排序时,可以提供一个Comparator来实现排序逻辑。例如,TreeSet和TreeMap就依赖于Comparator来维护元素的排序状态。

- **集合的算法操作**:Java集合框架还提供了一组算法操作,如Collections类中的sort、binarySearch、reverse等方法,用于对集合进行排序和搜索等操作。

### 2.2 常用集合类的内部实现和性能分析

在深入了解集合类的内部实现和性能分析之前,了解它们的设计动机和使用场景是非常必要的。Java集合框架允许开发者根据不同的需求选择合适的集合实现类。

#### 2.2.1 ArrayList和LinkedList的对比

- **ArrayList**:基于动态数组数据结构实现,提供了快速的随机访问和尾部添加删除操作,但在非尾部的插入删除操作中性能较低。ArrayList适合用于快速检索和频繁的尾部操作。

- **LinkedList**:基于双向链表数据结构实现,提供了常量时间的插入和删除操作(非首尾元素除外),但在随机访问元素时性能较低。LinkedList适合用于插入和删除操作频繁的场景。

```java

// 示例代码:ArrayList和LinkedList的性能测试

import java.util.ArrayList;

import java.util.LinkedList;

import java.util.List;

public class ListPerformanceTest {

public static void main(String[] args) {

List<Integer> arrayList = new ArrayList<>();

List<Integer> linkedList = new LinkedList<>();

long startTime, endTime;

final int NUM_INSERTIONS = 100000;

startTime = System.nanoTime();

for (int i = 0; i < NUM_INSERTIONS; i++) {

arrayList.add(i);

}

endTime = System.nanoTime();

System.out.println("ArrayList insertions took " + (endTime - startTime) + "ns");

startTime = System.nanoTime();

for (int i = 0; i < NUM_INSERTIONS; i++) {

linkedList.add(i);

}

endTime = System.nanoTime();

System.out.println("LinkedList insertions took " + (endTime - startTime) + "ns");

}

}

```

#### 2.2.2 HashMap和Hashtable的区别与性能优化

- **HashMap**:基于散列表实现,允许null键和多个null值。HashMap不是同步的,适用于单线程环境,或在保证外部同步的情况下多线程使用。

- **Hashtable**:是同步的,但不支持null键和null值。Hashtable是遗留的类,现在推荐使用HashMap。

HashMap的性能在多数情况下是优异的,但若经常发生哈希碰撞,则性能下降。为优化性能,可以调整初始容量和加载因子。

```java

// 示例代码:HashMap性能测试

import java.util.HashMap;

import java.util.Map;

public class MapPerformanceTest {

public static void main(String[] args) {

Map<Integer, Integer> map = new HashMap<>();

long startTime, endTime;

final int NUM_OPERATIONS = 100000;

startTime = System.nanoTime();

for (int i = 0; i < NUM_OPERATIONS; i++) {

map.put(i, i);

}

endTime = System.nanoTime();

System.out.println("HashMap put operations took " + (endTime - startTime) + "ns");

}

}

```

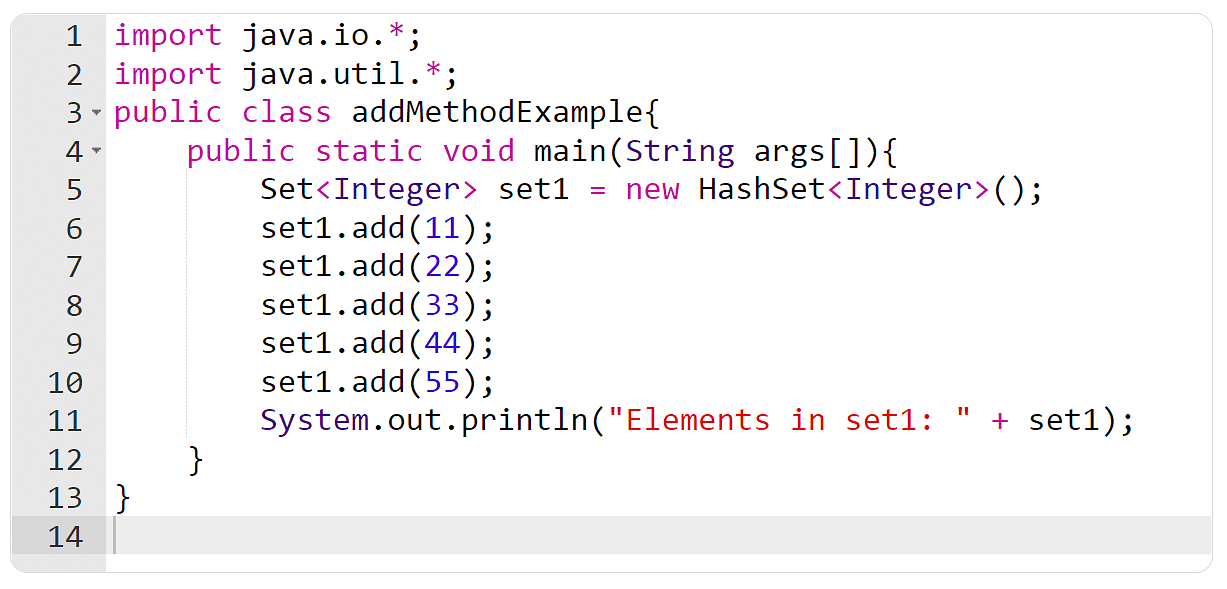

#### 2.2.3 HashSet和LinkedHashSet的原理与应用

- **HashSet**:内部通过HashMap实现,提供了快速查找的能力。HashSet的迭代顺序并不保证元素的顺序。

- **LinkedHashSet**:继承自HashSet,并通过维护一个双向链表来保持插入顺序。LinkedHashSet在遍历时能够保持元素的插入顺序,适用于需要维持插入顺序的场景。

在使用HashSet和LinkedHashSet时,应注意它们的元素唯一性约束,以及性能优化的考虑,如选择合适的初始容量。

```java

// 示例代码:HashSet与LinkedHashSet的性能比较

import java.util.HashSet;

import java.util.LinkedHashSet;

import java.

```

0

0