YOLO目标检测在智能家居领域的应用:物体识别与控制(智能家居新利器)

发布时间: 2024-08-15 06:08:51 阅读量: 166 订阅数: 45

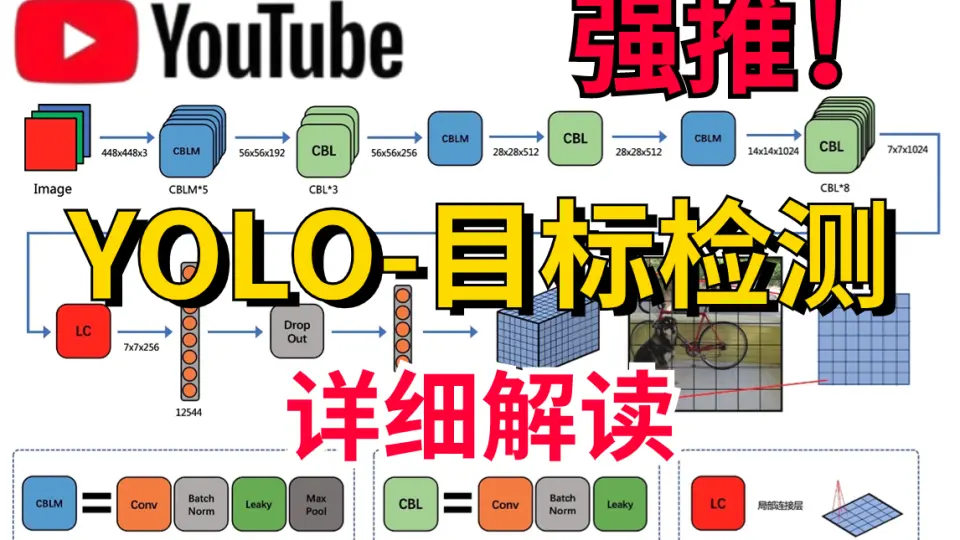

图像识别领域YOLO目标检测算法的机制解析与应用场景

1. YOLO目标检测概述**

YOLO(You Only Look Once)是一种单阶段目标检测算法,它在计算机视觉领域取得了突破性的进展。与传统的两阶段检测算法不同,YOLO直接将图像划分为网格,并预测每个网格单元中是否存在目标以及目标的类别和位置。这种单次预测的方式大大提高了检测速度,同时保持了较高的准确性。

YOLO算法主要包括以下几个关键模块:

- **主干网络:**负责提取图像特征,通常采用预训练的卷积神经网络,如ResNet或DarkNet。

- **检测头:**在主干网络提取的特征图上进行预测,输出每个网格单元的目标类别、位置和置信度。

- **非极大值抑制(NMS):**通过比较预测框的重叠程度,去除重复的检测结果,保留置信度最高的检测框。

2. YOLO目标检测在智能家居中的应用

2.1 物体识别在智能家居中的应用场景

2.1.1 智能安防

物体识别在智能安防中的应用场景主要包括:

- **入侵检测和报警:**通过识别进入特定区域或越过警戒线的可疑物体,及时触发报警并通知相关人员。

- **异常行为识别:**识别并分析监控画面中异常的人员行为,例如跌倒、徘徊或打斗,并及时采取相应措施。

2.1.2 智能交互

物体识别在智能交互中的应用场景主要包括:

- **手势控制:**识别用户的手势动作,并将其转换为控制指令,实现对智能家居设备的非接触式控制。

- **语音控制:**识别用户的语音指令,并将其转换为控制指令,实现对智能家居设备的语音控制。

2.2 YOLO目标检测在物体识别中的优势

2.2.1 实时性和准确性

YOLO(You Only Look Once)目标检测算法是一种单次卷积神经网络,能够在一次前向传播中同时预测目标的类别和位置。与传统的目标检测算法相比,YOLO具有以下优势:

- **实时性:**YOLO算法的推理速度非常快,可以达到每秒处理数十帧图像,满足智能家居中实时物体识别的需求。

- **准确性:**YOLO算法的检测准确率较高,能够准确识别不同类别和形状的物体,满足智能家居中物体识别的高精度要求。

2.2.2 跨平台和低资源消耗

YOLO算法具有良好的跨平台性和低资源消耗特点:

- **跨平台:**YOLO算法可以在不同的硬件平台上部署,包括嵌入式设备、移动设备和服务器,满足智能家居中不同场景的部署需求。

- **低资源消耗:**YOLO算法的模型相对较小,并且推理过程所需的计算资源较少,适合在资源受限的智能家居设备上部署。

代码示例:YOLO目标检测模型在智能家居中的应用

代码逻辑分析:

- 加载 YOLO 模型,初始化摄像头。

- 循环读取摄像头帧。

- 将图像转换为 YOLO 模型输入格式。

- 将 blob 输入 YOLO 模型,进行前向传播。

- 遍历检测结果,获取检测到的物体的类别和置信度。

- 如果置信度大于阈值,则绘制边界框。

- 显示帧,按键退出。

参数说明:

yolov3.weights:YOLO 模型权重文件路径。yolov3.cfg:YOLO 模型配置文件路径。0:摄像头索引,0 表示默认摄像头。1 / 255.0:图像归一化因子。(416, 416):YOLO 模型输入图像大小。(0, 0, 0):图像均值。swapRB=True:交换图像通道顺序。crop=False:不裁剪图像。0.5:置信度阈值。

3.1 YOLO目标检测模型的训练

3.1.1 数据集的准备

训练YOLO目标检测模型需要一个高质量的训练数据集。该数据集应包含大量标记良好的图像,其中包含模型需要检测的目标对象。数据集的质量和大小直接影响模型的性能。

数据集准备步骤:

- **收集图像:**从各种来源收集图像,例如互联网、摄像头和传感器。确保图像具有多样性,包括不同光照条件、背景和目标对象姿势。

- **标注图像:**使用图像标注工具(例如LabelImg或CVAT)对图像中的目标对象进行标注。标注应准确,包括对象的边界框和类别标签。

- **划分数据集:**将数据集划分为训练集、验证集和测试集。训练集用于训练模型,验证集用于评估模型的性能,测试集用于最终评估训练好的模型。

3.1.2 模型的训练和优化

YOLO目标检测模型的训练是一个迭代的过程,涉及以下步骤:

- **初始化模型:**使用预训练的模

0

0