MongoDB数据库复制原理与配置详解:数据同步的利器,助你实现MongoDB数据库高可用

发布时间: 2024-07-04 10:33:15 阅读量: 45 订阅数: 23

# 1. MongoDB复制概述**

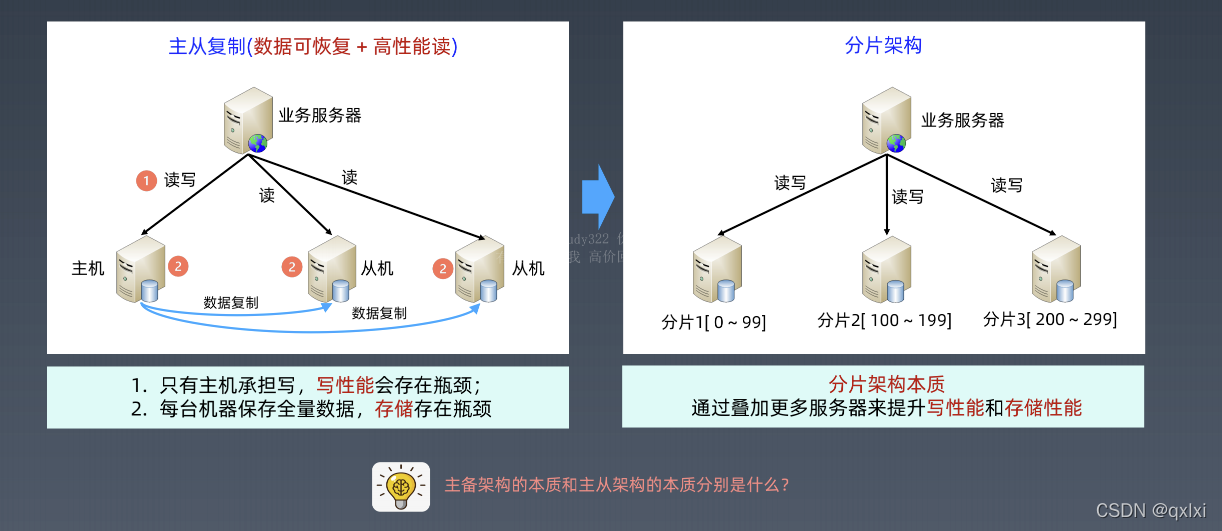

MongoDB复制是一种数据冗余机制,它允许在多个服务器上创建和维护数据库的副本。通过复制,可以在提高数据可用性和容错性的同时,实现读写分离和负载均衡。

MongoDB复制基于复制集实现,复制集是一个由一个主节点和多个从节点组成的逻辑组。主节点负责接收和处理写操作,并将更改复制到从节点。从节点保持与主节点的同步,并提供读操作服务。

# 2. MongoDB复制理论

### 2.1 复制集架构和概念

#### 2.1.1 主节点和从节点

MongoDB复制集由一个主节点和多个从节点组成。主节点负责接收写入操作并将其复制到从节点。从节点从主节点接收复制操作,并应用这些操作到自己的数据副本中。

#### 2.1.2 复制集仲裁器

复制集仲裁器是一个特殊类型的节点,它不存储数据,但负责选举主节点。当主节点出现故障时,仲裁器将选举一个新的主节点。

### 2.2 复制过程和数据同步

#### 2.2.1 日志复制原理

MongoDB使用操作日志(oplog)来实现复制。oplog记录了所有写入操作,并按顺序存储。从节点从主节点的oplog中读取操作,并应用这些操作到自己的数据副本中。

#### 2.2.2 数据一致性保证

MongoDB复制提供了两种数据一致性级别:

- **强一致性:**写入操作在主节点上提交后,立即在所有从节点上可见。

- **最终一致性:**写入操作在主节点上提交后,最终将在所有从节点上可见,但可能存在短暂的延迟。

**代码块:**

```javascript

// 初始化复制集

rs.initiate({

_id: "myReplSet",

members: [

{ _id: 0, host: "mongo1.example.com" },

{ _id: 1, host: "mongo2.example.com" },

{ _id: 2, host: "mongo3.example.com", arbiterOnly: true }

]

});

```

**逻辑分析:**

这段代码使用`rs.initiate()`方法初始化了一个名为“myReplSet”的复制集。该复制集由三个成员组成:两个数据节点(mongo1和mongo2)和一个仲裁器(mongo3)。

**参数说明:**

- `_id`:成员的唯一标识符。

- `host`:成员的IP地址或主机名。

- `arbiterOnly`:指定成员是否为仲裁器。

**表格:**

| 一致性级别 | 描述 |

|---|---|

| 强一致性 | 写入操作在主节点上提交后,立即在所有从节点上可见。 |

| 最终一致性 | 写入操作在主节点上提交后,最终将在所有从节点上可见,但可能存在短暂的延迟。 |

**Mermaid流程图:**

```mermaid

graph LR

subgraph 主节点

A[主节点]

end

subgraph 从节点

B[从节点1]

C[从节点2]

end

subgraph 仲裁器

D[仲裁器]

end

A --> B

A --> C

D --> A

```

**流程图分析:**

此流程图显示了复制集的架构。主节点(A)接收写入操作并将其复制到从节点(B和C)。仲裁器(D)负责选举主节点。

# 3. MongoDB复制实践

### 3.1 复制集创建和配置

#### 3.1.1 复制集初始化

**创建复制集:**

```

rs.initiate({

_id: "myReplSet",

members: [

{ _id: 0, host: "primary.example.com" },

{ _id: 1, host: "secondary1.example.com" },

{ _id: 2, host: "secondary2.example.com" }

]

})

```

**参数说明:**

* `_id`: 复制集的唯一标识符

* `members`: 复制集成员列表,包括主节点和从节点

**执行逻辑:**

此命令将在指定的主节点上初始化复制集,并添加从节点。

#### 3.1.2 节点加入和移除

**添加节点:**

```

rs.add("secondary3.example.com")

```

**移除节点:**

```

rs.remove("secondary2.example.com")

```

**执行逻辑:**

* `rs.add()`:将新节点添加到复制集。

* `rs.remove()`:从复制集中移除节点。

### 3.2 复制集监控和管理

#### 3.2.1 复制集状态查询

**获取复制集状态:**

```

rs.status()

```

**输出示例:**

```

{

"set": "myReplSet",

"date": "2023-03-08T16:30:00Z",

"members": [

{

"_id": 0,

"name": "primary.example.com",

"health": 1,

"state": 1,

"uptime": 10000,

"optime": {

"ts": "2023-03-08T16:29:59.999Z",

"t": 1678303399

}

},

{

"_id": 1,

"name": "secondary1.example.com",

"health": 1,

"state": 2,

"uptime": 9000,

"optime": {

"ts": "2023-03-08T16:29:59.999Z",

"t": 1678303399

}

},

{

"_id": 2,

"name": "secondary2.example.com",

"health": 0,

"state": 9,

"uptime": 0,

"optime": {

"ts": "2023-03-08T16:29:59.999Z",

"t": 1678303399

}

}

]

}

```

**参数说明:**

* `health`: 节点的健康状态(0:不健康,1:健康)

* `state`: 节点的状态(1:主节点,2:从节点,9:已移除)

* `uptime`: 节点在线时间(毫秒)

* `optime`: 节点复制进度(时间戳和术语)

#### 3.2.2 故障恢复和数据修复

**故障恢复:**

MongoDB自动检测和恢复故障,包括主节点故障、从节点故障等。

**数据修复:**

```

rs.recover()

```

**执行逻辑:**

此命令将尝试修复复制集中的数据不一致性。

# 4. MongoDB复制高级应用

本章节将介绍MongoDB复制的高级应用,包括读写分离和负载均衡、自动故障转移和高可用等内容。

### 4.1 读写分离和负载均衡

**4.1.1 读写分离机制**

读写分离是一种将读操作和写操作分开处理的机制,可以有效地提高数据库的并发性和性能。在MongoDB复制环境中,可以将从节点专门用于处理读操作,而将写操作集中在主节点上。

读写分离的实现方式是通过MongoDB的mongos路由器。mongos是一个代理服务器,它负责将客户端请求路由到适当的节点。对于读操作,mongos会将请求路由到从节点,而对于写操作,则会路由到主节点。

**4.1.2 负载均衡策略**

负载均衡策略决定了mongos如何将请求分配给不同的从节点。MongoDB提供了多种负载均衡策略,包括:

* **轮询:**将请求平均分配给所有可用从节点。

* **随机:**随机选择一个可用从节点。

* **最近最少使用(LRU):**将请求优先分配给最近最少使用的从节点。

* **自定义:**允许用户自定义负载均衡算法。

### 4.2 自动故障转移和高可用

**4.2.1 自动故障转移原理**

自动故障转移是MongoDB复制的一项重要特性,它可以确保在主节点发生故障时,复制集能够自动切换到新的主节点。

故障转移过程如下:

1. 当主节点发生故障时,仲裁器会检测到故障并触发选举。

2. 复制集中的从节点会参与选举,并投票选出一个新的主节点。

3. 新的主节点被选出后,会接管复制集并继续提供服务。

**4.2.2 高可用配置实践**

为了提高MongoDB复制的高可用性,可以采用以下配置实践:

* **使用奇数个节点:**奇数个节点可以防止选举出现平局。

* **启用仲裁器:**仲裁器负责协调选举过程,确保故障转移的顺利进行。

* **使用复制集标签:**复制集标签可以将复制集中的节点分组,并指定每个组的优先级。

* **配置优先级:**每个节点都可以配置优先级,优先级较高的节点更有可能被选为主节点。

### 代码示例

**代码块 1:创建读写分离配置**

```

mongos --configdb rs0/host1:27017,host2:27018,host3:27019 --shardsvr rs1/host4:27017,host5:27018,host6:27019

```

**逻辑分析:**

此代码创建了一个mongos路由器,并指定了复制集rs0和rs1作为配置数据库和分片服务器。

**代码块 2:设置负载均衡策略**

```

mongos --configdb rs0/host1:27017,host2:27018,host3:27019 --shardsvr rs1/host4:27017,host5:27018,host6:27019 --loadBalancerStrategy lru

```

**逻辑分析:**

此代码设置了负载均衡策略为LRU,即最近最少使用。

**代码块 3:配置自动故障转移**

```

rs.conf()

{

_id: "rs0",

members: [

{ _id: 0, host: "host1:27017", priority: 2 },

{ _id: 1, host: "host2:27018", priority: 1 },

{ _id: 2, host: "host3:27019", priority: 1 }

]

}

```

**逻辑分析:**

此代码配置了复制集rs0,并指定了每个节点的优先级。优先级较高的节点更有可能被选为主节点。

### 流程图

**流程图 1:自动故障转移过程**

```mermaid

graph LR

subgraph 主节点故障

A[主节点故障] --> B[仲裁器检测故障]

B --> C[选举新主节点]

end

subgraph 选举新主节点

C --> D[从节点投票]

D --> E[新主节点选出]

end

E --> F[复制集继续提供服务]

```

# 5. MongoDB复制最佳实践

### 5.1 复制集配置优化

**5.1.1 节点数量和硬件选择**

复制集的节点数量和硬件配置会直接影响复制性能和高可用性。一般来说,建议使用奇数个节点(例如 3、5、7),以避免脑裂问题。

在硬件选择方面,应考虑以下因素:

- **CPU:**复制过程需要消耗大量 CPU 资源,建议使用多核 CPU。

- **内存:**足够的内存可以缓存数据和索引,从而提高查询性能。

- **存储:**复制集中的所有节点都存储副本数据,因此需要考虑存储容量和性能。

**5.1.2 复制延迟和数据一致性权衡**

复制延迟是指从节点接收主节点变更并应用到本地数据库所需的时间。复制延迟越低,数据一致性越高,但也会增加系统开销。

为了权衡复制延迟和数据一致性,可以调整以下参数:

- **replSet.settings.chainingAllowed:**允许从节点直接从其他从节点复制数据,而不是从主节点复制,从而降低复制延迟。

- **replSet.settings.heartbeatIntervalMS:**设置心跳间隔,缩短心跳间隔可以降低复制延迟,但也会增加网络流量。

- **replSet.settings.electionTimeoutMillis:**设置选举超时时间,缩短超时时间可以加快故障转移过程,但也会增加脑裂风险。

### 5.2 复制集运维管理

**5.2.1 定期备份和恢复**

定期备份复制集数据至关重要,以防止数据丢失。可以使用以下命令进行备份:

```bash

mongodump --uri "mongodb://<user>:<password>@<host>:<port>/<database>" --out <backup_directory>

```

要恢复备份,可以使用以下命令:

```bash

mongorestore --uri "mongodb://<user>:<password>@<host>:<port>/<database>" --drop <backup_directory>

```

**5.2.2 监控和告警设置**

监控复制集的状态和性能至关重要。可以利用以下工具进行监控:

- **MongoDB Compass:**图形化界面工具,可提供复制集状态、节点健康状况和性能指标的实时视图。

- **MongoDB Cloud Manager:**云端监控和管理服务,可提供自动告警、性能分析和故障排除功能。

设置告警可以及时通知管理员复制集出现问题,例如复制延迟异常、节点故障或故障转移。

# 6. MongoDB复制故障排除

### 6.1 常见复制问题和解决方法

**6.1.1 复制延迟异常**

* **问题描述:**从节点与主节点之间的复制延迟过大,导致数据不一致。

* **解决方法:**

* 检查网络连接是否稳定,是否存在丢包或延迟。

* 调整`replSetSyncDelay`参数,增加主节点和从节点之间的同步间隔。

* 优化主节点的性能,例如增加内存或CPU资源。

* 使用`rs.slaveOk()`命令强制从节点读取数据,以缓解延迟带来的影响。

**6.1.2 节点无法加入复制集**

* **问题描述:**新节点无法加入现有的复制集。

* **解决方法:**

* 确认新节点的配置与复制集其他成员一致,包括副本集名称、端口号和身份验证信息。

* 检查防火墙或网络设置是否阻止新节点与其他成员通信。

* 使用`rs.add()`命令手动添加新节点,并指定必要的参数。

### 6.2 高级故障排除技巧

**6.2.1 日志分析和调试**

* **问题描述:**通过分析复制集日志可以发现潜在的故障原因。

* **解决方法:**

* 使用`mongod --repair`命令修复损坏的日志文件。

* 使用`rs.status()`命令查看复制集的当前状态和日志信息。

* 使用日志分析工具,如MongoDB Compass或Kibana,来过滤和分析日志数据。

**6.2.2 网络问题排查**

* **问题描述:**网络问题会导致复制集成员之间的通信中断。

* **解决方法:**

* 使用`ping`或`traceroute`命令测试复制集成员之间的网络连接。

* 检查防火墙或网络设备是否阻止复制集成员之间的通信。

* 调整网络设置,例如增加带宽或优化路由。

0

0