OpenCV目标追踪实战指南:人脸追踪、物体追踪轻松搞定,解锁追踪新技能

发布时间: 2024-08-08 03:06:41 阅读量: 40 订阅数: 44

# 1. OpenCV目标追踪概述**

OpenCV目标追踪是一种计算机视觉技术,用于在视频或图像序列中跟踪移动或变化的对象。它在各种应用中发挥着至关重要的作用,例如视频监控、人机交互和自动驾驶。

OpenCV提供了一系列目标追踪算法,包括相关滤波、粒子滤波和Kalman滤波。这些算法使用不同的方法来预测和更新目标的位置和状态,从而实现高效且准确的追踪。此外,OpenCV还支持深度学习目标追踪,利用神经网络来提高追踪的鲁棒性和准确性。

# 2. 目标追踪理论

### 2.1 相关滤波

**相关滤波**是一种基于相关性的目标追踪算法,它通过学习目标在上一帧中的外观模型来预测目标在当前帧中的位置。相关滤波算法的数学基础是循环相关,它衡量两个信号之间的相似性。

**算法流程:**

1. **初始化:**从目标的初始边界框中提取特征向量。

2. **训练:**使用循环相关计算特征向量与目标模型之间的相关系数矩阵。

3. **预测:**在当前帧中,计算特征向量与相关系数矩阵的相关性,得到目标的预测位置。

4. **更新:**使用预测位置和当前帧的目标边界框更新相关系数矩阵。

**代码示例:**

```python

import cv2

# 初始化相关滤波器

tracker = cv2.TrackerCSRT_create()

# 训练相关滤波器

tracker.init(frame, bounding_box)

# 预测目标位置

success, bounding_box = tracker.update(frame)

```

**逻辑分析:**

* `tracker.init()` 函数使用初始边界框初始化相关滤波器。

* `tracker.update()` 函数使用当前帧预测目标位置,并返回预测是否成功和更新后的边界框。

### 2.2 粒子滤波

**粒子滤波**是一种蒙特卡罗方法,它通过维护一组粒子来估计目标的状态。每个粒子代表目标可能的位置,粒子滤波算法通过更新粒子权重和重新采样来估计目标的真实位置。

**算法流程:**

1. **初始化:**在目标的初始位置周围随机生成一组粒子。

2. **预测:**根据目标运动模型预测每个粒子的新位置。

3. **更新:**计算每个粒子与当前帧目标外观的相似性,并更新其权重。

4. **重新采样:**根据粒子的权重重新采样,保留高权重的粒子并丢弃低权重的粒子。

**代码示例:**

```python

import cv2

# 初始化粒子滤波器

tracker = cv2.TrackerMOSSE_create()

# 训练粒子滤波器

tracker.init(frame, bounding_box)

# 预测目标位置

success, bounding_box = tracker.update(frame)

```

**逻辑分析:**

* `tracker.init()` 函数使用初始边界框初始化粒子滤波器。

* `tracker.update()` 函数使用当前帧预测目标位置,并返回预测是否成功和更新后的边界框。

### 2.3 Kalman滤波

**Kalman滤波**是一种线性滤波算法,它通过预测和更新状态向量来估计目标的状态。Kalman滤波算法基于马尔可夫假设,它假设目标的状态只与上一时刻的状态有关。

**算法流程:**

1. **初始化:**初始化状态向量和协方差矩阵。

2. **预测:**根据状态转移矩阵预测当前帧的目标状态。

3. **更新:**使用当前帧的目标观测值更新状态向量和协方差矩阵。

**代码示例:**

```python

import cv2

# 初始化Kalman滤波器

tracker = cv2.TrackerKCF_create()

# 训练Kalman滤波器

tracker.init(frame, bounding_box)

# 预测目标位置

success, bounding_box = tracker.update(frame)

```

**逻辑分析:**

* `tracker.init()` 函数使用初始边界框初始化Kalman滤波器。

* `tracker.update()` 函数使用当前帧预测目标位置,并返回预测是否成功和更新后的边界框。

### 2.4 深度学习目标追踪

**深度学习目标追踪**是一种基于深度学习模型的目标追踪算法。深度学习模型可以学习目标的外观特征,并预测目标在当前帧中的位置。

**算法流程:**

1. **训练:**使用目标的图像和边界框训练深度学习模型。

2. **预测:**在当前帧中,使用深度学习模型预测目标的位置。

3. **更新:**使用预测位置和当前帧的目标边界框更新深度学习模型。

**代码示例:**

```python

import cv2

# 初始化深度学习目标追踪器

tracker = cv2.TrackerGOTURN_create()

# 训练深度学习目标追踪器

tracker.init(frame, bounding_box)

# 预测目标位置

success, bounding_box = tracker.update(frame)

```

**逻辑分析:**

* `tracker.init()` 函数使用初始边界框初始化深度学习目标追踪器。

* `tracker.update()` 函数使用当前帧预测目标位置,并返回预测是否成功和更新后的边界框。

# 3.1 使用相关滤波进行人脸追踪

相关滤波是一种线性滤波器,它通过最小化目标和滤波器响应之间的相关性来学习目标的外观模型。在人脸追踪中,相关滤波器通过学习人脸图像的特征来构建目标模型,然后使用该模型在后续帧中追踪人脸。

**代码块 1:使用相关滤波进行人脸追踪**

```python

import cv2

# 初始化相关滤波器

tracker = cv2.TrackerCSRT_create()

# 获取第一帧并初始化追踪器

cap = cv2.VideoCapture('video.mp4')

ret, frame = cap.read()

bbox = cv2.selectROI('Tracking Window', frame)

tracker.init(frame, bbox)

# 循环处理后续帧

while True:

ret, frame = cap.read()

if not ret:

break

# 更新追踪器

success, bbox = tracker.update(frame)

# 绘制追踪框

if success:

p1 = (int(bbox[0]), int(bbox[1]))

p2 = (int(bbox[0] + bbox[2]), int(bbox[1] + bbox[3]))

cv2.rectangle(frame, p1, p2, (0, 255, 0), 2, 1)

# 显示结果

cv2.imshow('Tracking', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()

```

**代码逻辑分析:**

* 初始化相关滤波器 `tracker`。

* 获取第一帧并使用 `cv2.selectROI()` 选择追踪区域 `bbox`。

* 初始化追踪器 `tracker.init(frame, bbox)`。

* 循环处理后续帧。

* 更新追踪器 `tracker.update(frame)` 并获取追踪结果 `success` 和追踪框 `bbox`。

* 绘制追踪框。

* 显示结果并等待用户输入。

**参数说明:**

* `cv2.TrackerCSRT_create()`: 创建相关滤波追踪器。

* `cv2.selectROI()`: 选择追踪区域。

* `tracker.init(frame, bbox)`: 初始化追踪器。

* `tracker.update(frame)`: 更新追踪器并获取追踪结果。

* `cv2.rectangle()`: 绘制追踪框。

* `cv2.imshow()`: 显示结果。

* `cv2.waitKey()`: 等待用户输入。

**相关滤波的优点:**

* 计算效率高,适合实时追踪。

* 对目标外观变化具有鲁棒性。

**相关滤波的缺点:**

* 对遮挡和形变敏感。

* 容易受到背景杂波的影响。

# 4. OpenCV目标追踪进阶**

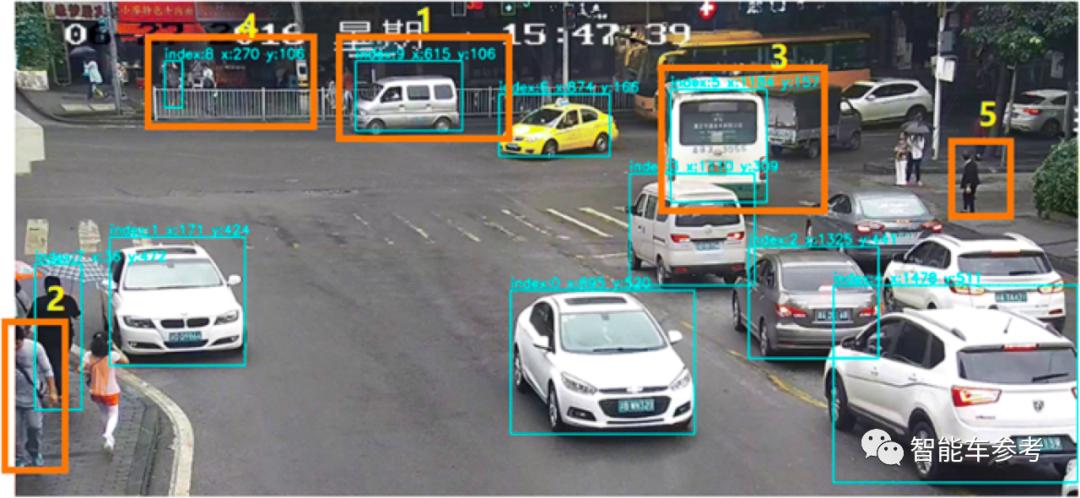

**4.1 多目标追踪**

多目标追踪是指同时追踪多个目标的过程。在现实世界中,经常需要追踪多个目标,例如在自动驾驶中追踪行人和车辆,在视频监控中追踪多个嫌疑人。

OpenCV提供了多种多目标追踪算法,包括:

- **多目标相关滤波(MOTR)**:MOTR是一种基于相关滤波的算法,它使用多个滤波器来追踪多个目标。

- **多目标粒子滤波(MOPT)**:MOPT是一种基于粒子滤波的算法,它使用多个粒子群来追踪多个目标。

- **多目标Kalman滤波(MOKF)**:MOKF是一种基于Kalman滤波的算法,它使用多个Kalman滤波器来追踪多个目标。

**4.2 长期追踪**

长期追踪是指在目标长时间遮挡或消失的情况下仍能继续追踪目标的过程。长期追踪对于许多应用至关重要,例如在视频监控中追踪嫌疑人,在自动驾驶中追踪车辆。

OpenCV提供了多种长期追踪算法,包括:

- **深度学习长期追踪(DLST)**:DLST是一种基于深度学习的算法,它使用卷积神经网络(CNN)来提取目标特征,并使用循环神经网络(RNN)来预测目标位置。

- **基于特征的长期追踪(FBT)**:FBT是一种基于特征的算法,它使用局部二进制模式(LBP)或直方图梯度(HOG)等特征来描述目标,并使用这些特征来匹配目标。

**4.3 鲁棒性增强**

鲁棒性增强是指提高目标追踪算法在噪声、遮挡和光照变化等挑战条件下的性能的过程。鲁棒性增强对于许多应用至关重要,例如在恶劣天气条件下追踪车辆,在拥挤场景中追踪行人。

OpenCV提供了多种鲁棒性增强技术,包括:

- **在线更新**:在线更新是一种技术,它允许目标追踪算法在追踪过程中更新目标模型,以适应目标外观和运动的变化。

- **背景建模**:背景建模是一种技术,它允许目标追踪算法区分目标和背景,从而提高追踪精度。

- **运动补偿**:运动补偿是一种技术,它允许目标追踪算法补偿目标运动,从而提高追踪稳定性。

**代码示例**

```python

import cv2

# 创建一个多目标相关滤波器

tracker = cv2.TrackerMOSSE_create()

# 初始化目标

bbox = (100, 100, 200, 200)

# 追踪目标

while True:

# 读取帧

frame = cv2.imread('frame.jpg')

# 更新目标

success, bbox = tracker.update(frame)

# 绘制边界框

if success:

cv2.rectangle(frame, (int(bbox[0]), int(bbox[1])), (int(bbox[0] + bbox[2]), int(bbox[1] + bbox[3])), (0, 255, 0), 2)

# 显示帧

cv2.imshow('Frame', frame)

# 按下 ESC 键退出

if cv2.waitKey(1) & 0xFF == 27:

break

# 释放摄像头

cv2.destroyAllWindows()

```

**逻辑分析**

这段代码使用OpenCV的多目标相关滤波器(MOTR)来追踪目标。MOTR算法使用多个相关滤波器来追踪多个目标。

代码首先创建了一个MOTR跟踪器,然后初始化目标边界框。然后,代码循环读取帧,更新目标,并绘制边界框。

**参数说明**

- `cv2.TrackerMOSSE_create()`:创建MOTR跟踪器。

- `tracker.update(frame)`:更新目标。

- `bbox`:目标边界框。

- `success`:是否成功更新目标。

# 5.1 人脸追踪系统开发

### 5.1.1 系统设计

人脸追踪系统是一个计算机视觉系统,用于实时检测和追踪视频帧中的面部。系统设计包括以下主要模块:

- **人脸检测:**使用Haar级联分类器或深度学习模型检测视频帧中的人脸。

- **人脸追踪:**使用相关滤波或粒子滤波等算法追踪检测到的人脸。

- **用户界面:**显示视频帧和追踪结果,允许用户与系统交互。

### 5.1.2 实现

**人脸检测:**

```python

import cv2

# 使用Haar级联分类器检测人脸

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

# 从视频流中读取帧

cap = cv2.VideoCapture(0)

while True:

# 读取帧

ret, frame = cap.read()

# 将帧转换为灰度

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 检测人脸

faces = face_cascade.detectMultiScale(gray, 1.1, 4)

# 在帧上绘制人脸边界框

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (0, 255, 0), 2)

# 显示帧

cv2.imshow('Frame', frame)

# 按'q'退出

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放视频流

cap.release()

# 销毁所有窗口

cv2.destroyAllWindows()

```

**人脸追踪:**

```python

import cv2

# 使用相关滤波追踪人脸

tracker = cv2.TrackerCSRT_create()

# 从视频流中读取帧

cap = cv2.VideoCapture(0)

# 初始化追踪器

success, bbox = tracker.init(cap.read()[1], (100, 100, 200, 200))

while True:

# 读取帧

ret, frame = cap.read()

# 追踪人脸

success, bbox = tracker.update(frame)

# 在帧上绘制人脸边界框

if success:

(x, y, w, h) = [int(v) for v in bbox]

cv2.rectangle(frame, (x, y), (x+w, y+h), (0, 255, 0), 2)

# 显示帧

cv2.imshow('Frame', frame)

# 按'q'退出

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放视频流

cap.release()

# 销毁所有窗口

cv2.destroyAllWindows()

```

### 5.1.3 评估

人脸追踪系统的评估指标包括:

- **准确性:**追踪器正确追踪人脸的帧数与总帧数的比率。

- **鲁棒性:**追踪器在光照变化、遮挡和运动模糊等干扰下保持追踪的稳定性。

- **实时性:**追踪器处理视频帧的速度,通常以每秒帧数(FPS)衡量。

### 5.1.4 应用

人脸追踪系统在以下应用中具有广泛的用途:

- **安全监控:**检测和追踪可疑人员。

- **人机交互:**控制设备或应用程序。

- **娱乐:**增强游戏和虚拟现实体验。

# 6. OpenCV目标追踪常见问题及解决方案

在使用OpenCV进行目标追踪时,可能会遇到一些常见问题。本文将介绍这些问题并提供相应的解决方案。

### 1. 目标追踪不准确

* **原因:**跟踪算法选择不当,目标运动模型不准确。

* **解决方案:**根据目标运动特性选择合适的跟踪算法。例如,对于快速运动目标,可以使用粒子滤波或深度学习目标追踪。

### 2. 目标丢失

* **原因:**目标遮挡、背景杂乱、目标变形。

* **解决方案:**

* 使用多目标追踪算法,当一个目标丢失时,可以从其他目标中恢复。

* 增强目标模型,使其对遮挡、变形等因素具有鲁棒性。

### 3. 跟踪速度慢

* **原因:**算法复杂度高、硬件性能不足。

* **解决方案:**

* 选择低复杂度的跟踪算法。

* 优化算法代码,减少计算量。

* 升级硬件配置,提高处理速度。

### 4. 目标漂移

* **原因:**跟踪算法对背景噪声敏感。

* **解决方案:**

* 使用鲁棒性强的跟踪算法,例如Kalman滤波或深度学习目标追踪。

* 对背景进行建模,并将其融入跟踪算法中。

### 5. 参数设置困难

* **原因:**跟踪算法参数众多,难以调优。

* **解决方案:**

* 了解每个参数的含义和影响。

* 根据目标特性和场景需求进行参数调整。

* 使用自动参数调优工具,简化参数设置过程。

0

0