PyTorch实现:循环神经网络进阶与GRU详解

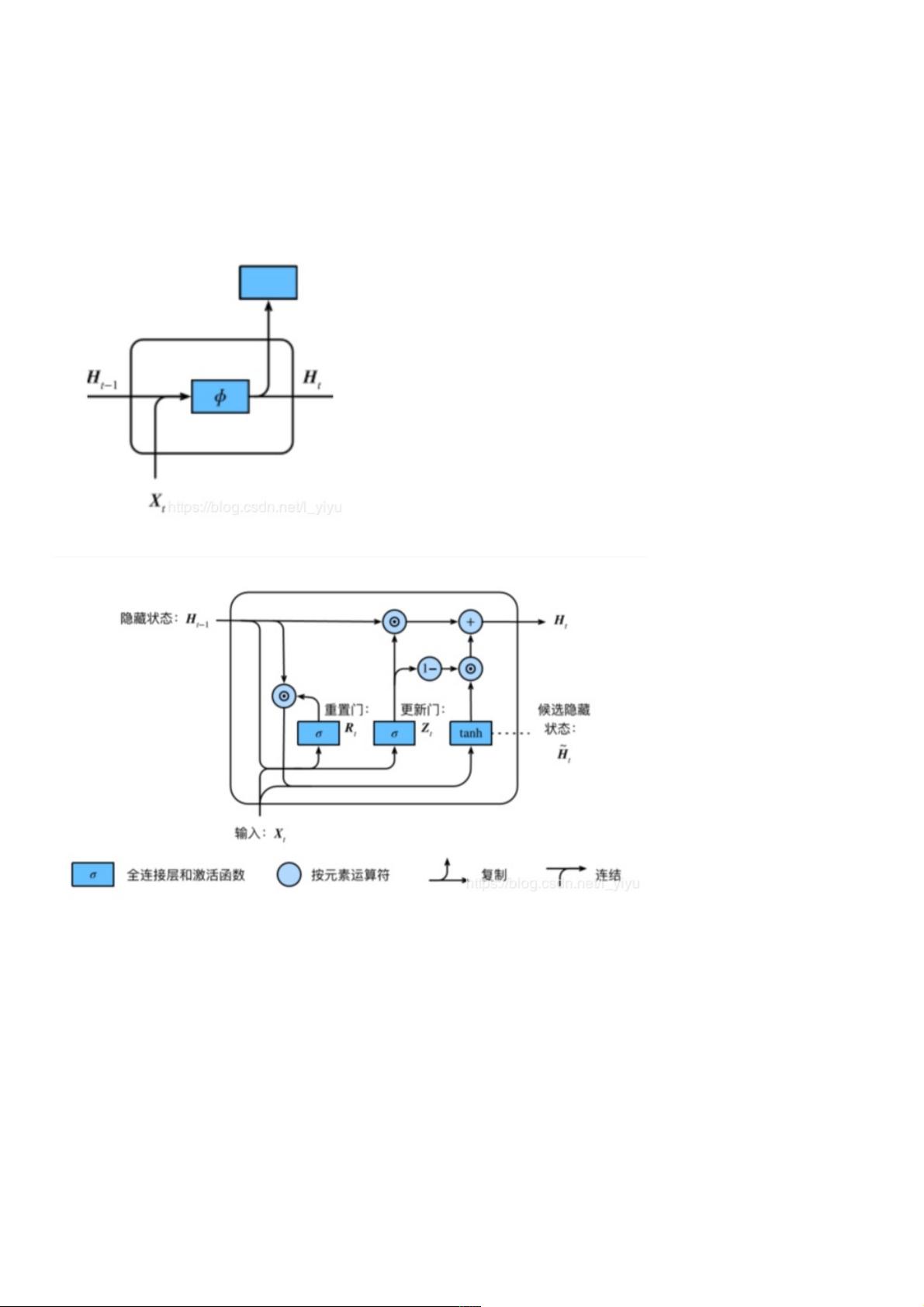

"Task03 循环神经网络进阶(pytorch代码实现)" 循环神经网络(RNN)是处理序列数据,如时间序列或文本数据的常用模型。然而,标准的RNN在处理长序列时会遇到梯度消失或梯度爆炸的问题,这限制了它们捕捉长期依赖的能力。为了解决这个问题,门控循环单元(Gated Recurrent Unit, GRU)被提出。 GRU结合了重置门(Reset Gate)和更新门(Update Gate)的概念,旨在更好地管理隐藏状态的更新,从而有效地捕捉不同时间尺度上的依赖关系。重置门允许模型忽略之前的一些时间步,专注于当前时间步的信息,而更新门则控制隐藏状态中旧信息与新信息的混合比例,这样就可以保持对远期依赖的记忆。 在GRU中,每个时间步的计算包含以下步骤: 1. 重置门计算:$r_t = \sigma(W_r x_t + U_r h_{t-1})$,其中$x_t$是当前时间步的输入,$h_{t-1}$是上一时间步的隐藏状态,$\sigma$是Sigmoid函数,$W_r$和$U_r$是权重矩阵。 2. 候选隐藏状态计算:$\tilde{h}_t = tanh(W_c x_t + U_c (r_t \odot h_{t-1}))$,其中$tanh$是双曲正切函数,$\odot$表示元素-wise乘法。 3. 更新门计算:$z_t = \sigma(W_z x_t + U_z h_{t-1})$。 4. 最终隐藏状态计算:$h_t = z_t \odot h_{t-1} + (1 - z_t) \odot \tilde{h}_t$。 这段代码展示了如何在PyTorch中实现GRU。首先导入必要的库,包括NumPy、PyTorch的nn和optim模块。然后,定义了设备(如果可用则使用GPU),加载数据,以及设置模型参数。`d2l.RNNModel`是自定义的RNN模型类,它包含了GRU层。在训练部分,使用了RNN的训练和预测函数`d2l.train_and_predict_rnn_pytorch`,该函数负责模型的优化、梯度裁剪以及预测。 此外,代码还提到了长短期记忆网络(Long Short-Term Memory, LSTM),这是另一种解决RNN梯度问题的方法,通过引入输入门、遗忘门和输出门来更精细地控制信息流。LSTM在处理序列数据方面表现出色,特别是在处理非常长的依赖关系时。 GRU和LSTM都是为了克服标准RNN的局限性而设计的,它们在处理时间序列和序列数据的任务中扮演着重要角色。在PyTorch中,可以通过`nn.GRU`和`nn.LSTM`轻松实现这些模型,使得研究者和开发者能够利用这些强大的工具进行自然语言处理、语音识别和许多其他领域的应用。

下载后可阅读完整内容,剩余3页未读,立即下载

- 粉丝: 6

- 资源: 888

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 十种常见电感线圈电感量计算公式详解

- 军用车辆:CAN总线的集成与优势

- CAN总线在汽车智能换档系统中的作用与实现

- CAN总线数据超载问题及解决策略

- 汽车车身系统CAN总线设计与应用

- SAP企业需求深度剖析:财务会计与供应链的关键流程与改进策略

- CAN总线在发动机电控系统中的通信设计实践

- Spring与iBATIS整合:快速开发与比较分析

- CAN总线驱动的整车管理系统硬件设计详解

- CAN总线通讯智能节点设计与实现

- DSP实现电动汽车CAN总线通讯技术

- CAN协议网关设计:自动位速率检测与互连

- Xcode免证书调试iPad程序开发指南

- 分布式数据库查询优化算法探讨

- Win7安装VC++6.0完全指南:解决兼容性与Office冲突

- MFC实现学生信息管理系统:登录与数据库操作

信息提交成功

信息提交成功