本篇文章主要探讨了基于多语言预训练模型的MLQA(多语言问答)研究与实践,重点关注于游戏出海背景下如何利用这些模型解决知识获取的挑战。作者提到腾讯公司在游戏领域的智能对话机器人项目,其核心功能涵盖智能对话、自助工具和主动关怀,已应用于包括腾讯游戏、和平精英、DNF和QQ飞车在内的40多个游戏产品。

游戏出海对于像“知几”这样的服务来说,面临的主要挑战包括多语言语料库的缺乏以及高昂的标注成本。由于游戏领域的特定问题可能在其他领域缺乏相应的标注数据,这使得直接迁移通用预训练模型到游戏场景变得困难。然而,作者指出存在大量未标注的多语言和开放域平行数据,预训练模型如BERT(Bidirectional Encoder Representations from Transformers)在图像领域的成功应用启发了寻找方法,通过迁移学习让通用语言能力适应游戏领域的低资源QA(Question Answering)问题。

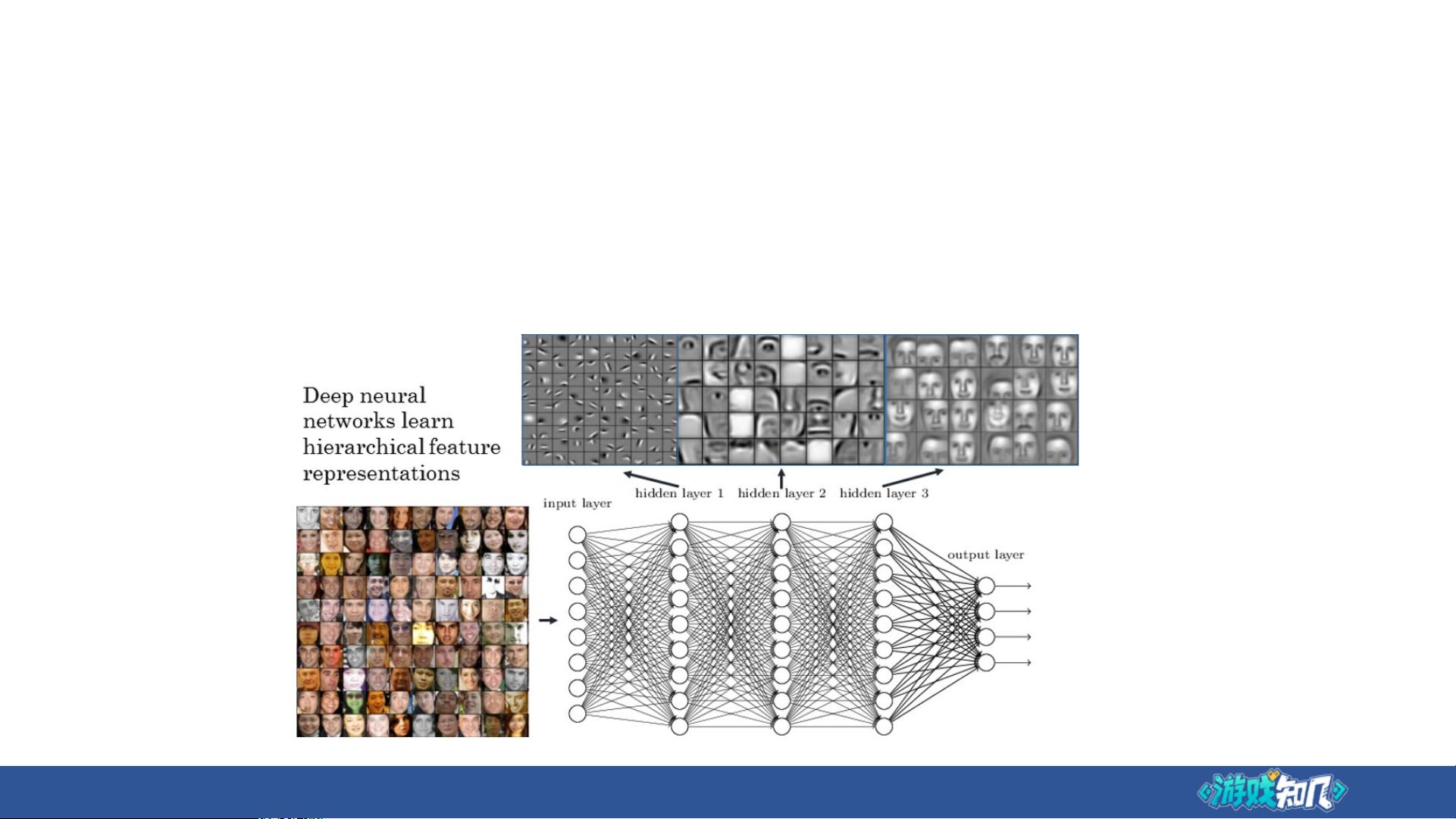

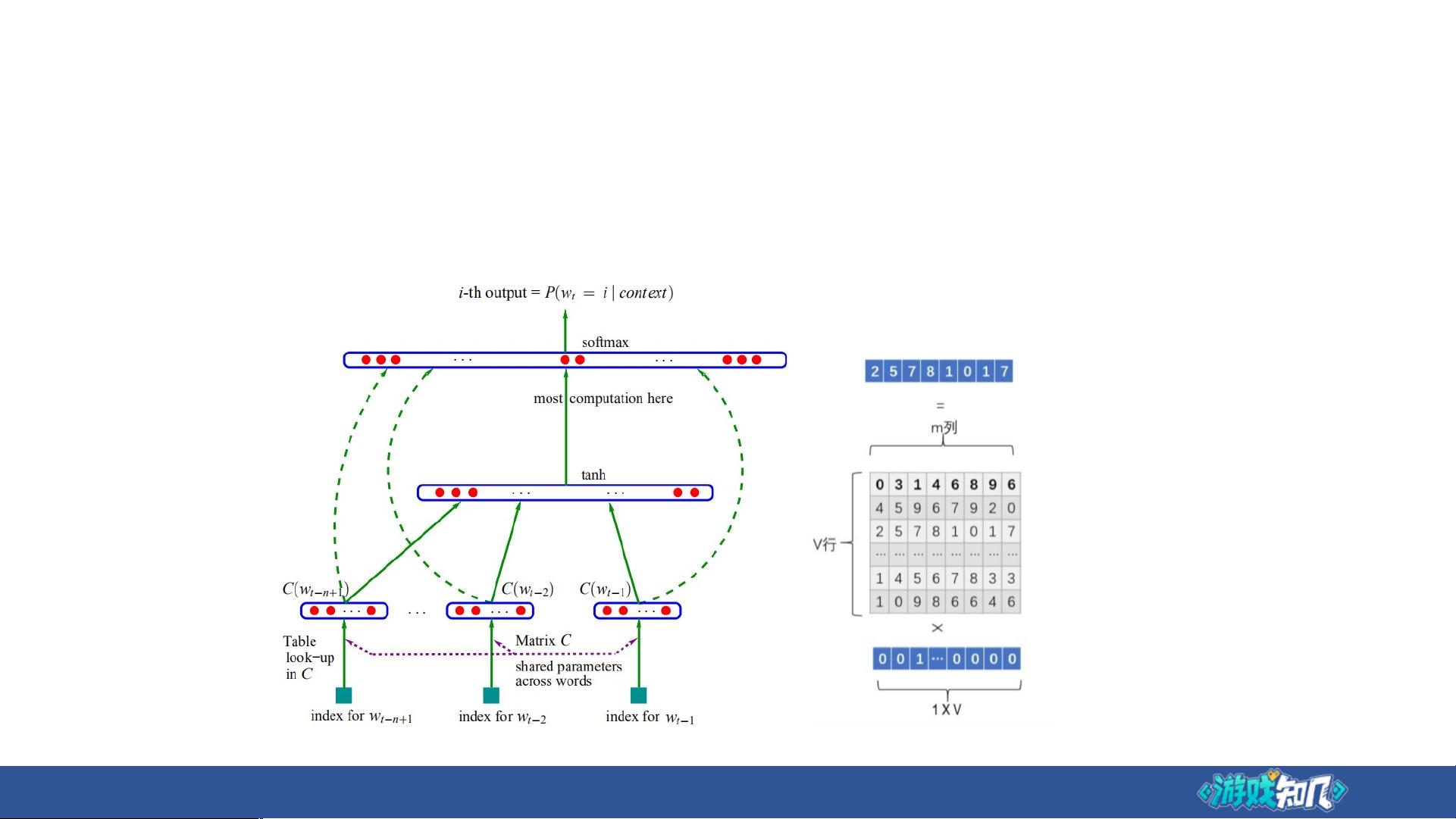

文章详细回顾了神经网络语言模型的发展历程,从Word2Vec到ELMo、GPT,最后聚焦于BERT,强调了BERT通过Masked Language Modeling(MLM)实现双向语言模型的优势,并通过Fine-Tuning解决下游任务的能力。BERT在11项NLP任务上的卓越表现表明其预训练阶段能有效利用大量无标注数据,将语言学知识编码在模型中,从而提高下游任务的性能。

文章还介绍了几种多语言预训练模型,如M-BERT(Multi-lingual BERT)、XLM、XLM-R、LASER、mUSE/LaBSE。M-BERT由Google Research的Pires等人在2019年提出,其特点是12层Transformer结构,使用英语数据和共享词Piece词汇表,旨在展示模型在跨语言泛化方面的强大能力。通过这些模型,研究者们探索了如何训练和优化多语言模型,以解决不同语言环境下游戏中的知识获取问题,并分享了实际项目的实战经验和收益。

总结起来,本文的核心知识点在于多语言预训练模型在解决游戏出海知识获取挑战中的应用,包括模型选择、跨语言迁移学习策略、以及实际项目中所取得的成果和面临的挑战。这些模型的潜力在于它们能够通过无监督学习处理多语言数据,为低资源语言环境下的游戏问答系统提供有力支持。