HDFS与MapReduce深度解析:Hadoop核心技术基石

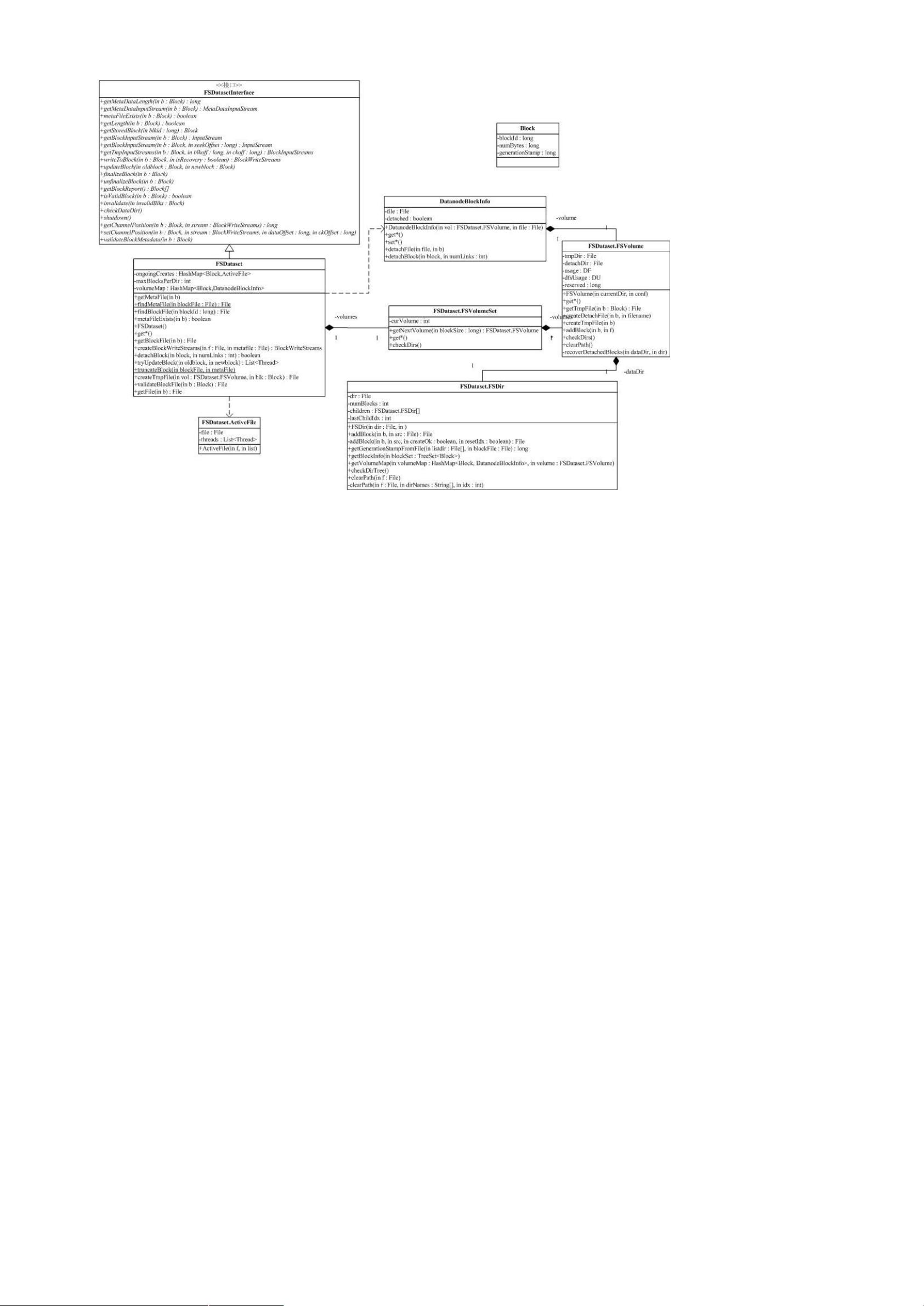

Hadoop源码分析深入探讨了Apache Hadoop项目的基石——分布式文件系统HDFS(Hadoop Distributed File System)和并行计算模型MapReduce。Hadoop源于Google的五个核心项目,即Google Cluster、Chubby、GFS、BigTable和MapReduce,Apache社区通过开源实现了类似的功能,将它们分别对应为ZooKeeper、HDFS、HBase和Hadoop本身。 HDFS作为Hadoop的核心组件,是分布式计算的基础,它允许在大规模集群上存储和处理大量数据。HDFS的设计目标是高容错性、高吞吐量和数据的可靠性,通过数据分片和副本机制来保证数据的可恢复性和访问效率。源代码分析显示,Hadoop包间的依赖关系复杂,源于其设计灵活性,可以适应多种存储后端。例如,conf包负责系统配置,对fs包有依赖,因为配置文件的读取涉及文件系统操作,而fs包又抽象出了一些基础文件系统功能。 重点考察的部分包括Hadoop的蓝区,即核心模块,其中包括HDFS客户端、HDFS服务器、NameNode(主名称节点)和DataNode(数据节点)、MapReduce框架以及相关的工具。MapReduce模型在Hadoop中扮演着至关重要的角色,它简化了大规模数据处理过程,通过将任务分解为一系列并行执行的map和reduce步骤,实现了数据处理的高效分布式执行。 在Hadoop的源码分析中,除了核心组件,还会涉及到Hadoop生态系统中的其他开源项目,如Hive,它是由Facebook开发的用于用户数据分析的工具,扩展了Hadoop的数据处理能力。通过对Hadoop源码的学习,开发者能够深入了解分布式计算的实现原理,提升对大数据处理技术的理解,并为实际项目中的问题解决提供有价值的参考。 为了深入学习,建议逐步阅读Hadoop源代码,理解其分布式文件系统、数据块管理和复制策略、RPC通信机制、JobTracker和TaskTracker的交互、以及MapReduce的工作流程。同时,关注配置文件的管理、错误处理机制和性能优化点。通过实践项目和参与开源社区,进一步巩固和深化对Hadoop技术的认识。

剩余63页未读,继续阅读

- 粉丝: 0

- 资源: 1

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构

信息提交成功

信息提交成功