GPU编程入门:CUDA与3D图形处理解析

需积分: 50 121 浏览量

更新于2024-07-19

1

收藏 4.25MB PDF 举报

"这篇文档是关于GPU并行编程的基础教程,特别关注CUDA技术和NVIDIA的GPU。内容包括对现代GPU的架构和设计原则的深入探讨,以Nvidia的GeForce系列芯片为例。"

在计算机科学领域,GPU(Graphics Processing Unit)扮演着至关重要的角色,特别是在高性能计算和3D图形处理方面。CUDA是NVIDIA公司推出的一种编程模型,它允许开发者利用GPU的强大计算能力来执行并行计算任务,而不仅仅是图形渲染。

1. GPU概述

GPU最初的设计目的是加速图形处理,将复杂的三维数据转化为二维像素图像。随着技术的发展,现代GPU已经超越了单纯的图形处理,它们能够处理复杂的数学运算和大规模并行计算,尤其适用于物理模拟、机器学习、数据分析等应用。

1.1 3D场景的构造

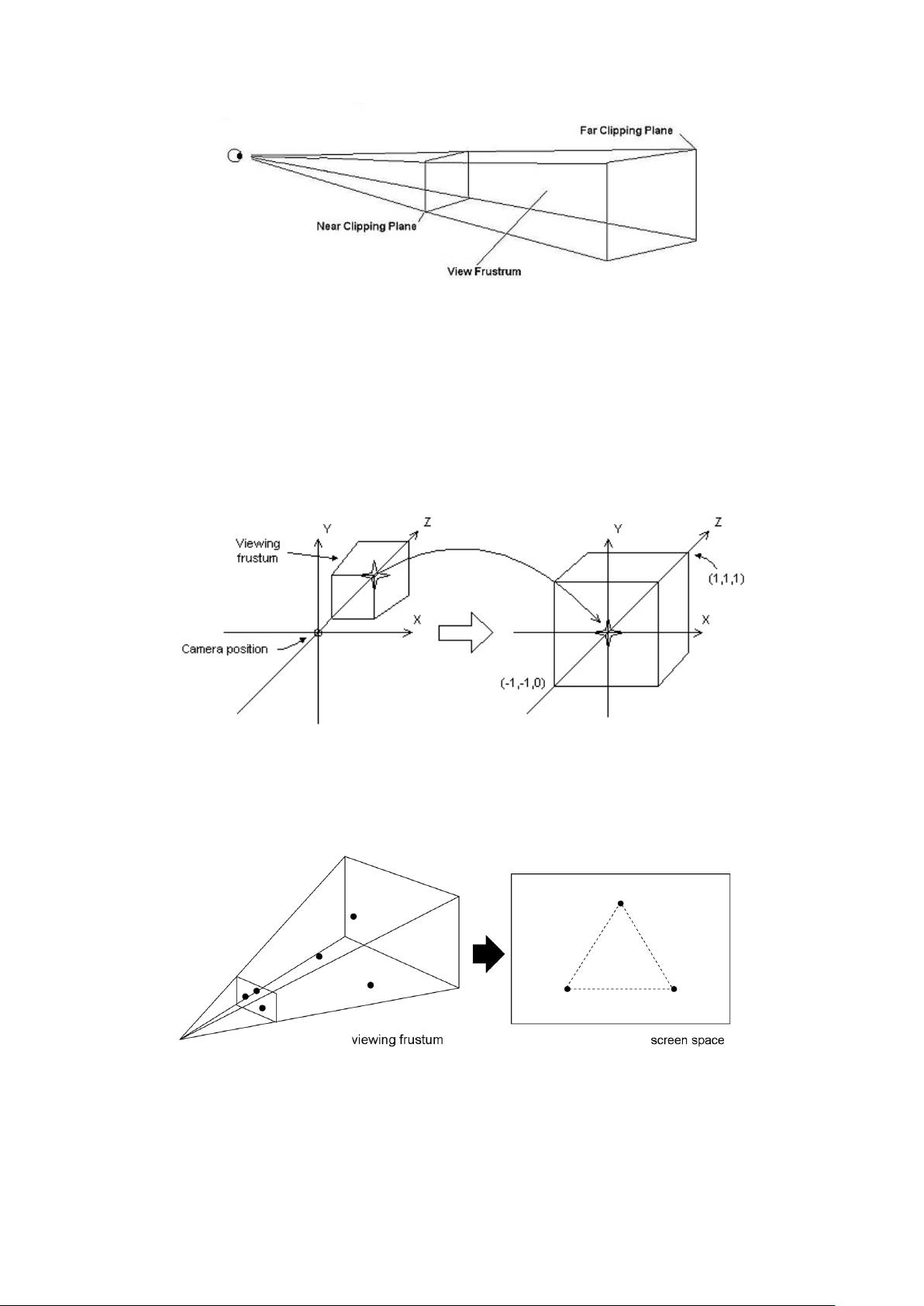

一个3D场景由多个3D对象和光源组成,如图1所示。这些对象在屏幕上被呈现为由多个三角形组成的多边形网络,这是因为三角形是最简单的多边形,可以有效地进行渲染和计算(见图2)。

1.2 3D对象与基本元素

3D对象由一系列几何形状构成,通常是以三角形面片为主,因为三角形易于处理且可以组合成任意复杂的形状。每个三角形由三个顶点(vertices)定义,这些顶点包含位置、颜色、法线向量等信息,用于确定物体表面的形状和光照效果。

2. GPU架构与CUDA

现代GPU的架构设计为高度并行,拥有大量的流处理器(Streaming Multiprocessors, SMs),每个SM又包含多个处理核心,能够同时处理大量数据。CUDA编程模型提供了一种接口,让程序员可以利用这些并行核心执行任务。通过CUDA,开发者可以定义并行线程块和线程网格,将计算任务分配到GPU的各个处理单元上,实现高效的并行计算。

3. 应用场景

CUDA广泛应用于科学计算、物理模拟、图像处理、视频编码、人工智能等领域。例如,在深度学习中,GPU可以加速神经网络的训练和推理过程;在分子动力学模拟中,GPU可以高效地计算大量粒子的相互作用。

4. 总结

了解GPU的架构和CUDA编程是进入并行计算领域的关键步骤。通过掌握这些知识,开发者能够编写高效的代码,充分利用GPU的计算潜力,解决计算密集型问题,从而推动科研和工业领域的创新。

为了进一步学习GPU并行编程,你需要掌握CUDA编程语言的基本概念,理解GPU的内存层次和并行执行模型,以及如何有效地调度和同步线程。此外,实践项目和实验也是提高技能的重要途径。通过实际编写和优化CUDA代码,你将能更深入地理解和利用GPU的并行计算能力。

411 浏览量

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

Shipley_Xie

- 粉丝: 0

最新资源

- 深入解析ARM嵌入式Linux系统开发教程

- 精通JavaScript实例应用

- sndspec: 将声音文件转换为频谱图的工具

- 全技术栈蓝黄企业站模板(HTML源码+使用指南)

- OCaml实现蒙特卡罗模拟投资组合运行于网络工作者

- 实现TMS320F28069 LCD显示与可调PWM频率输出

- 《自动控制原理第三版》孙炳达课后答案解析

- 深入学习RHEL6下KVM虚拟化技术

- 基于混沌序列的Matlab数字图像加密技术详解

- NumMath开源软件:图形化数值计算与结果可视化

- 绿色大气个人摄影相册网站模板源码下载

- OpenOffice集成jar包:实现Word与PDF转换功能

- 雷达数字下变频MATLAB仿真技术研究

- PHP面向对象开发核心关键字深入解析

- Node.js中PostgreSQL咨询锁的实践与应用场景

- AIHelp WEB SDK代码示例及集成指南