GCN原理解析:图卷积网络的半监督学习与公式推导

需积分: 16 172 浏览量

更新于2024-08-05

1

收藏 349KB DOCX 举报

"GCN开山之作精读,包括主观翻译和公式推导,讨论了半监督图节点学习问题,适合有一定图论和深度学习基础的读者。文章中提到,传统方法通过在损失函数中添加图拉普拉斯正则项来处理部分节点标签的情况,而GCN则是直接用神经网络模型编码图结构,以有监督的方式训练带标签节点,从而避免显式正则化。"

本文主要探讨的是Graph Convolutional Networks (GCNs) 在半监督节点分类任务中的应用。半监督学习通常处理的是大量无标签数据和少量标签数据的问题,而在图数据中,这个问题转化为如何利用图的结构信息来提升未标记节点的分类性能。

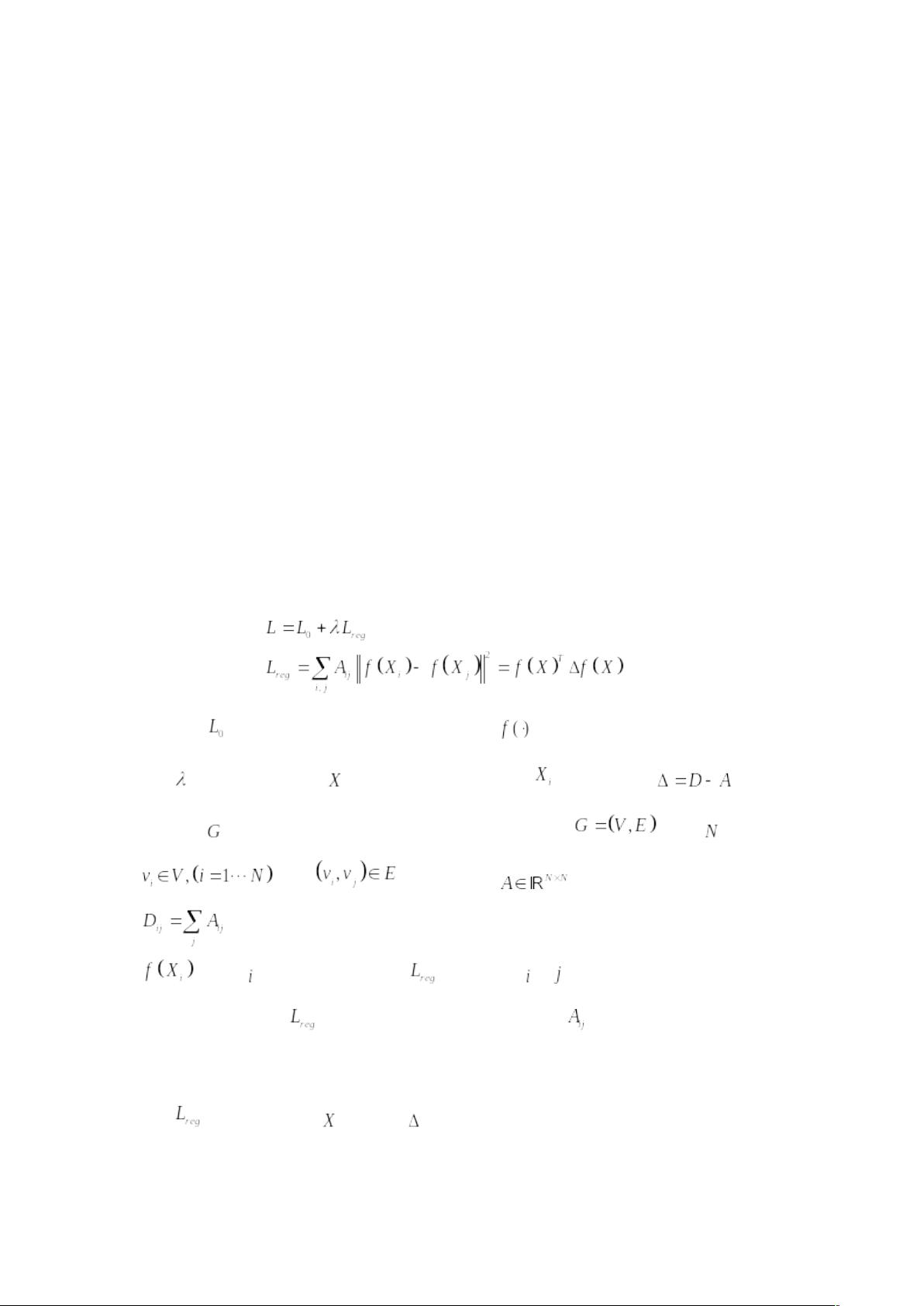

1. 引言部分指出,传统方法会利用图的拉普拉斯正则化(如式1)来传播标签信息,假设邻接节点可能共享相同标签。然而,这种方法可能会限制模型的表达能力,因为它将边和节点编码在一起,可能丢失了边携带的额外信息。

2. GCN的工作原理是,通过神经网络直接编码图结构,使用有标签节点的监督信息进行训练。模型以邻接矩阵作为输入,使得模型可以从损失函数中学习到梯度信息,同时对所有节点(无论是否带标签)进行学习。这种方法的优点在于,它不需要在损失函数中显式地添加正则化项,而是通过网络的内在机制隐式地利用图的拓扑信息。

3. GCN的核心思想是图卷积操作,它允许节点特征在图上进行传播和聚合,从而使得未标记节点能从邻居节点中获取信息。这种信息传递过程使得模型能够学习到更丰富的图结构特性,同时也考虑到了边的权重,提高了模型的泛化能力。

4. 在实际应用中,GCN的训练通常采用多层结构,每一层的输出会作为下一层的输入,通过连续的图卷积操作,节点特征会逐渐融合来自更远邻居的信息,形成更高级别的表示。

5. 由于GCN模型的这一特性,它们在图数据相关的任务中,如社交网络分析、分子结构预测和推荐系统等,都展现出了优秀的性能。尽管GCN模型有其优势,但也存在一些挑战,例如过平滑问题,即随着层数加深,所有节点特征趋于一致,这会影响模型的区分度。

6. 最后,文章提到,虽然作者的学术能力可能有限,但仍希望能通过分享个人理解和翻译,帮助读者更好地理解和应用GCN。因此,对于那些对图学习和深度学习感兴趣的读者,这篇文章提供了一个理解GCN基础知识和原理的起点,也鼓励读者深入研究和探索这个领域。

2019-08-11 上传

2022-03-22 上传

点击了解资源详情

2023-07-15 上传

2023-05-21 上传

2023-06-19 上传

2023-05-21 上传

2023-09-04 上传

2024-04-17 上传

爱读书的zyz

- 粉丝: 5

- 资源: 1

最新资源

- Hadoop生态系统与MapReduce详解

- MDS系列三相整流桥模块技术规格与特性

- MFC编程:指针与句柄获取全面解析

- LM06:多模4G高速数据模块,支持GSM至TD-LTE

- 使用Gradle与Nexus构建私有仓库

- JAVA编程规范指南:命名规则与文件样式

- EMC VNX5500 存储系统日常维护指南

- 大数据驱动的互联网用户体验深度管理策略

- 改进型Booth算法:32位浮点阵列乘法器的高速设计与算法比较

- H3CNE网络认证重点知识整理

- Linux环境下MongoDB的详细安装教程

- 压缩文法的等价变换与多余规则删除

- BRMS入门指南:JBOSS安装与基础操作详解

- Win7环境下Android开发环境配置全攻略

- SHT10 C语言程序与LCD1602显示实例及精度校准

- 反垃圾邮件技术:现状与前景