Adaboost算法详解:从弱学习到强学习的提升

版权申诉

"清华出品的机器学习技术课程——统计学习方法第二版系列课程,涵盖了从基础到高级的各种机器学习算法,包括Adaboost在内的多个重要章节。课程旨在帮助学生掌握机器学习的核心概念和技术,适用于初学者和需要复习的学员。课件详细、深入,适合逐步学习。全套课程提供下载,包括多项式学习、弱学习与强学习理论、Adaboost算法、EM算法、HMM、CRF、无监督学习、聚类方法、奇异值分解以及主成分分析等内容。"

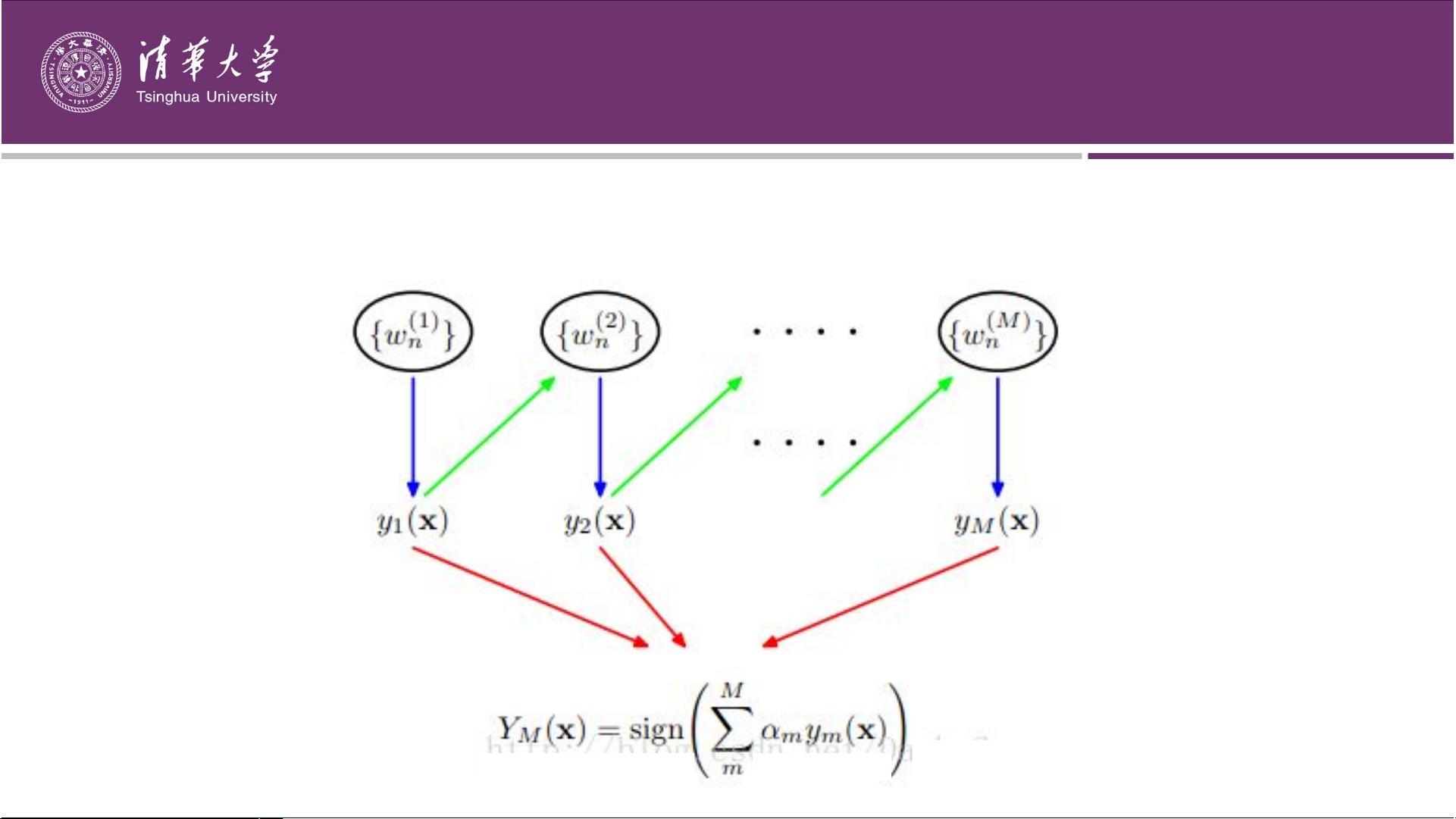

Adaboost是一种提升(boosting)算法,起源于对强可学习性和弱可学习性之间关系的研究。Kearns和Valiant在1984年提出了强可学习和弱可学习的概念,弱学习算法只需比随机猜测略好,而强学习算法则要求高正确率。1989年,Schapire证明了弱学习可以提升为强学习。Adaboost的目标是通过结合一系列弱分类器,构建一个强分类器。

Adaboost的基本思想是通过迭代的方式逐步构建分类器。在每一轮中,它会根据上一轮分类器的表现调整样本权重,使得错误分类的样本在下一轮中被赋予更高的权重。这样,后续的弱分类器更倾向于关注那些前一轮分类错误的样本。这个过程被称为前向分步训练算法,它会持续增加弱分类器直到达到预定的停止条件,如达到预设的弱分类器数量或者错误率低于某个阈值。

在实际应用中,Adaboost通常用于构造决策树组成的集成模型,因为决策树易于构建且能够处理多种类型的数据。Adaboost的编程实现包括选择弱学习算法(如决策树),然后按照Adaboost的框架调整训练数据的权重并构建一系列弱分类器。最后,这些弱分类器的预测结果会以加权的方式组合成最终的强分类器输出。

Adaboost也被应用于特定的领域,如在本资料中提到的实时人脸检测。Adaboost可以通过学习人脸和非人脸的特征来构建分类器,从而有效地识别和定位图像中的脸部区域。

此外,Adaboost与其它集成学习方法如Bagging(自助采样法)有所区别。Bagging通过多次随机抽样的方式生成多个训练集,每个训练集构建一个分类器,最后通过多数投票来决定最终结果。相比于Bagging的并行结构,Adaboost更像是一种串行过程,弱分类器的构建是逐步进行的,更侧重于错误样本的纠正。

本课程还涵盖了其他重要机器学习算法,如k-近邻、贝叶斯分类器、决策树、Logistic回归、SVM、EM算法、HMM、CRF、无监督学习方法、聚类、奇异值分解和主成分分析,为学习者提供了全面的机器学习理论和实践知识。

2022-04-30 上传

2022-05-03 上传

2022-05-03 上传

2023-08-09 上传

2023-05-26 上传

2023-10-08 上传

2023-05-24 上传

2023-10-17 上传

2024-06-06 上传

passionSnail

- 粉丝: 458

- 资源: 7362

最新资源

- 全国江河水系图层shp文件包下载

- 点云二值化测试数据集的详细解读

- JDiskCat:跨平台开源磁盘目录工具

- 加密FS模块:实现动态文件加密的Node.js包

- 宠物小精灵记忆配对游戏:强化你的命名记忆

- React入门教程:创建React应用与脚本使用指南

- Linux和Unix文件标记解决方案:贝岭的matlab代码

- Unity射击游戏UI套件:支持C#与多种屏幕布局

- MapboxGL Draw自定义模式:高效切割多边形方法

- C语言课程设计:计算机程序编辑语言的应用与优势

- 吴恩达课程手写实现Python优化器和网络模型

- PFT_2019项目:ft_printf测试器的新版测试规范

- MySQL数据库备份Shell脚本使用指南

- Ohbug扩展实现屏幕录像功能

- Ember CLI 插件:ember-cli-i18n-lazy-lookup 实现高效国际化

- Wireshark网络调试工具:中文支持的网口发包与分析