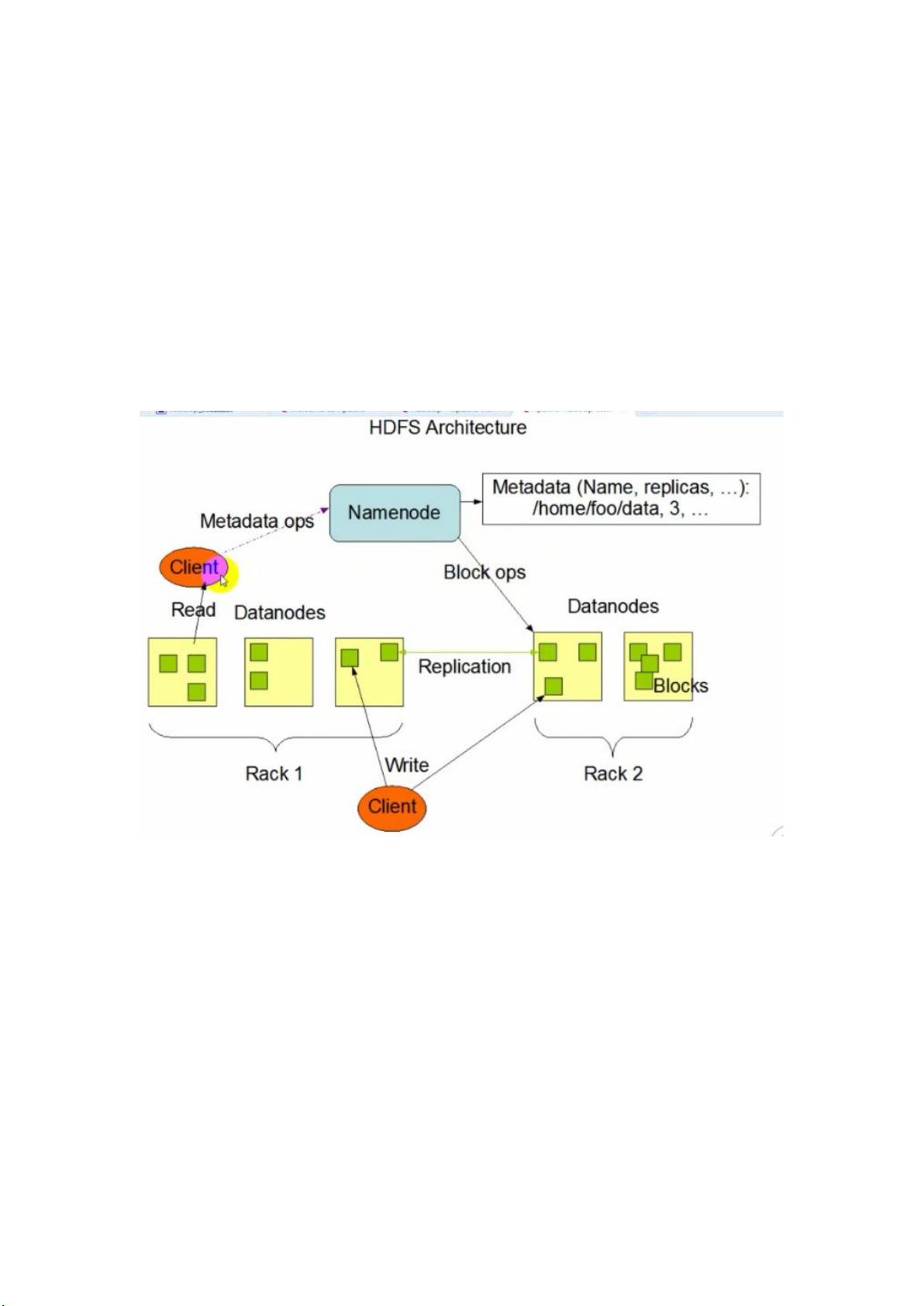

Hadoop基础知识涵盖了大数据领域中的核心技术栈,尤其是针对Hadoop生态系统的关键组件及其应用场景。Hadoop分布式文件系统(HDFS)作为基础架构,提供高容错性和高吞吐量,特别适用于处理大规模数据集。其设计目标是能够在廉价硬件上运行,使得大数据处理变得经济可行。 Hadoop的核心组件包括: 1. **HDFS (Hadoop Distributed File System)**:分布式存储系统,将数据分成块进行复制,确保数据的高可用性和容错性。它支持大规模数据的高效读写,适合批量处理。 2. **MapReduce**:离线计算框架,将复杂的计算任务分解成一系列可并行执行的小任务,通过数据本地性原理提升性能。 3. **YARN (Yet Another Resource Negotiator)**:资源管理器,负责在集群上调度和分配计算资源,支持MapReduce和更高级别的计算服务。 4. **HBase**:分布式列式数据库,基于HDFS,专为随机读写密集型应用设计,如在线服务和实时分析。 5. **Hive**:一个SQL-like查询语言,提供了易用的接口来处理Hadoop上的大量数据,优化了MapReduce任务执行。 6. **Zookeeper**:分布式协调服务,用于配置管理、命名空间维护和故障恢复。 7. **NoSQL数据库**:如Hypertable和Membase/MongoDB,提供了灵活的数据模型和高扩展性,适应不同类型的数据存储需求。 商业大数据解决方案则包括一体机数据库(如IBM PureData、Oracle Exadata和SAP HANA)、数据仓库(Teradata AsterData等)和数据集市(如QlikView和Tableau)等。 在大数据生态体系中,数据来源广泛,涉及结构化、半结构化和非结构化数据。数据传输层工具如Sqoop、Flume和Kafka分别负责数据迁移、日志收集和实时消息传递。Spark作为一个重要的计算引擎,提供了内存计算和流处理能力,相比MapReduce性能显著提升。 大数据应用涵盖多个行业,例如大型网站、电信运营商、视频分析、推荐系统以及实时监控等。从数据采集、存储、处理到分析展示,每个环节都对应着特定的技术和工具。大数据的生命周期管理涉及到任务调度(如Oozie和Azkaban)、数据操作层(Hive和Mahout)、实时计算(Spark Streaming和Storm)以及最终的业务模型展示。 理解并掌握这些关键技术是进入大数据领域并有效利用其潜力的关键。随着数据的增长和业务需求的变化,持续学习和更新知识库对于保持竞争力至关重要。

剩余51页未读,继续阅读

- 粉丝: 17

- 资源: 14

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- zlib-1.2.12压缩包解析与技术要点

- 微信小程序滑动选项卡源码模版发布

- Unity虚拟人物唇同步插件Oculus Lipsync介绍

- Nginx 1.18.0版本WinSW自动安装与管理指南

- Java Swing和JDBC实现的ATM系统源码解析

- 掌握Spark Streaming与Maven集成的分布式大数据处理

- 深入学习推荐系统:教程、案例与项目实践

- Web开发者必备的取色工具软件介绍

- C语言实现李春葆数据结构实验程序

- 超市管理系统开发:asp+SQL Server 2005实战

- Redis伪集群搭建教程与实践

- 掌握网络活动细节:Wireshark v3.6.3网络嗅探工具详解

- 全面掌握美赛:建模、分析与编程实现教程

- Java图书馆系统完整项目源码及SQL文件解析

- PCtoLCD2002软件:高效图片和字符取模转换

- Java开发的体育赛事在线购票系统源码分析

信息提交成功

信息提交成功