非线性最小二乘法:高斯牛顿迭代详解

需积分: 18 93 浏览量

更新于2024-09-14

1

收藏 663KB DOC 举报

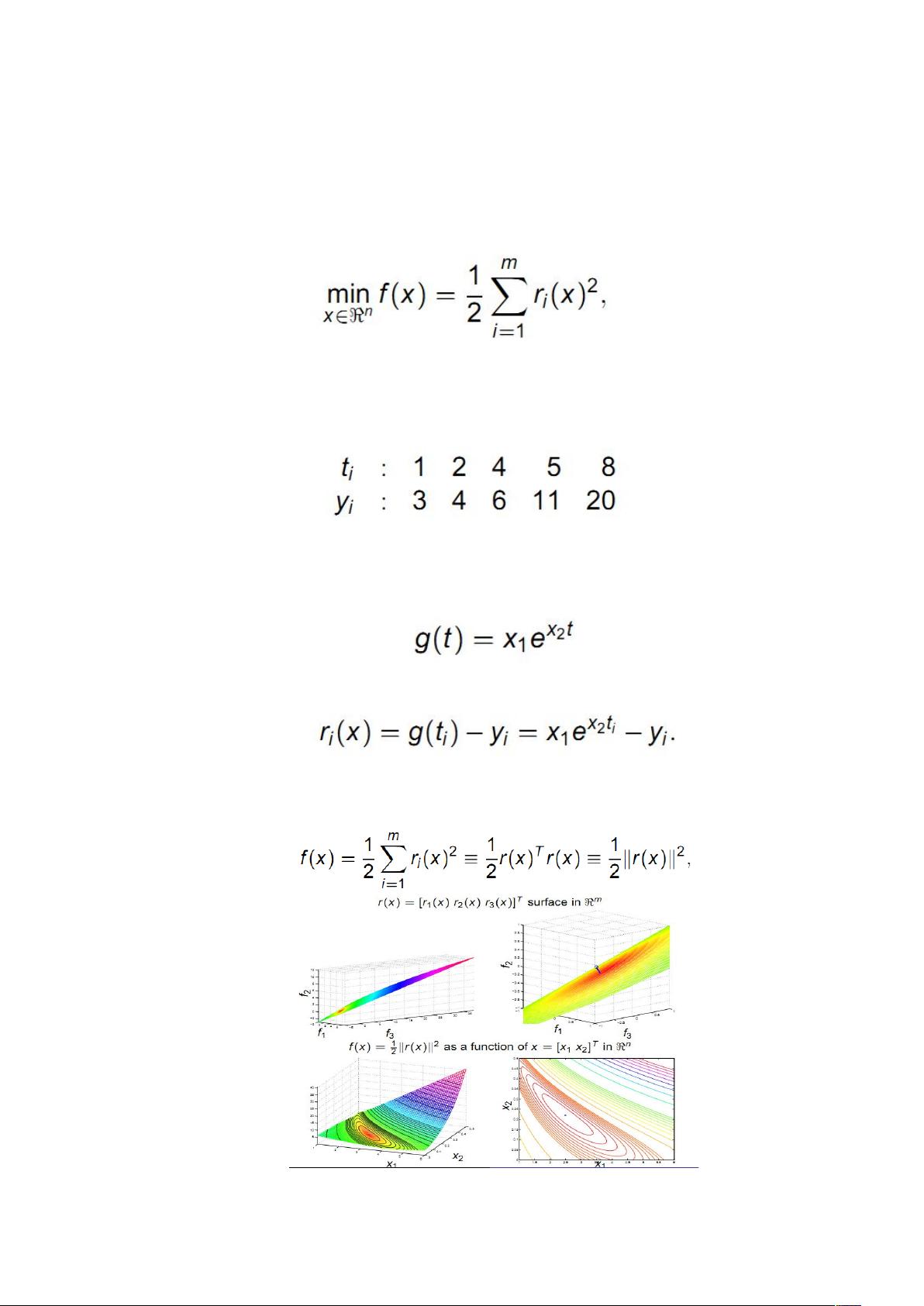

"高斯牛顿迭代是一种解决非线性最小二乘问题的优化算法,主要应用于无约束最优化问题。这种方法与牛顿法有相似之处,但避免了计算二阶导数,从而降低了计算复杂性。"

在非线性最小二乘问题中,目标是找到一组参数使得残差函数的平方和最小。例如,对于一个数据拟合问题,如果实际数据点与理论模型之间存在差异,我们可以构建一个剩余函数,表示模型预测值与实际观测值的差距。通过最小化这些差值的平方和,我们可以找到最佳参数估计。

高斯牛顿法利用了梯度(Gradient)和海森矩阵(Hessian)的概念。梯度是函数的一阶偏导数构成的向量,而海森矩阵包含了一阶偏导数和二阶偏导数的信息,反映了函数的曲率。在高斯牛顿法中,由于不直接计算二阶导数,而是通过雅可比矩阵(Jacobian)的转置乘以其自身来近似海森矩阵。雅可比矩阵代表了函数的局部线性变化。

迭代过程如下:首先,我们对当前点的残差函数进行泰勒级数展开,保留一阶项并忽略二阶项,这相当于用线性化模型逼近非线性函数。然后,通过求解线性系统来更新参数,该线性系统由雅可比矩阵的转置乘以其自身和残差的负梯度构成。如果雅可比矩阵是满秩的,解出的更新向量将导致函数值的下降,从而逐渐逼近最小值。

与牛顿法相比,高斯牛顿法的优点在于简化了计算,特别是在处理大型问题时,因为计算海森矩阵可能非常耗时。然而,它也有其局限性。如果二阶导数较大或雅可比矩阵不是满秩,高斯牛顿法可能收敛较慢,甚至可能不收敛。此外,如果初始点远离全局最小值,高斯牛顿法可能被困在局部最小值中。

总结来说,高斯牛顿迭代是一种强大的工具,用于解决非线性最小二乘问题,尤其在计算资源有限的情况下。它的核心思想是通过线性化来逼近非线性问题,以实现有效的参数优化。然而,它并不总是最优解决方案,因为其性能依赖于问题的特性,包括函数的光滑性、初始点的选择以及雅可比矩阵的结构。在实际应用中,可能需要结合其他优化策略,如Levenberg-Marquardt算法,以提高求解的稳定性和效率。

1564 浏览量

101 浏览量

2022-09-23 上传

378 浏览量

965 浏览量

101 浏览量

u011056900

- 粉丝: 0

- 资源: 1

最新资源

- jdk-11.0.6_windows-x64_bin.exe

- 接近客户的技巧——电话接近客户的技巧

- apsiyon-test-study

- i-sport:本学期的微信小程序期末设计,一种为喜爱运动健身人士所设计的APP

- goit-js-hw-07

- taskboard-ui

- Impellent.Developer.Tools:我自己的开发者工具的集合

- umodel_win32.zip

- 新人衔接教育30天销售实务培训班主任手册

- FORTE11.rar

- elex:对网关列表执行选举速度检查,以找到最快的网址

- win10打印机安装软件,一键配置ip打印

- pta_sim:PTA模拟代码存储库

- archive.cheesits456.dev:我网站的旧版本

- hello-world

- 客户服务与经营