非线性最小二乘法:高斯牛顿迭代解析

需积分: 18 150 浏览量

更新于2024-09-11

收藏 663KB DOC 举报

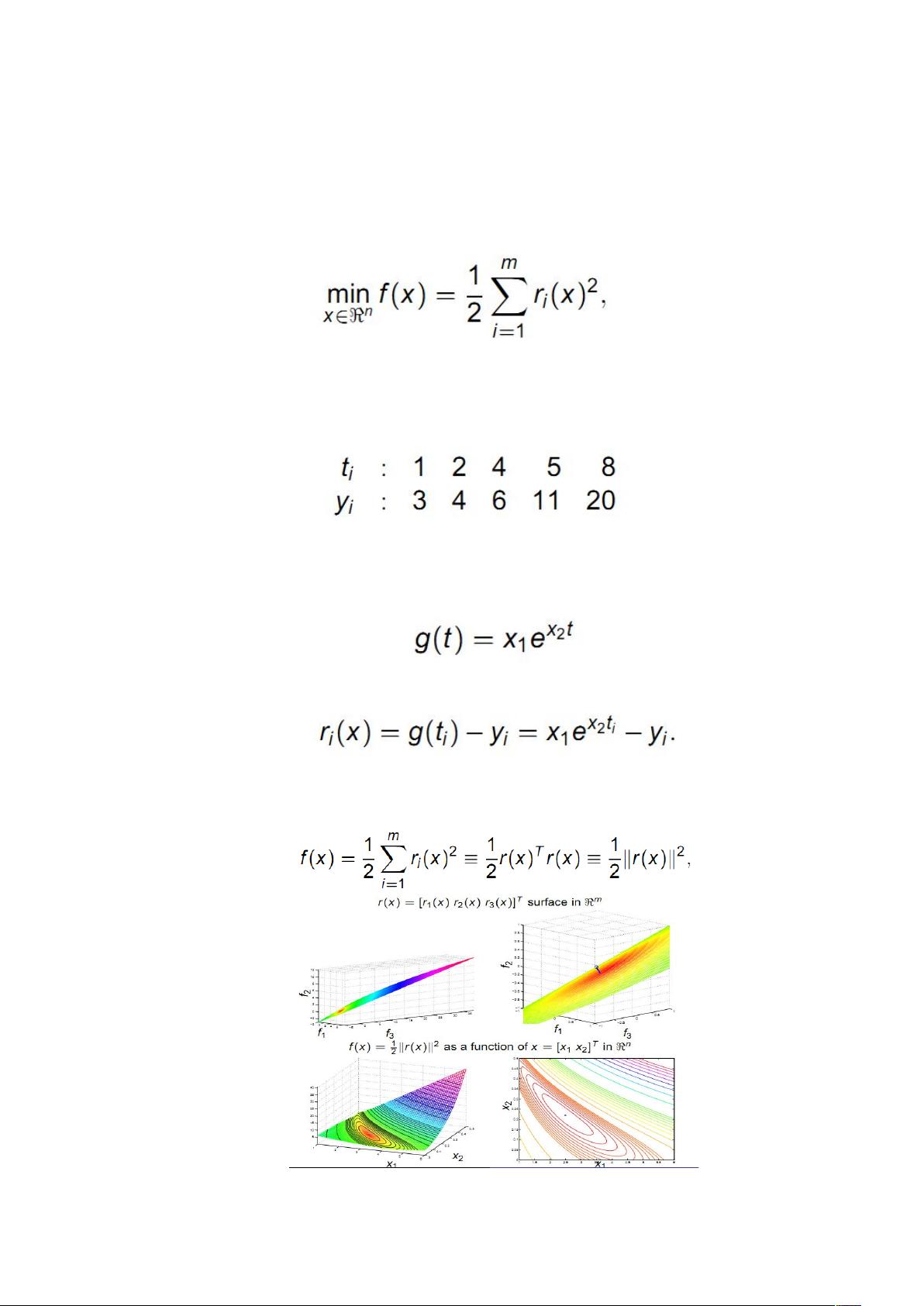

"高斯牛顿迭代是一种非线性最小二乘法的优化算法,用于找到使得一组辅助剩余函数平方和最小的变量解。这种方法在处理数据拟合、参数估计等许多实际问题中非常常见。高斯牛顿法与牛顿法的主要区别在于,它不需要直接计算目标函数的二阶导数矩阵(海森矩阵),而是通过雅可比矩阵的转置乘以其自身来近似海森矩阵,从而简化了计算过程。"

在非线性最小二乘问题中,目标是找到一个向量x,使得剩余函数r(x)的平方和达到最小。例如,在一个典型的人口增长模型中,实际人口数据与理论模型之间的差距被定义为剩余函数,通过最小化这些剩余的平方和来确定模型参数。

高斯牛顿法的核心在于梯度和海森矩阵。梯度是目标函数的一阶偏导数构成的向量,而海森矩阵则是目标函数的二阶偏导数组成的矩阵。在高斯牛顿法中,雅可比矩阵J(x)表示了目标函数对变量的线性变化,而Hessian Q(x)是J(x)的二阶导数。对于非线性最小二乘问题,当r(x)等于零时,Q(x)也接近于零,这意味着模型与实际数据的匹配度较高。

迭代过程如下:首先,通过线性化剩余函数r(x)来构建近似问题,然后求解线性系统的解来更新变量x。线性化的形式为r(x) ≈ J(x)(x - xk),其中xk是当前迭代的解。利用这个近似,可以形成以下迭代公式:

\[ x_{k+1} = x_k - [J^T(x_k)J(x_k)]^{-1} J^T(x_k) r(x_k) \]

如果雅可比矩阵J(x)在迭代点附近是满秩的,那么上述迭代会带来下降且收敛的步长。与标准牛顿法相比,高斯牛顿法在计算上更高效,因为它避免了直接计算和求逆海森矩阵。然而,如果目标函数的二阶导数很大,高斯牛顿法可能收敛较慢。

总结起来,高斯牛顿迭代是解决非线性最小二乘问题的一种有效方法,它利用雅可比矩阵近似海森矩阵,简化了计算,但可能在某些情况下不如牛顿法稳定或快速。在实际应用中,需要根据问题的具体特性选择合适的优化策略。

101 浏览量

点击了解资源详情

281 浏览量

101 浏览量

2022-09-23 上传

378 浏览量

965 浏览量

1580 浏览量

zgljiayou

- 粉丝: 1

- 资源: 31

最新资源

- 基于BIC、EM算法构建贝叶斯网

- 山社步进电机EnterCAT描述文件

- jquery.preloader:jQuery preloader插件

- VIM Emulator plugin for IntelliJ IDEA-开源

- 电子功用-故障导向安全的动态采集电路及故障导向安全的装置

- 沟通和追踪的秘笈

- portafolio-personal:Portafolio个人资源前端网络服务提供商React.js Node.js和Express.js。 Tengo Pensadoañadirmas funcionalidades en un Futuro

- 布局不稳定性:布局不稳定性规范的建议

- jQuery-TH-Float:jQuery插件-浮动的THEAD和TFOOT已在视图中修复

- Business_Cases_Projects

- nextjs-tutorial:学习使用Nextjs构建全栈React应用

- bioMEA

- 保险行业培训资料:试着把生命折迭51次

- node-app-etc-load:加载配置文件

- WIN

- py_udp:使用 Python 发送/接收 UDP 数据包。-matlab开发