改进的双词嵌入Bi-LSTM文本表示模型

128 浏览量

更新于2024-08-29

1

收藏 1MB PDF 举报

"本文提出了一种基于神经网络的文本表示模型新方法,该方法结合了double word-embedding和Bi-LSTM,用于文本特征词向量的提取和文本分类。通过构建词典索引和词性索引的double word-embedding列表,然后利用Bi-LSTM进行特征提取,最后通过mean-pooling和softmax层处理,提高了文本表示的质量和序列表达效果。实验结果显示,此模型优于传统的LSTM、LSTM+context window和Bi-LSTM模型。"

在当前的自然语言处理领域,文本表示是至关重要的一步,它能够将非结构化的文本数据转化为机器可以理解和处理的形式。本文提出的新型文本表示模型旨在解决这个问题,通过结合不同的技术来优化文本的特征提取过程。具体来说,模型首先利用词典索引和词性信息创建了一个double word-embedding列表,这种方法考虑了词汇的上下文语义和语法特性,增强了词向量的表示能力。

Double word-embedding是一种扩展的词向量表示方法,它不仅考虑了词的自身含义,还包含了词的词性信息,使得每个词的向量能够反映其在不同语境下的多维度意义。这种双层嵌入能够捕捉到更丰富的词汇特征,有助于提高后续处理的准确性。

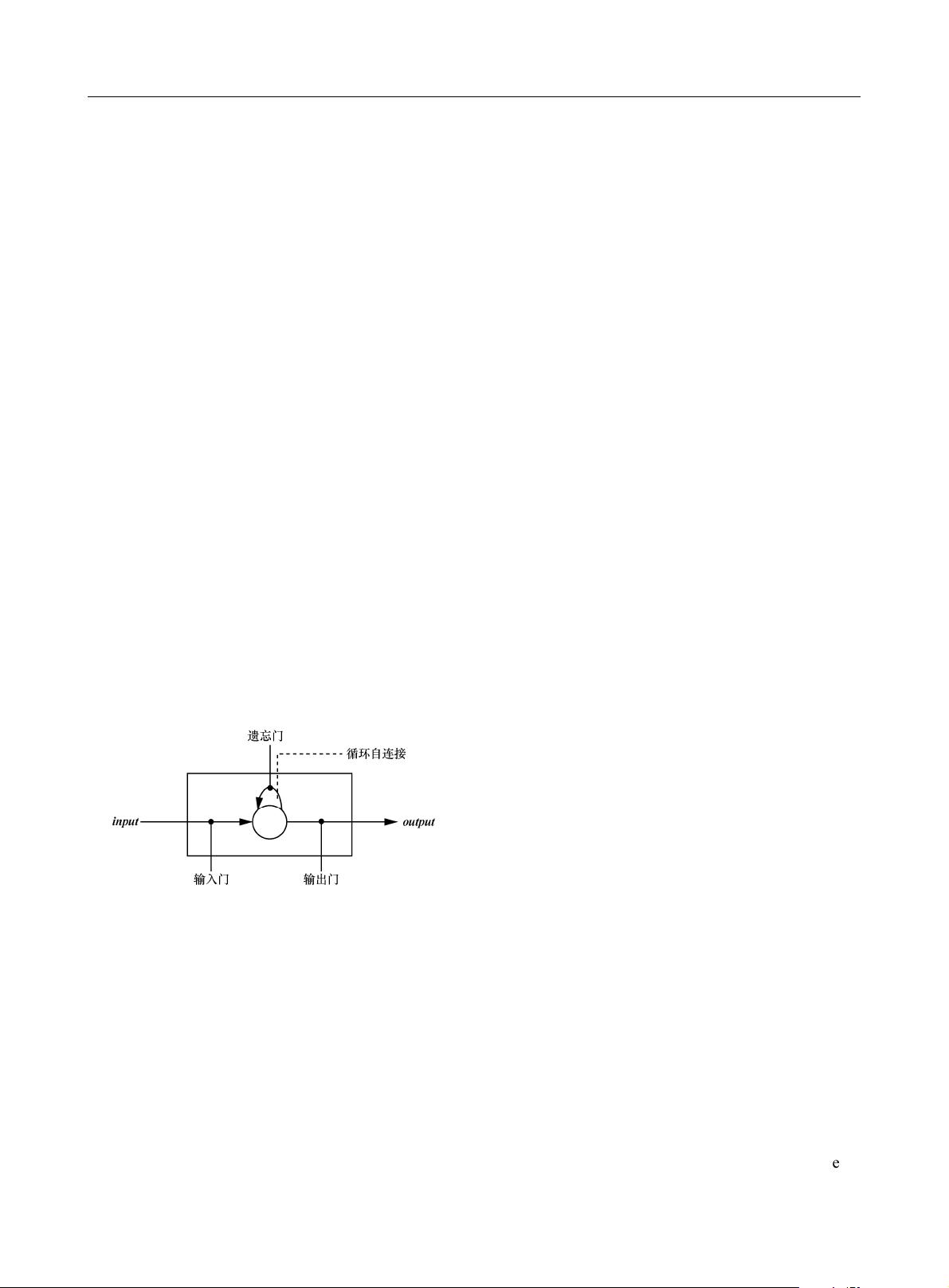

接下来,文章引入了双向长短期记忆网络(Bi-LSTM)来进一步提取特征。Bi-LSTM是LSTM的一个变体,它同时考虑了词的前向和后向上下文信息,能够更好地捕获序列中的依赖关系。在处理文本时,Bi-LSTM可以从两个方向学习词序信息,从而提供更为全面的上下文理解。

在Bi-LSTM处理过的词向量上,模型采用了mean-pooling层来整合整个句子的特征,这一操作可以得到一个代表整个句子的固定长度向量。mean-pooling的优势在于它能够忽略掉序列中的相对位置信息,只保留最重要的特征。最后,通过softmax层进行文本分类,这个层能够将每个类别的概率分布计算出来,使得模型可以对文本进行准确的分类。

实验结果证明,这种结合double word-embedding和Bi-LSTM的模型在文本特征提取和序列表达方面表现优秀,并且在与传统模型如LSTM、LSTM+context window以及单纯的Bi-LSTM的比较中,显示出了显著的性能优势。这表明该模型在处理高质量文本特征向量和表达复杂序列时具有较高的效率和准确性,对于自然语言处理任务,如情感分析、文本分类和语义理解等,具有广阔的应用前景。

2021-09-26 上传

2021-09-25 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

2021-09-26 上传

2021-09-25 上传

weixin_38725450

- 粉丝: 1

- 资源: 913

最新资源

- SSM动力电池数据管理系统源码及数据库详解

- R语言桑基图绘制与SCI图输入文件代码分析

- Linux下Sakagari Hurricane翻译工作:cpktools的使用教程

- prettybench: 让 Go 基准测试结果更易读

- Python官方文档查询库,提升开发效率与时间节约

- 基于Django的Python就业系统毕设源码

- 高并发下的SpringBoot与Nginx+Redis会话共享解决方案

- 构建问答游戏:Node.js与Express.js实战教程

- MATLAB在旅行商问题中的应用与优化方法研究

- OMAPL138 DSP平台UPP接口编程实践

- 杰克逊维尔非营利地基工程的VMS项目介绍

- 宠物猫企业网站模板PHP源码下载

- 52简易计算器源码解析与下载指南

- 探索Node.js v6.2.1 - 事件驱动的高性能Web服务器环境

- 找回WinSCP密码的神器:winscppasswd工具介绍

- xctools:解析Xcode命令行工具输出的Ruby库